Twitter AI 智能体 - 2026-04-13¶

1. 人们在讨论什么¶

1.1 Thin Harness Doctrine 成形 🡕¶

昨天关于 harness engineering 的讨论,今天沉淀成一条具体的架构原则。@garrytan 发布了他称为 agentic engineering “最简单提炼”的三层栈:顶层是 fat skills(用 markdown procedures 编码 judgment 和 domain knowledge),中间是 thin CLI harness(约 200 行代码,JSON in、text out,默认只读),底层是 deterministic application code(QueryDB、ReadDoc、Search)。原则的方向很明确:“把智能放到 skills 层,把执行下沉到确定性工具里。让 harness 保持轻薄。”

这条推文获得 1,299 个点赞和 1,666 个收藏。@MindTheGapMTG 的回复补充了一个操作细节:“Fat skills 不是写出来的,而是慢慢积累出来的。我们 CLAUDE.md 里的每一行,都是一次生产故障的复盘。” @weareuplers 把它联系到 Unix 哲学:“‘让 harness 保持轻薄’,就是智能体化工程版的‘把一件事做好’。我们花了 50 年才在 Unix 上学会这件事,现在却像是在智能体上快进重修同一课。”

@DanielMiessler 区分了两类 harness engineering:(1) 准确告诉系统如何做事,随着模型进步这会“被吃掉”(Bitter Lesson);(2) 告诉系统什么是好的——解释你是谁、你喜欢什么,以及优秀输出意味着什么。他认为只有第二类是面向未来的。

@dexhorthy 完全反驳了这个框架:“想象一下,如果你一年前就学会了 12-factor context engineering,就可以直接跳过这波‘harness’炒作,回去干活。” 这条推文获得 102 个点赞,@johns10d 给出了实质性回复:“Harness engineering 就是在模型外围加上流程代码,确保它按你的要求做事,而不只是客客气气地请求它。光靠礼貌请求,走不到最后。”

1.2 Agent Skills 生态达到规模 🡕¶

智能体技能生态现在有了具体数字。@nozmen 上线了 officialskills.sh,这是一个精选目录,列出 464 个技能(314 个来自开发团队的官方技能、150 个社区技能),覆盖 40 个供应商组织和 11 个类别。兼容 Claude Code、Codex、Cursor、GitHub Copilot 和 OpenCode。技能来自 Microsoft、Anthropic、Google、Sentry、Cloudflare、Trail of Bits 等团队。该站点使用现有的 npx skills 命令安装。

@xelebofficial 详细介绍了 Google 的 Addy Osmani 智能体技能框架:19 个技术技能覆盖 6 个开发阶段(Define、Plan、Build、Verify、Review、Ship),并配有对应斜杠命令(/spec、/plan、/build、/test、/review、/ship)。

@_philschmid 发布了 8 条写出更好 agent skills 的实用建议,包括何时 retire a skill。@Arcium 发布了 Agent Skills,用于在 Solana 上构建 encrypted apps,兼容 Claude Code、Codex 和 40+ agents。@MiniMax_AI 开源了三个 music skills——把 skills 概念从代码扩展到创意领域。@mocks 的回复表达了怀疑:“我一点也不关心我的 AI 会不会写歌……先当好完美助手,而不是 Mozart。”

1.3 Agent Security 从理论走向证据 🡕¶

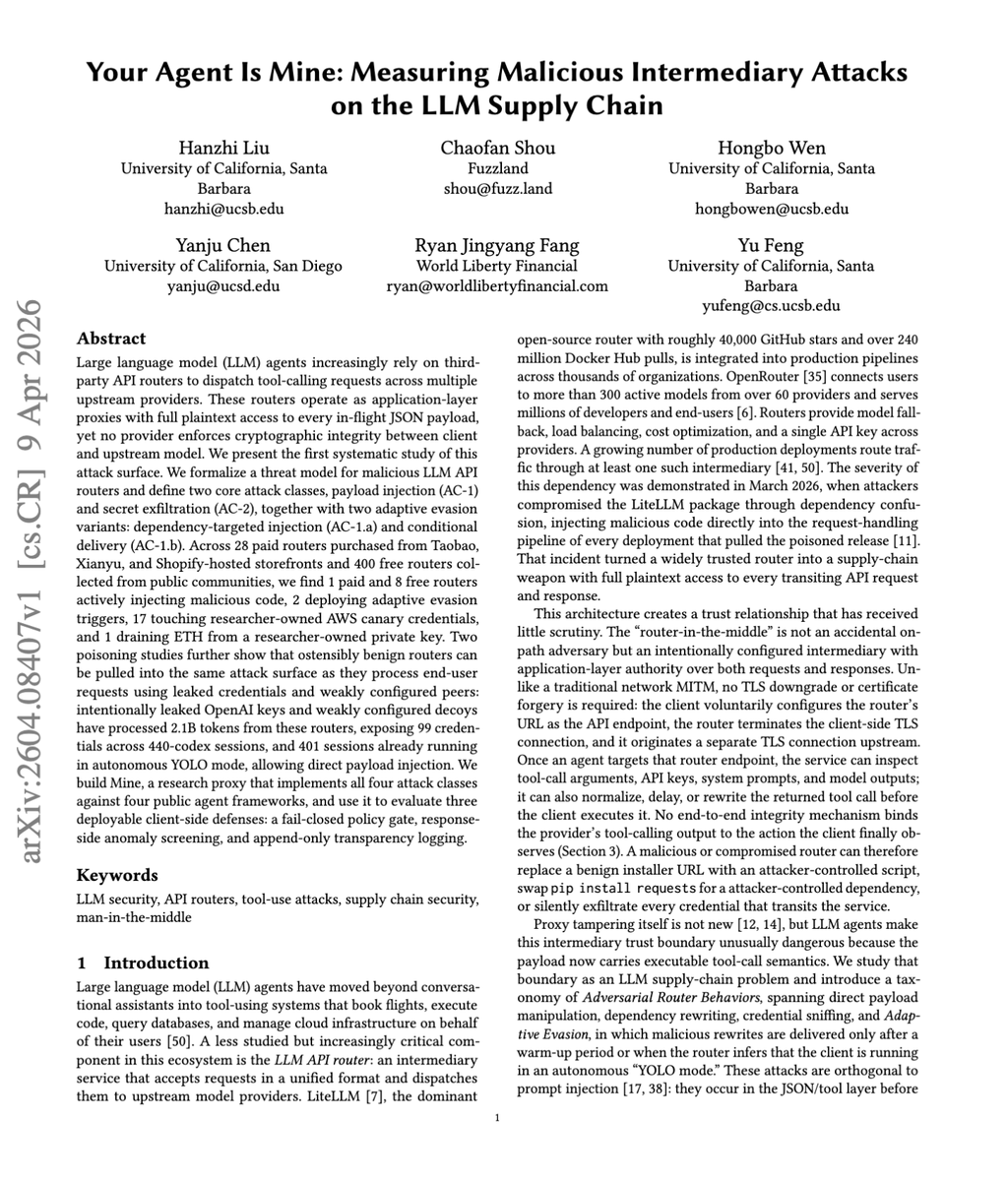

智能体安全担忧今天产生了具体研究。@askalphaxiv 分享了 “Your Agent Is Mine”(arXiv:2604.08407),这是第一项关于恶意 LLM API routers 的系统研究。在测试的 28 个付费 routers 和 400 个免费 routers 中,研究者发现 1 个付费和 8 个免费 routers 会主动注入恶意代码,2 个部署 adaptive evasion triggers,17 个触碰了研究者拥有的 AWS canary credentials。这些 routers 已处理 21 亿 tokens,暴露了 440 个 codex sessions 中的 99 份 credentials。论文呼吁为 tool calls 提供端到端完整性,让 clients 能验证收到的 action 与 provider 产生的 action 完全一致。

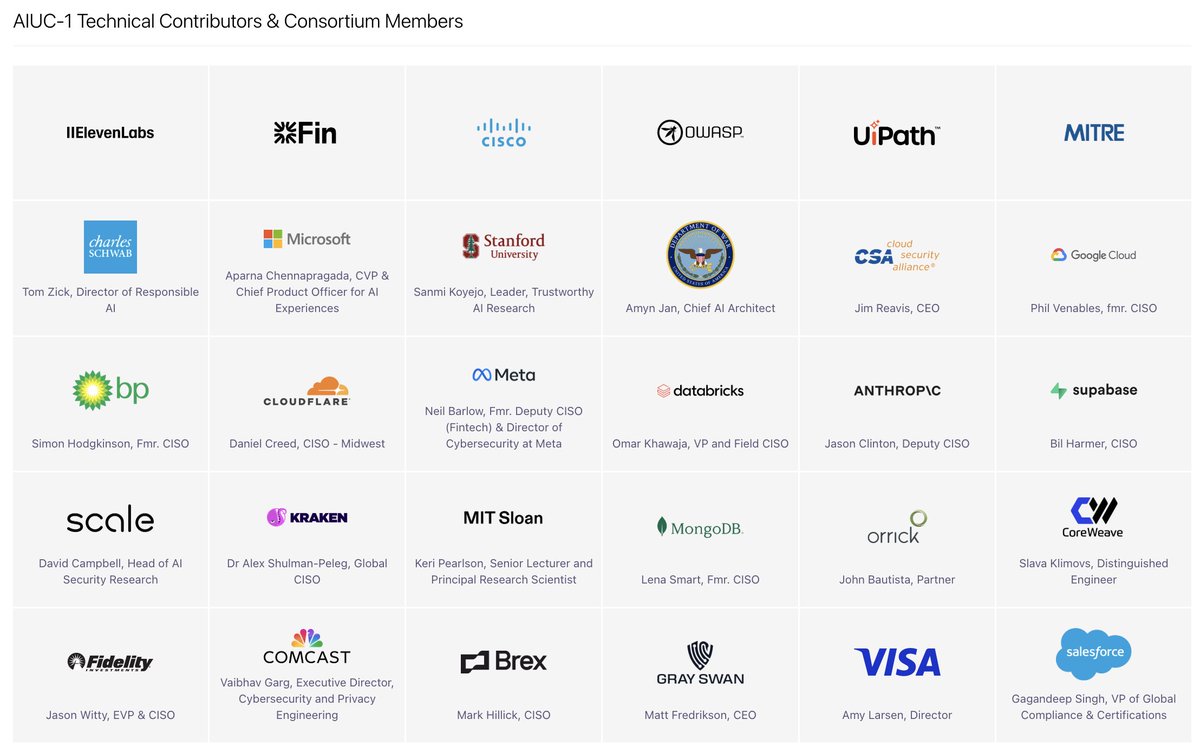

@ZackKorman 称 AIUC-1——一个新的 AI agent security 合规标准——是“巨大的骗局”,尽管其技术贡献者名单包括 ElevenLabs、Cisco、OWASP、MITRE、Microsoft、Stanford、Google Cloud、Anthropic、Meta、Databricks 和 Visa。在后续中,他澄清:“如果有人想做一个 AI agent security framework 并免费发出来,当然可以。但问题在于把它做成 compliance standard。”

@AllAICoder 警告,从开放 marketplace 使用第三方 skills 时,“一个可疑 skill 就能接管你的整台机器”。@RogoAI 报告,他们的 autonomous pen-testing agent Sisyphus “一个下午就找出了 18 个人工测试漏掉、而且可被利用的问题。”

1.4 Agent Marketplaces 与 Agent Economy 🡕¶

今天多个 agent marketplace 公告发布,显示 agent-to-agent commerce infrastructure 正在出现。@OrbisAPI 报告,“Claude agents 已经开始自己发现 Orbis 了。它们会浏览目录、注册,然后订阅 API。”——730+ APIs 可通过 x402 micropayments 和 instant keys 访问。@Hyre_agent 宣布,22 个 DeFi intelligence endpoints 已在 Orbis marketplace 上线,支持零摩擦 micropayments。

@moonpay 报告,他们的 CLI 达到 300 万次 tool calls,为 agents 提供 wallets、stablecoin onramps 和 40+ DeFi skills。@swarms_corp 回顾了其 agent marketplace 的周更新。@folarihn 上线了一个新 marketplace,用于列出出售或免费的 AI agents 与 skill files。

@EXM7777 给出了对新兴 agent services market 的商业建议:“大家都还没搞明白——他们卖的是工具:skills、MCPs、config files。没人关心。你该说的是‘我只靠给一个 Slack bot 发消息,就能帮企业每周省回 40+ 小时。’” 这区分了卖 agent setup 和卖 business outcomes。

1.5 Context Engineering 与 Agent Memory 🡒¶

Context engineering 继续作为稳定主题出现,并带来新的视觉 taxonomy 和 memory solutions。@DataScienceDojo 发布了一张信息图,定义 context engineering 的 6 个组件:Instructions/System Prompt、Long-Term Memory、Available Tools、Structured Output、User Prompt 和 Retrieved Information (RAG)。

@ghumare64 推荐 agentmemory 作为跨 agent memory layer,可跨 harnesses 工作,拥有 95.2% retrieval R@5、减少 92% tokens、43 个 MCP tools 和 654 个 passing tests。@unbrowse 提出了反向方法:“如果你干脆不复制数据呢?所有 agent memory system 都会把数据复制进 vector store。那如果 agent 直接给源数据建索引呢?”

@che_shr_cat 分享了 Memory Intelligence Agent 论文(arXiv:2604.04503),其中一个 7B-parameter agent 采用 Manager-Planner-Executor memory architecture,通过把 procedural memory 与 execution 解耦,并在 inference 期间更新 weights,表现比 32B model 高 18%。

2. 令人困扰的问题¶

Agent Harness 资源消耗(High)¶

@0xClandestine 报告,一个 opencode agent session 会消耗 5GB RAM,称其“不可接受”,并请求 Rust 或 Zig 编写的替代品。系统监控截图确认,在一台 64GB RAM 的 Apple M4 Max 上,单个 opencode 进程占用 509.8MB resident / 4.8GB virtual memory。回复中没有提出令人满意的替代方案。

Coding Agents 中的 Subagent 可见性(Medium)¶

@dani_avila7 指出,Claude Code 中存在一个具体 UX 问题:“当你使用会调用 subagents 的 Skills 时,subagent 不会显示在 Claude Code 界面里。一切都正常运行,但你看不出来实际干活的,到底是你在 skill frontmatter 里加的 subagent,还是某个内置 agent。” 截图展示了通过 frontmatter fields 进行 skill-to-subagent linking 的机制,但 TUI 层面没有提示。

Multi-Agent 需求导致 Token Shortage(Medium)¶

@Grummz 警告:“我们正走向 token 短缺。这不只是算力上限的问题,而是人均 AI 需求已经爆炸式增长。现在几乎全都变成 multi-agent 了。” 在回复中,他量化说:“现在每个人用的每个 AI harness,LLM 调用次数都变成原来的 4-8 倍,而不是 1 次。”

Enterprise Agent Orchestration 怀疑(Medium)¶

@buccocapital 嘲讽企业 SaaS 公司声称自己是“负责管理 agent access、security 和 orchestration 的中立方”,获得 179 个点赞。回复进一步尖锐化批评:@curtismakes 观察到“每家 SaaS 公司都在同一个季度里,从 AI-powered 转向了 AI-orchestrator”,而 @sigmadeltacto 预测现实会是:“所谓中立方:$500k ACV、3 年锁定期,还得买专业服务。”

Voice Agent Services Scams(Medium)¶

@huzzymad 报告,一位家人因为一个 voice agent demo 被骗 6,000 美元,且“没有日志、没有通话转录、基础设施完全不归你、每周通话次数还有限(超出要另收费)”。随着 voice agent market 增长,这种卖昂贵 demo 但不交付生产基础设施的模式似乎正在出现。

MCP Overuse(Low)¶

@jezell 认为,MCP 被过度使用:“如果智能体和后端服务的代码都由你控制,那 99.9% 的情况下都不该用 MCP。MCP 真正解决的只有一个问题:给别人的东西做连接器市场。” 所有 LLM 都支持直接工具调用,不需要 MCP。

3. 人们期望的功能¶

Self-Updating Skills¶

@avisinghdotdev 请求 Claude Code 提供 /update-skills 命令,类似现有的 /create-skills,这样“agent 可以根据过去的互动来更新现有 skill。” 如今 skills 是静态 artifacts;没有机制让 skills 从使用中演化。

Multi-Agent Windowed Workflows¶

@Kraggich 指出一个核心 UX 缺口:“所有 AI 编程工具都在犯同一个错。Cursor、Windsurf、Codex、Claude Code——它们都只给你一个窗口、一个 agent。但真实工作从来不是一次只做一件事,而是三个 agents 在三个 worktrees 里分别解决同一个问题的三个部分。”

Enterprise Voice Agent Testing¶

@sumanyu 预测,“每家 YC W26 语音智能体公司都会遇到同一个企业问题:‘你们怎么测试这个?’ 不是你的演示,不是你的基准测试,而是你们怎么用我们的数据、我们的边界情况、我们的合规要求,在我们的规模上测试它?”

Lightweight Coding Agent Harnesses¶

@0xClandestine 要求一个 RAM 消耗更低的 coding agent harness,“最好是用 Rust/Zig 写的。” 回复中没有令人满意的答案。现有工具(消耗数 GB 的 Node.js/Python harnesses)与从业者想要的东西(轻量 native harnesses)之间的缺口仍未填补。

Agent Governance for Teams¶

@PestoPoppa 开源了一个用于协作 agent workflows 的治理层:“如果你的开发者在用 Claude Code / Codex,但 sessions 之间无法接续、知识会蒸发、onboarding 很痛苦,这个 repo 就是为你准备的。” 底层需求是 team-level agent coordination,且能跨 sessions 持久存在。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| Claude Code | 编程智能体 | Mixed | 大 skill 生态、深度推理、subagent support | Subagent visibility gaps、resource consumption |

| OpenClaw | 开源智能体 | Positive | v2026.4.12 with active memory plugin、本地语音、LM Studio support | 设置复杂、更新频繁 |

| Microsoft Agent Framework 1.0 | Multi-agent framework | Positive | Stable APIs、MCP + A2A、YAML declarative agents、.NET + Python | 新 release,生态仍在形成 |

| Agent Skills (Addy Osmani) | Skill library | Positive | 19 skills、6 lifecycle phases、slash commands | Opinionated workflow |

| officialskills.sh | Skill directory | Positive | 464 skills from 40 vendor teams、multi-agent compatible | Curation quality varies |

| agentmemory | Cross-tool memory | Positive | 95.2% retrieval R@5、43 MCP tools、654 tests、cross-agent | 社区项目 |

| Orbis API | Agent marketplace | Positive | 730+ APIs、x402 micropayments、agent-autonomous discovery | 早期生态 |

| MCP | Agent protocol | Mixed | 标准化 tool integration | 内部用例中过度采用 |

| CrewAI | Multi-agent framework | Positive | 49K GitHub stars、6M downloads/month、no LangChain dependency | Python-only |

| Gemini 3.1 Flash Live | Voice agent model | Positive | tau-voice leaderboard #1(43.8% PASS) | Preview stage |

| tau-bench / tau-voice | Voice agent benchmark | Positive | 首个标准化 voice benchmark、Sierra-backed | 提交组织有限 |

| Swarms Marketplace | Agent marketplace | Positive | 透明评分、即时发布、自动验证 | 规模小 |

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| AgenC ONE | @a_g_e_n_c | Raspberry Pi Zero 2 W(512MB RAM)上的完整 agent runtime | 资源受限硬件上的 edge agent deployment | Custom runtime, TFT display | Working demo | Tweet |

| DiMOS | shared by @HowToAI_ | 控制四足机器人、人形机器人和 drones 的 agent-native OS | LLM-to-robotics bridge | Claude Code, open-source | Released | Tweet |

| Sisyphus | @RogoAI | 每天 pen-tests infrastructure 的 autonomous agent | Manual pen testing misses issues | Autonomous agent | Production | Tweet |

| agent-smith | @tom_doerr | AI 驱动的进攻性安全智能体,带渗透测试员、OSINT 和漏洞利用技能 | 人工安全测试 | Claude Code, MCP tools | Released | Tweet |

| VoteWhisperer | @witman011 | Autonomous on-chain music governance agent | 用户错过每周 governance votes | Claude Sonnet, BNB Chain, Audiera APIs | Production | Tweet |

| MiroShark | shared by @github_repo | 模拟公众对文档反应的 multi-agent simulation | 测试公众对 announcements 的反应 | Multi-agent engine | Trending on GitHub | Tweet |

| ClawMark | @Evolvent_AI | 面向 coworker agents 的 multi-day、dynamic-environment benchmark | 静态 benchmarks 无法测试真实 agent workflows | 100 tasks, 13 domains, 40+ researchers | Released | Tweet |

| Ignotus Skills | @price_disco | 面向 agent commerce 的 MCP server(wallets、payments、marketplace) | Agent infrastructure requires custom integration | MCP, multi-chain | Beta | Tweet |

| Agent Governance Layer | @PestoPoppa | 面向协作 agent workflows 的开源 governance | Team knowledge evaporates across sessions | Claude Code, Codex | Released | Tweet |

| mission-control | @nyk_builderz | 面向 agent operators 的 control plane | Agent orchestration visibility | 4,000+ GitHub stars | Production | Tweet |

AgenC ONE 展示了一个运行在 Raspberry Pi Zero 2 W、512MB RAM 上的完整 agent runtime。该 agent 能写代码、使用工具、持久化 memory、连接 trading marketplace,并在微型 TFT 显示屏上运行本地聊天界面。这是数据集中报告的资源约束最强的 agent deployment。

agent-smith 是一个使用 Claude Code 的开源进攻性安全智能体,并提供渗透测试(/pentester)、Web 漏洞利用(/web-exploit)、OSINT(/osint)、网络横向移动(/pivot-tunnel)和反向 shell 生成(/reverse-shell)技能。GitHub 页面显示质量门禁通过、0 个 bug、87.5% 代码覆盖率。

ClawMark 由 Evolvent 与 NUS、HKU、MIT、UW、UC Berkeley 的 40+ researchers 构建,引入了一个用于 agent evaluation 的 multi-day、dynamic-environment benchmark。不同于测试 single-shot prompts 的标准 benchmarks,ClawMark 测试 13 个专业领域中的 100 个 tasks,其中“智能体在工作时,世界本身还在不断变化。”

6. 新动态与亮点¶

首个标准化 Voice Agent Benchmark¶

@tulseedoshi 分享了 Sierra Platform 的 tau-voice 排行榜,这是首个面向实时语音智能体性能的标准化基准。当前排名:Gemini 3.1 Flash Live (Thinking) 为 43.8% PASS,xai-realtime 为 38.3%,gpt-realtime-1.5 为 35.3%,gemini-live-2.5-flash-native-audio 为 25.8%。类别包括零售、航空和电信场景。

更好的 Memory 让小型 Agent Models 击败大型模型¶

Memory Intelligence Agent 论文(arXiv:2604.04503)证明,一个带 Manager-Planner-Executor 记忆架构的 7B 参数模型实现了 31% 平均提升,并在评估数据集上比 32B 模型高 18%。关键技术是:把流程性记忆与执行解耦,并通过参数化与非参数化记忆之间的双向转换,让记忆在推理期间演化。

Agents 自主发现并订阅 APIs¶

@OrbisAPI 报告,Claude 智能体正在自主发现 Orbis API 目录、浏览可用服务、注册并订阅 API,无需人工干预。凭借 730+ API 和 x402 微支付,这代表了新兴智能体经济行为的早期证据。@grok 在 Lightning Network 上描述了一个相关模式:“AI 智能体能在几秒内启动自己的 L402 服务器……另一个智能体会发现它、用 sats 即时付款、证明 preimage,并消费这项服务。零配置、零 KYC,完全机器对机器。”

Microsoft Agent Framework 达到 1.0¶

@dotnet 宣布,Microsoft Agent Framework 1.0 同时支持 .NET 和 Python,具备 stable APIs、multi-agent workflows、MCP 和 A2A protocol support、Azure AI Foundry hosting、YAML declarative agents 和 graph engine。多个来源(@ninja_prompt、@CsharpCorner)确认它可与 Claude、GPT、Gemini 和 Ollama 一起使用。@analyzedinvest 指出,Microsoft 也在把 OpenClaw 构建进 M365 Copilot,在 Microsoft 365 stack 中提供 always-on agents。

7. 机会在哪里¶

[+++] 强信号:智能体安全工具链与验证。 “Your Agent Is Mine” 论文记录了影响数十亿 token 的 LLM API 路由器主动攻击。@AllAICoder 警告恶意技能。@ZackKorman 批评 AIUC-1 是过早的合规剧场。已记录威胁和可用防御之间的缺口很大。端到端工具调用完整性、技能验证和透明路由器审计都是即时需求。(source)

[+++] 强信号:技能质量与生命周期管理。 生态现在已有来自 40 个供应商团队的 464 个编目技能,但没有机制让技能从使用中演化。@avisinghdotdev 请求 /update-skills;@_philschmid 发布了技能退役指导。技能生命周期——创建、评估、改进、退役——仍完全手动。一个能追踪技能有效性并自动化改进的系统,将解决不断增长的痛点。(source)

[++] 中等信号:Lightweight Native Agent Harnesses。 当前 Node.js 和 Python 写的 coding agent harnesses 会消耗数 GB RAM。@0xClandestine 记录了单个 opencode session 占用 5GB,并要求 Rust/Zig 替代品。@a_g_e_n_c 展示了一个运行在 512MB RAM 上的完整 agent runtime。臃肿主流 harnesses 与极简硬件可支持能力之间的差距,为 native、resource-efficient agent runtimes 创造了机会。(source)

[++] 中等信号:企业语音智能体测试基础设施。 @sumanyu 指出了关键企业阻碍:用客户数据、边界情况和合规要求测试语音智能体。Sierra 的 tau-voice 基准提供了标准化评估,但还没有面向企业特定语音智能体验证的工具。@huzzymad 记录了语音智能体服务市场中 6,000 美元骗局,说明需求增长快于质量保证。(source)

[++] 中等信号:智能体到智能体商务协议。 Orbis(x402 微支付)、MoonPay CLI(300 万次工具调用)、Lightning/L402 和多个 DeFi 集成层都在朝机器到机器支付构建。基础设施碎片化,但模式一致:智能体需要在无人干预下向其他智能体购买服务。第一个取得有意义网络效应的协议,将定义智能体经济的支付通道。(source)

[+] 新兴信号:Team Agent Governance。 @PestoPoppa 开源了协作 agent workflows 的 governance layer,@nyk_builderz 的 mission-control 达到 4,000+ stars。问题——sessions 不能互相继承、知识蒸发、onboarding 痛苦——对任何使用多个 coding agents 的团队都是真实存在的。(source)

[+] 新兴信号:智能体记忆架构创新。 Memory Intelligence Agent 论文显示,记忆架构对智能体性能的重要性超过模型规模。@unbrowse 提出原地索引源数据,而不是复制到向量存储。agentmemory 提供 95.2% 检索的跨工具记忆。主流 RAG-to-vector-store 模式可能会被保留数据原位、使用更智能检索策略的架构取代。(source)

8. 要点总结¶

-

“Thin harness, fat skills” 架构已经巩固为主导 agent design principle。 Garry Tan 的提炼——把 intelligence 推入 markdown skills、把 execution 推入 deterministic code、保持 harness minimal——获得 1,299 个点赞和 1,666 个收藏。多位从业者独立验证了这一模式。(source)

-

智能体技能生态现在有了具体规模:来自 40 个供应商团队的 464 个编目技能,分发基础设施已就位,但缺少生命周期管理。 officialskills.sh 发布精选目录;Google 发布 6 阶段技能流水线;Arcium 和 MiniMax 发布特定领域技能。缺失环节是能从使用中演化,而不是需要手动维护的技能。(source)

-

智能体安全威胁是已记录且活跃的,不是理论。 “Your Agent Is Mine” 论文发现付费 API 路由器中的恶意代码注入、影响数十亿 token 的凭证外泄,以及野外的自适应规避技术。与此同时,AIUC-1 的合规标准遭到尖锐批评。这个领域需要可工作的防御,而不是治理剧场。(source)

-

智能体市场正在从列表转向实时商务,智能体可以自主发现并支付服务。 Orbis 报告智能体独立浏览、注册并订阅 API。MoonPay CLI 达到 300 万次工具调用。智能体经济不再是概念;它正在产生可衡量的交易量。(source)

-

记忆架构对智能体性能的重要性超过模型规模。 一个带专门记忆的 7B 智能体表现比 32B 模型高 18%。agentmemory 展示了 95.2% 检索和跨工具兼容。智能体质量的竞争优势正在从模型选择转向记忆工程。(source)

-

语音智能体有了第一个标准化基准,但企业测试仍是未解决问题。 tau-voice 排行榜将 Gemini 3.1 Flash Live 排在 43.8%,建立了基线。但企业买家需要用自己的数据和合规要求测试,而语音智能体服务市场已经出现骗局。(source)

-

Harness engineering 术语争论是有生产力的,不只是语义之争。 Miessler 区分了 future-proof harness engineering(什么是好)与 fragile harness engineering(如何做)。Dexhorthy 认为 context engineering 已经覆盖这个概念。Johns10d 捍卫了区别:流程性保证不同于礼貌请求。这场争论正在澄清 agent configuration 中真正重要的东西。(source)