Twitter AI Agent — 2026-04-14¶

1. 人们在讨论什么¶

1.1 Harness 工程从理念走向参考架构 🡕¶

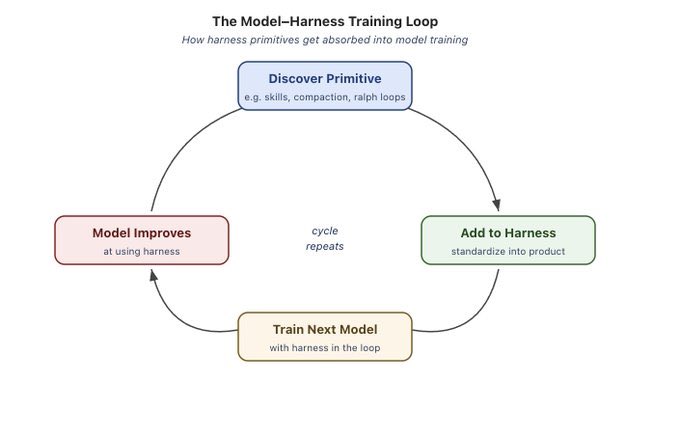

昨天确立了"轻量 harness,重型 skills"的理念。今天社区开始围绕它构建参考基础设施。@Vtrivedy10 发布了一篇从第一性原理出发的分析,解释了 harness 存在的原因,从模型无法独立完成的能力倒推:模型本质上是 token 输入/输出机器,需要通过增强层来获取工具访问、记忆、规划和验证循环能力。该帖获得 206 个点赞和 204 个书签——是今日数据集中的最高分。

@codylindley 在 codylindley.github.io 发布了一份 harness 工程兼容性矩阵,比较了指令格式(AGENTS.md、CLAUDE.md、GEMINI.md、copilot-instructions.md)、自定义智能体系统和技能格式,涵盖 Copilot、Claude Code、OpenCode、Gemini CLI、Cursor、Windsurf 等 10 多款工具。该帖在 26 个点赞的基础上获得了 31 个书签——是数据集中最高的书签与点赞比——表明从业者对参考资料有强烈需求。

@loiane 发表了一篇博文,将 harness 工程定义为一个包含两大支柱的控制系统:前馈(模型运行前的引导——指令、上下文、示例、schema)和自动反馈(执行后的传感器——测试、schema 验证、业务规则检查)。她引用了 Martin Fowler 的 harness 工程文章,将该概念映射到软件交付生命周期上,认为这一转变是"从 in-the-loop 到 on-the-loop"。

@Infoxicador 提出,如果 harness 工程成为常态,投入应集中在模块化和紧密验证循环上——否则"不看代码就疯狂消耗 token"只会产生脆弱的系统。该帖获得 30,328 次浏览和 34 个书签。

讨论要点: @KSimback 展示了如何使用个人知识库研究 harness 工程,特别是分析哪些要素构成护城河、哪些将被商品化。@SynabunAI 的回复揭示了一个关键洞见:"护城河是能跨会话存续的上下文。模型正日益商品化。记忆层才是真正的锁定所在。"

与前日对比: 昨天的讨论确立了轻量 harness 原则。今天讨论碎片化为具体实现细节:兼容性矩阵、控制系统框架以及明确的护城河分析。话语从"harness 工程是什么?"转向"我该如何构建一个?"

1.2 技能自改进成为新实践 🡕¶

今天有三个独立团队发布了自动技能改进工具,将昨天手动的技能生命周期转化为自动反馈循环。@PiSquared 开源了 skill-optimizer,一款用于评估、改进和适配智能体技能的工具,无需反复试错。@Saboo_Shubham_ 使用 Google Agent Development Kit 和 Gemini 3 构建了一个自改进多智能体系统,能够针对测试场景运行技能、诊断故障并自动修复。

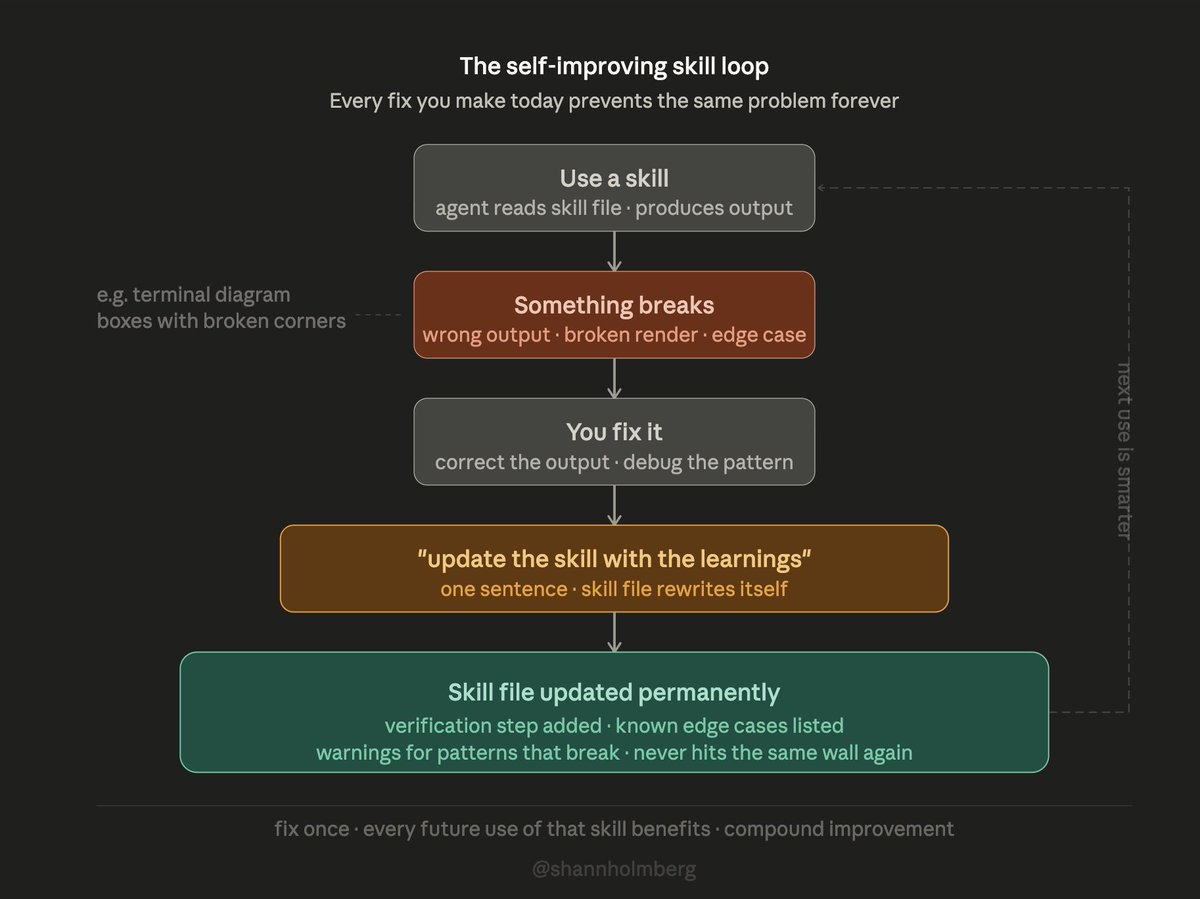

@shannholmberg 发布了一张"自改进技能循环"图:使用技能,出现故障,修复它,告诉智能体"用学到的经验更新技能",技能文件就会自动重写,加入验证步骤和边缘情况警告。口号是:"修复一次——该技能的每次未来使用都将受益。"

@koylanai 提出观点:技能——即编码在 markdown 流程中的知识——才是真正的产品,而 harness 只是可互换的基础设施。该帖 99 个点赞中有 98 个书签,进一步印证了这一观点。

讨论要点: @anatoliygatt 在回复 @akshay_pachaar 关于 MiniMax M2.7 的帖子时报告称"仅通过 harness 优化就获得了 30% 的提升,零重训练,权重完全冻结"——这是 harness/技能优化可以替代模型重训练的一个具体数据点。

与前日对比: 昨天 @avisinghdotdev 请求增加 /update-skills 命令。今天三个团队独立发布了自动技能改进工具。从"技能需要进化"到"技能如何进化"的鸿沟在 24 小时内被填补。

1.3 多智能体编排走向主流 🡕¶

多智能体架构从实验阶段转向推荐实践。@code_rams 发布了一份详细的多智能体指南,指出"单独运行 OpenClaw 等于浪费了 80% 的能力",并给出了 OpenClaw + Hermes 互补搭配方案。该帖得分 1,088,书签 192——数据集中第三高。

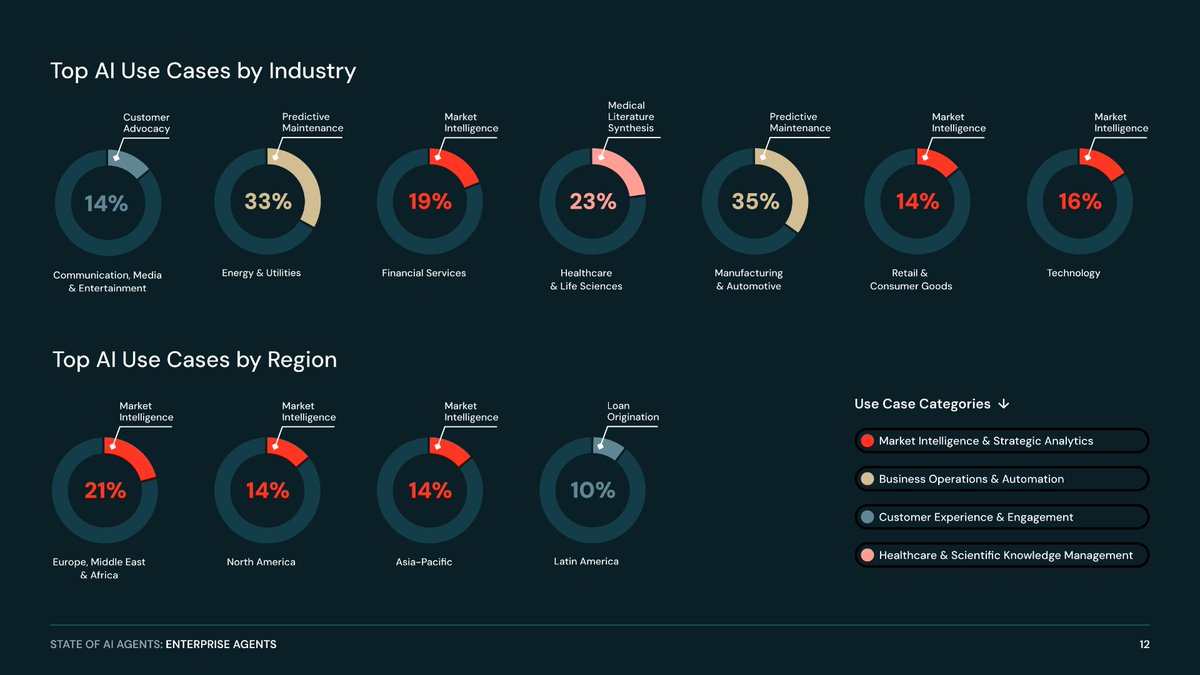

@databricks 发布了来自 20,000 多个组织的使用数据,显示多智能体系统在不到四个月内增长了 327%,78% 的企业同时使用两个或更多智能体框架。

@WesRoth 报道,在 Google I/O 之前,泄露信息显示 Google 正在测试一个自主多智能体平台,旨在直接对标 Anthropic 的 Claude Cowork。据报道该平台名为"Agent",面向 Gemini 工作区。该帖获得 200 个点赞和 24,403 次浏览。

@mizzysworld 描述了将单个 Hermes 智能体拆分为专业角色,每个角色拥有"独立记忆、独立会话、共享原则"。@kevinchan 展示了他使用 Hermes 多智能体框架完成的首个重要产出:编排器和研究智能体创建了 PRD,然后传递给编码智能体进行实现。

讨论要点: @hassanlaasri 在回复 WesRoth 时预测:"随着时间推移,聊天、编码和工作区管理将越来越多地融合到一个对话式界面中。"

与前日对比: 昨天的多智能体讨论停留在概念层面。今天有了 Databricks 数据支撑(327% 增长,20K 组织)、实操指南(OpenClaw + Hermes)以及竞争动态(Google Agent 平台)。叙事从"我们该不该用多智能体?"转向"选哪种多智能体方案?"

1.4 智能体安全:"致命三角" 🡕¶

@iancr 回忆道,去年十月他站在舞台上警告"在智能体化的未来,我们把登录凭证、信用卡和身份交给智能体,这是一场安全噩梦。"六个月后,他认为这一预言已被验证。在一条自回复帖子中,他定义了"致命三角":智能体需要访问有价值的资源(资金、邮件、凭证、浏览器、文件),但目前没有任何验证基础设施来确保它们安全使用这些资源。该帖获得 41 次转发——对于安全警告来说是异常高的传播率。

@omarsar0 分享了"Multi-User Large Language Model Agents"(arXiv:2604.08567),来自 Stanford、KAUST 和 MIT——这是首个关于多用户 LLM 智能体交互的系统性研究。论文发现,前沿 LLM 在面对冲突的用户目标时无法维持稳定的优先级排序,并且在多轮交互中表现出越来越多的隐私违规。

@a_g_e_n_c 发布了 devnet 任务系统更新,将市场任务视为不可信输入:"一个任务可以描述工作内容、奖励、约束和交付物。但任务文本本身没有权限。"任务哈希作为加密工作合约。

讨论要点: @FoltzAI 在回复 @rryssf_ 时问道"上下文策展人成为标配还要多久?"——将安全和上下文质量定义为同一信任问题的两面。

与前日对比: 昨天记录了针对 LLM API 路由器的主动攻击("Your Agent Is Mine"论文)。今天从攻击记录转向架构层面的回应:"致命三角"框架、多用户隐私研究以及加密任务验证。

1.5 上下文噪声被重新定义为核心问题 🡒¶

@rryssf_ 发帖称"每一个主流 AI 智能体框架都在解决错误的问题。它们在扩展上下文窗口。但问题不在容量——而在于智能体读取的内容 90% 都是结构性噪声。"该帖获得 6 次引用转发和 66 个书签,表明它引发了实质性讨论。

@dair_ai 分享了"Artifacts as Memory Beyond the Agent Boundary"(arXiv:2604.08756),正式阐述了环境本身如何作为智能体的记忆。Artifact 缩减定理证明,某些环境观测可以减少智能体需要内部存储的信息——智能体可以利用环境作为外部记忆,而非将所有内容复制到上下文中。

@talraviv 观察到:"我们 19 年前就解决了文件共享问题,但至今仍未解决共享 AI 上下文的问题。"用 Zapier 产品副总裁的话说,目标是"上下文工程成为团队协作"。

与前日对比: 昨天的上下文工程讨论聚焦于分类体系(6 个组成部分)和跨工具记忆。今天重新定义了问题:瓶颈不在于上下文窗口大小,而在于上下文中的信噪比。

1.6 中国 AI 解决开放数学问题 🡕¶

@commiepommie 报道,北京大学的双智能体框架在无人工干预的情况下解决了一个长达十年的交换代数开放问题。该系统使用两个协作智能体自主生成和验证证明。

与前日对比: 前日无直接先例。这代表了使用多智能体架构在 AI 数学推理能力上的阶跃式进步。

2. 令人困扰的问题¶

平台依赖风险(严重程度:高)¶

@heynavtoor 报告,Anthropic 在其 24/7 运行 OpenClaw 期间毫无预警地终止了他们的 Claude Max 订阅($200/月):"Anthropic 一封邮件,一切都停了。没有警告期。没有迁移窗口。就这样结束了。"截图显示了 Anthropic 的终止邮件。

这延续了昨天的模式:基于订阅的工作流会造成单点故障。"永远在线的智能体基础设施"与"随时可能被撤销的按月付费 API 访问"之间的差距仍是一个结构性问题。

上下文噪声而非上下文大小(严重程度:高)¶

@rryssf_ 指出,智能体框架在 90% 的内容是结构性噪声的情况下仍在扩展上下文窗口,这是在解决错误的问题。多条回复验证了这一不满。@FoltzAI 质问为什么前沿实验室不把上下文策展作为内置功能。框架在优化容量,而从业者需要的是信号质量。

智能体框架的知识产权争议(严重程度:中)¶

@uniquesingh__ 披露了来自 @EvoMapAI 的指控,称 Hermes 团队复制了他们的"Evolver"智能体框架——"相同的循环、相同的结构、相同的推理链。"该帖获得 81 个点赞和 53 条回复。随着智能体框架激增,围绕架构模式的知识产权纠纷正变得越来越常见。

智能体编排的质疑声(严重程度:中)¶

@alexhillman 称那些号称提供"一键 AI 公司"的智能体编排工具为"生产力表演秀"。这一批评瞄准的是演示级智能体编排与生产级智能体管理之间的鸿沟。

3. 人们期望的功能¶

团队共享智能体上下文¶

@talraviv 指出,在解决文件共享 19 年后,共享 AI 上下文仍未解决。Zapier 的产品副总裁将目标描述为"上下文工程成为团队协作"——如何在团队中共享知识、提示词和智能体配置,让每次智能体会话都能在此前工作的基础上推进?

上下文策展层¶

@FoltzAI 在回复 @rryssf_ 关于结构性噪声的帖子时问道:"上下文策展人成为标配还要多久?为什么前沿实验室不能明天就加上这个功能?"无人给出令人满意的答案。原始上下文窗口与经策展的高信号上下文之间的鸿沟依然未被填补。

智能体订阅可移植性¶

@heynavtoor 一夜之间失去 Claude Max 订阅的经历凸显了对不依赖单一提供商订阅条款的可移植智能体基础设施的需求。除运行本地模型外,目前尚无解决方案。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| Claude Code | 编码智能体 | 褒贬不一 | 深度推理,大型技能生态系统,子智能体支持 | 平台依赖风险,订阅可能被撤销 |

| OpenClaw | 开源智能体 | 正面 | 6.5M MAU,143K GitHub stars,与 Hermes 互补 | 据 @code_rams 称,不搭配多智能体会损失 80% 的能力 |

| Hermes Agent | 多智能体框架 | 正面 | 记忆、研究、编排、专业角色 | 与 EvoMapAI 的知识产权争议,配置复杂 |

| Runtime (runtm.com) | 智能体基础设施 | 正面 | Harness、沙箱、可观测性、多智能体、可自托管 | 新发布,规模化尚未验证 |

| GBrain | 个人智能体大脑 | 正面 | PGLite(无服务器)、梦境循环、实体扫描、多集成 | 需要前沿模型(Opus 4.6 / GPT-5.4) |

| Google ADK | 智能体开发工具包 | 正面 | Gemini 3 集成,技能自改进 | Google 生态锁定 |

| skill-optimizer | 技能质量保证工具 | 正面 | 开源,自动化技能评估与改进 | 新项目,社区维护 |

| Letta Code | 智能体框架 | 正面 | Recall 子智能体作为主上下文的分支,获 Dex Horthy 推荐 | 小众采用 |

| LiveKit Agent Console | 语音智能体调试工具 | 正面 | 实时管道可视化、延迟跟踪、工具调用检查 | 仅限语音智能体 |

| Pipecat | 语音智能体框架 | 正面 | 实时语音智能体构建 | 内容处于教程阶段 |

| Fire-PDF | PDF 解析器 | 正面 | 基于 Rust,markdown 转换速度快 5 倍 | 新发布 |

Runtime 由 @ycombinator 推出、@gustrigos 构建,是最值得关注的新工具——它将 harness 工程产品化,提供沙箱环境、策略控制(支出限制、文件保护)以及跨 Claude Code、Codex、Gemini CLI 和 OpenCode 的会话级可观测性。支持自托管,采用 MIT/Apache/AGPL 许可。GBrain 由 @garrytan 发布,引入了"梦境循环"概念——夜间记忆整合,智能体执行实体扫描、引用修复和知识复合积累。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| Runtime | @gustrigos | 编码智能体的 harness、沙箱和可观测性 | 团队从零搭建智能体基础设施 | 多智能体,可自托管 | 已发布(YC) | Tweet, Site |

| Fuel | @ashleyhindle | 有明确理念的开发工作流 harness | 非结构化智能体工作流 | 自定义 harness | 第一天 | Tweet |

| GBrain | @garrytan | 带记忆整合的个人智能体知识库 | 智能体缺乏持久个人上下文 | PGLite, OpenClaw/Hermes, Bun | 已发布 | Tweet, GitHub |

| skill-optimizer | @PiSquared | 自动化技能评估、改进和适配 | 手动技能维护 | 开源 | 已发布 | Tweet |

| Harness 兼容性矩阵 | @codylindley | 跨工具指令格式和技能系统对比 | Harness 配置缺乏标准参考 | 静态站点 | 已发布 | Tweet, Site |

| LiveKit Agent Console | @livekit | 语音智能体的实时调试界面 | 语音智能体管道缺乏可视化 | LiveKit 平台 | 已上线 | Tweet |

| AgenC Devnet 任务系统 | @a_g_e_n_c | 智能体市场的加密任务验证 | 市场任务被视为可信输入 | 自定义运行时 | Devnet | Tweet |

| ClickNClaw | @ClickNClawLabs | Windows 原生多智能体编排桌面应用 | 智能体工具困在浏览器标签和 web 包装器中 | Windows 原生, Gemini CLI | 可用演示 | Tweet |

| 自改进技能(ADK) | @Saboo_Shubham_ | 测试、诊断和修复智能体技能的多智能体系统 | 手动技能调试和迭代 | Google ADK, Gemini 3 | 演示 | Tweet |

Runtime 是首个明确为团队打包 harness 工程的产品,脱颖而出。它提供按仓库自动配置的沙箱环境、策略控制(支出限制、文件保护、按用户规则),以及与 Slack、Linear、GitHub 和 Jira 的原生集成——让产品经理和设计师无需 git 知识即可触发智能体会话。

GBrain 引入了"梦境循环"概念——一个夜间 cron 作业,智能体在个人知识库中执行实体扫描、引用修复和记忆整合。随着智能体处理会议、邮件、推文和语音通话并将其转化为可搜索、可关联的知识,大脑会随时间持续积累。

6. 新动态与亮点¶

Databricks:多智能体采用率在 20,000 个组织中增长 327%¶

@databricks 发布了首批大规模多智能体系统采用数据。来自 20,000 多个全球组织的关键发现:多智能体系统在不到四个月内增长了 327%,78% 的企业同时使用两个或更多智能体框架。这是数据集中关于多智能体采用最硬核的使用数据。

Harness 工程兼容性矩阵¶

@codylindley 发布了一份全面的兼容性矩阵,比较了 Copilot、Claude Code、OpenCode、Gemini CLI、Cursor、Windsurf 等工具的指令格式、智能体系统和技能格式。该矩阵涵盖了作用域机制(仓库根目录 vs. 子目录 vs. glob 模式)、激活模式和跨工具兼容性。这是标准化碎片化 harness 配置格局的首次尝试。

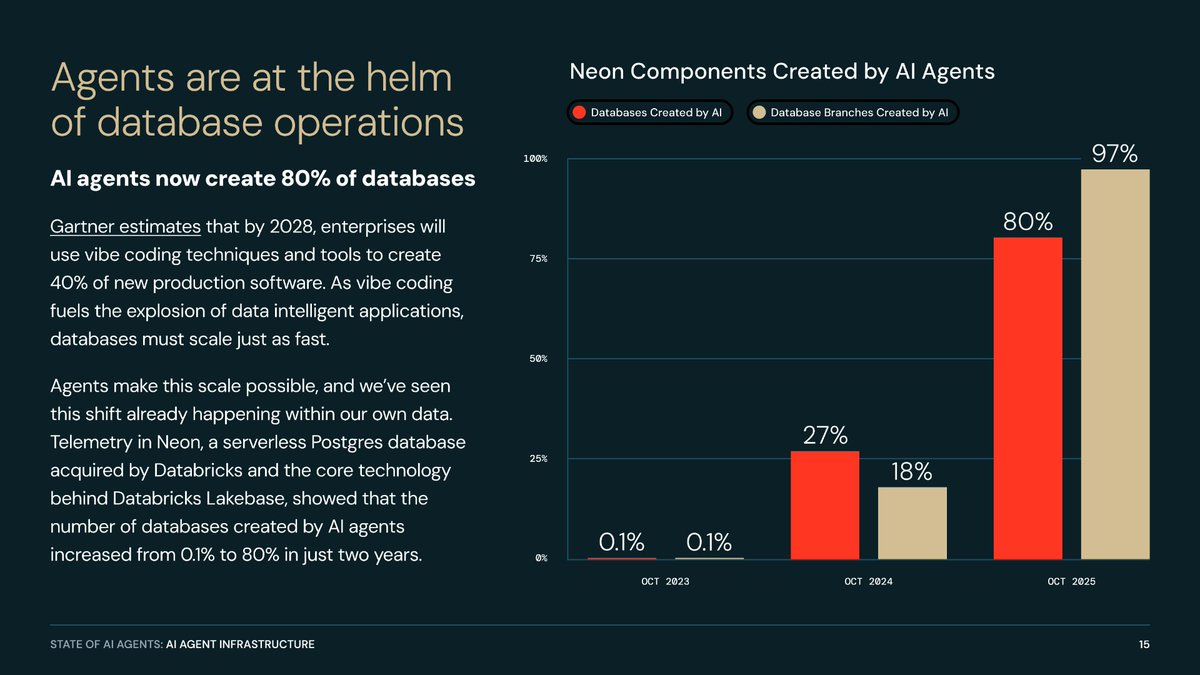

ClickHouse CEO 谈智能体驱动的数据基础设施变革¶

@ceo_clickhouse 引用了一篇分析,指出"AI 对 Snowflake 的看空逻辑围绕人类与智能体在数据访问偏好上的差异展开。"随着智能体越来越多地直接查询数据基础设施,那些针对人类仪表板和 SQL 工作台交互优化的产品可能不敌那些针对编程式、高吞吐量智能体访问模式优化的产品。该帖达到 38,337 次浏览。

多用户智能体隐私故障被记录¶

"Multi-User Large Language Model Agents"论文(arXiv:2604.08567)来自 Stanford、KAUST、University of Toronto 和 MIT,证实了同时服务多用户的前沿 LLM 在多轮交互中表现出越来越多的隐私违规,且在用户目标冲突时无法维持稳定的优先级排序。这是关于多主体智能体问题的首个系统性研究。

7. 机会在哪里¶

[+++] 技能生命周期自动化。 今天有三个独立团队发布了技能自改进工具(@PiSquared、@Saboo_Shubham_、@shannholmberg 的概念循环)。昨天这还是一个未被满足的需求。今天已有三个竞争实现,但尚无标准方案。"已有的技能"与"质量随时间复合增长的技能"之间的差距,正是下一个平台优势形成之处。Databricks 数据显示 78% 的多框架采用率意味着跨工具通用的技能具有超额价值。(source)

[+++] 团队级智能体基础设施。 Runtime(YC 支持)今天发布,但团队级智能体基础设施市场——harness、沙箱、可观测性、治理——仍然大有可为。@talraviv 将共享 AI 上下文定义为未解决的问题。@ashleyhindle 发布了 Fuel。模式一致:个人智能体使用可行;团队智能体使用需要目前尚不成熟的基础设施。(source)

[++] 上下文策展优于上下文扩展。 @rryssf_ 的论断——90% 的智能体上下文是结构性噪声——引起共鸣,获得 66 个书签和 6 次引用转发。"Artifacts as Memory"论文(arXiv:2604.08756)为利用环境记忆减少内部上下文需求提供了理论基础。一款能策展上下文(去除噪声、优先信号)而非扩展上下文的工具,将解决从业者记录在案的痛点。(source)

[++] 智能体安全验证。 "致命三角"(@iancr)、多用户隐私故障(arXiv:2604.08567)以及 AgenC 的加密任务验证都指向同一缺口:智能体需要访问有价值的资源,但没有验证基础设施。多用户论文证明这不仅仅是理论问题——前沿模型在多主体条件下确实违反了隐私约束。(source)

[+] 个人智能体记忆系统。 GBrain 的"梦境循环"概念——夜间记忆整合、实体扫描、知识复合积累——代表了智能体基础设施的一个新品类。@KSimback 的研究表明"护城河是能跨会话存续的上下文。"会话范围的智能体记忆与持久的、可复合积累的个人知识之间的差距仍然很大。(source)

[+] 平台无关的智能体访问。 @heynavtoor 的 Claude Max 被终止事件证明了基于订阅的智能体工作流的脆弱性。随着智能体成为永远在线的基础设施,"可撤销的订阅"与"关键任务运行时"之间的错配催生了对平台无关的智能体访问层的需求。(source)

8. 要点总结¶

-

Harness 工程在一天内从理念走向参考架构。 一份比较 10 多款工具的兼容性矩阵、一个控制系统框架(前馈 + 反馈)以及明确的护城河分析,现已作为社区构建的资源存在。话语从"这是什么?"转向"我该如何实现?"(source)

-

技能自改进不再是愿望——三个独立团队发布了实现方案。 PiSquared 开源了 skill-optimizer,Saboo 用 Google ADK 构建了自改进技能,shannholmberg 绘制了复合改进循环图。仅通过 harness 优化就获得 30% 性能提升(零重训练)的结果验证了技能质量比模型选择更重要。(source)

-

多智能体采用有了硬数据:20,000 个组织中增长 327%,78% 使用两个或更多框架。 Databricks 提供了首批大规模证据,表明多智能体系统不是实验性的——它们已是默认模式。Google 泄露的面向 Gemini 的"Agent"平台证实主要厂商将多智能体工作区视为竞争战场。(source)

-

智能体安全研究的步伐正超越智能体安全基础设施。 Stanford/MIT 的多用户论文记录了在多轮交互中恶化的隐私违规。"致命三角"框架捕捉了结构性问题:智能体需要访问有价值的资源,但验证机制不存在。AgenC 的加密任务验证是今天观察到的唯一实现层面的回应。(source)

-

智能体化 AI 的护城河正从模型访问转向持久上下文。 多个信号汇聚:GBrain 的"梦境循环"用于知识复合积累,KSimback 的护城河分析将"跨会话存续的上下文"定义为锁定点,Artifacts-as-Memory 论文将环境记忆理论化为内部上下文的替代。模型在商品化;会话之间能保留下来的东西则不会。(source)

-

平台依赖现已成为生产级智能体工作流的记录在案的风险。 Anthropic 在毫无预警、毫无迁移窗口的情况下终止了一个用于 24/7 运行 OpenClaw 的 Claude Max 订阅。随着智能体成为关键任务基础设施,可撤销的订阅访问造成了市场尚未解决的结构性脆弱性。(source)

-

上下文质量而非上下文数量,正成为新的瓶颈。 90% 的智能体上下文是结构性噪声这一论点在社区中引起广泛共鸣。Artifacts-as-Memory 论文提供了一种理论替代方案:让智能体利用环境作为记忆,而非将所有内容复制到上下文窗口中。上下文工程领域正从"多大?"转向"多干净?"(source)