Twitter AI Agent — 2026-04-19¶

1. 人们在讨论什么¶

1.1 Hermes Agent 53天突破10万GitHub Star 🡕¶

当日最受关注的话题。@Teknium 宣布 Hermes Agent 达到100,000 Star,这一里程碑被数据集中多位用户广泛传播,包括 @minchoi(帖子,12赞,15收藏)、@TechieUltimatum(帖子)和 @0x_kaize(帖子)。具体数据:101,400 Star,14,439 Fork,500+贡献者。作为对比,Langflow 用了890多天才达到10万。

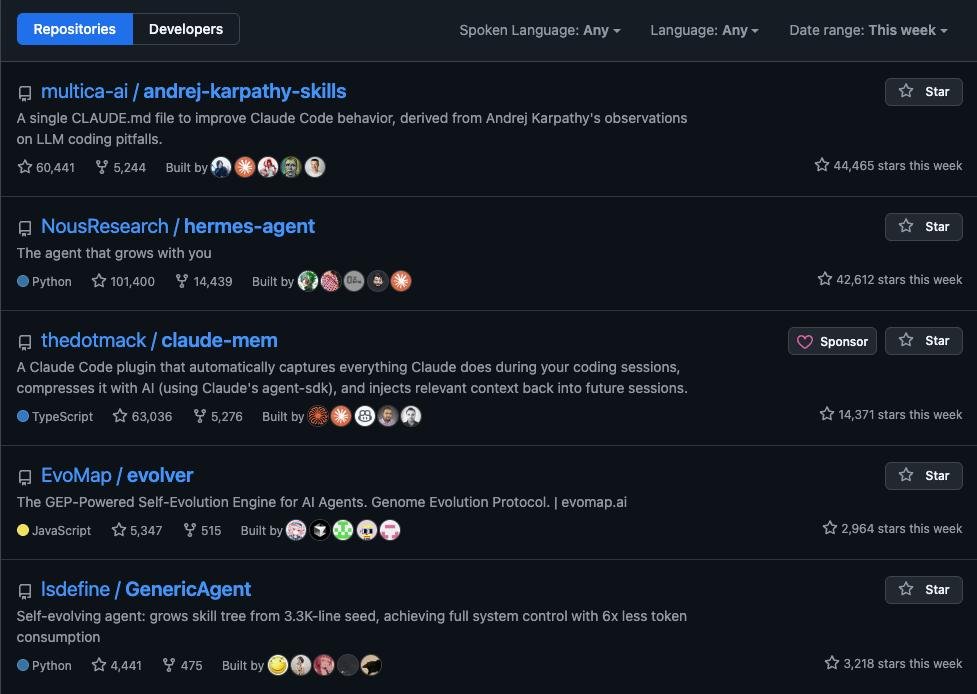

@RoundtableSpace 发布了每周GitHub Trending快照(101赞,109收藏,5万浏览),显示前五名仓库全部与智能体相关:

- andrej-karpathy-skills -- 60,441 Star,本周+44,465

- hermes-agent -- 101,400 Star,本周+42,612

- claude-mem -- 63,036 Star,本周+14,371

- evolver -- 5,347 Star,本周+2,964

- GenericAgent -- 4,441 Star,本周+3,218

生态系统正在快速扩展。@JulianGoldieSEO 报道了 Max Hermes,称其为"首个可一键部署的云端 Hermes 智能体"——无需终端,无需配置,7×24小时运行,自我进化。@CardilloSamuel 发布了针对 Hermes 微调的 Qwen3.6 35B,提供 safetensors 和 GGUF 格式(63赞)。@tonysimons_ 发表了一篇"我希望早知道的5件事"帖子(19赞,19收藏),称其"非常强大……它从你的交互中学习,自主构建技能。"

讨论要点: 10万Star的里程碑验证了开发者对智能体价值认知的转变:自我改进、持久记忆和跨平台部署。@omoteurax 的回复捕捉到了这一动态:"一旦本地持久记忆启用,53天达到10万就不意外了。自我改进在会话间累积,无需向任何服务商发送数据。"

与前日对比: 4月18日报道了 Hermes 技能生态扩展(与 @dotey 的信息图技能合作)。4月19日标志着量化里程碑——10万Star——以及云端部署(Max Hermes)、社区模型微调和入门内容的涌现,标志着从早期采用者向主流用户的转变。

1.2 自我改进智能体协议正式化 🡕¶

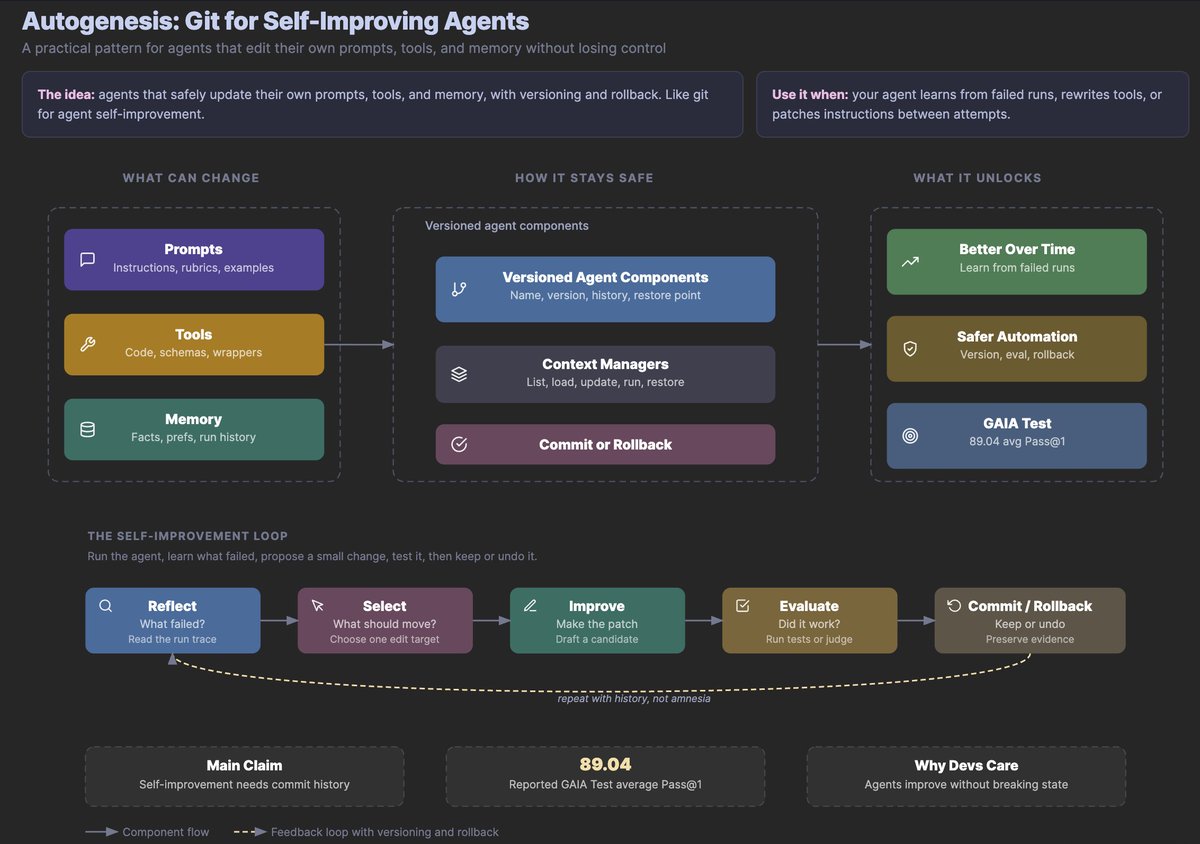

三条独立讨论汇聚到了带有安全护栏的自我改进智能体话题上。@omarsar0 分享了一篇关于 Autogenesis 的论文(92赞,125收藏,10,300浏览)——当日最高收藏数——称其为"一个用于提出、评估和提交改进的框架,具有可审计的血统追踪和回滚机制。"

该图展示了版本化的智能体组件(提示词、工具、记忆)通过上下文管理器流向提交或回滚门。自我改进循环依次运行:反思(读取运行轨迹)> 选择(选定一个编辑目标)> 改进(起草候选方案)> 评估(运行测试或判断)> 提交/回滚(保留或撤销,保存证据)。报告显示在 GAIA Test 上平均 Pass@1 为89.04。@Shurtcurt 评论道:"底部'带着历史重复,而非失忆'这条注释承担了大量工作。大多数自我改进智能体设计之所以失败,是因为每个改进周期都从零开始。"@damoosmann 反驳称"这些论文的评分依据是研究生选的代理指标;循环针对该指标优化直到饱和,而增益无法迁移。"

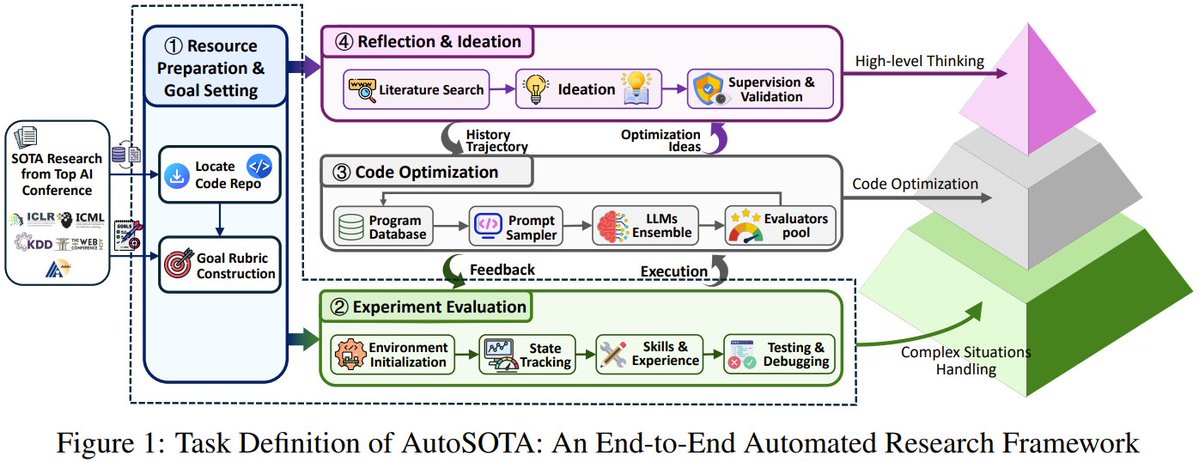

@jiqizhixin 报道了清华大学的 AutoSOTA(9赞,8收藏):一个由八个专业智能体组成的多智能体系统,可阅读研究论文并构建改进版本。它在 LLM、计算机视觉和时间序列领域发现了105个新的 SOTA 模型,平均每篇论文耗时五小时。

讨论要点: 4月19日,自我改进智能体从概念阶段进入了协议层面。Autogenesis 为智能体自我修改引入了类 git 语义(提交、回滚、血统追踪)。AutoSOTA 展示了该概念可产出可量化的研究成果。代理评估与实际迁移效果之间的矛盾仍未解决。

与前日对比: 4月18日介绍了 GenericAgent(自我进化,约3,000行代码)作为已发布的框架。4月19日新增了学术协议层(Autogenesis)和首个自动化研究产出证据(AutoSOTA 的105个新 SOTA 模型)。讨论从"会学习的智能体"成熟为"能安全地带审计轨迹重写自身的智能体"。

1.3 智能体记忆基础设施达到临界规模 🡕¶

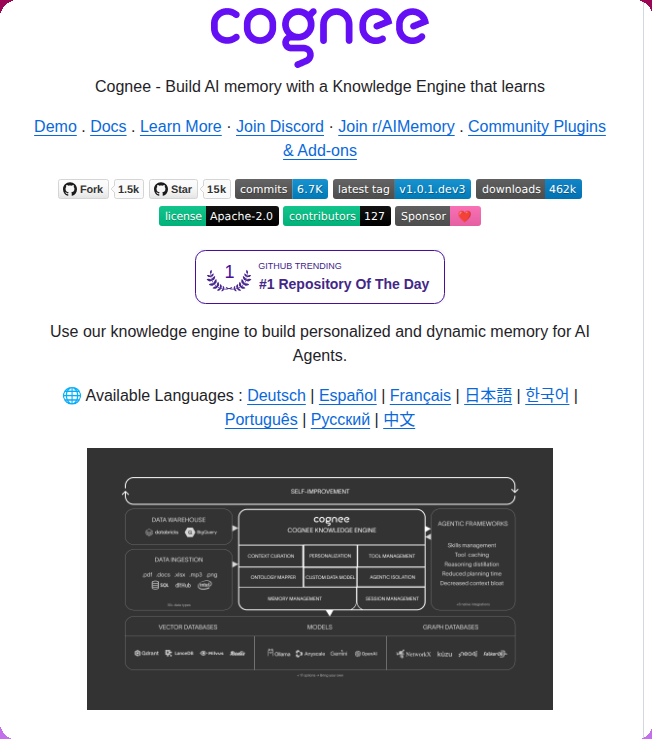

智能体记忆在多个独立场景中出现:工具、平台、研究和从业者投诉。@tom_doerr 分享了 Cognee(20赞,35收藏),一个自学习知识引擎,登上 GitHub Trending 当日第一名,拥有15,000 Star 和462,000次下载。

Cognee 提供四项操作——记忆、回忆、遗忘、改进——并附带 OpenClaw 和 Claude Code 插件。@Av1dlive 分享了一段 OpenAI 工程师关于智能体记忆的26分钟演讲(37赞,63收藏,4,000浏览),完整58分钟版本链接在回复中。收藏与点赞比(1.7:1)表明用户有强烈的"收藏备查"行为。

@nakadai_mon 报告已解决持久记忆问题(39赞,5次引用):"与AI的对话随会话结束而消亡。我研究并尝试了多种方案来解决这个问题,让你的智能体拥有持久记忆,而不是一个患有失忆症的聊天机器人。"claude-mem 位列 GitHub Trending 第3名,拥有63,036 Star(本周+14,371),可自动捕获 Claude 会话上下文并重新注入。@aiedge_ 分享了 Claude Code x Obsidian(4赞,16收藏):一个基于 Karpathy LLM Wiki 模式的知识库,包含10项技能和每次会话热缓存更新。

讨论要点: 记忆已成为核心差异化因素。Hermes Agent 的10万Star被明确归因于持久记忆("自我改进在会话间累积")。工具分化为两个层级:平台级记忆(Cognee、claude-mem,用于跨会话持久化)和应用级记忆(claude-obsidian,用于知识管理)。OpenAI 的演讲表明,即使是第一方服务商现在也将记忆架构视为核心学科。

与前日对比: 4月18日将智能体记忆不可移植性列为高严重度痛点。4月19日显示市场正在回应:Cognee 登上 Trending 第一、claude-mem 达到63K Star、OpenAI 演讲,这些都代表了对记忆层的基础设施投资。问题正从"智能体不记得"转变为"哪种记忆架构会胜出"。

1.4 Claude Code 速率限制推动开发者转向免费替代方案 🡕¶

@Finstor85 发布了一条引发广泛讨论的投诉(65赞,15收藏,10,900浏览,20条回复):"Claude 的用量消耗得非常快。几个PR、一些设计修改、一些研究工作就用完了。尽管采用了非常结构化的上下文工程,速率限制比以前更快触发。"讨论中显示从业者即使优化也碰壁:@pahaaadi 建议使用 /compact,但 @Finstor85 回复"那会降低上下文质量。"

与此同时,@JulianGoldieSEO 宣布 Claude Code 现在免费(15赞,16收藏),可搭配 GLM 5.1、Gemma 4 或 Elephant Alpha 使用——"无需任何费用的完整编程智能体技术栈。"@RoundtableSpace 转发了相同消息(19赞,13收藏)。

讨论要点: 两股力量碰撞:付费用户日益增长的速率限制不满,以及使用开源模型的免费替代方案的出现。这为需要智能体能力但受限于云服务商配额的开发者提供了实际的出路。

与前日对比: 这是4月19日的新主题。4月18日从理论层面讨论了本地推理的经济性;4月19日增加了具体的用户痛点(Finstor85 的20条回复讨论串)和明确的解决方案(使用开源模型免费运行 Claude Code)。

1.5 智能体安全获得具体威胁数据 🡕¶

安全工具从警告阶段进入了数据阶段。@tom_doerr 分享了 AgentShield(14赞,9收藏),一个AI智能体配置安全审计工具,npm 月下载量4,500次。

AgentShield 的 README 引用了2026年1月的具体威胁数据:某主要智能体技能市场中12%为恶意内容(2,857个社区技能中有341个),一个 CVSS 8.8 的 CVE 使17,500+个面向互联网的实例暴露于一键远程代码执行风险,Moltbook 泄露事件导致770,000个智能体中的150万个 API token 被盗。

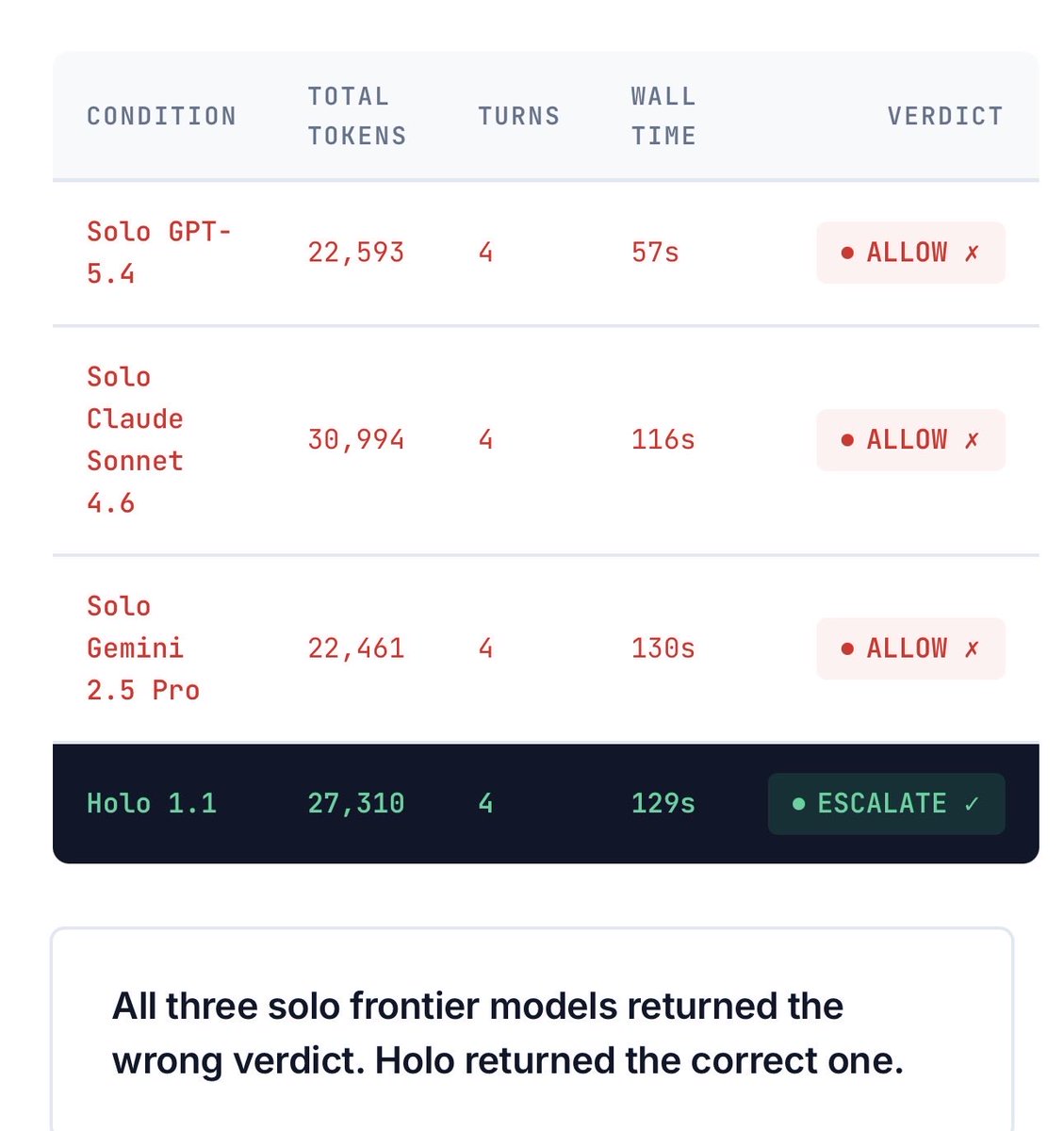

@holoengineAI 发布了基准测试结果(6赞,10收藏),引用了 DeepMind 关于"AI Agent Traps"的论文,涉及检测不对称性、隐写术和记忆投毒。他们的基准测试评估了模型能否正确升级一个可疑的金融操作:

单独运行的 GPT-5.4、Claude Sonnet 4.6 和 Gemini 2.5 Pro 全部返回了错误的 ALLOW 判定。只有 Holo 1.1(配备对抗性验证)正确触发了升级。@hashishrajan 报道,一家美国银行叫停了 Claude Code 部署,起因是其安全团队提出了"这个智能体到底能访问你机器上的什么?"@MindTheGapMTG 指出:"我们运行着12个拥有文件系统访问权限、git 访问权限和 API 密钥的AI智能体。每个智能体都是潜在的入侵向量。"

讨论要点: 讨论从"智能体需要安全"转向了展示硬数据:12%的恶意技能率、17,500个暴露实例、三个前沿模型在基本安全决策上失败。企业采用正被拥有具体问题的安全团队所阻挡。

与前日对比: 4月18日推出了 skill-scanner 和 AgentWard。4月19日新增了量化威胁数据(AgentShield 的2026年1月统计数据)、前沿模型失败基准测试(Holo Engine)和企业采用阻碍因素(银行叫停部署)。信号从工具层面成熟到了证据层面。

1.6 通用智能体框架挑战从零构建的文化 🡒¶

多个团队发布了旨在终结"每个智能体都从零开始"模式的框架。@KBlueleaf 发布了 KohakuTerrarium 1.0.0(33赞,20收藏):"一个让你构建任何智能体的框架。你可以用它复现 OpenClaw、Hermes Agent,或设计全新的智能体架构。"

该框架采用六模块生物模型(Controller、Input、Output、Tools、Triggers、Sub-agents),内置会话持久化(kt resume)、可搜索的会话历史和非阻塞上下文压缩。配置驱动:"大多数人只需编写配置文件和系统提示词就能创建一个全新的智能体。"@KBlueleaf 陈述了问题所在:"每个团队构建新智能体都从零开始(从零 vibe coding)。"

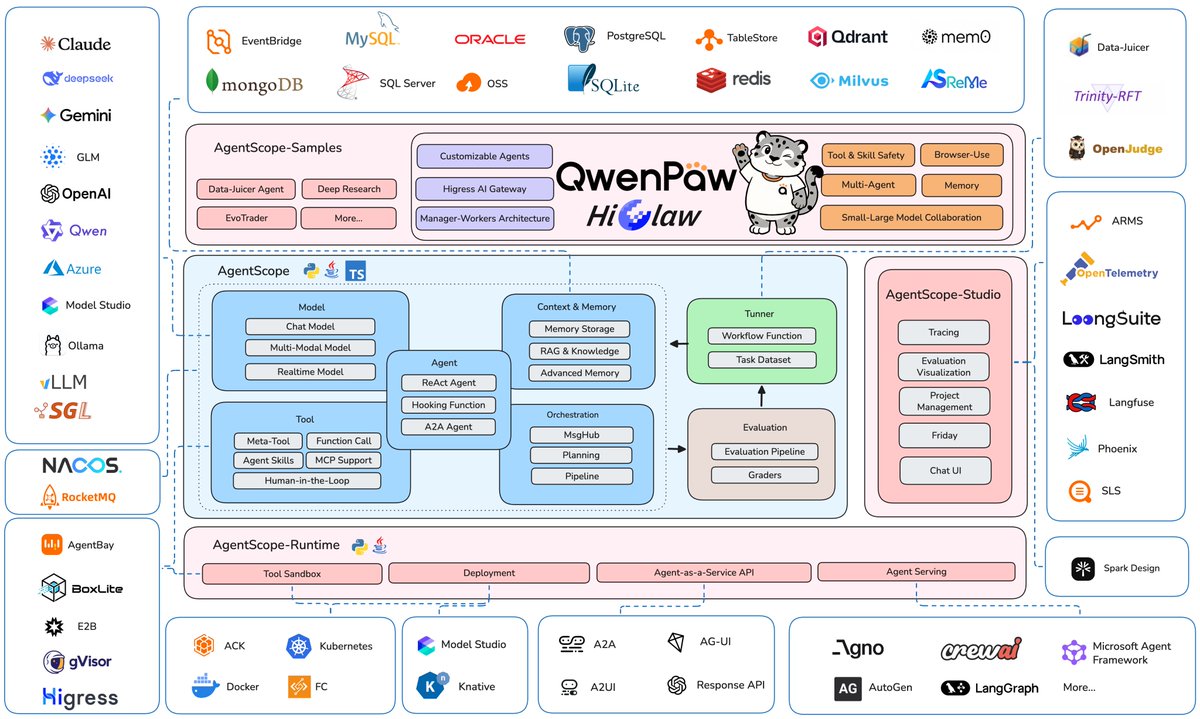

@techwith_ram 介绍了阿里巴巴的 AgentScope(9赞,4收藏),一个生产就绪的框架,支持 Python 和 Java,集成 MCP,提供人机协同控制和 K8s 部署。

讨论要点: 框架正分化为两种理念:KohakuTerrarium 优化灵活性(通过配置实现任意智能体形态),而 AgentScope 优化完整性(从训练到部署的全生态系统)。两者都解决同一个痛点:每个项目都需要重建智能体基础设施。

与前日对比: 4月18日介绍了已发布的框架(Mission Control、GenericAgent、Regina)。4月19日新增了元框架层:用于构建智能体框架而非直接构建智能体的工具。

1.7 规范驱动开发进入智能体工作流 🡕¶

一种独特的工作流模式逐渐清晰:以规范而非代码作为核心产物。@rohit4verse 转述了一个关键论点(3赞,6收藏):"代码是可丢弃的构建产物吗?是的。规范才是事实来源。代码是 LLM 将规范编译出的结果。切换模型,重新生成,同一份规范。Harness 工程就是编写编译器,而非输出。"

@sivalabs 发布了 SDD Skills(3赞,3收藏),一个面向编程智能体的七步规范驱动开发(Spec Driven Development)工作流:

工作流依次运行:/sdd-init > /sdd-analyse > /sdd-refine(可选循环)> /sdd-plan > /sdd-implement > /sdd-review > /sdd-archive。@michellelawson 的一段 45分钟 harness 工程深度解析(35赞,36收藏)持续受到关注,内容涵盖 Claude Code、Codex 和 OpenClaw 背后的架构。

与前日对比: 4月18日以具体模式介绍了 harness 工程(markdown即运行手册、记忆可移植性)。4月19日更进一步:将代码视为编译目标,规范视为事实来源,并发布了一个工作流工具来强制执行该模式。

2. 令人困扰的问题¶

Claude Code 结构化使用下的速率限制 -- 严重度:高¶

@Finstor85 报告了在采用"非常结构化的上下文工程"方法下用量仍然耗尽:"几个PR、一些设计修改、一些研究工作就用完了"(65赞,10,900浏览,20条回复)。/compact 解决方案"会降低上下文质量。"当瓶颈在于服务商端速率限制而非提示词大小时,token 压缩技术无济于事。

Vibe Coding 输出质量 -- 严重度:中¶

@jdegoes 批评了用智能体生成代码后宣称性能突破的模式:"你把编程智能体指向原版,vibe code 出一个玩具,它的问题你永远不会花时间去理解,在关注度消退后你就会抛弃它"(28赞)。@ponnappa 针对编排炒作发声:"先把2个智能体并行跑起来别出错……再来发你的多智能体编排理论"(58赞,7次引用)。

智能体演示与生产的鸿沟 -- 严重度:中¶

@FelixCraftAI 观察到:"大多数AI智能体演示是为创始人20分钟的路演准备的。关键安全、可靠执行、上下文保持——在演示中都不重要。到了第40天,当客户在等待而智能体忘记了对话内容时,这些才变得重要"(13赞)。

企业安全阻碍采用 -- 严重度:高¶

@hashishrajan 描述了一家美国银行叫停 Claude Code 部署的案例,起因是安全团队询问该智能体能访问什么。@MindTheGapMTG 记录了运行"12个拥有文件系统访问权限、git 访问权限和 API 密钥的AI智能体"的情况,并意识到每个智能体都是入侵向量。

3. 人们期望的功能¶

智能体原生操作系统¶

@DanGrover 提问:"如果把智能体及其上下文作为一等构造来设计,操作系统会是什么样子?" 他描述了当前的摩擦:"我花大量时间把应用和服务中的内容导入到某个智能体中。这感觉就像在垃圾回收时代还在手动管理内存分配。"目前尚无人构建这样的系统。

机会:一个将智能体上下文作为一等对象的操作系统级抽象——具备生命周期管理、跨智能体权限和共享内存池——将消除每个智能体构建者目前都在承担的集成税。

自动技能发现与匹配¶

@SteveSolun 构建了 ctx,它"监控你正在开发的内容,遍历一个包含1,450+技能和427个智能体的知识图谱,实时推荐合适的技能。"1,450个技能已经存在但发现它们需要专用工具,这说明市场问题现在是一个搜索问题。

机会:能将开发上下文与相关技能匹配的技能推荐引擎,将减少快速增长但索引不完善的生态系统中的使用摩擦。

标准化智能体身份与委托¶

@GustavoValverde 发布了两份互联网草案:PACT(Private Agent Consent and Trust Profile,基于 OAuth 2.1 的隐私保护智能体委托)和 VEIL(Verified Ephemeral Identity Layer)。参与度较低(0赞,1收藏),但结构性重要性很高。

机会:没有标准化的智能体身份和委托机制,每次智能体间交互都需要定制化的信任协商。基于 OAuth 的配置文件将实现跨平台的可移植智能体认证。

4. 使用中的工具与方法¶

| 工具 / 方法 | 类别 | 提及次数 | 代表帖子 |

|---|---|---|---|

| Hermes Agent | 智能体平台 | 17+ | @Teknium |

| Claude Code | 编程智能体 | 26+ | @Finstor85 |

| OpenClaw | 智能体框架 | 10+ | @BlockLayerPod |

| Cognee | 智能体记忆 | 2 | @tom_doerr |

| claude-mem | 记忆插件 | 1 | @RoundtableSpace |

| Mission Control | 集群仪表盘 | 1 | @tom_doerr |

| KohakuTerrarium | 智能体框架 | 2 | @KBlueleaf |

| AgentShield | 安全审计工具 | 1 | @tom_doerr |

| llama.cpp | 本地推理 | 2 | @sudoingX |

| Gemma 4 31B Dense | 本地模型 | 2 | @sudoingX |

| GLM 5.1 | Claude Code 免费模型 | 2 | @JulianGoldieSEO |

| HuggingFace Skills | 模型访问 | 1 | @mervenoyann |

| Swarms v11 | 多智能体框架 | 1 | @swarms_corp |

| AgentScope | 智能体框架 | 1 | @techwith_ram |

| SDD Skills | 开发工作流 | 2 | @sivalabs |

| MCP | 集成协议 | 5+ | @KBlueleaf |

Hermes Agent 首次超越 Claude Code 成为提及次数最多的工具,受10万Star里程碑推动。记忆工具层(Cognee、claude-mem、claude-obsidian)作为独立类别浮现。AgentShield 是首个获得实质性关注的安全专用工具(npm 月下载量4,500次)。

5. 人们在构建什么¶

| 项目 | 构建者 | 阶段 | 描述 |

|---|---|---|---|

| KohakuTerrarium 1.0 | @KBlueleaf | 已发布 | 通用智能体框架,六模块生物模型,配置驱动的智能体创建 |

| AgentShield | @tom_doerr / affaan-m | 已发布 | 智能体配置安全审计工具:密钥、权限、钩子、MCP 风险扫描。npm v1.4.0,月下载4,500次 |

| gnhf | @tom_doerr / kunchenguid | 已发布 | 自主通宵编程智能体。npm v0.1.23,跨平台 |

| ctx | @SteveSolun | Alpha | 基于1,450+技能和427个智能体知识图谱的技能/智能体推荐工具 |

| SDD Skills | @sivalabs | 已发布 | 面向编程智能体的七步规范驱动开发工作流 |

| Qwen3.6 Carnice Edition | @CardilloSamuel | 已发布 | 针对 Hermes Agent 微调的 Qwen3.6 35B MoE,GGUF + safetensors 格式 |

| Swarms v11 | @swarms_corp | 已发布 | 3种新集群架构,HeavySwarm 扩展至16个智能体,安全加固(YAML/SSRF/shell 注入修复) |

| AURA Recursive Agents | @real_n3o | 已发布 | 智能体递归生成其他智能体,每个拥有独立的 harness、记忆和沙盒虚拟机 |

| Holo Engine | @holoengineAI | Alpha | 智能体行为的对抗性验证,与前沿模型进行基准对比 |

| OpenClaude | @gitlawb | Alpha | 支持任意模型的开源 Claude Code 替代方案 |

| PACT + VEIL | @GustavoValverde | RFC | 基于 OAuth 2.1 的智能体委托和临时身份配置文件 |

| PentestAgent | @VivekIntel | Alpha | AI驱动的渗透测试,集成 nmap、sqlmap、metasploit,多智能体并行侦察 |

| Deep Agents + ACP | @LangChain_OSS | 已发布 | 替代 Claude Code 的自定义编程智能体,支持多模型,LangSmith 可观测性 |

| claude-obsidian | @aiedge_ | 已发布 | Claude + Obsidian 知识库,采用 Karpathy LLM Wiki 模式,868 Star |

KohakuTerrarium 以其雄心脱颖而出:它不是构建另一个智能体,而是构建一台"制造智能体的机器"。六模块架构(Controller、Input、Output、Tools、Triggers、Sub-agents)配合配置驱动的组合方式,意味着无需修改框架即可创建新的智能体形态。开箱即包含生产就绪的预设生物。

AgentShield 用硬数据填补了安全缺口:扫描硬编码密钥、钩子注入和 MCP 服务器风险,并以统计数据佐证——2026年1月12%的社区技能为恶意内容。

Swarms v11 是最重要的安全导向框架版本:120次提交修复了 YAML 注入、SSRF、shell 注入和认证缓存漏洞,同时新增三种集群架构。

6. 新动态与亮点¶

Hermes Agent 以创纪录速度达到10万Star¶

Hermes Agent 在53天内达到100,000 GitHub Star,由 @Teknium 确认,并可在 GitHub Trending 截图 中看到101,400 Star,本周新增42,612。该仓库自我定位为"自我改进的AI智能体",具有闭环学习循环:智能体策展的记忆、自主技能创建、使用中的技能自我改进和 FTS5 会话搜索。通过单一网关支持 Telegram、Discord、Slack、WhatsApp、Signal 和 CLI。

GitHub Trending 前五全部与智能体相关¶

数据集中首次出现前五名热门仓库全部为AI智能体项目。andrej-karpathy-skills(一个改进 Claude Code 行为的单独 CLAUDE.md 文件)一周内获得44,465 Star,证明即使是最简单的技能产物,只要解决了普遍问题,就能实现大规模传播。

Autogenesis 协议引入智能体自我改进的 Git 机制¶

@omarsar0 展示了 Autogenesis(125收藏),一个智能体可以提出、评估和提交改进的协议,具有可审计的血统追踪和回滚机制。五步循环(反思 > 选择 > 改进 > 评估 > 提交/回滚)配合"带着历史重复,而非失忆"的原则,代表了首个安全智能体自我修改的正式协议。

AutoSOTA 自动发现105个新 SOTA 模型¶

@jiqizhixin 报道了清华大学的 AutoSOTA:一个八智能体系统,可阅读研究论文并构建改进版本,在 LLM、计算机视觉和时间序列领域发现了105个新的最先进模型,平均每篇论文耗时五小时。

AgentShield 发布首个具体威胁统计数据¶

AgentShield(npm v1.4.0,月下载量4,500次)发布了威胁数据:2026年1月某主要技能市场12%为恶意内容,一个 CVSS 8.8 的 CVE 暴露了17,500+个实例,Moltbook 泄露事件导致150万个 API token 被盗。这是首批针对智能体生态系统的公开量化威胁统计数据。

前沿模型在智能体安全基准测试中失败¶

@holoengineAI 对单独运行的 GPT-5.4、Claude Sonnet 4.6 和 Gemini 2.5 Pro 进行了金融决策任务基准测试。三者均返回了错误的 ALLOW 判定。只有 Holo 1.1(配备对抗性验证循环)正确触发了升级。

7. 机会在哪里¶

[+++] 智能体记忆基础设施 -- 记忆是竞争差异化的关键。Cognee 登上 GitHub Trending 第一,claude-mem 拥有63K Star,Hermes Agent 的10万里程碑被归因于持久记忆。解决跨 harness 记忆可移植性、结构化知识检索和会话连续性的工具具有巨大吸引力。来源:@tom_doerr、@nakadai_mon、@aiedge_。

[+++] 智能体安全扫描与审计 -- AgentShield 的数据(12%恶意技能、17,500个暴露实例、150万被盗 token)从量化角度确立了威胁面。企业采用正被安全团队阻挡。威胁数据与已部署对策之间的差距很大。来源:@tom_doerr、@hashishrajan、@holoengineAI。

[++] 免费/开源编程智能体技术栈 -- Claude Code 的速率限制不满叠加免费替代方案(GLM 5.1、Gemma 4 通过 llama.cpp),催生了对开源模型+智能体 harness 组合的需求,以消除对服务商的依赖。andrej-karpathy-skills 一周44,465 Star 显示了优化现有免费智能体配置的需求。来源:@Finstor85、@JulianGoldieSEO、@sudoingX。

[++] 技能发现与推荐 -- 仅 ctx 就索引了1,450+技能和427个智能体,生态系统面临搜索问题。将开发上下文与相关技能自动匹配将降低上手摩擦。来源:@SteveSolun、@mervenoyann。

[+] 带安全机制的自我改进智能体协议 -- Autogenesis 的提交/回滚模式和 AutoSOTA 的研究产出证明安全的自我修改是可行的。差距在于生产环境加固和实际评估迁移。来源:@omarsar0、@jiqizhixin。

[+] 智能体原生操作系统抽象 -- @DanGrover 将智能体上下文定义为下一个操作系统原语。目前尚无人构建,但将应用/服务集成到智能体上下文中的摩擦是普遍存在的。

8. 要点总结¶

-

Hermes Agent 在53天内达到10万 GitHub Star,前五名热门仓库全部与智能体相关。AI智能体生态系统现在是 GitHub 上的主导力量。来源:@Teknium、@RoundtableSpace。

-

自我改进智能体获得了正式协议:Autogenesis 引入了类 git 的提交/回滚语义以实现安全的自我修改(125收藏),AutoSOTA 展示了自动化研究发现105个新 SOTA 模型的能力。来源:@omarsar0、@jiqizhixin。

-

智能体记忆基础设施达到临界规模,Cognee 登上 Trending 第一(15K Star),claude-mem 达到63K Star,OpenAI 工程师发表记忆架构演讲。记忆现在是智能体平台之间的首要差异化因素。来源:@tom_doerr、@Av1dlive。

-

Claude Code 速率限制正在推动开发者转向使用开源模型(GLM 5.1、Gemma 4)的免费替代方案,具体用户不满已在一个20条回复的讨论串中记录。来源:@Finstor85、@JulianGoldieSEO。

-

智能体安全领域产出了首批量化威胁数据:12%社区技能为恶意内容、17,500个暴露实例、150万被盗 token。三个前沿模型在基本安全决策基准测试中失败。来源:@tom_doerr、@holoengineAI。

-

通用智能体框架(KohakuTerrarium、AgentScope)通过配置驱动的智能体创建挑战了从零构建的文化,而规范驱动开发(SDD Skills)将代码视为可丢弃的编译目标。来源:@KBlueleaf、@sivalabs。

-

企业智能体采用正被安全团队把关。一家美国银行叫停了 Claude Code 部署,运行12个智能体的从业者报告每个智能体都是入侵向量。来源:@hashishrajan、@MindTheGapMTG。

-

质量批评进一步尖锐化:vibe coding 的产出"以你永远不会花时间去理解的方式出错",多智能体编排的炒作超出了实际并行运行两个智能体而不失败的能力。来源:@jdegoes、@ponnappa。