Twitter AI 编程 - 2026-04-11¶

1. 人们在讨论什么¶

1.1 限流挤压波及所有提供商(🡕)¶

当天的主导讨论是:所有主要 AI 编程提供商都在同时收紧用量限制,开发者正在被迫调整。

@HarshithLucky3 发布了 当天互动量最高的串推(722 点赞,68K 浏览):“先是 Google 下调 Antigravity Pro 用户的限流。接着 Anthropic 对 Claude web/app 和 Claude Code 做了同样的事。现在 OpenAI 也对 Codex 这么做。” $100/月计划推出后,Plus 用户报告自己的用量大约只剩以前的三分之一。@cepvi0 在回复中观察到,Google 最先这么做,所以“大家都忘了”,注意力随后被 Anthropic 的削减吸走。@Alaric4678 问 GitHub Copilot 是否会是下一个,并提出开源模型是“唯一解决方案”。

这个预测当天就成真了。@douglascamata 指出,GitHub Copilot 发布了一条更新日志——“执行新限制,并从 Copilot Pro+ 中退役 Opus 4.6 Fast”——引入高级请求配额:Pro($10/月)每月 300 次,Pro+($39/月)每月 1,500 次,超额按每次请求 $0.04 计费,模型倍率从 1x 到前沿模型的 50x 不等。他称这是“为了避免反弹而写得很含糊的发帖”,因为公告没有给出旧限制与新限制的具体对比。@SPARKSERiAN 抓住了时机:“我刚说在 OpenAI 和 Anthropic 都推出那些 5 小时限制之后,GitHub Copilot 计划现在是最好的选择……结果这个就来了。”

@andacgvn 分享了一张截图,来自 Reddit 帖“Anthropic 让 Claude 变笨 67% 却没有告诉任何人,一名开发者运行 6,852 个会话证明了这一点。” 数据很惊人:分析了 17,871 个思考块,推理深度下降 67%,每个会话读取文件数从 6.6 降到 2,三分之一的编辑是在完全没读文件的情况下作出,输出中 “simplest”(最简单)一词出现频率增加 642%。Anthropic 的 Boris Cherny 将其归因于 “adaptive thinking”(自适应思考)功能:本意是在简单任务上节省 token,却错误地也限制了困难问题。该问题在用户反对下被关闭。

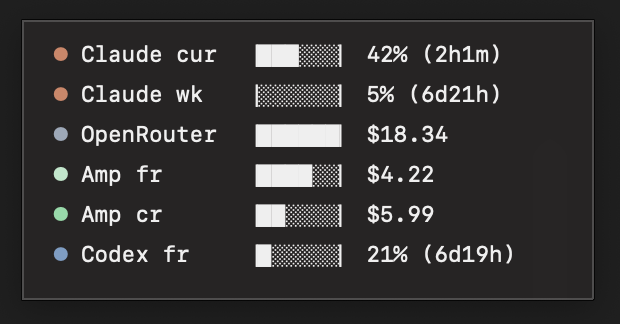

@rvtond 构建了一个桌面小组件,用于同时追踪 Claude、OpenRouter、Amplify 和 Codex 的限流状态——“不用再刷新 27 个浏览器标签页”。小组件截图显示,一个开发者正在同时消耗 5 个提供商的额度,Claude 当前周期已经用到 42%,Codex 用到 21%。

1.2 开源模型与预算叠加成为回应(🡕)¶

限流挤压正在直接推动开发者通过聚合服务采用开源模型。

@mhdcode 给出了价值测算(240 点赞,172 收藏):“$10 OpenCode Go + $10 GitHub Copilot = 大约 $80 的用量价值。” OpenCode Go 已确认首月 $5,之后 $10/月,按花费设置限制($12/5 小时、$30/周、$60/月),可使用 GLM-5、GLM-5.1、Kimi K2.5、MiMo-V2-Pro、MiMo-V2-Omni、MiniMax M2.5 和 MiniMax M2.7。@Wayland_Six 在回复中问 OpenCode 是否支持替代模型网关,@mhdcode 确认可以通过 opencode.json 配置。

@andacgvn 为试图逃离限流挤压的开发者 发布了一份完整定价指南。拆解覆盖 6 类替代服务:OpenCode Go($10/月)、Xiaomi MiMo Token Plans($6-$100/月,分层额度池)、MiniMax Token Plans($10-$50/月,最高档每 5 小时最多 30,000 次请求)、Chutes($3-$20/月)、Novita Coding Plans($19.90-$199.90/月,RPM 保障最高 450)、Alibaba Cloud Coding($50/月,每 5 小时 6,000 次请求)和 Z AI GLM Plans($10-$80/月)。

@gubatron 直接建议:“好朋友不会让你用 Claude 4.6 Sonnet,却不告诉你切到 OpenRouter 上 OpenCode harness 里的 GLM-5.1。编程和工具使用的智能水平基本相同,价格只是零头。” 他估计开源模型正以 2.2-2.5 个月的滞后追赶,并预测除非 Anthropic 和 OpenAI 在价格上竞争,否则开源会赢。

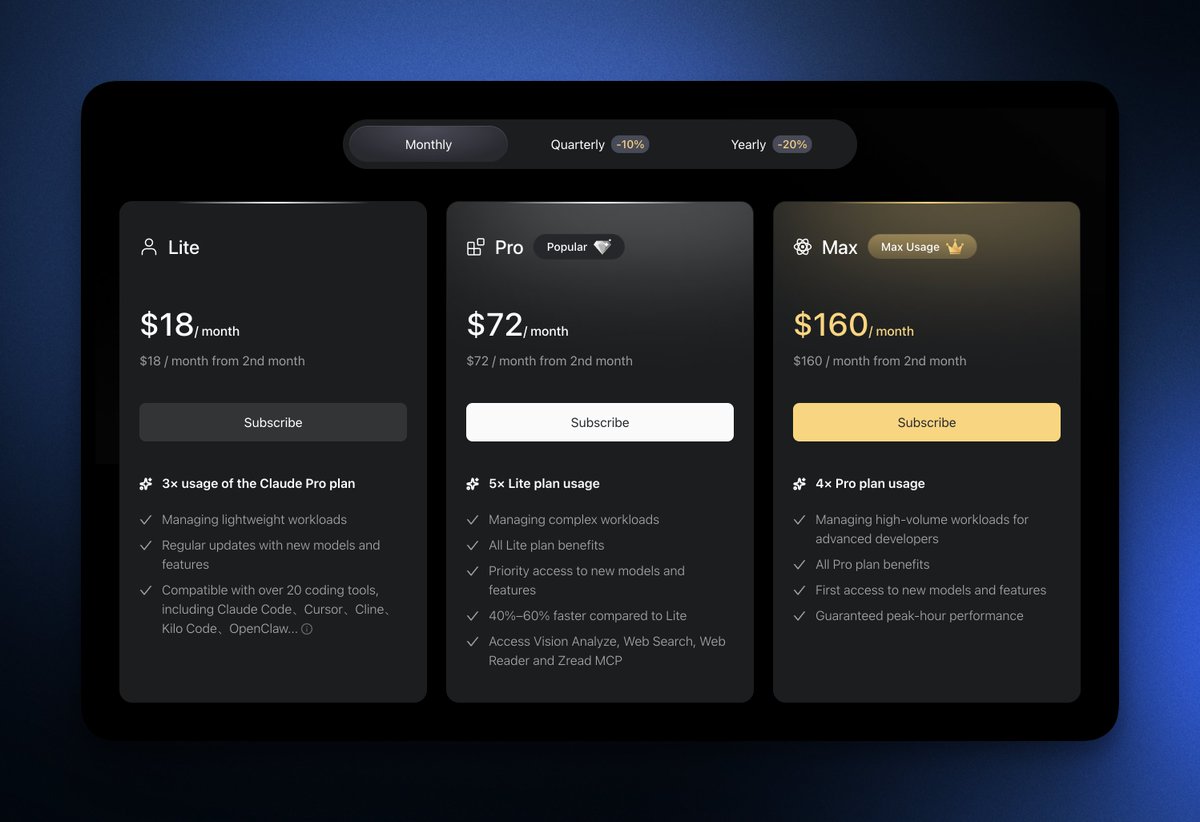

@robinebers 批评了 Z AI 针对 GLM-5.1 的定价:$18/月 Lite 计划慢且限制低,跳到 $72/月 Pro 过于极端,而 $160/月 Max 更显得不合理,因为 OpenCode Go 以 $10/月提供同一模型。

@ardadev 通过生态贡献,把所有 Kilo Code 网关模型同步到 models.dev 数据库,让它们可在 OpenCode 中使用,先从 GLM-5.1 PR 开始。

1.3 编排层浮现为真正产品(🡒)¶

一条更安静但结构上重要的线索是:AI 编程工具的价值正在从模型转向周边基础设施。

@brunoborges 演示了(79 点赞)为什么 GitHub Copilot 的价值主张是智能体编排层,而不是任何单一模型。他的截图显示 Copilot 问题分配对话框中有一个模型选择器(Claude Opus 4.6)和一个智能体下拉菜单,列出 3 个内置智能体(Copilot、Claude、Codex)以及自定义智能体(智能体式工作流、OpenGrep Autofix Agent)。“我为什么要订阅 GitHub Copilot?因为你能访问 3 个 CLI Runners 智能体编排层。”

@VeritasDYOR 分析了 Claude Code npm 源码泄露:512,000 行 TypeScript,在 24 小时内被净室重写,GitHub star 达到 100K(历史最快)。他的架构图对比了多数开源工具的“当前关注点”——从发现(MCP/API 聚合)到模型推理再到执行的薄封装。它还对比了 Claude Code 源码中暴露的“生产栈”:在发现和模型之间存在庞大的编排层,处理工具沙箱、上下文管理、错误恢复、权限控制、状态检查点和子智能体编排。

@samsaffron 具体展示了编排层差距,对比 Claude Code 与 Gemini CLI 的表格渲染。Claude Code 把结构化数据(团队名单)渲染成格式正确、对齐良好的 ASCII 表格,列间距正确;term-llm 对同一数据的展示则出现对齐糟糕和换行失败。“Claude Code 的表格渲染做得很用心——里面有很多小细节,比如空间不足时折叠表格并换一种方式渲染。”

@RNR_0 提出了经济问题:“用 API 时 Claude 贵得离谱。只能用他们的 Claude Code 或 chat,而他们可能在巨额亏损运行这些。Codex 很便宜,配 Hermes、OpenClaw 等也很好用。” 这把 harness 层框定为吸引用户留在生态里的亏本获客工具。

1.4 Vibe coding 项目变得更有野心(🡒)¶

Vibe coding 正在产生越来越复杂的结果,尽管怀疑者仍然存在。

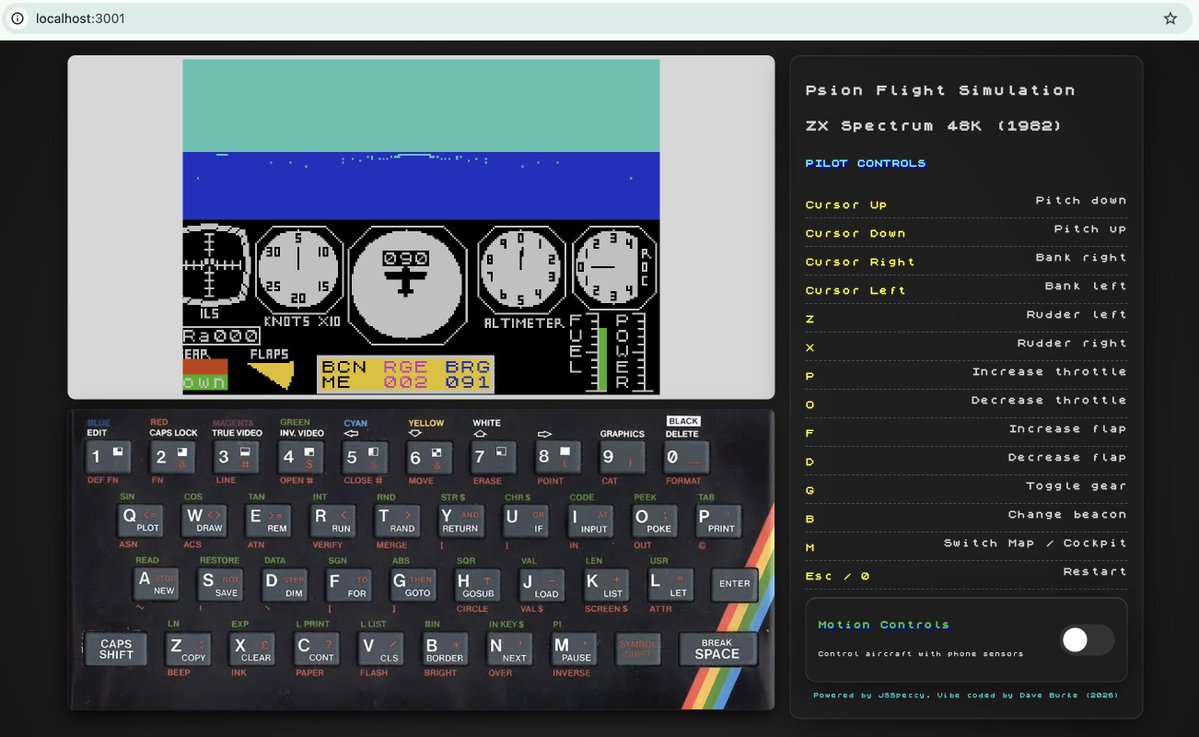

@davey_burke 用 Claude Code 搭配 gcloud-mcp 部署到 Google Cloud,复活了 1982 年的 Psion Flight Simulation(最初是 ZX Spectrum 48K)并做成完整浏览器应用。结果包括一个拟物风虚拟 ZX Spectrum 键盘、驾驶舱仪表、手机加速度计/陀螺仪控制,以及原版游戏没有的音效。

@RoundtableSpace 发布当天最高分推文(1,686 分,188 点赞,287 收藏),内容是把 Claude Code 变成“AI SEO 机器”,用于内容、关键词和搜索优化工作流。@jxkedevs 在回复中反驳:“设置还不错,但 SEO 正在被 AI 搜索吃掉。真正的打法是为 LLM 优化,而不是 Google。” @theswolesurfer 也指出,它仍然无法替代 Semrush 或 Ahrefs。

@leondevinci_ 回应(44 点赞)“人人都能写代码所以代码不值钱”的叙事:“这和 Stack Overflow 刚出现时、WordPress 刚出现时、GitHub Copilot 刚出现时一样错。每当底层被自动化,上限就会变高。WordPress 没有杀死 Web 开发者薪资。”

@cgarciae88 描述 了使用 OpenCode 中的 Gemini Flash Light 即时调试并修复 Hermes Agent WhatsApp 网关——“现在竟然可以即时修补软件了,太疯狂了”——指向一种 AI 智能体修复 AI 智能体的工作流。

2. 令人困扰的问题¶

同步发生的限流下调(High)¶

所有主要提供商——Google(Antigravity)、Anthropic(Claude Code)、OpenAI(Codex),以及现在 GitHub Copilot——都在同一时期下调用量限制,制造出一种协同“平台劣化”的观感。@HarshithLucky3 用 722 个赞的共鸣 记录了这一模式。各平台 Plus 档用户报告,用同样价格只能得到大约过去三分之一的用量。$100/月计划实际上是在重新定价过去 $20/月能获得的配额。

偷偷降低质量(High)¶

Claude Code 的 “adaptive thinking”(自适应思考)事件(由 @andacgvn 分享)代表了更深层挫败感:提供商静默降低模型能力。一名开发者运行了 6,852 个会话和 17,871 个思考块,量化出 67% 的推理深度下降。Anthropic 只有在数据公开发布到 GitHub 后才承认 bug。尽管用户反对,该问题仍被关闭。@cousinvanko 概括了情绪:“所有这些公司都应该专注于不要让模型发布 2 个月后,就不得不把它们的思考能力和智能彻底毁掉。”

定价不透明与档位宰客(Medium)¶

多个提供商以差异巨大的价格提供同一底层模型。GLM-5.1 通过 OpenCode Go 可 $10/月使用,但在 Z AI 的 Pro 档需要 $72/月才能获得更快访问。@robinebers 称这种定价“离谱”。对于“更快”或“更高限制”在实践中究竟意味着什么,缺少标准化基准,使比价变得困难。

多提供商切换开销(Medium)¶

@rvtond 构建小组件,正是因为追踪 5 个以上提供商的用量需要刷新 27 个浏览器标签页。这种运营开销——管理多个订阅、API key、限流窗口和计费周期——是当一个订阅还够用时不存在的生产力税。

3. 人们期望的功能¶

统一的限流与成本仪表盘¶

@rvtond 构建了原型,但开发者需要真正的跨提供商仪表盘:追踪用量、预测何时触发限制,并根据实时配额状态把请求自动路由到最便宜的可用提供商。小组件适合监控,但缺少优化支出的路由智能。

透明的模型质量指标¶

Claude Code 67% 的质量下降直到某个用户运行数千个会话才被发现。没有提供商发布其编程模型的持续质量指标。开发者想要第三方基准测试服务,持续监控真实编程任务上的模型表现,并在回归时发出警报。

面向前沿模型的类 OpenCode 编排层¶

@gubatron 和 @mhdcode 都指出 OpenCode 是最佳性价比,但它目前只适用于开源模型。开发者想要同样的编排层灵活性——模型无关、提供商无关、可本地配置——同时能在开源模型应付不了复杂任务时使用前沿模型(Claude Opus 4.6、GPT-5.4)。

标准化提供商定价对比¶

@andacgvn 手动整理了 6 个提供商的价格对比。这本应是一个持续维护、可搜索的数据库,并具备归一化指标:每请求成本、每 token 成本、每时间窗口请求数、模型可用性和延迟保障。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| Claude Code | 编程智能体 | 褒贬不一 | 512K 行编排层,具备打磨良好的 UX(表格渲染、上下文管理、状态检查点);在 Copilot 中集成 3 个智能体 | 限流下调;“adaptive thinking” 质量下降事件;API 定价昂贵 |

| OpenCode + OpenCode Go | 编程智能体 + 订阅 | 正面 | $10/月使用 GLM-5.1、Kimi K2.5、MiMo-V2-Pro 等;模型无关编排层;opencode.json 配置 | 仅开源模型;无法访问前沿模型;生态较新 |

| GitHub Copilot | 编程智能体平台 | 褒贬不一 | 3 个 CLI runner 智能体(Copilot、Claude、Codex);支持自定义智能体;IDE 集成 | 新高级请求配额(Pro 每月 300);模型倍率最高 50x,很快吃完配额 |

| Codex (OpenAI) | 编程智能体 | 正面 | API 定价比 Claude 便宜;配合 Hermes 和 OpenClaw 表现好 | 限流也在收紧;Plus 用户报告配额减少 |

| Hermes Agent | 自托管智能体 | 正面 | 77K GitHub star;持久记忆;47 个工具;15+ 个消息界面;cron 调度;MIT 许可 | 自托管开销;需要自己的基础设施 |

| OpenRouter | 模型路由器 | 正面 | 通过单一 API 访问多个模型;成本透明 | 多一层抽象;依赖上游提供商可用性 |

| Gemini Flash Light | 编程模型 | 正面 | 在 OpenCode 中快速调试和修复 | 复杂推理能力弱于前沿模型 |

| GLM-5.1 | 开源模型 | 正面 | 编程质量接近 Claude,成本只有零头;可通过 OpenCode Go 和 OpenRouter 使用 | 能力落后前沿模型约 2.2-2.5 个月 |

| gcloud-mcp | 部署工具 | 正面 | 从 Claude Code 直接部署到 Google Cloud | 仅适用于 Google Cloud 生态 |

| Kilo Code Gateway | 模型网关 | 中性 | 模型目录同步到 models.dev;可配合 OpenCode 使用 | 生态较小,早期阶段 |

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| Multi-provider rate limit widget | @rvtond | 桌面浮层,同时追踪 Claude、OpenRouter、Amplify、Codex 用量 | 开发者要在 5 个以上提供商仪表盘间切换 | 桌面小组件 | 已上线 | 推文 |

| ZX Spectrum Flight Sim (browser) | @davey_burke | 在 Chrome 中重建 1982 年 Psion Flight Simulation,带虚拟键盘、驾驶舱仪表和手机陀螺仪控制 | 用 vibe coding 做复古游戏保存 | Claude Code、gcloud-mcp、JSSpeccy、Google Cloud | 已上线 | 推文 |

| Hermes Agent comparison page | @nesquena | 功能对比表:Hermes vs OpenClaw vs Claude Code vs Codex,维度包括持久记忆、自托管、调度 | 自托管智能体缺少清晰竞品对比 | GitHub Pages、Hermes docs | 已上线 | 页面 |

| OpenCode + Kilo Code model sync | @ardadev | 将 Kilo Code 网关模型同步到 models.dev 数据库以兼容 OpenCode,先从 GLM-5.1 开始 | OpenCode 无法访问 Kilo Code 模型目录 | OpenCode、models.dev、PRs | 已上线 | 推文 |

| Shipper (Claude Opus 4.6 package) | @shipper_now | 预打包 Claude Opus 4.6 工作流,用于构建 Web/移动应用、Chrome 扩展、邮件营销、应用翻译、自我维护 | 非技术用户创建应用的门槛高 | Claude Opus 4.6、Shipper platform | 测试版 | 推文 |

@rvtond 的 multi-provider rate limit widget 是当天最实用的构建。截图显示 Claude 当前周期消耗 42%(剩 2h1m)、Claude 周额度 5%、OpenRouter 已花 $18.34、Codex 21%(剩 6d19h)。它解决了一个 6 个月前还不存在、但如今在管理碎片化 AI 编程订阅的高级用户中已普遍存在的问题。

@davey_burke 的 ZX Spectrum Flight Simulation 因范围和还原度而值得注意。重建一款 1982 年游戏,并加入拟物风键盘和手机传感器集成,说明 vibe coding 能产出简单原型之外的打磨过、可部署应用。

6. 新动态与亮点¶

Claude Code 源码泄露暴露 512K 行编排层基础设施¶

@VeritasDYOR 分析了 Claude Code 源码通过一次 npm 发布失误泄露后的含义。512,000 行 TypeScript 在 24 小时内被净室重写,并累积 100K GitHub star——GitHub 历史最快。架构洞察很重要:生产级编程智能体需要在工具发现和模型推理之间有庞大的编排层,处理工具沙箱、上下文管理、错误恢复、权限控制、状态检查点和子智能体编排。多数开源替代品只是薄封装,完全跳过了这一层。

GitHub Copilot 引入高级请求配额¶

GitHub 在 4 月 10 日 发布 新的限流政策,引入“高级请求”货币系统。Pro 用户($10/月)每月获得 300 次高级请求,Pro+($39/月)获得 1,500 次,超额按每次请求 $0.04 计费。高级模型倍率最高 50x,意味着一次 Claude Opus 4.6 交互就可能消耗 300 次月度请求中的 50 次。Opus 4.6 Fast 模式从 Pro+ 中退役。至此,全行业收紧已经覆盖 Google、Anthropic、OpenAI 和 GitHub,它们都在几周内下调了限制。

Hermes Agent 达到 77K GitHub star,并提供完整自托管叙事¶

Hermes Agent 对比页面(由 @nesquena 发布)把这个自托管智能体定位为综合方案:以本地 markdown 文件作为持久记忆、用 cron 调度自主任务、提供 47 个内置工具、支持 15+ 个消息界面(Telegram、Discord、Slack、WhatsApp、Signal、Matrix 等),并且能把 Claude Code 或 Codex 作为子智能体生成。在 77K+ GitHub star 和 MIT 许可背后,它代表了最成熟的开源替代方案,能够替代厂商锁定的编程智能体。@cgarciae88 演示 了如何在 OpenCode 中使用 Gemini Flash Light 实时调试并修复 Hermes WhatsApp 网关。

OpenCode Go 成为预算开发者的默认选择¶

OpenCode Go 以 $10/月提供 GLM-5.1、Kimi K2.5、MiMo-V2-Pro、MiniMax M2.5 和 MiniMax M2.7,正在迅速成为注重成本开发者的默认推荐。多名独立用户(@mhdcode、@gubatron、@robinebers)收敛到同一判断:通过 OpenCode 使用开源模型,可以用远低于前沿模型的成本达到相近编程质量。

7. 机会在哪里¶

[+++] 强:跨提供商用量管理与智能路由。 今天数据集中的每个开发者都在管理多个 AI 编程订阅,且每个都有不同限流窗口、定价模型和计费周期。@rvtond 构建了监控小组件;下一步是智能路由,根据实时配额状态、任务复杂度和模型能力,自动把请求导向最便宜的可用提供商。这是工具层问题,可以独立于任何提供商解决。(rvtond widget, mhdcode budget stacking)

[+++] 强:持续模型质量监控。 Claude Code 67% 质量下降事件显示,提供商会静默降低模型质量,而独立监控并不存在。一个在标准化任务上持续基准测试编程模型表现的服务——追踪推理深度、代码正确性、文件读取模式和思考 token 用量,并发布回归警报——将服务开发者和评估提供商可靠性的企业采购团队。(andacgvn Reddit data)

[++] 中等:开源编排层基础设施。 Claude Code 生产编排层与典型开源薄封装之间的 512K 行差距已经公开。能在开源模型之上构建生产级编排层的项目——上下文管理、错误恢复、状态检查点、子智能体编排——有机会拿下目前锁在专有编程智能体中的价值。Hermes Agent 是最接近的进入者,但它侧重一般用途智能体工作流,而不是纯编程。(VeritasDYOR architecture analysis, samsaffron table rendering comparison)

[++] 中等:标准化 AI 编程提供商市场。 @andacgvn 手工整理了 6 个提供商的价格。一个持续维护的对比平台,如果能提供归一化指标——每请求成本、每美元 token 数、每时间窗口请求数、模型可用性、延迟和质量基准——将减少现在落在个体开发者身上的研究负担。(andacgvn pricing guide, robinebers pricing critique)

[+] 新兴:带前沿模型兜底的模型无关智能体编排层。 当前生态一分为二:OpenCode/Hermes 用于开源模型,Claude Code/Copilot 用于前沿模型。一个默认使用廉价开源模型、但能在复杂任务上无缝升级到前沿模型的编排层——带成本护栏和质量阈值——会承接 @gubatron 描述的开发者工作流:常规工作交给开源,边界情况交给前沿模型。(gubatron on GLM-5.1 parity)

8. 要点总结¶

-

限流挤压是全行业同步发生的。 Google、Anthropic、OpenAI 和 GitHub 都在几周内收紧限制。$20/月档位现在只能提供大约 6 个月前三分之一的用量,而 $100/月计划重新拿回原来的额度。这是结构性重新定价,不是临时调整。(HarshithLucky3, douglascamata on Copilot)

-

开源模型是主要受益者。 通过 OpenCode Go 以 $10/月使用 GLM-5.1、Kimi K2.5 和 MiMo-V2-Pro,已经成为多名独立实践者的默认推荐,他们报告其编程质量可与前沿模型相比。开源能力滞后估计为 2.2-2.5 个月,并在缩小。(mhdcode, gubatron)

-

编排层,而不是模型,才是护城河。 Claude Code 泄露的 512K 行 TypeScript 基础设施——工具沙箱、上下文管理、错误恢复、状态检查点——代表了薄封装开源工具难以快速复刻的多年工程积累。GitHub Copilot 的价值主张也明确是多智能体编排层,而不是任何单一模型。(brunoborges, VeritasDYOR)

-

偷降质量是一个尚未解决的信任问题。 一名开发者必须运行 6,852 个会话,才能证明 Claude Code 的推理深度下降了 67%。提供商只在公开压力后承认问题。没有独立监控服务存在。这将成为需要可靠性保证的企业团队采购障碍。(andacgvn)

-

多提供商套利是新的开发者工作流。 高级用户现在同时管理 5 个或更多 AI 编程订阅,在限流窗口和定价模型之间优化。这种方法带来的运营开销——追踪配额、切换上下文、管理 API key——本身正在创造 6 个月前不存在的工具需求。(rvtond)

-

自托管智能体提供了逃离挤压的路径。 Hermes Agent 拥有 77K GitHub star,是一个成熟替代方案,让开发者控制自己的基础设施、选择自己的模型,并且不受外部限流约束。代价是运营复杂度,但随着提供商限制收紧,这个取舍越来越划算。(nesquena)