Twitter AI Coding — 2026-04-17¶

1. 人们在讨论什么¶

1.1 GitHub Copilot 速率限制危机达到临界点 🡕¶

当天对 Copilot 速率限制问题最详尽的报道来自 @OwenGregorian,他分享了 The Register 的完整报道(6 赞,1 收藏,1,024 浏览)。文章记录了:2026 年 3 月发现的 token 计数漏洞,导致 Claude Opus 4.6 和 GPT-5.4 等新模型的 token 被低估;漏洞修复后限额恢复到配置值,造成 181 小时的锁定;Anthropic 为 Copilot Pro+ 用户下线了 Opus 4.6 Fast;以及 GitHub 因滥用问题暂停了所有 Copilot Pro 免费试用。文章中一位开发者报告了 44 小时的"每周速率限制",并描述了切换到 Auto 模式后"性能明显下降"。

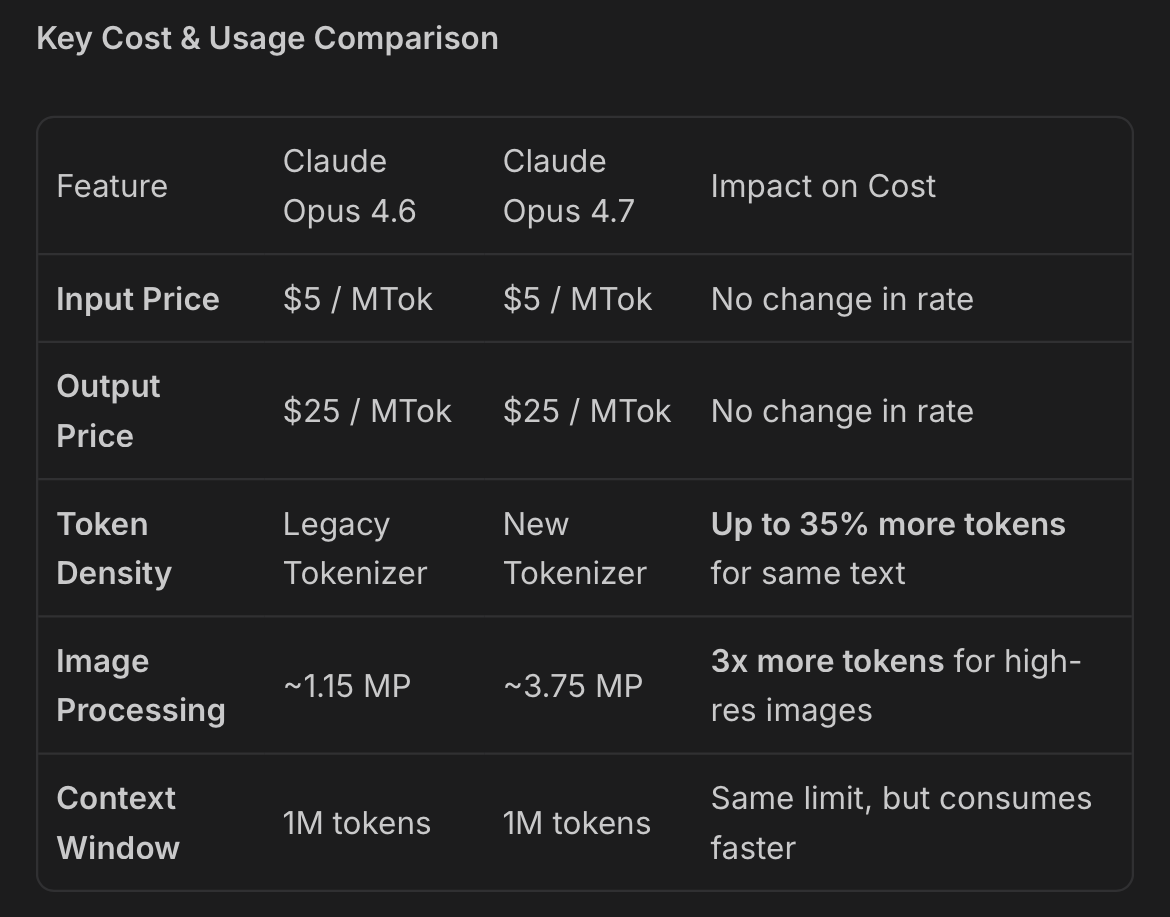

@edandersen 提供了量化分析(2 赞,3 回复,195 浏览),显示 Opus 4.7 的新分词器对相同文本多消耗 35% 的 token,对高分辨率图像(约 1.15MP 到约 3.75MP)多消耗 3 倍的 token,而 API 定价保持不变,仍为输入 $5/MTok、输出 $25/MTok。他指出,仅此一项并不能解释 GitHub Copilot 使用量 3 倍到 7.5 倍的增幅,暗示 Anthropic 可能已改变向 Microsoft 收费的价格。

另外,@shaneleexcx 转发了 GitHub 博客文章(1 赞,1 收藏),宣布从 4 月 24 日起,Free、Pro 和 Pro+ 用户的 Copilot 交互数据——包括输入、输出、代码片段和上下文——将被用于模型训练,除非用户主动选择退出。Business 和 Enterprise 用户不受影响。这一政策变更加剧了速率限制问题已经引发的信任危机。

讨论要点: The Register 的文章将这场危机定性为定价模型崩溃,而非容量问题:新模型打破了固定订阅费背后的成本假设。分词器分析提供了具体机制——Opus 4.7 在相同单价下,文本 token 数量增加 35%,图像增加 3 倍。两者共同对订阅用户形成了双重挤压。

与前日对比: 昨日记录的速率限制问题主要来自用户投诉。今天这个话题被提升到行业出版物调查层面,包含结构性分析、量化成本拆解,以及数据使用政策变更在开发者信任方面开辟的第二战线。

1.2 Warp 终端构建多智能体审查层 🡕¶

Warp 在同一天发布了两项重要功能。@warpdotdev 宣布了 /remote control(48 赞,3 引用,1,566 浏览):可在网页或手机上共享编程智能体会话并显示实时光标,支持 Claude Code、Codex 和 OpenCode。在第二篇帖子(36 赞,8 收藏,1,250 浏览)中,Warp 推出了终端内智能体代码审查功能,包括差异视图、LSP 悬浮提示和跳转定义支持,以及可发回给智能体的内联评论——"就像不离开终端的 PR 审查。"

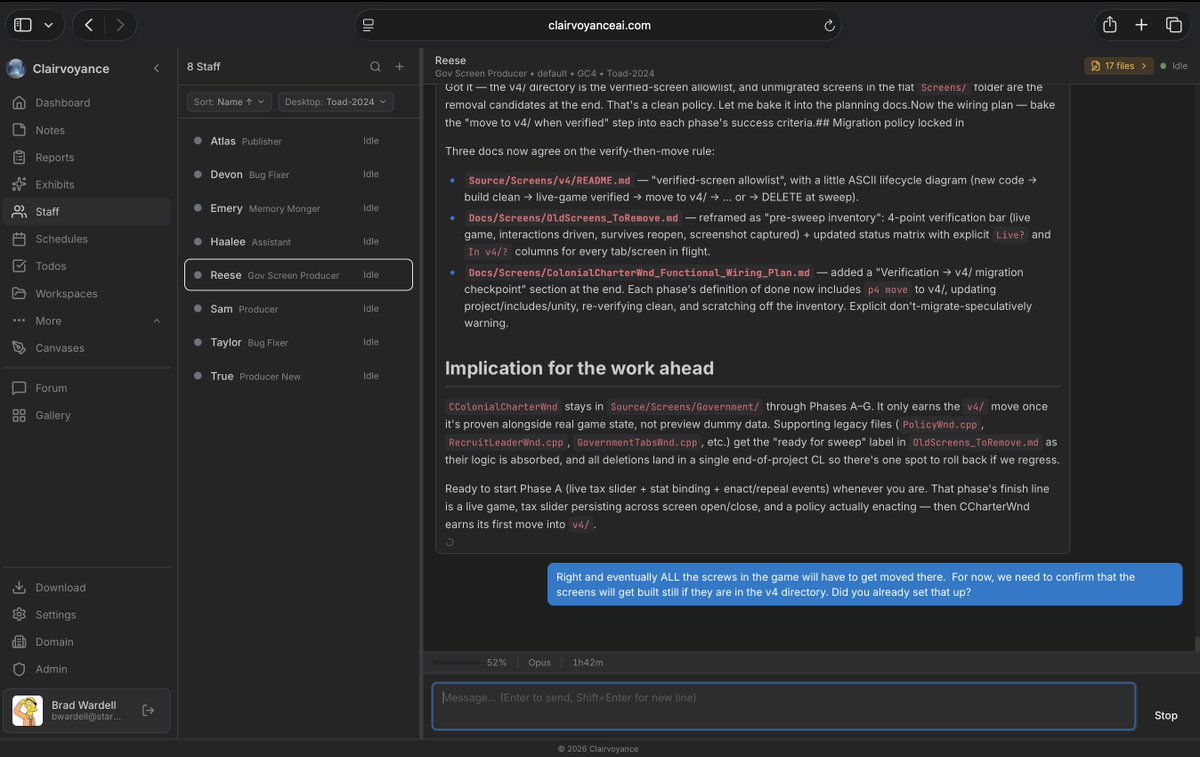

@draginol(Brad Wardell,Stardock CEO)推荐了 Clairvoyance(4 赞,2 收藏,570 浏览),展示了它通过 8 个命名 AI "员工"智能体(Bug Fixer、Memory Monger、Publisher 等专业角色)在单一界面中管理游戏迁移项目:"我在咖啡店里,能安全地通过与 Claude Code 对话让桌面电脑执行工作。"

讨论要点: 智能体交互正在形成两种截然不同的模式:Warp 将终端作为审查界面,把类 PR 工作流引入智能体输出;Clairvoyance 将智能体视为拥有命名角色和委托任务的团队。两者都假设用户需要监督和审查智能体工作,而非仅仅接收输出。

与前日对比: 昨日 Warp 发布了智能体通知功能(智能体完成或被阻塞时发送提醒)。今天扩展到完整的远程会话共享和终端内代码审查,从被动监控升级为跨设备的主动协作。

1.3 Token 压缩作为新品类出现 🡕¶

同一天有两个独立工具面世,针对同一个问题:AI 编程智能体在嘈杂的命令行输出和样板上下文上浪费大量 token。

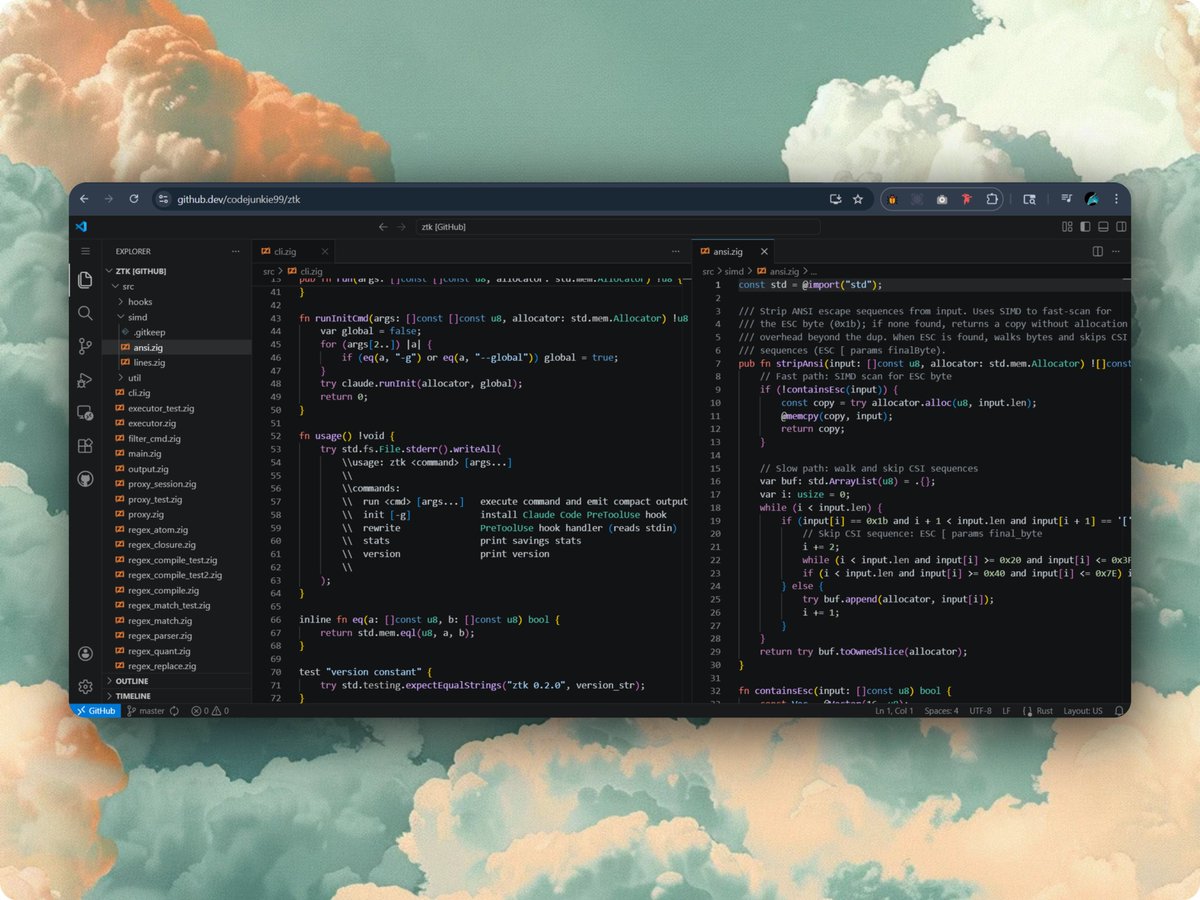

@ItsRoboki 分享了 ztk(2 赞,1 收藏,23 浏览),这是一个基于 Zig 的 CLI 工具,位于 Claude Code 和 shell 之间,在输出到达模型前压缩命令输出。GitHub 仓库记录了在 256 条真实命令上实现 90.6% 的整体 token 缩减:git diff HEAD~5 从 92,000 降至 18,000 token;cargo test(全部通过)从 397 降至 21 token。二进制文件仅 260KB,零依赖,内置 56 个过滤器,采用 SIMD 文本处理,包含 217 个测试。

@pratikbin 称赞了 Headroom 压缩引擎(1 赞,1 转发,1 收藏,26 浏览),表示在 Opus 4.7 高 token 消耗的背景下与 Claude Code 配合良好。GitHub 仓库显示 Headroom 作为代理层运行在任何智能体和 LLM 提供商之间,提供 Python 和 TypeScript SDK。附带的仪表板显示 642 次请求,节省 6,822,424 个 token,省下 $27.35,缓存命中率 93.2%,零失败。

讨论要点: 两个独立工具同时针对同一问题出现,标志着真实需求的存在。ztk 在 shell 层面运作(在输出进入上下文窗口前压缩命令输出),而 Headroom 在 API 层面运作(在智能体和 LLM 之间压缩所有上下文)。两者都是对同一经济压力的回应:Opus 4.7 的 35% token 膨胀和日益收紧的速率限制使上下文效率成为硬性要求。

与前日对比: 昨日 token 压缩并非可见话题。今天它以两个已发布工具的形式出现,并附带可衡量的成果,直接源于 Opus 4.7 的 token 成本上涨和 Copilot 速率限制收紧。

1.4 Claude Code 与 Codex:切换之争愈演愈烈 🡕¶

@chatgpt21 为 Claude Code 辩护(10 赞,4 回复,634 浏览),反驳 @theo 的批评:"它是 4 个月前由一个人开发的。而且作为一个 100% 用 vibe coding 方式更新的产品,它的表现非常出色。"他将其定位为"第一个通过 vibe coding 达到如此大用户规模的软件","每天有数百万人在使用。"

@2sush 观察到开发者正从 Claude Code 转向 Codex(4 赞,89 浏览):"结果证明,'最好的模型'在截止日期前崩溃时毫无意义。"与此同时,@weswinder 指出了 Codex 的弱点(6 赞,5 回复,329 浏览):"如果 Codex 能做设计,我真的会把所有事情都交给它。它非常聪明,但当我看到输出的样子时真的很失望。"@jskoiz 的回复精准概括了这种审美问题:"你不喜欢圆角矩形套着额外边框来'突出'效果,再嵌套在一个更大的圆角矩形里?"

@dani_avila7 强调了 Claude Design(4 赞,1 收藏,160 浏览)发布了"移交给 Claude Code"功能以及 Canva 导出——一个从设计到代码的直接桥梁,这是 Codex 目前所缺少的。

讨论要点: 竞争框架已从"哪个模型更聪明"转向"哪个工具更可靠、更完整"。Claude Code 的优势在于通过 Claude Design 实现的设计到代码管线。Codex 的优势在于智能水平,但设计输出是公认的短板。对 Claude Code 的"vibe coding"辩护值得注意——它表达的观点是:当迭代速度足够快时,vibe coding 的质量水平是可接受的。

与前日对比: 昨日报道了 Codex 通过 111 个插件向通用平台扩展。今天出现了反面叙事:可靠性问题推动用户转向 Codex,但设计质量又将他们拉回 Claude 生态系统。

1.5 Vibe Coding 既获尊重也遭质疑 🡒¶

@martin_casado(a16z 普通合伙人)反思了 vibe coding 游戏开发(46 赞,10 回复,2 引用,1,544 浏览):"这让我深刻感受到传统游戏开发投入的时间和精力。显然,大部分精力花在了调整数值、游戏玩法、故事撰写、关卡编辑、叙事创作等方面。打磨的长尾效应。"@MatthewSchrager 回复道:"让人深感谦卑,意识到第一版与专业作品之间的差距有多大。"Casado 表示认同:"我越用 vibe coding,就越尊重专业游戏开发者。"

@Grady_Booch(UML 联合创始人,IBM Fellow)在被问到"那边怎么了?"时,给出了精辟的诊断(18 赞,4 回复,510 浏览):"两个词:Vibe. Coding."

@SenorScience 提出了反面观点(1 收藏,143 浏览):"Vibe coding 适合快速发布。但'随着时间推移会变好'的前提是有真正具备工程判断力的人在引导构建什么以及如何构建。"@SPYDA000 分享了现实体验(4 赞,58 浏览):"我试图构建的东西真的比预期花了多得多的时间……如果你真的想交付严肃的产品,就必须花时间。"

讨论要点: Vibe coding 的讨论正在从二元对立(有用/没用)走向细致入微。Casado 的观点很有代表性:vibe coding 足以揭示代码生成从来就不是难点。打磨、设计、叙事和游戏平衡才是。这重新定义了 vibe coding 的角色——它是一个暴露哪些工程工作才真正重要的工具。

与前日对比: 昨日报道了有组织的黑客松和零基础到构建者的叙事。今天有影响力的声音(Casado、Booch)加入,带来更审慎的评价,将对话从"vibe coding 是未来"转向"vibe coding 让你看清什么才是难的"。

1.6 智能体驱动的内容生产管线投入实际运行 🡕¶

@zeke 详细描述了一个完整的深度伪造视频制作管线(13 赞,10 收藏,962 浏览),在单次 OpenCode 会话中使用 Claude Opus 4.6 构建,总成本 $95:Replicate 视频生成约 $53,OpenCode 约 $32,X API 访问约 $12。该管线将博客文章抓取为 markdown,通过 Chrome DevTools MCP 提取员工账号,分析互动数据,编写视频脚本,并行生成图像和克隆语音 TTS,用 ffmpeg 拼接 4 分钟视频,并通过 Typefully API 草拟推文串——全程不到两小时,公开 GitHub 仓库记录了整个过程。

@galileowilson 倡导系统级自动化(30 赞,8 回复,165 浏览):"打开 Claude,让它了解你的整个业务流程。然后用 Claude Code 和智能体自动化重复任务。一个周末的设置,你的运营效率就能提升 10 倍。"

讨论要点: 这条深度伪造管线的意义不在于新颖性,而在于透明度:精确的成本拆解、模型选择和成本优化建议。以 $95 制作一个包含语音克隆和图像生成的 4 分钟视频,确立了智能体编排多媒体制作的成本底线。

与前日对比: 昨日报道了 Codex 的非编程用例(报税、高管简报)。今天扩展到多媒体制作领域并附有完整成本核算,将智能体编排的内容创作确立为一个有据可查、可复制的工作流。

1.7 Google Antigravity 教育内容与免费叠加策略 🡒¶

@JulianGoldieSEO 发布了 4 小时(16 赞,9 收藏,644 浏览)和 2 小时(13 赞,8 收藏,782 浏览)两套完整的 Google Antigravity 课程。合计 17 个收藏的数据表明,对这个尚属新兴的平台有着较高的参考价值。

@TheCryptoDaddi 描述了零成本叠加模式(12 赞,5 收藏,1,853 浏览):免费使用 Google Stitch,将 Stitch MCP 添加到 Google Antigravity,即可获得与 Opus 4.7 相当的网站质量且零成本。在另一篇帖子(12 赞,700 浏览)中,他认为这种组合对传统建站工具构成威胁:"大概可以放心做空 $WIX 了。"

@imnottanmay 批评了 Google 的执行力(2 赞,1 收藏,269 浏览):"Gemini Pro 3.1 太差了。Antigravity 没救了。"这与大量教育内容形成对比,表明平台布道者积极制作课程与开发者评估模型质量之间存在分歧。

讨论要点: Google Antigravity 占据独特位置:免费定价推动采用,但模型质量遭到批评。Stitch + Antigravity 免费技术栈是相对付费 Claude/Codex 订阅的具体成本套利手段,在那些平台遭遇速率限制困扰的背景下尤为相关。

与前日对比: 昨日指出了 Antigravity 与第三方工具的认证政策风险。今天焦点转向教育内容(共 6 小时课程)和免费叠加策略,表明即使模型质量受到质疑,该平台的采用仍在增长。

1.8 OpenClaw 与 Codex 认证基础设施的摩擦 🡕¶

@levelsio(Pieter Levels)公开请求帮助(19 赞,18 回复,5,027 浏览)解决 openai-codex 的 OpenClaw OAuth token 刷新失败问题。该帖子吸引了 18 条回复,@wayneb 提供了分步修复方案(2 赞,2 收藏,294 浏览):列出已配置的账户、通过浏览器流程重新认证、重启网关。另一位用户报告因无法 SSH 访问他们的 Raspberry Pi 而无法远程修复。

@buildbasekit 在回复中概括了更广泛的挫败感:"这就是现代开发体验。你调试的不是自己的代码——你在调试工具之间的认证。通常重新认证就能解决,但真正的修复方案是更好的错误提示。有一半时间你根本不知道是哪一层出了问题。"

讨论要点: 当一位拥有 5,027 浏览量求助帖的知名开发者都无法解决工具认证问题时,这表明智能体基础设施已经复杂到成为一种独立的故障模式。修复需要跨两个系统的三条 CLI 命令——这种摩擦程度削弱了"让智能体自行工作"的承诺。

与前日对比: 昨日未出现 OAuth/认证基础设施作为痛点。今天通过一位知名用户暴露了这个问题,揭示了多层认证(OpenClaw 网关 + OpenAI Codex OAuth + 本地 token)构成了一条脆弱的链路。

2. 令人困扰的问题¶

速率限制与定价模型崩溃——高¶

The Register 的调查提供了迄今最全面的报道:2026 年 3 月的 token 计数漏洞使新模型看起来比实际更便宜。GitHub 修复后,限额恢复到配置值,导致 181 小时的锁定和任务中途智能体被终止。GitHub 已为 Pro+ 用户下线 Opus 4.6 Fast,并暂停了所有免费试用。@OwenGregorian 分享了完整文章(1,024 浏览)。文中一位开发者描述了切换到 Auto 模式的体验,该模式选择更便宜的模型:"我的项目几乎没有进展,Auto 模式选择的低质量模型经常偷偷走捷径也不告诉我。"这已不再是容量问题——而是固定订阅无法承受前沿模型成本的定价模型失败。

Opus 4.7 Token 成本膨胀——中¶

@edandersen 量化了影响(195 浏览):Opus 4.7 的新分词器对相同文本多产生 35% 的 token,对高分辨率图像多产生 3 倍的 token,而每 token 的 API 成本保持不变。上下文窗口仍为 1M token,但填充速度更快。这对所有 Opus 4.7 用户构成了隐性涨价,进一步加剧了 Copilot 速率限制问题。

智能体认证基础设施脆弱性——中¶

@levelsio 因 OAuth token 刷新失败而无法使用 OpenClaw/Codex(5,027 浏览)。修复需要跨两个系统的三条 CLI 命令。另一位用户因无法通过 SSH 访问 Raspberry Pi 进行重新认证而被阻塞。调试负担落在了用户身上——他们要调试的不是自己的代码,而是认证层。

不透明的更新实践——低¶

@uncooloj 呼吁提供更新日志(3 赞,150 浏览):"每天都看到更新提示,却完全不知道会有什么变化、有什么新功能或改了什么。"频繁发布却缺乏文档会侵蚀用户信任。

GitHub 引导用户使用 Copilot——低¶

@_avdept 展示了一张截图(3 赞,67 浏览),显示 GitHub 的冲突解决下拉菜单中"在网页编辑"被标记为"太复杂"并置灰,而"用 Copilot 修复"被提供为替代选项。该用户感到不满:"什么时候开始限制我在网页编辑器中解决冲突了?"

3. 人们期望的功能¶

AI 编程智能体的设计质量¶

@weswinder 直接指出了这个缺口(6 赞,329 浏览):"如果 Codex 能做设计,我真的会把所有事情都交给它。这是最大的问题。"Claude Design 的"移交给 Claude Code"(由 @dani_avila7 展示)是首次尝试弥合这一差距,但需要留在 Anthropic 生态系统内。一个任何编程智能体都能调用的模型无关设计层仍然缺位。

更好的智能体故障信息¶

@buildbasekit 在回复 levelsio 的 OAuth 问题时总结道:"真正的修复方案是更好的错误提示。有一半时间你根本不知道是哪一层出了问题。"随着智能体技术栈越来越深(编排器 + 网关 + OAuth + 模型提供商),错误归因本身已成为一个工程难题。

更新日志与更新透明度¶

@uncooloj 请求为 Claude Code 和 Codex 更新提供结构化的更新日志。由于这两个工具每天都在发布更新,用户需要版本级别的发布说明来了解行为变化,尤其是影响智能体工作流的破坏性变更。

网站的智能体就绪标准¶

@celso 在 Cloudflare 的"你的网站对智能体友好吗?"扫描器中获得了满分 100/100(10 赞,4 收藏,505 浏览),该扫描器从可发现性(3/3)、内容(1/1)和 Bot 访问控制(2/2)三个维度评分,给出 Level 5"智能体原生"评级。这代表了一个新兴标准,但采用工具和最佳实践仍然稀缺。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| GitHub Copilot / Copilot CLI | IDE + 终端智能体 | (-) | 对 OSS 维护者/学生免费;Spring Boot 教程生态;冲突解决集成 | 速率限制危机(181 小时锁定);token 计数漏洞后遗症;数据训练 opt-out 政策 |

| Claude Code | 终端编程智能体 | (+/-) | Opus 4.7 任务范围扩展;Claude Design 移交;数百万日活用户 | 新分词器导致 35% token 膨胀;"vibe coding"质量顾虑;身份验证推行 |

| Codex CLI / Desktop | 智能体平台 | (+/-) | 计算机控制;GPT-5.4 性能;高智能水平 | 设计输出质量差距;通过 OpenClaw 的 OAuth 脆弱性;速率限制 |

| Warp | 终端 | (+) | 带实时光标的远程会话共享;终端内类 PR 代码审查并支持 LSP;多智能体支持 | 新功能未经规模验证 |

| OpenCode | 开源终端智能体 | (+) | 智能体就绪测试;深度伪造管线编排;模型无关 | 生态系统不及 Claude Code/Codex |

| ztk | Token 压缩 CLI | (+) | 90.6% token 缩减;260KB 二进制文件;56 个过滤器;SIMD 处理 | 新项目;仅 Zig 实现;仅限 shell 层面 |

| Headroom | Token 压缩代理 | (+) | 节省 680 万 token;93.2% 缓存命中率;适用于任何智能体/提供商 | 增加延迟(平均 10.56 秒);代理架构 |

| Google Antigravity | IDE | (+/-) | 免费定价;Stitch MCP 集成实现零成本网站 | 模型质量受批评;与第三方工具的认证政策风险 |

| OpenFang | 开源智能体框架 | (+) | v0.5.10:AWS Bedrock、Copilot OAuth 重写、armv7、Argon2id 认证、45 个 bug 修复 | 复杂;受众小 |

| Clairvoyance | 多智能体桌面应用 | (+) | 命名智能体角色;手机远程访问;游戏开发用例 | 早期阶段;文档有限 |

| Hermes Agent | 本地智能体 | (+) | 高级用户忠诚度高;支持本地模型运行 | 难以配置;社区有限 |

最显著的变化是智能体与模型之间出现了 token 压缩层。ztk 和 Headroom 都在回应同一个经济压力:Opus 4.7 的分词器膨胀和 Copilot 速率限制使上下文效率从优化变成了硬性要求。Warp 同一天发布的两项功能(远程控制 + 代码审查)将其定位为包裹所有智能体的终端层,不受提供商限制。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| ztk | @ItsRoboki | 面向 AI 智能体的 CLI shell 输出压缩工具 | 嘈杂命令输出造成的 token 浪费 | Zig, SIMD, Thompson NFA regex | v0.2.0, shipped | Post, GitHub |

| Headroom | @pratikbin(贡献者) | 面向任何 LLM 智能体的代理式上下文压缩 | 工具调用、RAG、文件读取中的样板膨胀 | Python, TypeScript, LiteLLM, Apache 2.0 | Shipped, PyPI + npm | Post, GitHub |

| Labrat | @poof_eth | 采用赌博机式资源分配的并行研究运行器 | 智能体研究中单一思路的爬山算法容易陷入瓶颈 | CPU workers, eval-based frontier, family funding | Open-sourced | Post |

| OpenFang v0.5.10 | @openfangg | 支持 15+ 适配器的多提供商智能体框架 | 提供商锁定、部署复杂性 | Rust, TOML config, Docker, armv7 | v0.5.10 | Post |

| Dr JSkill Workshop | @juliendubois | 9 章 Copilot CLI + Spring Boot 工作坊 | Java 开发者需要结构化的智能体驱动学习 | Spring Boot 4, Copilot CLI, Agent Skills | Published | Post, GitHub |

| SuperBased | @Santosh74038967 | 带 token 压缩的 AI 截图 + 语音输入应用 | 向智能体描述视觉上下文浪费 token | Screenshot capture, Wispr Flow-style voice, plugins for Claude Code/Codex | In development | Post, Site |

| Agents Week Deepfake | @zeke | 通过单次智能体会话完成端到端视频制作管线 | 手动多媒体制作缓慢且昂贵 | OpenCode, Claude Opus 4.6, Replicate, ffmpeg, X API, Typefully | Completed ($95 total) | Post |

| egaki | @__morse | 使用 Codex 订阅 token 的 CLI 图像生成器 | 智能体内部生成图像的最低成本方式 | npx, Codex API | Shipped | Post |

| Vortex Chaser | @WatersChie | VibeJam 2026 龙卷风追逐游戏 | Game Jam 参赛作品,展示 AI 构建的游戏 | Bolt, Google Antigravity, 90%+ AI-generated | Submitted | Post |

Token 压缩集群(ztk、Headroom、SuperBased)代表了当天最显著的构建模式。三个独立项目从不同角度解决同一问题:shell 输出(ztk)、API 代理(Headroom)和视觉捕获(SuperBased)。Labrat 对智能体研究的处理方式——运行并行实验族群并基于评估分配资源——在架构上颇具新意,将研究本身视为资源调度问题而非顺序搜索。

6. 新动态与亮点¶

Claude Code 内部架构通过 npm 源码被完整映射¶

@_vmlops 报告(1 赞,3 收藏,90 浏览),法国一位开发者从 Claude Code 的 npm 包中逆向工程了完整源代码:1,900 个文件中的 512,000 行 TypeScript。由此建立的微型网站映射了智能体循环、50 多个工具、多智能体编排以及未发布的功能。这种透明度——无论是否有意为之——为开源社区提供了一份商业智能体架构的详细蓝图。

Claude 身份验证推行¶

@nicklaunches 报告(7 赞,71 浏览),Anthropic 正在推行 Claude 的身份验证,要求提供有效证件(护照、驾照)并进行面部识别扫描。r/LocalLLaMA 上的帖子"更多转向本地的理由"一夜之间获得 540 个赞。这可能会加速注重隐私的开发者采用本地模型。

Copilot 交互数据训练政策¶

GitHub 宣布从 4 月 24 日起,Copilot Free、Pro 和 Pro+ 用户的交互数据将被用于模型训练,除非主动选择退出。数据包括接受的输出、代码上下文、光标位置、导航模式和功能交互反馈。Microsoft 员工数据已在使用中。Business 和 Enterprise 用户不受影响。(Post)

Cloudflare 智能体就绪扫描器¶

@celso 获得了满分智能体就绪评分(10 赞,505 浏览),使用 Cloudflare 的"你的网站对智能体友好吗?"工具,该工具从可发现性、内容和 Bot 访问控制三个维度评分,采用 5 级评级体系。结合 OpenCode 在 2 分钟内达成满分的表现,这标志着一个面向 AI 智能体可访问性的新兴 Web 标准正在形成。

GitHub 冲突解决引导至 Copilot¶

@_avdept 记录(67 浏览),GitHub 网页编辑器现在将某些合并冲突标记为"太复杂无法解决",同时提供"用 Copilot 修复"作为替代方案。这代表了 Copilot 从可选助手向某些操作的默认解决路径的转变。

7. 机会在哪里¶

[+++] Token 压缩与上下文优化 — 两个独立工具(ztk:shell 层面 90.6% 缩减;Headroom:API 代理层面节省 680 万 token)加上 SuperBased(截图到 token 转换)在同一天发布。需求驱动力是结构性的:Opus 4.7 的 35% 分词器膨胀叠加 Copilot 速率限制执行,形成硬性经济约束。任何减少每次智能体会话 token 消耗的工具,都能直接在速率限制内延长使用时间。市场正按层次分化(shell、代理、捕获)——一个跨越所有三层的集成方案将能覆盖完整技术栈。

[+++] 智能体会话审查与协作基础设施 — Warp 在同一天发布了远程会话共享和终端内代码审查。Clairvoyance 展示了带命名角色的多智能体团队管理。其模式是:随着智能体运行时间越来越长、产出的代码越来越多,人工审查成为瓶颈。提供类 PR 审查工作流、协作光标和基于角色的智能体管理的工具,解决的正是随着每个 Opus 4.7 长时间运行会话而不断扩大的缺口。

[++] AI 智能体的设计到代码管线 — Codex 的设计质量被称为"阻碍全面采用的最大问题"。Claude Design 的"移交给 Claude Code"是首个集成方案,但将用户锁定在单一生态系统内。一个模型无关的设计层——能够根据智能体提示词生成生产级 UI/UX,可与任何编程智能体配合使用——填补的是今日数据中被引用最多的能力缺口。

[++] 智能体认证与基础设施调试 — levelsio 的 OAuth 故障引来 5,027 浏览和 18 条回复。修复需要跨两个系统的三条 CLI 命令。随着智能体技术栈不断加深(编排器 + 网关 + OAuth + 提供商),调试重心从"我的代码有什么问题"转向"哪个认证层坏了"。能够追踪智能体基础设施各层故障——并提供清晰、可归因错误信息——的诊断工具,解决的是随着每次新集成而不断加剧的痛点。

[+] Web 资产的智能体就绪优化 — Cloudflare 的智能体就绪扫描器建立了评分框架(可发现性、内容、Bot 访问控制)。随着 AI 智能体成为重要的流量来源,网站需要像当年针对搜索引擎优化一样,为智能体可访问性进行优化。审计和提升智能体就绪评分的工具——类似于 SEO 工具——随着"你的网站对智能体友好吗?"标准的推广,正在填补一个新兴细分市场。

8. 要点总结¶

-

Copilot 速率限制危机有了结构性解释。 The Register 的调查揭示了 2026 年 3 月的 token 计数漏洞,使新模型看起来比实际更便宜。修复后,限额恢复原位,导致 181 小时的锁定。这是定价模型失败,而非容量问题——固定订阅无法承受前沿模型的成本。(Post)

-

Token 压缩在一天内成为一个品类。 两个独立工具——ztk(shell 层面 90.6% 缩减,260KB Zig 二进制文件)和 Headroom(API 代理层面节省 680 万 token)——以可衡量的成果发布。两者都是对 Opus 4.7 的 35% 分词器膨胀和日益收紧的速率限制的直接回应。(Post, Post)

-

Warp 正在构建多智能体终端层。 同一天发布的两项功能——带实时光标的远程会话共享和支持 LSP 的终端内类 PR 代码审查——将 Warp 定位为所有编程智能体的审查与协作界面,不受提供商限制。(Post, Post)

-

设计质量是 AI 编程智能体被引用最多的缺口。 用户需要 Codex 的智能水平,但无法接受它的视觉输出。Claude Design 的"移交给 Claude Code"是首个集成的设计到代码桥梁,但将用户锁定在单一生态系统内。(Post, Post)

-

GitHub 正在多条战线上收紧 Copilot 生态系统。 速率限制、Opus 4.6 Fast 下线、免费试用暂停、交互数据训练 opt-out(4 月 24 日生效)以及冲突解决引导至 Copilot,都指向一个对开发者体验施加更多控制的平台。(Post, Post)