Twitter AI Coding — 2026-04-18¶

1. 人们在讨论什么¶

1.1 Token 优化成为当日热议焦点 🡕¶

当天互动量最高的帖子来自 @DeRonin_,他整理了 10 个 GitHub 仓库,可在 Claude Code 中减少 60-90% 的 token 消耗(559 赞,1,177 收藏,60,532 浏览)。该列表涵盖 token 缩减技术栈的多个层级:RTK(Rust Token Killer)是一个 CLI 代理,在终端输出进入上下文窗口前进行过滤,声称可对常见开发命令减少 60-90%。Context Mode 将原始工具输出沙箱化到 SQLite 中,在 Playwright、GitHub 和日志数据上实现 98% 的缩减。code-review-graph 使用 Tree-sitter 将代码库映射为本地知识图谱,在大型 monorepo 上实现 49 倍的 token 缩减。Token Savior 通过基于符号的导航(69 个工具、零外部依赖)实现 97% 的代码导航 token 缩减。帖子还列出了更轻量的方案:Caveman Claude 通过约束输出详细度减少 65-75% 的输出 token,claude-token-efficient 是一个直接放入的 CLAUDE.md 文件,Zilliz 的 claude-context 使用混合 BM25 + 稠密向量搜索实现约 40% 的缩减。

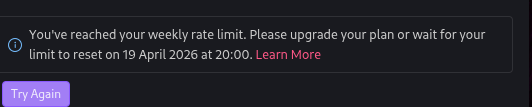

附带的基准表量化了一个 30 分钟 Claude Code 会话的节省情况:cat/read 从 40,000 降至 12,000 token(节省 70%),cargo test / npm test 从 25,000 降至 2,500(90%),git add/commit/push 从 1,600 降至 120(92%),总计从约 118,000 降至约 23,900 token,减少 80%。@Hamid98927142 的回复指出 "On opus 4.7, 5 prompt use and token gone",DeRonin_ 建议将 Opus 4.7 保留用于 "general tests, compliance of general roadmap, architecture building",而日常任务使用 Opus 4.6。

讨论要点: 1,177 次收藏——远超当日数据集中任何其他帖子——表明 token 优化已从小众关注演变为生存技能。DeRonin_ 的表述("most people are burning tokens without knowing it")将上下文浪费视为盲区而非有意选择。他建议根据工作流类型(大量终端输出、大型代码库、多 MCP 服务器)组合使用 2-3 个工具,意味着优化空间足够大,没有任何单一工具能全面覆盖。

与前日对比: 昨日 token 压缩作为一个新品类出现,有两个工具(ztk 和 Headroom)发布。今天这个话题爆发为一个完整的工具包生态,涵盖 10 个仓库、一张基准表和 60K 浏览量——证实昨日的信号只是一波更大浪潮的前沿。

1.2 Anthropic 订阅条款不透明引发开发者强烈反弹 🡕¶

@theo(T3 Stack 创始人)发布了一篇详细投诉(38 赞,2,131 浏览),指出 Claude Code 订阅条款缺乏明确性:"We've been begging for clarity for months. All we get is 'we're working on it' again and again." 该帖子的起因是有报告称 Anthropic 在没有预警的情况下封禁了 T3 Code 用户。Theo 描述了其影响:"There are dozens of incredible builders who want to make incredible things, and none of them even know if they are allowed to." @mjtechguy 在回复中补充道:"I want to give them thousands of dollars a month personally, I just wanna know what I'm allowed to do."

@GergelyOrosz(The Pragmatic Engineer)在两篇帖子中做了跨厂商对比。在其中一篇(99 赞,9,852 浏览)中,他称 "unacceptable to ban paying customers from your AI tool without justification, and no appeals path",并提到自己 "called it out when Google did the same with Antigravity customers." 在另一篇(94 赞,8,877 浏览)中,他回忆了 Google 封禁 Antigravity 用户的经历——"who caused too much load for them: no comms, no way to appeal." 他还在自回复中披露:"I have no affiliation neither with Anthropic, nor OpenAI. I pay for both."

@milan_milanovic 列举了一连串故障(2 赞,61 浏览):"Claude Code is failing on every second attempt to use it. Substack is refreshing the page when you enter something. ChatGPT is clearing what you wrote after 4-5 seconds when loaded."

讨论要点: 这次反弹的核心不在于价格,而在于规则不明。Theo 明确表示愿意遵守任何指导方针,甚至愿意在被告知后放弃支持。令人沮丧的是 Anthropic 没有为第三方集成发布清晰的使用政策,导致构建者无法放心投入。Gergely 的跨厂商框架(Anthropic + Google + 此前的 GitHub Copilot 速率限制)将此定位为行业性问题,而非单一供应商的问题。

与前日对比: 昨日记录了通过 The Register 调查报道和 Opus 4.7 token 膨胀反映出的 Copilot 速率限制危机。今天信任侵蚀直接扩展到 Anthropic 本身,高知名度构建者(theo、Gergely)公开质疑订阅透明度。供应商信任问题现已涵盖三大主要提供商。

1.3 多工具工作流取代单一智能体忠诚度 🡕¶

"一个工具统治一切"的叙事持续瓦解。@smartnakamoura 捕捉到了这一趋势(3 赞,2 收藏,65 浏览):"Cursor, Claude Code, and OpenAI Codex are no longer competing with each other. Developers are now running all three together in the same workflow. Cursor for the interface, Claude Code for reasoning, Codex for code generation. The one AI tool wins story was wrong."

@jtlin 提出了一个具体的组合方案(1 赞,1 收藏,61 浏览):"Claude Opus 4.7 for strategy, OpenAI Codex w/ GPT 5.4 for coding, Qwen 3.6 35B A3B local for everything else." @cblatts 更进一步(2 赞,4 收藏,475 浏览),将 Codex 集成到 Claude Code 中,"so I can get dueling deep research reports, or have an outside critic of Claude plans/skills/code from Codex."

@BillydaAnalyst 描述了一个双工具配置(1 收藏,38 浏览):"My AI coding stack in 2026 isn't one tool. It's Google Antigravity + Claude Code in the terminal running together. This combo replaced my entire workflow."

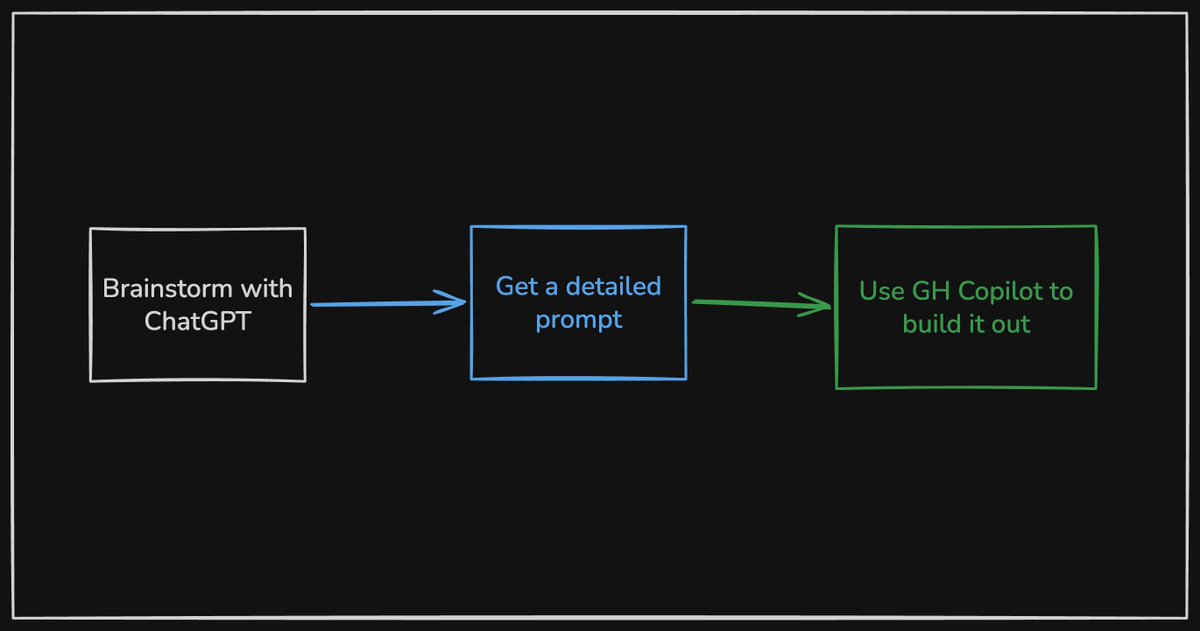

@maskaravivek 分享了一个三步原型开发工作流(1 赞,32 浏览):先用 ChatGPT 进行头脑风暴,获得详细的提示词,然后使用 GitHub Copilot 来构建。他赞赏 Copilot 的定价模式:"charges per PR, not flat rate."

讨论要点: 多工具模式已不再是愿景——而是实际运行中的工作流。用户正在为特定工具分配特定角色(Cursor 负责 UI,Claude 负责推理,Codex 负责生成,Qwen 负责本地任务)。这使市场沿着能力维度而非品牌忠诚度进行分化。目前的组合使用需要手动编排,这催生了对自动路由不同工具的集成层的需求。

与前日对比: 昨日话题集中在 Claude Code 与 Codex 之间的切换辩论。今天这种二元框架被多工具组合所取代,问题不再是"选哪个",而是"用什么组合,每个工具承担什么角色"。

1.4 Google Antigravity 教育内容大量涌现 🡒¶

@JulianGoldieSEO 发布了多个 Antigravity 课程:一个 4 小时版本(17 赞,10 收藏,731 浏览),一个 2 小时版本(15 赞,10 收藏,828 浏览),另一个 4 小时帖子(14 赞,10 收藏,535 浏览),第二个 2 小时帖子(7 赞,7 收藏,943 浏览),以及一个 Codex 视频(7 赞,2 收藏,324 浏览),标题为 "OpenAI Codex AI: The New Everything Super App." Antigravity 相关帖子的累计收藏数(37)表明参考需求强劲。

与此同时,@xdadevelopers 发布了一篇为期一个月的对比评测(10 赞,5 收藏,2,141 浏览),比较了 Cursor、Google Antigravity 和 Windsurf,宣称 "there is a clear winner."

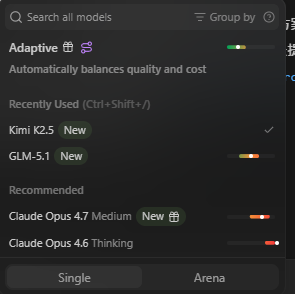

@FyzureX 选择了相反的方向(1 赞,1 收藏,213 浏览):"Officially ditched Google Antigravity for Windsurf! Done with 429 errors & Gemini lock-in. Windsurf brings real stability + Model Freedom: use Opus 4.7, GLM 5.1, or free Kimi 2.5."

讨论要点: Google Antigravity 处于一个矛盾的位置:它产生了最多的教育内容(6 小时以上的课程),同时也因 429 错误和模型锁定而流失用户。XDA 的对比评测达到 2,141 浏览,表明主流受众正在积极评估 IDE 版图。Windsurf 成为 Antigravity 不满情绪的受益者,具体原因在于它提供了模型选择自由。

与前日对比: 昨日 Antigravity 的报道集中在免费叠加策略(用 Stitch MCP 构建 $0 网站)和认证政策风险上。今天教育内容的量级进一步增加,同时出现了向 Windsurf 转移的并行趋势,表明该平台在同时获取休闲用户和流失高级用户。

1.5 Copilot 速率限制持续困扰付费用户 🡒¶

@mkurman88 报告称(15 赞,1,393 浏览):"GitHub Copilot was the best choice a few days ago, but they made the most stupid move I've ever seen. I pay for requests, aka additional credits I haven't yet bought/paid for, and I still got rate-limited for 32 hours."

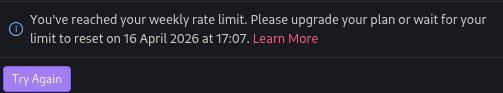

@MelansonIndus 附带截图投诉(1 赞,68 浏览):"Why keep adding stuff to GitHub copilot when we pay for 4 weeks and get a rate limit weekly. This is ridiculous 2h of work and I hit my rate limit. It used to be you get rate limited for one specific model, now rate limited globally across all models."

@chrisklumph 指出(1 赞,34 浏览):"Still not seeing 4.7 truly shine above Opus 4.6 even though it's more than twice as expensive in GitHub Copilot." @789HZ 公开申诉(2 赞,23 浏览),称其订阅因共享支付方式而被暂停。

相比之下,@martinwoodward(GitHub)提供了内部人士的视角(4 赞,1 收藏,123 浏览):"We see high performing teams doing some investments in custom instructions / skills though to get things tuned up and a reproduceable experience across the team. Maybe that's the part people are missing when they go from greenfield to existing codebases?"

讨论要点: 速率限制的不满已从昨日的结构性分析演变为今天的切身体验报告。从按模型限制升级到全局限制(MelansonIndus 的经历)代表了显著的收紧。MartinWoodward 的回复表明 GitHub 将解决方案定位于更好的上下文工程(自定义指令/技能),而非更高的限额,但这一框架并未回应用户反映的"2 小时即被锁定"的体验。

与前日对比: 昨日 The Register 提供了结构性分析(token 计数漏洞、定价模型崩溃)。今天用户层面的证据不断积累:尽管付费购买额度仍被锁定 32 小时,全局速率限制取代了按模型限制,以及因共享支付方式导致的订阅暂停。

1.6 OpenCode 转向 Electron,Tauri 失宠 🡕¶

@TechieUltimatum 记录了 OpenCode 的技术转换(6 赞,3 收藏,21 浏览),从 Tauri 迁移到 Electron:"Fix performance issues. Consistent experience across platforms. Fewer crashes (Windows + Linux). Unified rendering with Chromium." 帖子提到 OpenCode 已有 140K star 和 650 万用户。

@ibuildthecloud 紧随其后(1 赞,276 浏览):"I guess I'm porting discobot to electron. I haven't been happy with tauri but honestly I just copy whatever @opencode does. I went with tauri because they were doing it. I previously tried two projects on tauri, both sucked."

@LukeParkerDev 报告了持续的 Tauri 问题(6 赞,259 浏览):"my opencode desktop WSL branch is getting really big lol im not merging until its smooth and just WORKS nicely. many many little fixes. lots of footguns with WSL/windows."

讨论要点: OpenCode 从 Tauri 迁移到 Electron 是一个重要的数据点:一个拥有 140K star 的项目选择了稳定性和跨平台一致性,而非 Tauri 更轻量的优势。连锁效应(ibuildthecloud 也随之切换,因为 "I just copy whatever @opencode does")表明这可能将智能体桌面应用的默认选择从 Tauri 拉回 Electron。

与前日对比: 昨日 Tauri 与 Electron 并非讨论话题。今天通过一个重大项目迁移浮出水面,确立了 Electron 作为生产级智能体桌面应用的务实选择。

1.7 OpenAI Codex 黑客马拉松与生态势能 🡒¶

@gabrielchua(OpenAI)宣布(12 赞,1,177 浏览)API 额度已发放给 OpenAI Codex 黑客马拉松班加罗尔站的申请者:"Pair it with Codex which is available on ChatGPT Free & Go." @vipulgupta2048 赞赏了组织团队(13 赞,1,130 浏览)。@Dev_Maqbool 分享了 API 额度邮件截图(2 赞,12 浏览),表示尽管未被选中仍心怀感激。

@freeCodeCamp 发布了一门完整课程(84 赞,66 收藏,3,484 浏览),主题为使用 OpenAI Codex 进行智能体化开发,由 @andrewbrown 讲授:"AI coding tools are evolving from assistants into full-blown agents that can complete tasks for you."

@bradwmorris 对 Codex 的 computer use 功能做出反应(1 赞,1,130 浏览):"holy sh*t - he is right. go and try the new codex computer use feature. far better than cowork + playwright, seems super token efficient."

讨论要点: OpenAI 正在投资社区建设(附带 API 额度的黑客马拉松),而 freeCodeCamp 的课程标志着主流教育领域的采纳。bradwmorris 对 computer use 功能的认可将 Codex 定位为在智能体-计算机交互领域取得进展,这恰好是 token 效率至关重要的领域。

与前日对比: 昨日报道了 Codex 向通用平台的扩展。今天生态支撑基础设施(黑客马拉松、课程、社区额度)和具体功能热度(computer use)进一步巩固了这一势头。

2. 令人困扰的问题¶

Copilot 速率限制波及付费用户 — 高¶

@mkurman88 报告了 32 小时的速率限制(1,393 浏览),尽管已付费购买额外额度。@MelansonIndus 记录了工作 2 小时即触发速率限制的情况,截图显示限制已从按模型升级为全局限制。@chrisklumph 指出 Opus 4.7 "more than twice as expensive" 但质量提升不明显。用户的不满不再仅仅是限制存在——而是限制与付费模式相矛盾。

Anthropic 订阅条款仍不透明 — 高¶

@theo 详细描述了数月来未获回应的诉求(2,131 浏览),希望获得关于 Claude Code 订阅条款对第三方集成的明确规定。有报告称 T3 Code 用户在未收到预警的情况下被封禁。@GergelyOrosz 做了跨厂商对比(9,852 浏览),与 Google 封禁 Antigravity 用户的情况类似。当规则未公开时,构建者无法放心投入。

Google Antigravity 稳定性问题 — 中¶

@FyzureX 转向 Windsurf,理由是 "429 errors & Gemini lock-in." @DynastyWillz 描述了(6 赞,82 浏览)反复失败的经历:"After some many prompts the agent still mix the design up and have not gotten it right." @imnottanmay 称(2 赞,280 浏览)Antigravity "a lost cause."

AI 生成代码质量问题("Slop") — 中¶

@d4m1n 记录了(72 浏览)使用 claude -p 在 4 小时内对 68 个 spec 文件运行 100 次迭代的 Claude Code 实验。结果:65,000 行代码生成了一个空应用,在部署时以 Vercel "client-side exception" 错误崩溃。git 提交历史显示约 15 个 "feat:" 提交,由 "danmindru and claude" 在 5-6 小时内完成,全部指向一个无法运行的应用。

OpenCode 会话持久化 Bug — 低¶

@eren7262 报告称(55 浏览)关闭并重新打开终端会清除本地目录会话,而全局会话则保留:"whole session wiped by local directory wise."

3. 人们期望的功能¶

AI 供应商提供清晰的订阅和使用政策¶

@theo 明确表示:"Give us ANY clarity... We're happy to follow any official guidance we are given." 构建者需要针对 Claude Code、Codex 和 Copilot 第三方集成的已发布、可执行的条款。当前状态——规则不透明且执行不可预测——阻碍了对生态的投资。

自动多工具路由¶

多位用户描述了手动为工具分配角色:Cursor 负责 UI,Claude 负责推理,Codex 负责生成(smartnakamoura),或 Opus 负责策略,GPT 5.4 负责编码,Qwen 本地运行处理其余任务(jtlin)。一个能根据任务类型、成本和可用性自动将任务路由到最优工具/模型的编排层,将取代当前的手动组合方式。

智能体会话中的 Token 预算可见性¶

@DeRonin_ 建议 "run /context in a fresh session and see how much is gone before you even type a word",暗示大多数用户对 token 消耗毫无可见性。集成到智能体会话中的实时 token 预算仪表板将帮助用户做出明智的优化决策。

非简单项目的可靠 AI 智能体输出¶

@d4m1n 的 4 小时 Claude Code 会话产出 65,000 行无法运行的代码,@DynastyWillz 在 Antigravity 中反复遇到设计失败,凸显了演示级与生产级智能体输出之间的差距。长时间智能体运行中的质量关卡、增量验证和人机协同检查点仍未被解决。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| Claude Code | 终端编程智能体 | (+/-) | 深度推理能力;token 优化生态(10+ 工具);MCP 工具结果上限达 500K token | 订阅条款不透明;无预警封禁用户;长时间运行产出 65K 行低质量代码 |

| GitHub Copilot / Copilot CLI | IDE + 终端智能体 | (+/-) | 自动模型选择 GA 发布,享 10% 折扣;按 PR 计费;CLI 可扩展性 | 2 小时后触发全局速率限制;付费用户被锁定 32 小时;Opus 4.7 成本翻倍但效果不明 |

| OpenAI Codex | 智能体平台 | (+) | Computer use 功能被赞为 "super token efficient";freeCodeCamp 课程;黑客马拉松社区 | Playwright-stealth 请求被拒(dallas_on_ai);生态仍在成熟中 |

| Google Antigravity | IDE | (+/-) | 大量教育内容(6 小时以上课程);免费层;XDA 对比评测 | 429 错误;Gemini 锁定;反复提示后设计混乱 |

| Windsurf | IDE | (+) | 模型自由度(Opus 4.7、GLM 5.1、Kimi 2.5);比 Antigravity 更稳定 | 社区规模较小;教育内容较少 |

| OpenCode | 开源终端智能体 | (+) | 140K star,650 万用户;转向 Electron 提升稳定性 | WSL/Windows 使用陷阱;会话持久化 Bug |

| CodexBar | 智能体仪表板 | (+) | v0.21:Abacus AI、Codex Pro $100、多提供商修复 | CPU 使用问题(已缓解);需要配置审计 |

| OpenFang | 智能体框架 | (+) | v0.5.10:AWS Bedrock、Copilot OAuth 重写、armv7、修复 45 个 Bug | 配置复杂;受众较窄 |

| Cursor | IDE | (+) | 在多工具组合中因界面质量获得好评 | 被定位为"UI 层"而非完整解决方案 |

| Qwen 3.6 35B A3B | 本地模型 | (+) | ts-bench 100% 通过率;匹配 Sonnet 4.6 / Opus 4.6 任务速度;可在消费级硬件运行 | 需要 32GB+ 内存或 RTX 3090+ |

最显著的变化是多工具工作流的整合。用户不再争论"用哪个工具",而是组装角色分明的工具栈。Copilot CLI 的自动模型选择(附带 10% 折扣)和 Windsurf 的模型自由度都在回应同一需求:用户希望使用多个模型而无需手动管理。围绕 Claude Code 的 token 优化生态(10 个仓库,60K 浏览)现已成为数据中最大的单一主题集群。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| CodexBar v0.21 | @steipete,由 @RatulSarna 维护 | 多提供商成本仪表板和编程智能体网关 | 跨 Claude、Codex、Antigravity、Ollama 的成本追踪和提供商管理 | macOS,多提供商 API | 已发布 | Post |

| OpenCode Obsidian 插件 | @tom_doerr(分享) | 将 OpenCode AI 助手直接嵌入 Obsidian | 笔记配合 AI 需要独立工具 | Obsidian 插件,OpenCode web view,Bun,Node.js | Beta(通过 BRAT) | Post, GitHub |

| wterm + agent-browser | @ctatedev | HTML 终端渲染器,配合 a11y tree 自动化用于智能体端到端测试 | 终端自动化和跨智能体编排 | HTML,a11y tree,浏览器自动化 | Demo | Post |

| OpenFang v0.5.10 | @openfangg | 支持 15+ 适配器的多提供商智能体框架 | 提供商锁定,部署复杂性 | Rust,TOML 配置,Docker,armv7 | v0.5.10,已发布 | Post |

| Kodelyth ECC | @sifxprime | 53 个 AI 智能体,185 项技能,79 个命令,面向开发者 | 跨平台可复用的智能体工具包 | MIT 许可,多平台 | v1.1.0,已发布 | Post, GitHub |

| 智能体控制的视频编辑器 | @om_patel5(分享) | 由 Claude Code 和 Codex 控制的视频编辑器 | 繁琐的手动视频编辑 | macOS 桌面,本地处理,DaVinci Resolve/Premiere Pro 导出 | Demo | Post |

| peon-ping | @chenzeling4(分享) | 游戏主题语音通知,用于 AI 智能体请求关注 | 需要守候终端等待智能体完成/出错 | Warcraft/StarCraft/Portal/Zelda 语音包,跨平台 | v2.21.0,已发布 | Post, GitHub |

| OpenClaude | @chenzeling4(分享) | 支持 200+ 模型的开源编程智能体 CLI | 终端编程智能体的提供商锁定 | 终端优先,MCP,斜杠命令,提供商配置文件 | v0.4.0,已发布 | Post |

| Emoji List Generator | @cassidoo | 将项目符号列表转换为带 emoji 标注的列表的 CLI 工具 | 手动选择 emoji 效率低 | @opentui/core,@github/copilot-sdk,clipboardy | 已发布 | Post, Blog |

| Claude x TradingView MCP | @AleiahLock(分享) | 将 Claude Code 连接到 TradingView 进行自动交易分析 | 无公开 TradingView API;手动分析效率低 | Claude Code,MCP,Node.js 18+,TradingView Desktop | 指南已发布 | Post |

| Cloudflare Agent-Ready Skill | @fctelles | 用于编程智能体集成 Cloudflare API 的 MCP 技能 | 手动操作 Cloudflare API | npx,兼容 GitHub Copilot/Claude/Kiro | 已发布 | Post |

最引人注目的构建趋势是智能体生态基础设施的涌现:CodexBar 管理多提供商成本,OpenFang 提供多适配器框架,Kodelyth 捆绑 53 个可复用智能体,peon-ping 解决了一个平凡但真实的问题——知道智能体何时需要关注。由 Claude Code 和 Codex 控制的视频编辑器将 AI 编程智能体的边界从代码扩展到创意工作流。OpenClaude 的快速 star 增长(约两周内超过 20K)表明市场对开源、供应商无关的终端智能体有着强劲需求。

6. 新动态与亮点¶

Copilot CLI 自动模型选择正式发布¶

GitHub 推出了 Copilot CLI 的自动模型选择功能,覆盖所有计划。Auto 模式根据计划和策略自动路由到 GPT-5.4、GPT-5.3-Codex、Sonnet 4.6 和 Haiku 4.5。使用 auto 时,用户可享受 10% 的高级请求折扣。该功能为动态模式,通过选择最高效的模型来缓解速率限制。(@GHchangelog,帖子,26 赞,1,863 浏览)

Qwen 3.6 35B A3B 在消费级硬件上匹配云端模型¶

@TeksEdge 分享了基准测试结果(6 赞,4 收藏,308 浏览),显示 Qwen3.6-35B-A3B 在所有测试的智能体(opencode、vibe-local、GitHub Copilot、qwencode、Claude Code)中实现 100% 的 ts-bench 通过率,匹配 Claude Sonnet 4.6 和 Opus 4.6 的任务速度,推理速度比 Qwen3.5-27B 快 3 倍。可在 32GB+ 内存的 Mac 或 RTX 3090/4090/5090 上运行。

Android CLI 发布,支持 AI 辅助移动开发¶

@geekyouup 分享了使用感受(1 赞,2 收藏,149 浏览),体验了 4 月 17 日发布的新 Android CLI,与 Google Antigravity 配合使用。这将 AI 编程智能体扩展到移动开发领域,提供了专用的命令行工具。

OpenClaw 衰退加速¶

@Param_eth 预测了 OpenClaw 的消亡(10 赞,675 浏览):"Don't be surprised if OpenClaw is fully dead in a few months. OpenAI onboarded Peter Steinberger to push Codex. Then OpenAI made OpenClaw irrelevant." 引用了一则 Polymarket 帖子,显示 "OpenClaw" 的 Google 搜索量已跌至接近基线水平。

GPT-Rosalind 和 Codex 生命科学插件¶

@MSaintjour 报道称(3 赞,209 浏览)OpenAI 发布了 GPT-Rosalind——一个面向生命科学的前沿 AI 模型,同时推出 Codex 生命科学插件,将 50+ 个科学数据库集成到统一的自然语言界面中。这将 Codex 从软件开发扩展到了科学研究领域。

Claude Code 更新:500K Token MCP 结果和原生可执行文件¶

@T_ok_AI 总结了(1 赞)Claude Code 的最新更新:MCP 工具结果上限提升至 500K token,插件命令现可使用原生可执行文件,内置教程可从 CLI 访问。

7. 机会在哪里¶

[+++] Token 优化工具与集成 — 当天热度最高的帖子(6,675 分,1,177 收藏)汇总了 10 个独立的 token 缩减工具。用户正在根据工作流类型手动叠加 2-3 个工具。一个将 shell 层过滤(RTK)、API 层压缩和上下文感知代码导航整合到单一配置中的集成方案,将覆盖完整的优化面。需求驱动力是结构性的且持续增长:速率限制收紧加上 Opus 4.7 token 膨胀,使上下文效率成为每次会话的硬性经济约束。

[+++] 多工具编排层 — 用户正在手动分配 Cursor 负责 UI,Claude 负责推理,Codex 负责生成,本地模型负责成本优化。目前没有工具能自动将任务路由到最优模型/智能体。一个轻量级编排层——检测任务类型(设计、推理、生成、适合本地处理)并结合成本感知路由到最佳工具——将取代当前每个多工具用户都在独立进行的手动组合。

[++] 供应商中立的订阅管理 — Anthropic 无预警封禁,Google 因负载过高封禁,Copilot 对付费额度实施速率限制。构建者需要一个能跨提供商监控订阅健康状态、在接近限额时发出警报、追踪执行操作并自动故障转移到备用提供商的工具。三大主要提供商全面的信任侵蚀使这成为一个跨领域需求。

[++] 智能体运行质量关卡 — @d4m1n 4 小时自主运行产出 65,000 行无法运行的代码,表明在长时间智能体会话中需要增量验证。一个在执行过程中定期编译、测试和验证智能体输出的工具——在生成无法运行的代码时终止或重定向运行——将防止"大规模低质量输出"的失败模式。

[+] 编程智能体的本地模型部署 — Qwen 3.6 35B A3B 在消费级硬件上匹配云端模型性能(所有智能体 ts-bench 100% 通过),使本地部署在许多任务中变得可行。简化编程智能体本地模型设置的工具——在本地资源不足时自动回退到云端——将帮助用户降低云端成本并避免日常任务的速率限制。

8. 要点总结¶

-

Token 优化现已成为 AI 编程领域互动量最高的话题。 一个汇总了 10 个 token 缩减仓库的列表获得了 60,532 浏览和 1,177 收藏——是第二高收藏帖子的 10 倍以上。基准数据显示 30 分钟 Claude Code 会话可实现 80% 的整体节省。这是社区的首要优先事项。(帖子)

-

供应商信任侵蚀现已涵盖三大主要提供商。 Anthropic 无预警封禁 T3 Code 用户并拒绝公布订阅条款(@theo,帖子)。Google 因负载过高封禁 Antigravity 用户(@GergelyOrosz,帖子)。GitHub Copilot 在 2 小时后对付费额度用户实施速率限制(@mkurman88,帖子)。目前没有任何主要 AI 编程提供商提供可预测、透明的条款。

-

多工具叠加已取代单一工具忠诚度。 开发者正在为特定工具分配特定角色——Cursor 负责界面,Claude 负责推理,Codex 负责生成,Qwen 本地运行负责成本控制——并同时运行。竞争问题已从"哪个工具胜出"转变为"什么组合和怎样编排"。(帖子,帖子)

-

本地模型现已在消费级硬件上匹配云端编程性能。 Qwen 3.6 35B A3B 在所有测试的编程智能体中实现 100% 的 ts-bench 通过率,匹配 Claude Sonnet 4.6 和 Opus 4.6 的任务速度,可在 Mac 32GB+ 或 RTX 3090+ 上运行。这使本地优先的开发方式在越来越多的任务中变得可行。(帖子)

-

Copilot CLI 自动模型选择预示成本感知智能体路由的未来。 GitHub 正式发布的自动模型选择——路由到最高效的模型并附带 10% 高级请求折扣——是用户手动构建的路由模式的首个供应商级实现。这验证了多模型编排的机会。(帖子)

-

大规模 AI 智能体输出质量仍未解决。 一次 4 小时的自主 Claude Code 会话产出 65,000 行无法运行的代码,表明当前智能体在长时间运行中缺乏自我验证能力。演示级与生产级智能体输出之间的差距,是超越绿地项目后采纳面临的下一个重大障碍。(帖子)