Twitter AI Coding — 2026-04-20¶

1. 人们在讨论什么¶

1.1 GitHub Copilot 定价剧变:暂停注册、速率限制、token 计费 🡕¶

当天最重大的新闻由 @edzitron 爆出,他报道(143 赞,8,989 浏览)称"本周 GitHub Copilot 个人计划的速率限制将迎来重大变化,Opus 模型将从 $20 计划中移除,甚至可能引入 token 计费。"随后他发布了一篇独家文章(53 赞,3,288 浏览),援引 Microsoft 内部文件揭示:自一月以来,运行 GitHub Copilot 的周成本已翻倍,token 计费已成为"首要优先事项"。

数小时后,GitHub 确认了这些变化。@chribjel 分享(10 赞,894 浏览)了 @GHchangelog 的官方公告:Copilot Pro、Pro+ 和 Student 计划的新注册已暂停,"以维护现有用户的服务可靠性",使用限额收紧,Pro+ 提供比 Pro 高 5 倍的限额。

@Techmeme 汇总(7 赞,2,624 浏览)了完整的变化范围:Opus 模型从 Pro 移除,Opus 4.7 仅限 Pro+。@badlogicgames 发布提醒(38 赞,3,612 浏览):"通过 GitHub Copilot 使用 Opus 4.7 仅支持中等思考模式。"一位名为 @cherry_mx_reds 的回复者称其为"明抢"——信用消耗为 7.5 倍。

@edandersen 指出了另一个缺陷(33 赞,5,030 浏览):"付费高级请求预算只能在组织层面设置——你无法为特定项目的部分用户分配额度——这意味着一个普通开发者就能在一天内花光整个公司的预算。"@ZakSMorris 反映(4 赞,168 浏览)自己每月支付 39 英镑的 Pro+ 费用,却被"一夜之间降级"且毫无预警。

@thisisjonc 提出了反面观点,他展示(31 赞,1,155 浏览)在 $100/月的计划上以 Extra High 级别运行,每周用量仅消耗 10%:"这完全合理。"

讨论要点: edzitron 最初帖子的回复串捕捉到了这种张力。@mrnuu 指出 Opus 和 Anthropic 模型自三月中下旬起就已从 Copilot 消失,按请求计费搭配昂贵模型本就不可持续。@GlennDubby 预测:"当企业看到真实价格并衡量其与'智能'的性价比时,对 LLM 的退缩将会非常强烈。"

与前日对比: 昨天的 Copilot 话题是关于 Ollama 实现免费本地智能体运行。今天叙事发生了反转:Microsoft 正在收紧云端产品的访问权限、移除模型并暂停新用户注册。昨天的本地优先选项如今看来颇具先见之明,因为成本压力正在加速。

1.2 Codex 桌面应用激增,Chronicle 新增屏幕上下文记忆 🡕¶

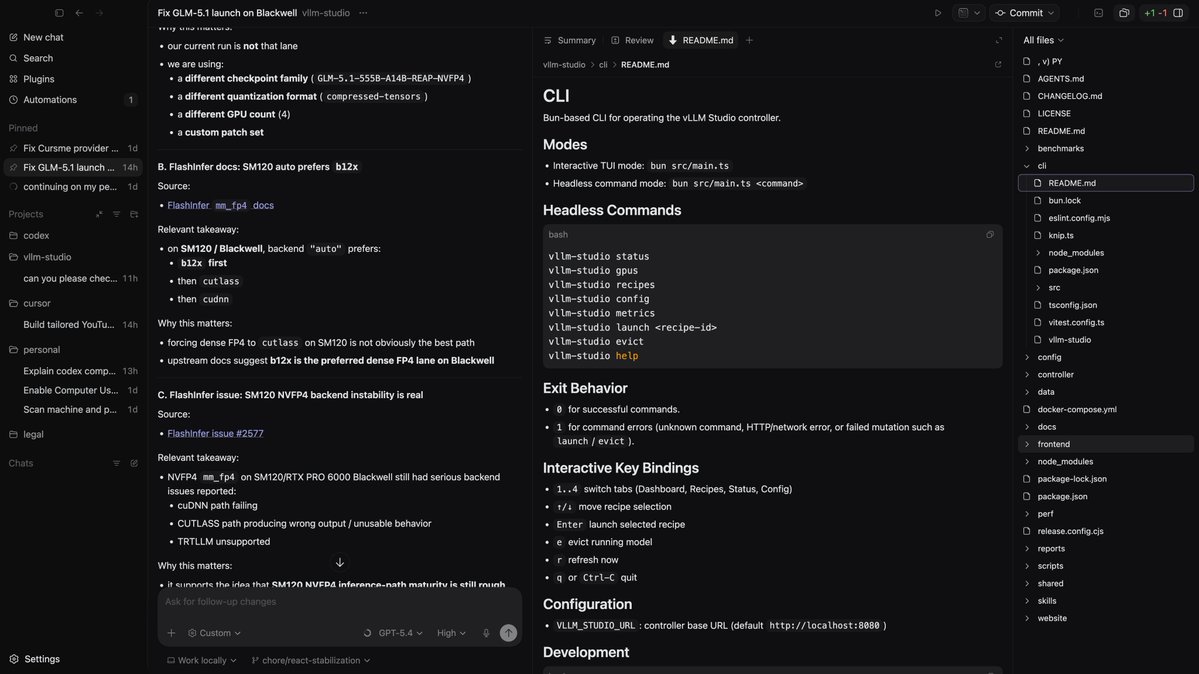

当天得分最高的帖子来自 @0xSero,他盛赞 Codex 桌面应用(546 赞,20,128 浏览,评分 1182.2)"从不可用变成了当下'智能体工程'的第一名体验。UI 非常出色,计算机使用完全不具侵入性且功能强大。"

截图显示 Codex 在 vllm-studio 项目上运行 GPT-5.4,调试 Blackwell 架构的 GPU 推理路径——这是一个真实的工程任务,而非演示。@m13v_ 的回复解释了为何计算机使用在 macOS 上效果出色:"AX 树自 OS X 以来一直保持稳定,每个原生应用都能干净地暴露它。同样的策略在 Windows UIA 上几乎立刻遇到不一致的问题。"

@rileybrown 发帖(276 赞,8,568 浏览):"如果 OpenAI 发布一个设计能力和 Opus 4.7 一样强的模型,Codex 应用将遥遥领先。"@Ixel111 在回复中建议 GPT-5.4 加上 GPT-Image-2 可能缩小差距:"假设两个模型本周都发布,我们拭目以待。"@haider1(18 赞,1,397 浏览)也呼应了这一设计质量差距:"我真的希望 OpenAI 在下一个 gpt-5.x 版本中提升前端质量。"@TeeDevh(3 赞,131 浏览)则问:"有没有办法让 Codex 输出好看的 UI?它在逻辑方面很强,但设计方面和 Claude 完全不在一个水平。"

另外,OpenAI 发布了 Chronicle。@embirico(OpenAI)宣布(90 赞,4,124 浏览):"Codex 现在有了记忆功能,而且可以包含最近的桌面上下文——即你一直在做的工作。"Chronicle 通过定期截屏来构建项目、错误和工作流的记忆。仅限 Pro 用户,仅限 macOS,"超级实验性"。

@TechieUltimatum 详细介绍(8 赞,59 浏览)了实现方式:记忆以 markdown 文件形式存储在本地,需要选择加入权限,并包含隐私警告。@Steffan0xd 在 @coinbureau 的报道(19 赞,5,504 浏览)下的回复道出了隐私方面的紧张:"我绝对没准备好让 AI 全天候监视我的屏幕,就为省点时间。"

讨论要点: @RatulSarna 向 embirico 询问了仓库级记忆与全局记忆的问题,显示出企业对作用域上下文的需求。@robschaper 将 Codex 称为"我推荐人们学习并利用的首要技能,无论你做什么工作。"

与前日对比: 昨天 Codex 的计算机使用功能在基础设施任务(Raspberry Pi + Tailscale)中有所记录。今天桌面应用获得了有史以来最高的互动量(评分 1182.2),同时 Chronicle 增加了一项全新能力——从屏幕截图获取环境上下文。产品正在从"你去提示的工具"转变为"主动观察的助手"。

1.3 Google Antigravity:发布速度遇上客户信任危机 🡖¶

@GergelyOrosz 记录(113 赞,7,380 浏览)了一个破坏性的客户故事:一名付费 Antigravity 用户想要跟踪使用量,由于 Antigravity 没有原生工具而使用了 CodexBar,结果被 Antigravity 封禁;尝试用 Gemini CLI 作为替代方案,结果发现也被封了——由同一个 Antigravity 团队控制。客服告诉他们"无能为力"。在后续回复中,Gergely 补充道:"还有人问为什么 Google 在开发者中无法获得市场份额?Antigravity 悄悄封禁合法的付费用户已是反复出现的模式。"

与此同时,@LyalinDotCom(Google)列出了八项产品发布(134 赞,7,155 浏览),语带尖刻讽刺:"最近这里也没什么大事。"清单包括 Gemini 3.1 Flash TTS、Gemini Robotics-ER 1.6、Antigravity 更新、Gemini CLI 更新、AI Studio 更新、macOS 原生应用、Flash Live Thinking 和 Gemma4。LyalinDotCom 还支持使用竞品工具(17 赞,1,285 浏览)与 Google 的工具一起使用——"如果你是构建者,就应该探索所有工具。"

@Presidentlin 表达了期望(25 赞,1,348 浏览),希望 Gemini 3.5 Pro 在 Google I/O 之前发布,指出 Google 拥有"太多产品界面"(CLI、Antigravity、Jules、AI Studio、API)。@cyburke 列出了自己的订阅组合(1 赞,445 浏览,3 收藏)并表示:"我也有 Gemini Pro(免费一年),但在 Google 搞了 Antigravity 封禁之后我就不用了。"

@JulianGoldieSEO 继续在信息流中大量发布 Antigravity 教育内容:一门 4 小时课程(28 赞,18 收藏)、第二门 4 小时课程(3 赞,10 收藏),以及两门 2 小时课程。

讨论要点: Antigravity 悖论进一步加深。Google 以极快的速度发布功能(一周 8 款产品),产出数小时的教育内容,但信任问题——无解释、无救济地封禁用户——直接削弱了采用率。GergelyOrosz 的帖子串明确展示了后果:"开发者耸耸肩,回去用 Claude Code 和 Codex 了。"

与前日对比: 昨天 Antigravity 的叙事是"产生最多教育内容的同时也在驱使高级用户转向 Windsurf"。今天问题升级了:一位高知名度的科技记者(113 赞)记录了一名付费客户在两个不相关的 Google 产品上被封禁且无法申诉。信任赤字如今已成为有据可查的流失驱动因素。

1.4 OpenAI 全球宕机:ChatGPT 和 Codex 同时不可用,状态页面沉默 🡕¶

一次重大 OpenAI 宕机同时影响了 ChatGPT 和 Codex。@paul_cal 记录了这一脱节(12 赞,1,263 浏览):"ChatGPT 和 Codex 挂了。OpenAI 状态页面显示今日 100% 无事故。Twitter 仍然是最好的宕机检测应用。"

@rehan_hyperion 询问(16 赞,1,764 浏览):"ChatGPT 是不是挂了????"@CryptoNewsHntrs 确认(7 赞,589 浏览)这是一次"全球性重大宕机",影响了 ChatGPT 网页版、应用、API 和 Codex。@HashNuke 展示(0 赞,48 浏览)宕机同时影响了 Codex CLI(403 Forbidden)和桌面应用(重连循环),并附上了标注 OpenCode 与 Codex 流量的使用量分布图。

@altArtist7 批评(1 赞,22 浏览)了沟通的缺失:"ChatGPT 和 Codex 宕机了,而 OpenAI 和 Sam Altman 表现得好像什么都没发生——甚至连在 X 上发个说明都没有?"

讨论要点: 此次宕机加剧了定价动荡的影响。对速率限制变更感到沮丧的用户同时被完全锁在了服务之外。状态页面的矛盾——在全球性宕机期间显示"无事故"——进一步侵蚀了对 OpenAI 运营透明度的信任。

与前日对比: 4 月 19 日没有报告过宕机。今天的事件发生在一个特别糟糕的时间点:就在 GitHub 以可靠性为由宣布暂停 Copilot 注册的同一天,OpenAI 自己的服务也宕机了。这在观感上强化了 AI 基础设施正在承受需求压力的叙事。

1.5 Anthropic 的 Claude Code 工作坊走红 🡕¶

Anthropic Coding Agents 研究团队负责人的一场 30 分钟工作坊产生了四篇独立的高分帖子。@RoundtableSpace 发帖(28 赞,27 收藏,13,105 浏览):"CLAUDE CODE 创造者的这场 30 分钟工作坊,比 100 个 YouTube 教程教你更多关于 vibe coding 的知识。"@Ronycoder 附和(6 赞,6 收藏,133 浏览):"与其看一小时 Netflix,不如看这场 30 分钟的演讲。"@de1lymoon 评价(10 赞,9 收藏,123 浏览)"比 100 门付费课程更有价值。"@goyalshaliniuk 补充(8 赞,3 收藏,79 浏览):"这个视频将永远改变你使用 Claude 的方式。"

这些帖子的综合收藏率值得关注:13,470 总浏览中有 45 次收藏(0.33%)。RoundtableSpace 的帖子单独获得了 0.21% 的收藏率,27 次收藏,表明强烈的参考保存意图。

讨论要点: @themccodes 的回复道出了情绪核心:"真正构建它的人讲 30 分钟 > 3 小时的'嗨各位欢迎回到我的频道'。"对权威一手内容的偏好优于衍生教程内容,这是一个反复出现的信号。

与前日对比: 昨天的教育内容是关于 Ollama + Copilot CLI 的分步指南。今天模式发生了转变:来自工具创造者本人的 Anthropic 单场工作坊产生的互动量超过了所有教程内容的总和。来源的权威性比制作质量更重要。

1.6 Vibe Coding 反弹加剧,行业框架浮现 🡕¶

Vibe coding 的反弹从零散的抱怨升级为结构化的行业回应。@nixcraft 直接否定(11 赞,954 浏览):"vibe coding 和几乎所有 AI 工具都是炒作垃圾。所以没有编码或工程技能的人写不出代码,我一点都不意外。"他引用的是 @CtrlAltDwayne 的观察:"vibe coder 们开始放弃了,因为他们发现 AI 不能替你做所有事。"

@thoughtworks 发布(3 赞,3 收藏,214 浏览)了《Beyond Vibe Coding: The Five Building Blocks of AI-Native Engineering》,认为 2026 年的生产级软件需要的是编排,而非提示词。文章定义了五大支柱:结构化提示词、CI/CD 集成、测试驱动 AI、版本控制审计追踪和人工监督。它引用了 BMAD Method 和 GitHub 的 SpecKit 作为开放式提示的具体替代方案。

@ThePracticalDev 分享(1 赞,2 收藏,424 浏览)了一位开发者使用 BMAD 的经验:"Vibe coding 以牺牲理解为代价优化输出。这位开发者发现 BMAD 让你保持编排者的角色,而不是乘客。"

@pxue 预测(2 赞,46 浏览):"Vibe coding 将在夏天达到顶峰,然后悄然消亡。"

@Layton_Gott 提供了实用建议(1 赞,12 浏览):"别用 Claude Code 调试了。如果它两次尝试都修不好一个 bug,问题不在 bug 本身,而在你的上下文。关闭会话,开一个新的,只粘贴出错的函数和错误信息。"

讨论要点: 反弹正在分化。一方面,经验丰富的工程师完全否定 vibe coding。另一方面,BMAD 和 SpecKit 等方法论试图在保留 AI 辅助速度的同时增加工程纪律。共同主线是:仅靠非结构化提示词不足以应对生产工作。

与前日对比: 昨天"vibe coding 宿醉"作为新兴的反弹术语被命名。今天它进阶为来自 Thoughtworks 和 BMAD 社区的结构化对策提案。对话正在从"vibe coding 有问题"转向"这是它的替代方案"。

1.7 本地和免费 AI 编程选项持续扩展 🡒¶

免费/本地编程的话题延续了昨天 Ollama + Copilot CLI 突破的势头。@python_spaces 分享了一份分步指南(13 赞,8 收藏,535 浏览),介绍如何使用 Ollama 在本地运行 Copilot CLI:"零 API 成本。100% 本地运行。"

@JulianGoldieSEO 推荐 Gemma 4(10 赞,4 收藏,654 浏览)称其为"一个击败 GitHub Copilot 的免费 AI",可"直接在你自己的笔记本电脑上运行",通过 Ollama 和 Cursor 使用。他另外列出了三条免费使用 Claude Code 的途径(4 赞,5 收藏,108 浏览):通过 Ollama 云模型使用 GLM 5.1、本地运行 Gemma 4,以及通过 OpenRouter 使用 Elephant Alpha。

@hampsonw 发布了 BenchLocal 测试结果(1 赞,95 浏览),显示 Gemma-4-31b-it 在六项基准测试中平均得分 90.17,击败了 GPT-5.4(88.67)、GPT-5.4-mini(86.83)和 Qwen3.6-35B(85.67)。

@llmdevguy 反对(1 赞,84 浏览)昂贵的订阅:"不,别这样做。每月 $1000 太离谱了。不如用 MiniMax 2.7($20/月,每月 180,000 次请求)或 Ollama Cloud(GLM-5.1、M2.7,$20/月)。"

讨论要点: 本地/免费内容出现的时间并非巧合。GitHub 在同一天暂停注册并收紧速率限制,放大了对完全摆脱订阅依赖的替代方案的需求。BenchLocal 数据显示本地模型超越 GPT-5.4,为本地优先的论点提供了量化支撑。

与前日对比: 昨天 Ollama 发布了 Copilot CLI 集成。今天生态系统以指南、基准测试和替代模型推荐作为回应。本地优先选项正在从公告阶段过渡到采用基础设施阶段。

2. 令人困扰的问题¶

GitHub Copilot 无预警降级 — 高¶

@ZakSMorris 反映(4 赞,168 浏览)自己每月支付 39 英镑的 Pro+ 费用,却被"一夜之间降级。使用限额收紧。Opus 4.5 和 4.6 被移除。价格不变。无预警,无调整。"@edandersen 标记(33 赞,5,030 浏览)了组织级预算缺陷。@prashant_hq 在回复中指出:"在今天之前,你可以在 OpenCode 中给 Opus 一个 100 项的任务,它会不断自动压缩并持续工作数小时,而这只消耗 1 次请求。$10 计划给了 300 次。"应对方式:转向本地模型或叠加更便宜的订阅。

Google Antigravity 封禁付费客户且无救济途径 — 高¶

@GergelyOrosz 记录(113 赞,7,380 浏览)了一名付费 Antigravity 客户因使用 CodexBar(一个用量跟踪器)而被封禁,随后发现其 Gemini CLI 访问也被 Antigravity 团队撤销。客服表示他们"无能为力"。该用户放弃并转回了 Claude Code 和 Codex。@cyburke 确认在"Google 搞了 Antigravity 封禁之后"停止使用 Antigravity。应对方式:完全放弃该平台。

OpenAI 宕机且状态页面沉默 — 中¶

@paul_cal 展示(12 赞,1,263 浏览)ChatGPT 和 Codex 宕机的同时 OpenAI 状态页面报告"无事故"。多名用户报告了 CLI、桌面和网页端的 403 Forbidden 错误。@altArtist7 指出:"OpenAI 和 Sam Altman 表现得好像什么都没发生。"应对方式:Twitter 成为事实上的状态页面。

Codex 前端质量差距 — 中¶

@rileybrown(276 赞)、@haider1(18 赞)和 @TeeDevh(3 赞)都指出了同一个差距:Codex 处理后端逻辑表现良好,但与 Claude 相比 UI 产出较差。@haider1 表示:"我基本上还是在用 5.3 codex,因为 gpt-5.4 token 消耗太大。"应对方式:前端工作切换到 Claude/Opus,Codex 仅用于逻辑。

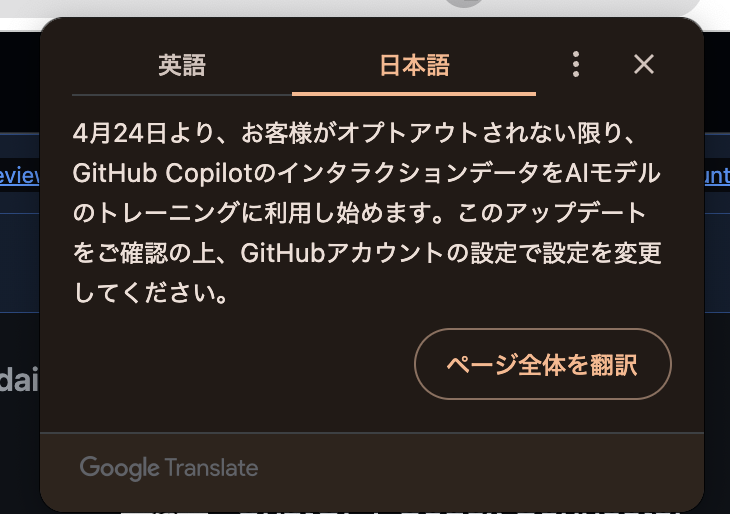

Copilot 交互数据训练的退出截止日期 — 低¶

@zento_ai 发现(3 赞,747 浏览)一则通知:从 4 月 24 日起,GitHub 将使用 Copilot 交互数据进行 AI 模型训练,除非用户选择退出。该截图为日文版,表明它可能出现在本地化设置中,而没有显著的英文公告。

3. 人们期望的功能¶

Codex 设计质量达到 Opus 4.7 水平¶

@rileybrown 阐述了差距(276 赞,8,568 浏览):"如果 OpenAI 发布一个设计能力和 Opus 4.7 一样强的模型,Codex 应用将遥遥领先。"@TeeDevh 直接提问(3 赞,131 浏览):"有没有办法让 Codex 输出好看的 UI?"@haider1 补充(18 赞,1,397 浏览):"我真的希望 OpenAI 在下一个 gpt-5.x 版本中提升前端质量,这样我就不用切换到其他模型了。"需求信号清晰且量大:后端能力很强,前端/设计是阻塞性差距。

Copilot 企业版的项目级预算控制¶

@edandersen 指出(33 赞,5,030 浏览)了问题:"你无法为特定项目的部分用户分配额度。"仅支持组织级别的预算分配意味着一个开发者就能耗尽整个公司的高级请求预算。5,030 浏览和 4 次收藏表明这引起了企业买家的共鸣。

移动端 Codex 客户端¶

@gpsamson 构建了 Flodex(1 赞,22 浏览),因为"Codex 还不支持移动端控制"。该应用通过 Tailscale 连接到 Codex 服务器,展示了一个用于在移动端管理线程的任务列表界面。用户自行构建移动客户端这一事实本身就表明了未被满足的需求。

Codex 的仓库级记忆¶

@RatulSarna 在 Chronicle 公告的帖子串中提问:"你们是否考虑过仓库级记忆?为什么选择了全局模式?"Chronicle 目前的实现是全局存储记忆;项目级上下文将允许为不同代码库设置不同的记忆集。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| OpenAI Codex | 智能体平台 | (+) | 桌面应用被赞为"第一名智能体工程"体验(评分 1182.2);Chronicle 新增屏幕上下文记忆;$100 计划用量合理 | 前端/设计质量不及 Opus;4 月 20 日全球宕机;GPT-5.4"token 消耗太大" |

| GitHub Copilot | 云端 IDE 智能体 | (+/-) | 需求巨大(注册已暂停);Pro+ 5 倍限额;组织计划仍可用 | 注册暂停;Opus 从 Pro 移除;Opus 4.7 仅支持中等思考模式;组织预算不够细化;4 月 24 日训练数据退出 |

| Claude Code | 终端智能体 | (+) | 创造者工作坊走红(13K+ 浏览);数据集中 25 次提及;在 AGI House 算法发现中使用 | 无移动端支持;订阅复杂度未变 |

| Google Antigravity | IDE | (-) | 一周 8 款产品发布;10+ 小时课程内容 | 付费客户被封禁且无救济途径;客服"无能为力";通过 Gemini CLI 的跨产品封禁 |

| OpenCode | 开源终端智能体 | (+) | Cloudflare 用其构建了 CI 原生代码审查工具;主题配置有文档 | K2.6 模型质量被评为"垃圾";/theme 命令有 bug |

| Ollama | 本地模型服务器 | (+) | 昨天的 Copilot CLI 集成持续传播;零成本本地智能体运行 | 仍在被发现阶段;需要教程引导 |

| Gemma 4 (31b-it) | 本地模型 | (+) | BenchLocal:平均 90.17,击败 GPT-5.4(88.67);可在笔记本电脑本地运行 | 并非在所有测试集上验证过;需要 Ollama 环境 |

| Cursor | IDE | (+) | 仍被部分用户视为日常主力,"犯蠢错误更少" | 被认为是"LLM 包装器",独特差异化有限 |

| BMAD Method | 规范驱动框架 | (+) | 获得 Thoughtworks 背书;防止"智能体反复折腾";多角色编排 | 较新;采用深度未知 |

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| Chronicle | @embirico (OpenAI) | 通过定期截屏为 Codex 上下文构建记忆 | 每次会话都需重述上下文 | macOS, Codex, GPT-5.4 | 研究预览(仅限 Pro) | 公告 |

| Flodex | @gpsamson | 通过 Tailscale 连接的 Codex 移动客户端 | 没有原生移动端 Codex 控制 | iOS, Tailscale, Codex API | Alpha(个人使用) | 帖子 |

| Agent Arcade | @DanWahlin | 在智能体工作时运行的复古街机游戏覆盖层 | 等待智能体时的空闲时间 | Tauri, Phaser, TypeScript, Copilot CLI | 已发布(开源) | 帖子, 仓库 |

| Mission Control v2.0 | @nyk_builderz | 带可观测性、记忆图谱和安全功能的智能体运维平台 | 协调多个 AI 智能体 | OpenCode, Hermes, Claude, Codex | 已发布(4.2k stars, 726 forks) | 帖子 |

| Plannotator 0.18.0 | @plannotator | 带智能体支持的标注/计划审查工具 | 与智能体协作进行代码审查 | Cloudflare, OpenCode | 已发布 | 帖子 |

| Polymarket 分析 | @RetroChainer | 4 亿笔交易分析与蒙特卡洛模拟 | 预测市场的优势发现 | Mac Mini, Claude Code, XGBoost | 已发布(个人) | 帖子 |

| NBA 博彩模型 | @RetroChainer | 结合 nba_api、Polymarket、DraftKings 的 XGBoost 模型 | 从数据差异中发现体育博彩优势 | Mac Mini, Claude Code, XGBoost | 已发布(个人) | 帖子 |

| CI 原生代码审查工具 | @Cloudflare | 集成到 CI 流水线的 AI 代码审查工具 | 人工代码审查瓶颈 | OpenCode | 已发布 | 帖子 |

| OmniSwap | @DefiHimanshu | DEX 聚合器,获取最佳兑换率 | DeFi 流动性碎片化 | 黑客松项目 | Alpha(黑客松获奖) | 帖子 |

| Local Hive | @TODIofBaltomore | 农场到餐桌的配送应用 | UI/UX 设计师通过 AI 跨界开发 | Figma, Codex | 设计阶段 | 帖子 |

6. 新动态与亮点¶

OpenAI Chronicle:Codex 的屏幕上下文记忆¶

@embirico(OpenAI)发布(90 赞,4,124 浏览)Chronicle 作为 macOS 上 Pro 订阅者的研究预览。它定期截屏并构建基于 markdown 的记忆,使 Codex 能够了解你一直在做的工作而无需重述上下文。@Techmeme 进行了报道(10 赞,1,697 浏览)。隐私功能为选择加入,并附有明确警告。这是编程智能体中首个重要的环境上下文功能。

GitHub 暂停所有个人 Copilot 注册¶

@GHchangelog 宣布暂停新的 Pro、Pro+ 和 Student 注册,收紧使用限额,并从 Pro 层级移除 Opus 模型。@edzitron 的报道补充称,内部文件显示自一月以来 Copilot 周成本翻倍,token 计费计划于 2026 年晚些时候推出。

Cloudflare 使用 OpenCode 构建 CI 原生代码审查工具¶

@Cloudflare 分享(26 赞,20 收藏,2,079 浏览)了他们如何使用 OpenCode 构建 CI 原生 AI 代码审查工具,帮助工程师"发布更好、更安全的代码"。20 次收藏相对于浏览量(0.96% 收藏率)表明从业者兴趣浓厚。这是首个有文档记录的使用 OpenCode 的企业 CI 集成。

BenchLocal:本地 Gemma-4 击败 GPT-5.4¶

@hampsonw 发布(1 赞,95 浏览)BenchLocal 测试结果,显示 Gemma-4-31b-it 在六项基准测试中平均得分 90.17,超越 GPT-5.4(88.67)。各项基准分解显示 Gemma-4 在 bugfind(93 vs 95)、dataextract(90 vs 86)和 instructfollow(97 vs 99)类别中获胜。互动量低但信号价值高,证明了本地优先方案的可行性。

Copilot 交互数据训练于 4 月 24 日开始¶

@zento_ai 发现(3 赞,747 浏览)一则 GitHub 通知:除非用户选择退出,否则从 4 月 24 日起 Copilot 交互数据将被用于 AI 模型训练。该通知以日语本地化形式出现,表明它可能尚未获得显著的英语报道。

Claude Code 智能体在算法发现方面接近最优水平¶

@0x_Asuka 报道(8 赞,70 浏览)了一场 AGI House 活动:27 个 Claude Code 智能体在 30 秒内产出了与最优水平相差不到 3% 的车辆路径问题算法。被称为"该领域第一研究者"的 @vidalthi 在观看智能体"在大约 4 小时内重新发现 30 年的 VRP 文献"后"感到惊叹"。

7. 机会在哪里¶

[+++] 订阅成本优化层 — 自一月以来 GitHub Copilot 成本翻倍(@edzitron,文章)。注册已暂停。token 计费即将到来。@thisisjonc 显示 $100/月计划每周仅使用 10%。@llmdevguy 列出了 $20/月的替代方案。一款能监控 Copilot、Claude 和 Codex 订阅的实际 token 消耗、推荐最优计划分配、并自动将请求路由至最低成本的合格模型的工具,将满足一个结构性的、不断增长的需求——随着补贴定价的终结,这一需求将更加迫切。

[+++] 企业 AI 编程预算细化 — @edandersen 指出(33 赞,5,030 浏览)Copilot 高级请求预算仅支持组织级别,无法按用户或项目分配。随着 token 计费的临近,企业需要部门级、项目级和用户级的预算控制及告警。GitHub 目前不提供此功能。一个第三方 AI 编程工具预算治理层将填补这一空白,而随着按用量计费成为标准,这一空白只会越来越大。

[++] 编程智能体的环境上下文 — Chronicle(@embirico,帖子)仅限 Pro、仅限 macOS、仅限 Codex。一个跨平台、跨智能体的环境上下文层——捕获屏幕状态、终端输出和浏览器活动以供 Claude Code、Codex 和 OpenCode 使用——将在不锁定供应商的前提下解决同样的"不再重述上下文"问题。@RatulSarna 关于仓库级记忆的提问表明企业对作用域上下文有需求。

[++] 移动优先的 Codex/智能体客户端 — @gpsamson 构建了 Flodex 作为个人解决方案,因为 Codex 没有移动端支持。一款精心打造的移动客户端,用于跨 Codex、Claude Code 和 OpenCode 管理智能体会话——查看进度、审批变更、管理队列——将服务于日益增长的离开工位后仍需监控长时间运行的智能体任务的开发者群体。

[+] 规范驱动的 AI 开发工具 — Thoughtworks 发布了一套"AI 原生工程"框架,用结构化的规范到代码流水线取代 vibe coding。BMAD Method 和 GitHub SpecKit 被引用但仍处于早期阶段。让规范驱动的 AI 开发像 vibe coding 一样简单的工具——从对话自动生成规范、维护规范与代码的可追溯性、标记偏差——将吸引越来越多认为 vibe coding 不足以应对生产工作的用户。

8. 要点总结¶

-

GitHub Copilot 的定价剧变是当天决定性的政策事件。 Microsoft 暂停了所有个人注册、收紧了速率限制、从 Pro 移除了 Opus,并计划推出 token 计费,因为自一月以来周成本已翻倍。这是补贴式 AI 编程即将终结的最明确信号。(@edzitron,独家;@GHchangelog 经 @chribjel,帖子)

-

Codex 桌面应用获得史上最高评价,同时发布环境上下文功能。 以 1182.2 的评分和 20,128 浏览,@0xSero 的推荐是当天互动量最高帖子的 3 倍。与此同时,Chronicle 新增了屏幕上下文记忆——这是主流编程智能体中首个环境上下文功能。产品正在从被提示的工具加速演进为主动观察的助手。(@0xSero,帖子;@embirico,帖子)

-

Google Antigravity 的客户信任问题已成为有据可查的流失驱动因素。 一名付费客户在两个不相关的 Google 产品上被封禁,客服承认"无能为力"。后果很明确:"开发者耸耸肩,回去用 Claude Code 和 Codex 了。"Google 的发布速度(一周 8 款产品)无法弥补主动驱赶付费用户的损失。(@GergelyOrosz,帖子)

-

OpenAI 宕机在最糟糕的时刻暴露了状态页面的不可靠性。 ChatGPT 和 Codex 在 GitHub 以可靠性为由暂停 Copilot 注册的同一天全球宕机。OpenAI 状态页面在宕机期间显示"无事故"。对运营透明度的信任在 Microsoft 和 OpenAI 两侧同时受损。(@paul_cal,帖子)

-

本地模型基准测试显示已具备与云端模型的量化对等性。 BenchLocal 结果显示 Gemma-4-31b-it(90.17)在六项编程基准测试中超越 GPT-5.4(88.67)。结合昨天的 Ollama + Copilot CLI 集成和今天的定价剧变,本地优先选项正从小众走向结构性优势。(@hampsonw,帖子)

-

Vibe coding 的反弹正从抱怨升级为竞争性框架。 Thoughtworks 发布了"AI 原生工程"的五大支柱框架。BMAD Method 正在获得背书。对话已从"vibe coding 有问题"转向"这些是结构化的替代方案"。这表明该实践已足够成熟,开始产生自己的反对文献。(@thoughtworks,帖子;@ThePracticalDev,帖子)

-

Anthropic 的内容策略通过直达源头击败了所有竞争者。 Claude Code 创造者的一场 30 分钟工作坊产生的综合互动量(13K+ 浏览,45 收藏)超过了数小时的第三方教程。对权威一手内容的偏好优于衍生教程内容,这是一个清晰的、反复出现的模式。(@RoundtableSpace,帖子)