Twitter AI Coding -- 2026-04-24¶

1. 人们在讨论什么¶

1.1 GPT-5.5首日采用浪潮重塑工具偏好 🡕¶

GPT-5.5发布次日,话题从基准测试转向了实际采用。@satyanadella 宣布(292赞,11,332次浏览,32次收藏)该模型已在GitHub Copilot、M365 Copilot、Copilot Studio和Foundry中全面上线:"凭借更深层的推理能力、更强的多步执行和在长篇复杂任务上的更优表现,GPT-5.5帮助你更快地从想法走向执行,减少迭代次数。"在后续讨论串中,Nadella描述了Copilot CLI中的多模型工作流:"用更快的模型来搭建脚手架和快速探索,用深度推理模型来规划,然后GPT-5.5可以接过这个计划并将其转化为可运行的代码。"他还提到了一个"Rubber Duck智能体"——一个多模型反思循环,GPT-5.5审查另一个模型的输出,反之亦然。

@code 确认(47赞,3,911次浏览)GPT-5.5已在VS Code中可用,并引用了@github的公告:"我们的早期测试表明,它在复杂的智能体化编程任务中表现最为出色。"评论区对定价反应不一:@dbdnvikas指出"Opus和5.5都是7.5倍?拜拜,我直接用Codex",@alex_smmr则说"7.5倍简直是开玩笑。"

@mckaywrigley 发布了一篇详细的从业者评估(12赞,709次浏览,11次收藏),捕捉到了格局的变化:"在代码方面,我在不到3个月内从80/20的Claude/GPT比例变成了80/20的GPT/Claude比例。"他称GPT-5.5"令人难以置信",并表示"如果现在只能选一个模型,我会选这个。"但他也指出Opus 4.7"充其量是原地踏步",而且"Anthropic必须解决算力问题,作为用户你能明显感受到。"他将编程工具分为:Codex和Claude Code第一梯队,Cursor第二梯队,并表示他本月卸载了Cursor,回归VS Code。

@Colewherld 表达了新用户的兴奋(25赞,225次浏览):"兄弟为什么没人早点告诉我Codex?刚开始用就觉得比Claude Code好了不止一个档次。5.5新模型在Codex里简直太强了。"@zaheerain回复问"真有这么简单?",Colewherld则补充道:"AI的效果取决于使用它的人。"

讨论要点: GPT-5.5在Copilot中的7.5倍token乘数遭到多位用户的反对。以这个倍率计算,20美元的Codex方案比通过Copilot使用GPT-5.5更具吸引力,形成了一个有利于Codex采用的定价套利空间。@JakeKAllDay指出"GPT-5.5比5.4 Mini High更便宜(而且更快),即使在20美元/月的方案上,它的可用性也大幅提升了。"

与前日对比: 4月23日,GPT-5.5带着基准测试数据发布(Senior Engineer基准测试62/100)。今天叙事转向了从业者偏好数据:mckaywrigley的80/20翻转、Colewherld从Claude Code的迁移,以及Kappaemme1926取消Claude订阅。这个模型不再处于评估阶段——它正在被采用。

1.2 DeepSeek V4登场;OpenCode成为默认测试平台 🡕¶

@opencode 宣布(116赞,2,376次浏览,22次收藏)集成DeepSeek V4:"立即在OpenCode中体验DeepSeek V4。1. /connect连接DeepSeek提供商。2. 在platform.deepseek.com获取密钥。3. 选择DeepSeek-V4-Pro。"评论区立刻要求Go版本:@Shawnw3i说"不……我们需要它在OpenCode Go里",@noctus91和@alomorfYT也表达了相同诉求。

@rileybrown 提问(28赞,4,998次浏览):"测试新DeepSeek模型的最佳方式是什么?OpenCode?"14条回复确认OpenCode是默认选择:@ZagZino说"老实说直接用OpenCode就行,他们在最新更新中已经加入了V4 Pro和Flash",而@nishancodes则建议"最便宜的方式——OpenCode / OpenRouter。最佳方式——在vast或Runpod上租GPU。"

@mehulmpt 设置了四方对比测试(36赞,1,820次浏览,8次收藏):"我在一个真实代码库中用DeepSeek V4 Pro(OpenCode)、Kimi K2.6(OpenCode)、Opus 4.7 Max(Claude Code)和GPT-5.5(Codex)完成了一个25分钟的任务。结果很有趣,视频即将发布。"这是首次将DeepSeek V4与三大西方前沿模型进行正面对比。

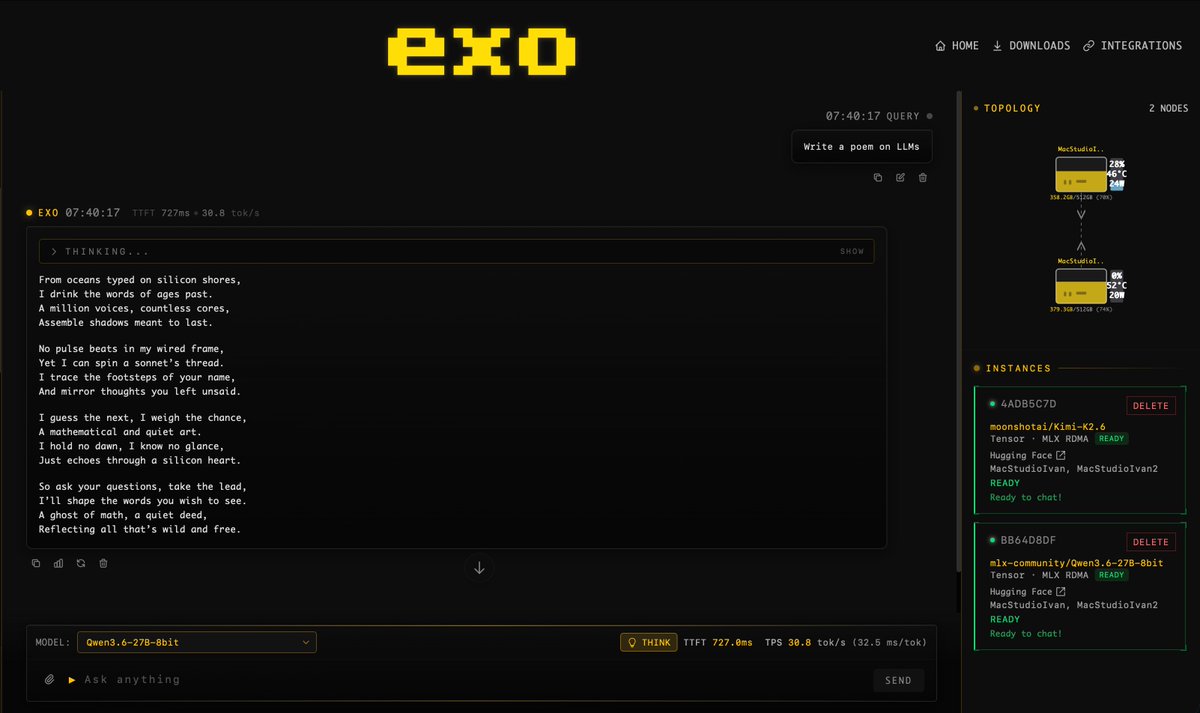

@ivanfioravanti 展示了(13赞,504次浏览)在两台M3 Ultra 512GB机器上使用EXO v1.0.71进行本地推理:"Qwen3.6-27B-8bit 30 tps,Kimi-K2.6 4bit 20 tps。"截图显示两台Mac Studio通过MLX RDMA连接,同时在EXO chat和OpenCode中运行模型。

讨论要点: OpenCode已巩固了其作为新模型中立测试平台的地位。当一个模型发布(DeepSeek V4、Kimi K2.6、Qwen 3.6),第一个问题现在是"OpenCode支持了吗?"而不是"哪个IDE支持它?"

与前日对比: 4月23日,OpenCode正在吸引以每天5-7美元成本从Claude Code迁移的用户。今天它新增了DeepSeek V4支持,社区将其视为任何新模型发布的默认评估工具。开源智能体层正在成为AI编程工具界的"瑞士"。

1.3 20美元的抉择:用户众筹讨论哪个工具值得花钱 🡒¶

@Bhavani_00007 提出了一个问题(42赞,1,987次浏览),精准捕捉了市场碎片化焦虑:"我准备投资20美元,该选哪个?Claude、Codex、Cursor、Antigravity、GitHub Copilot,哪个现在最值?"41条回复反映了真正的困惑。@molaerga推荐Cursor:"我用20美元方案每天都在构建,做了多个应用,从来没有达到限额。"@explorersofai则反驳:"如果你是认真的,就投200而不是20。"

@Kappaemme1926 用行动回答了这个问题(48赞,2,577次浏览):"从没这么高兴地取消过一个订阅。时间越久,我越觉得这是正确的决定。感谢OpenAI。Codex完全是另一个层级。"附图显示了Claude Pro的取消订阅邮件。

@0xSero 给出了排名(33赞,2,022次浏览):"Anthropic这个UI做得太好了,比上个版本好太多。很有竞争力,但Codex更好。所以应用排名是:Codex、Cursor、Claude、Droid,然后OpenCode和t3code并列。"@julythirt33n回复指出了矛盾:"没错,Codex牢牢抓住了我,虽然我也想用factory或OpenCode这样的应用。"

@lunardragon420 寻求具体的切换建议(4赞,467次浏览):"我在用Claude Code配合GLM模型。你推荐切换到Codex吗?听说OpenCode也很好,你怎么看?"

讨论要点: Bhavani_00007帖子的41条回复未能达成共识。Cursor、Codex和Claude Code各有拥护者。这反映了一个在20美元价位上没有单一工具占据主导地位的市场,而且切换成本足够低,用户每周都在工具之间流转。

与前日对比: 4月23日,工具对比由基准测试数据驱动(danshipper给GPT-5.5的评分为62/100)。今天则由消费级预算决策和订阅取消驱动。受众已从高级用户扩展到评估性价比的主流采用者。

1.4 Vibe Coding到处撞上速率限制 🡕¶

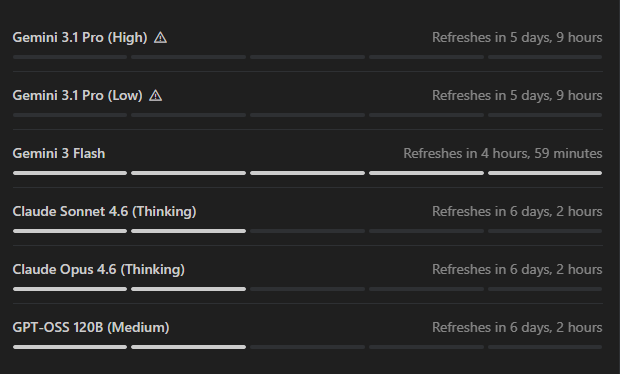

@notjazii 记录了这种挫败感(134赞,1,428次浏览),定义了当天的算力主题:"昨天刚开始vibe coding,就已经用完了Antigravity的周限额。我可是Google Pro用户,他们说Antigravity比Claude限额更多,所以我选了它,现在得等整整五天?"附图显示了Gemini 3.1 Pro(5天9小时刷新)、Claude Sonnet 4.6和Opus 4.6 Thinking(6天2小时)的配额全部耗尽,只有Gemini 3 Flash在5小时内刷新。

@vaultmkr回复道:"Antigravity就是垃圾,别浪费时间。如果你想花20美元做vibe coding又不想被配额限制困扰,就用Codex。我基本感觉不到限额问题。"

@MilkRoadAI 将此与宏观图景联系起来(7赞,1,421次浏览):"Anthropic刚刚不得不降低Claude的思考深度并对付费用户设置使用上限。开发者正在转向OpenAI Codex。"该讨论串详细说明Anthropic的收入在一个季度内增长了两倍,达到300亿美元年化收入,但"一个运行AI智能体的开发者可能在几分钟内就耗尽一整天的算力。"2026年超大规模云厂商合计约7000亿美元的AI资本支出"仍不足以满足需求。"

@edzitron 在Times Tech Report上做了背景分析(17赞,2,816次浏览),涵盖了"GitHub Copilot转向token计费、Anthropic虚高的二级市场估值,以及补贴AI时代即将终结。"

讨论要点: notjazii的帖子(90条回复,数据集中最高回复数)暴露了一位新用户在36小时的游戏开发中耗尽速率限制。这就是vibe coding的采用模式:充满热情的新手在第一个周末就发现了硬性算力天花板。

与前日对比: 4月23日,算力故事是GitHub暂停Copilot Business注册和Codex出现重连循环。今天约束范围扩大到Antigravity(数天的刷新计时器)和Anthropic(限制思考深度、高峰时段设限)。每个主要提供商现在都在明显地配给算力。

1.5 对抗式多模型工作流作为实践涌现 🡕¶

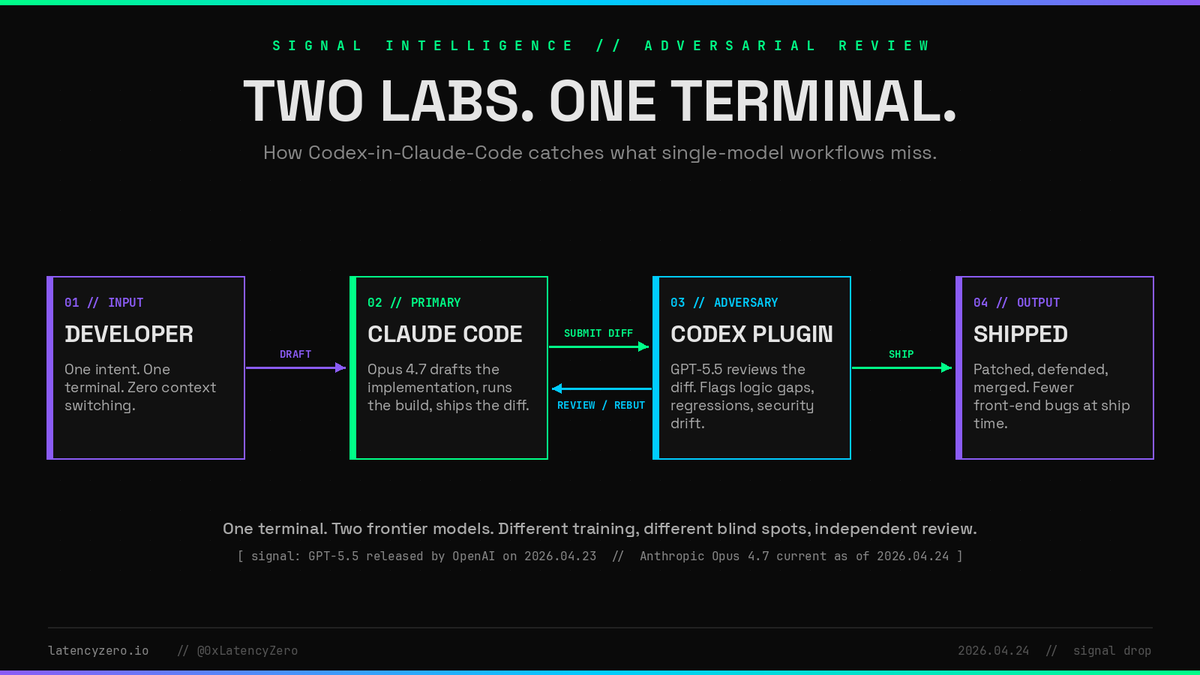

@0xLatencyZero 发布了一个工作流图(1赞,137次浏览,2次收藏),展示"对抗式审查"——使用Claude Code中的Opus 4.7起草实现,然后用Codex插件中的GPT-5.5审查差异:"两个前沿模型。不同的训练数据,不同的盲点,独立审查。"流程为:开发者将意图发送给Claude Code,由其起草和构建;差异发送到Codex,由其标记逻辑漏洞、回归问题和安全偏移;审查后的代码投入生产。

@mr_the_dooom 描述了类似的模式(0赞,27次浏览):"把Claude纯粹当作管理者、架构师和文档维护者,让Codex作为被Claude驱动的代码工人。这种平衡不知怎么产出惊人,而且token消耗非常少。"

Nadella的讨论串在平台层面强化了这一点,描述了"Rubber Duck智能体",其中"GPT-5.5可以审查另一个模型的输出,反之亦然。"

讨论要点: 对抗式多模型审查正在从自上而下(Nadella将其描述为平台功能)和自下而上(从业者独立发现)两个方向涌现。共同的洞察是:来自不同实验室的模型有不同的失败模式,因此跨实验室审查能捕获同模型审查遗漏的bug。

与前日对比: 4月23日,工具质量被认为比模型选择更重要(kylejeong展示了同一模型不同输出)。今天这一模式扩展到了有意的多模型管线,不同实验室的模型扮演互补角色:一个起草,另一个审查。

1.6 Google Antigravity:课程内容涌入时间线,心智份额停滞 🡒¶

@JulianGoldieSEO当天发布了四个独立的Antigravity课程视频:一个2小时课程(11赞,506次浏览,15次收藏),一个4小时课程(13赞,582次浏览,8次收藏),以及两次额外转发。@heyDhavall 发布了一个4小时版本(23赞,1,612次浏览,14次收藏):"今晚别看Netflix了,来看这个4小时的Google Antigravity完整课程。"@geeksforgeeks 推广了(9赞,344次浏览)一个免费工作坊:"了解Antigravity和AI智能体的工作原理。在指导下构建自己的AI智能体。使用免费额度部署到Google Cloud。"

然而从业者信号依然微弱。@Fabiobuilds 评估道(6赞,1,094次浏览):"Google在小型/本地模型(Gemma、Flash、Flash Lite)上投入很大,表现也不错。但在3.1 Pro上的投入非常有限(到底有没有人在Antigravity上写代码?)。"@mckaywrigley 写道:"Gemini……?看起来这已经是连续2-3个模型了,模型发布时看起来很棒,然后就再也没人用了。"

@crawler_gill 是一个正面的例外(12赞,290次浏览):"正在用DataForSEO API + Google Antigravity构建一个迷你Ahrefs风格的仪表盘——想想一年前我连想都不敢想能做这件事。不用写代码,但仍然能构建我需要的工具。"

讨论要点: Antigravity教育内容的数量(单个创作者一天内发布6+课程帖子)表明这是SEO驱动的内容策略,而非有机的从业者热情。实际的编程社区仍持怀疑态度:可用教程与实际采用之间的差距在扩大。

与前日对比: 4月23日,Antigravity的故事是木马化下载和"你们还记得吗"式的帖子。今天的叙事类似:丰富的教育内容与平淡的从业者采用并存。crawler_gill的SEO仪表盘是唯一使用Antigravity的新实际构建。

1.7 Copilot SDK v0.3.0和JetBrains智能体模式发布 🡕¶

@GHCopilotCLILog 宣布(24赞,1,231次浏览)Copilot SDK v0.3.0包含40项功能和增强。关键能力包括:支持每个会话独立GitHub认证以便会话携带不同身份,通过defaultAgent.excludedTools实现每个智能体的工具可见性控制以支持带子智能体委派的编排模式,自定义智能体声明skills: string[]以注入特定技能,以及通过消息增量事件中的agentId实现子智能体流式传输以支持精细的UI过滤。会话不再默认30分钟超时,技能严格采用选择加入机制以防止从父智能体意外继承。

@GHchangelog 发布了(12赞,1,235次浏览)JetBrains内联智能体模式公开预览版,包含增强的Next Edit Suggestions和"新的全局加细粒度终端命令和文件编辑自动批准控制。"

讨论要点: SDK发布表明Copilot正在向其智能体平台的接近最终GA状态迈进。每会话身份和子智能体委派功能实现了与从业者社区涌现的对抗式工作流相呼应的多智能体编排模式。

与前日对比: 4月23日,Copilot的故事是关于暂停注册和token计费。今天平台基础设施在进步:SDK v0.3.0和JetBrains智能体模式表明GitHub在限制新客户入驻的同时正在构建智能体平台层。

2. 令人困扰的问题¶

所有提供商的Vibe Coding速率限制 -- High¶

@notjazii 在36小时的vibe coding游戏开发后用完了周限额(134赞,90条回复),尽管拥有Google Pro。截图显示Gemini 3.1 Pro、Claude Sonnet 4.6和Opus 4.6的刷新计时器长达5-6天。@vaultmkr称Antigravity的vibe coding限额"就是垃圾"。@MilkRoadAI 报道Anthropic降低了Claude的默认思考模式并引入高峰时段限制。@nixxin 报告:"我在Codex和Claude Code上都反复遇到速率限制。"这已不再是单一提供商的问题;每个主要平台都在明显地配给算力。

GPT-5.5 Token乘数使Copilot变得昂贵 -- Medium¶

@dbdnvikas 对Copilot中GPT-5.5的7.5倍乘数表示反对:"Opus和5.5都是7.5倍?拜拜,我直接用Codex。"@alex_smmr说"7.5倍简直是开玩笑。"@aias_0警告:"版本升级无法解决上下文限制。应该先跟踪大型仓库上的自动补全延迟。"该乘数造成了价格落差:通过Copilot使用GPT-5.5会快速消耗月度token预算,而通过20美元/月的Codex使用同一模型则有更宽裕的限额。

Codex CLI标记安全研究人员 -- Medium¶

@offsec97 展示了(0赞,16次浏览)一张Codex CLI截图:"您的账户因潜在的高风险网络活动被标记。在进行额外验证期间,请求可能会变慢。"这发生在经过验证的账户进行合法安全评估工作时,表明安全过滤器需要改进以区分攻防安全研究和恶意使用。

DeepSeek数据隐私担忧被视为有组织的攻击 -- Low¶

@KuittinenPetri 反驳了(38赞,696次浏览)对DeepSeek的批评:"今天X上对DeepSeek的仇恨言论数量惊人。这是有组织有偿的吗?你们觉得Anthropic用Claude Code的提示词和代码追踪数据做了什么?Google用Antigravity呢?OpenAI用Codex呢?当然了,让我们假装它们完全不用这些数据训练。"

3. 人们期望的功能¶

模型无关的20美元方案并配备充足限额¶

@Bhavani_00007的帖子(41条回复)显示用户无法判断哪个20美元订阅提供最佳价值。每个工具在不同任务上各有所长,限流方式也各不相同。需求是一个统一的订阅层,为每种任务类型提供最佳模型的访问权限,并配备透明且可预测的速率限制,而不是迫使用户押注单一提供商。

紧迫性:High。机会:[+++] -- 41条回复未达成共识,表明市场存在结构性空白。

OpenCode Go对新模型的首日支持¶

@Shawnw3i、@noctus91和@alomorfYT在DeepSeek V4公告下的回复都要求OpenCode Go访问而非BYOK。用户希望新模型在托管订阅层中立即可用,而不仅仅是通过API密钥配置。

紧迫性:Medium。机会:[++] -- 跨多次模型发布的持续需求。

安全感知的编程智能体模式¶

@offsec97在合法安全评估中被标记,加上@0xSV1的Damn Vulnerable Startup项目(一个故意存在漏洞的应用,讽刺vibe coding的安全实践),指向了对安全上下文感知智能体模式的需求——能够区分攻防研究和恶意使用,并在部署前标记vibe coding应用中的安全问题。

紧迫性:Medium。机会:[++] -- 随着vibe coding触及非安全意识用户而持续增长。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| OpenAI Codex + GPT-5.5 | 智能体平台 | (+) | 首日采用浪潮;mckaywrigley的编程首选;据JakeKAllDay称比GPT-5.4 Mini High便宜7.5倍;浏览器使用功能支持自主QA已上线 | Copilot中7.5倍乘数消耗token预算;Codex CLI标记安全研究人员 |

| GitHub Copilot | 云端IDE智能体 | (+/-) | GPT-5.5可用;SDK v0.3.0包含40项功能;JetBrains内联智能体模式预览中 | 前沿模型7.5倍乘数;token计费转型进行中 |

| Claude Code | 终端智能体 | (+/-) | 新桌面UI获0xSero好评;Claude Design被mckaywrigley评为A+;更新后的应用"很棒" | 算力限流;高峰时段设限;用户取消Pro订阅 |

| OpenCode | 开源终端智能体 | (+) | 新增DeepSeek V4 Pro支持;新模型的默认测试工具;Honcho长期记忆插件上线 | OpenCode Go对新模型的支持落后于BYOK |

| Google Antigravity | IDE | (-) | crawler_gill构建了功能性SEO仪表盘;大量教育内容可用 | 多天刷新的速率限制计时器;mckaywrigley:"再也没人用了";Fabiobuilds:"到底有没有人在Antigravity上写代码?" |

| Cursor | IDE智能体 | (+/-) | molaerga:"20美元方案每天都在构建,从未达到限额" | mckaywrigley卸载了它;排名第二梯队,落后于Codex和Claude Code;xAI收购带来不确定性 |

| EXO | 本地推理 | (+) | v1.0.71在M3 Ultra上通过MLX RDMA运行Kimi K2.6达20 tps,Qwen3.6-27B达30 tps | 需要高端硬件(展示的是双M3 Ultra 512GB) |

| Copilot SDK v0.3.0 | 智能体框架 | (+) | 每会话认证、每智能体工具可见性、子智能体流式传输、技能选择加入 | 接近最终GA状态;生态系统仍在成熟中 |

4月24日的工具格局由三个梯队定义:Codex和Claude Code作为主导的智能体化平台(Codex势头正增),OpenCode作为开源模型无关层,其余工具争夺存在感。Cursor失去了其最有力的支持者(mckaywrigley卸载了它),Antigravity的速率限制削弱了其教育内容推广的效果。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| Honcho x OpenCode Plugin | @honchodotdev | 为OpenCode会话提供长期记忆 | 智能体在会话间丢失上下文;没有持久记忆层 | OpenCode, Honcho, Bun | Shipped | 公告 |

| andrej-karpathy-skills | forrestchang (GitHub) | 单个CLAUDE.md文件,基于Karpathy的编程观察改进Claude Code行为 | LLM在没有指导的情况下会犯可预测的编程错误 | Claude Code, CLAUDE.md | Shipped(78.5k stars) | 推文 |

| Codex Browser Use | @JamesZmSun (OpenAI) | Codex中的原生浏览器,用于自主前端QA——构建UI、点击交互、监控日志、修复bug | 前端开发中"构建并验证"循环已断裂 | Codex, Vision, Browser | Shipped | 回顾 |

| Damn Vulnerable Startup (DVS) | @0xSV1 | 故意存在漏洞的应用,用于安全教育,灵感来自vibe coding文化 | 没有用于保护AI生成应用的训练场地 | Claude Code | Alpha | 帖子 |

| Adversarial Review Pipeline | @0xLatencyZero | Claude Code起草 + Codex审查差异以发现逻辑漏洞和安全偏移 | 单模型审查因共享训练偏差而遗漏bug | Claude Code (Opus 4.7), Codex (GPT-5.5) | Concept/demo | 帖子 |

| SEO Dashboard | @crawler_gill | 使用DataForSEO API构建的迷你Ahrefs风格仪表盘 | 非程序员无法构建自定义SEO分析工具 | Google Antigravity, DataForSEO API | Working prototype | 帖子 |

| DP Code v0.0.36 | @emanueledpt | 集成GPT-5.5的IDE,以OpenCode为提供商,支持快速模型搜索、编辑消息、LaTeX渲染 | 跨IDE的模型访问碎片化 | OpenCode, GPT-5.5 | Shipped | 帖子 |

| Polymarket Trading Bot | 上海交通大学学生,经@adiix_official | 自动化套利机器人,追踪50+个Polymarket市场并同步Binance BTC数据 | 手动跨市场套利速度太慢 | Claude Code, OpenClaw, Polymarket, Binance | Running in production | 帖子 |

| lambench-pro | @BitcoinBananaBY | 使用Effect TS配合opencode-swarm和GitHub Actions的基准测试运行器 | 缺乏编程模型的标准化实时基准测试 | Effect TS, OpenCode Swarm, GitHub Actions | Alpha | 帖子 |

andrej-karpathy-skills仓库达到78.5k stars值得关注:一个基于Andrej Karpathy对LLM编程陷阱观察而衍生的单个CLAUDE.md文件,已成为智能体编程领域最高星标的提示工程产物。@cgtwts 指出:"有人把Andrej Karpathy的编程洞察整合成一个claude.md文件来修正Claude写代码的方式,已经有78k stars了。"

Codex浏览器使用功能代表了一项重大能力提升:@WesRoth 描述了Codex如何"现在可以自主构建前端界面,然后充当人类QA测试员。它使用视觉能力来'看到'UI,像真实用户一样点击应用,同时监控网络和控制台日志以发现错误。"

6. 新动态与亮点¶

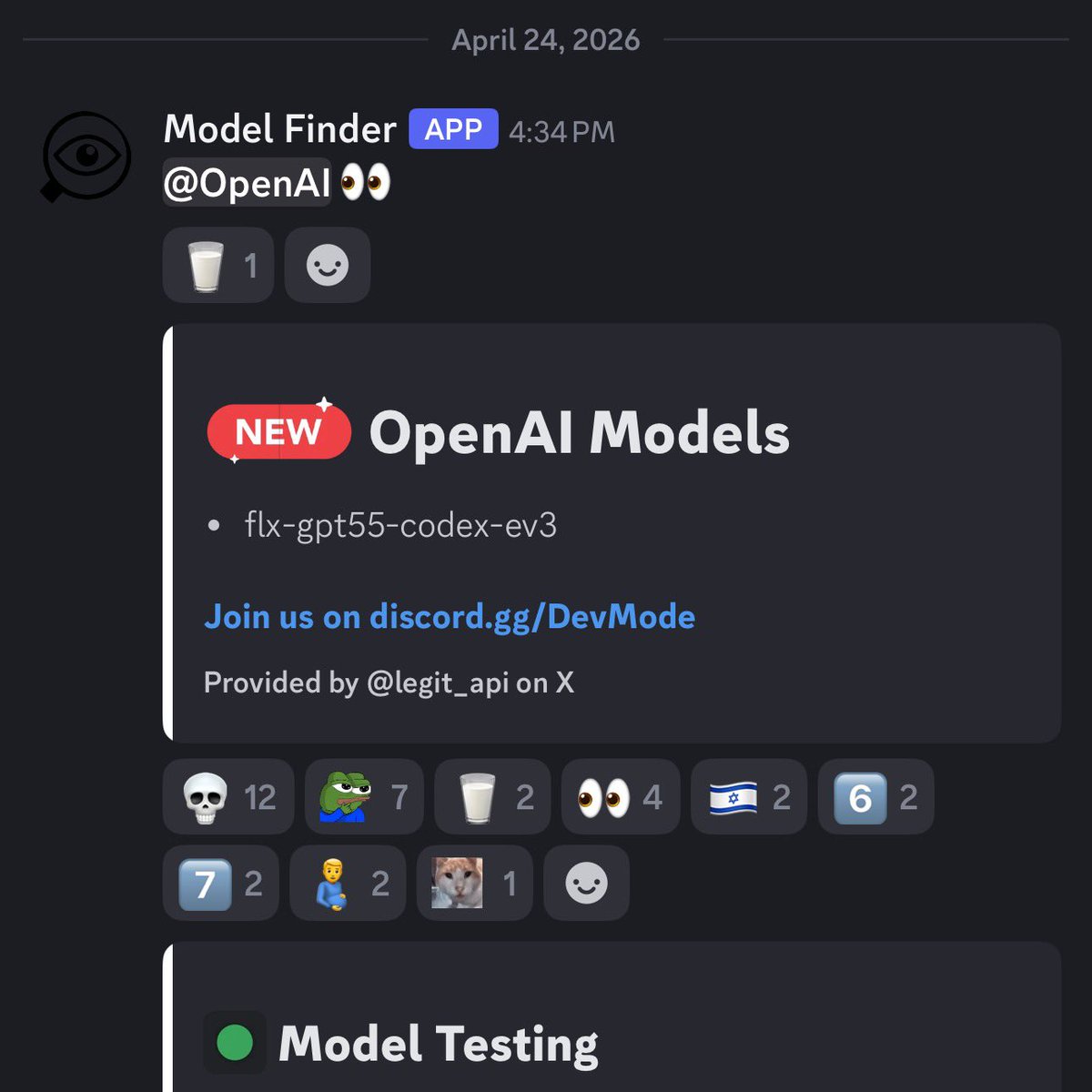

GPT-Codex-5.5模型标识符在野外被发现¶

@testingcatalog 标记了(20赞,289次浏览,2次引用)一个新的模型标识符"flx-gpt55-codex-ev3",由Discord模型发现机器人于4月24日检测到。这表明OpenAI正在测试GPT-5.5的Codex专用变体,可能针对智能体化编程任务进行了超越通用GPT-5.5版本的进一步优化。

垂直AI整合加速¶

@kilocode 观察到(13赞,576次浏览):"OpenAI有Codex,Anthropic有Claude Code,Google有Gemini Code Assist,现在SpaceX有Cursor和xAI。当AI实验室试图拥有编程工具时,让你选择模型的独立层正在不断缩小。"这种垂直整合趋势使模型无关层(OpenCode、Kilo Code)在战略上更加重要,但也更加脆弱。

AI可靠性中断达到每周节奏¶

@NeuronicxAI 记录了(1赞,6次浏览)2026年4月的一系列中断:"4月15日——Anthropic:API + Code宕机7小时。4月20日——OpenAI:ChatGPT + Codex中断,3K+报告。4月24日——Anthropic再次出问题。"各提供商近乎每周的重大中断节奏强化了对多提供商弹性的需求。

Copilot数据训练截止日期已过¶

@jordanicruz 指出(1赞,70次浏览)4月24日是GitHub开始使用Copilot交互数据进行AI模型训练的日期,除非用户已选择退出。这在昨天的报告中被标记为即将到来;今天正式生效。

Anthropic产品团队速度引人关注¶

@hrishikeshhh_ 分享了(2赞,11次浏览)来自Anthropic Claude Code产品负责人的见解:"产品时间线从6个月缩短到1个月,有时甚至缩短到1天。每周发布,否则就会被淘汰。Anthropic招聘具有产品品味的工程师,而非纯粹的专家。"

7. 机会在哪里¶

[+++] 20美元价位的统一模型路由 -- @Bhavani_00007的帖子收到41条回复,对选择哪个20美元工具未达成共识。@mckaywrigley 描述了不同工具在不同任务上的优势。@Kappaemme1926 取消了Claude转向Codex。一个以单一价格将任务路由到跨提供商最具性价比模型的服务——GPT-5.5用于复杂重构,开源模型用于脚手架搭建,Claude用于设计工作——将解决数据集中最常见的问题。

[+++] 多提供商弹性与故障转移 -- @NeuronicxAI 记录了各提供商近乎每周的中断。@notjazii 同时用完了多个Antigravity模型的限额。@MilkRoadAI 确认即使超大规模云厂商合计7000亿美元的资本支出也不够。在中断和速率限制事件期间自动在提供商之间故障转移并保持会话上下文,可以解决所有用户类别共享的基础设施痛点。

[++] 对抗式多模型代码审查 -- @0xLatencyZero 展示了Claude起草/Codex审查的管线。@satyanadella 描述了用于多模型反思的Rubber Duck智能体。@mr_the_dooom 报告Claude作为架构师加Codex作为编码者带来了"惊人的产出但token消耗极少"。将跨实验室对抗式审查变为一键设置而非手动管线的工具,将正式化一个正在涌现的最佳实践。

[++] 智能体记忆与上下文持久化 -- @honchodotdev 发布了(22赞,7次收藏)OpenCode的长期记忆。Copilot SDK v0.3.0新增了可配置的会话空闲超时(之前固定为30分钟)。随着智能体会话延伸到数小时的自主运行,跨会话和工具的持久记忆正从锦上添花变为基础设施。

[+] Vibe Coding安全教育 -- @0xSV1 构建了Damn Vulnerable Startup,一个故意不安全的应用,讽刺vibe coding:"100% AI生成。0%安全审查。无限部署。"随着非技术用户通过vibe coding发布代码,专门为AI生成代码库设计的安全训练和自动扫描工具代表着不断增长的需求。

8. 要点总结¶

-

GPT-5.5的采用正在驱动真实的订阅变更,而不仅是基准测试热潮。 @mckaywrigley 报告在不到三个月内从80/20的Claude/GPT比例翻转为80/20的GPT/Claude比例。@Kappaemme1926 晒出了Claude取消订阅邮件。@Colewherld 称Codex"比Claude Code好了不止一个档次。"次日信号是迁移,而非仅仅是评估。

-

速率限制是所有提供商共同面临的关键用户体验问题。 @notjazii 在36小时内耗尽了Antigravity配额(90条回复,数据集最高)。@MilkRoadAI 报道Anthropic限制了Claude的思考深度。2026年超大规模云厂商合计7000亿美元的资本支出仍无法满足需求。算力短缺是结构性的,而非暂时的。

-

OpenCode已成为评估新模型的中立阵地。 @rileybrown 向4,998人提问"测试新DeepSeek模型的最佳方式是什么?"答案是OpenCode。@mehulmpt 用它进行了四方模型对比。@opencode 在发布后数小时内集成了DeepSeek V4。随着各实验室垂直整合(Codex、Claude Code、Gemini Code Assist、Cursor/xAI),模型无关层变得更加关键。

-

对抗式多模型工作流正在作为生产实践涌现。 @0xLatencyZero 发布了Claude起草/Codex审查的管线。@satyanadella 将多模型反思描述为平台功能。洞察在于:来自不同实验室的模型有互补的盲点,因此跨实验室审查比单模型工作流能捕获更多bug。

-

20美元AI编程工具市场没有明确赢家,用户困惑达到顶峰。 @Bhavani_00007的问题收到41条回复但无共识。Codex、Cursor和Claude Code各自针对不同用例拥有拥护者。这种入门级价位的碎片化为聚合或路由解决方案创造了机会。

-

Copilot智能体平台的成熟速度超出了生态系统的关注。 SDK v0.3.0包含40项功能发布,包括每会话认证、子智能体委派和技能选择加入(@GHCopilotCLILog,发布说明)。JetBrains内联智能体模式进入公开预览(@GHchangelog,公告)。多智能体编排的基础设施正在发布,而大多数关注仍集中在模型对比上。