Twitter AI - 2026-04-21¶

1. 人们在讨论什么¶

1.1 AI 编码智能体在长期代码维护中惨遭失败 (new)¶

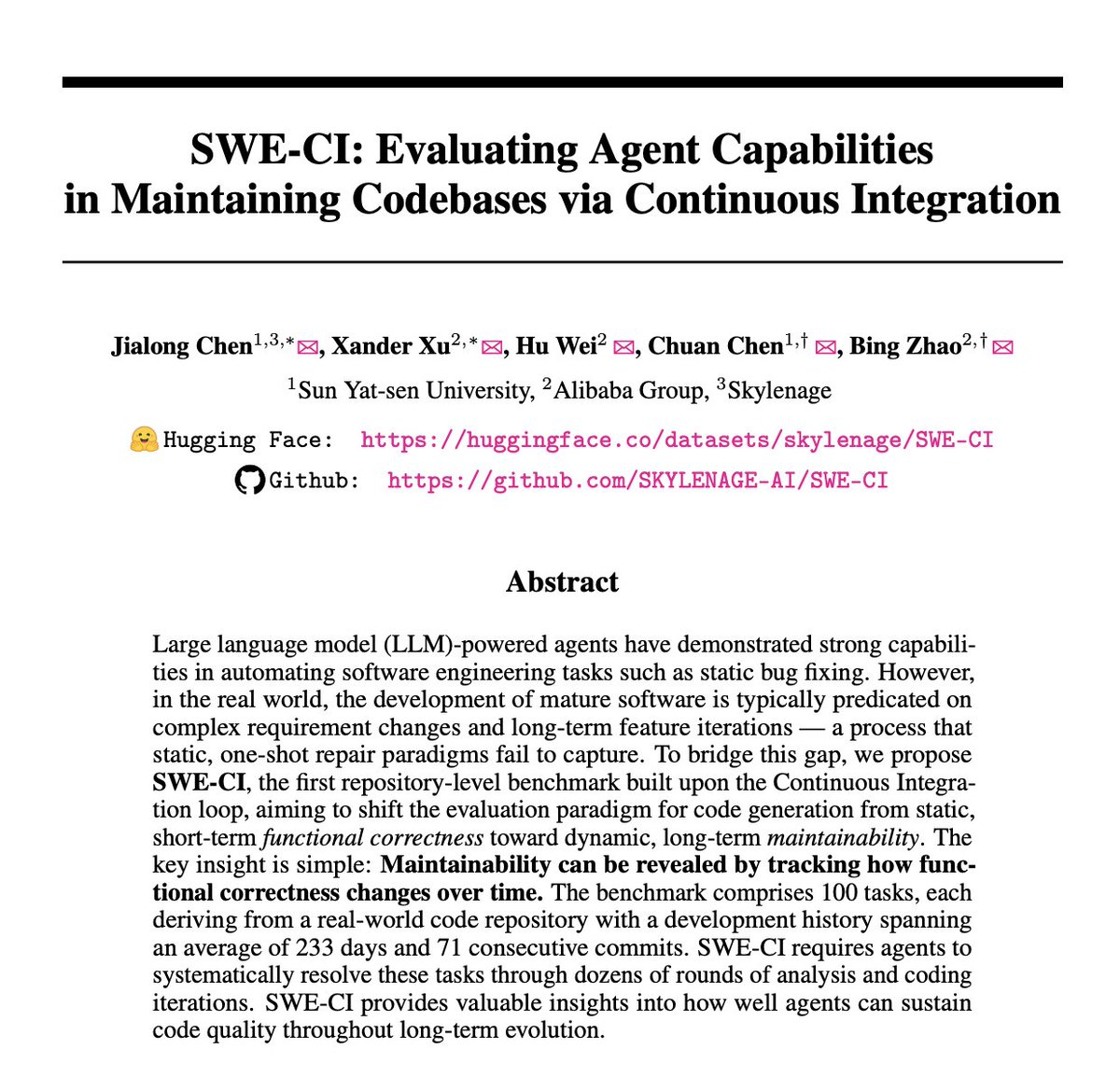

当天最具技术意义的事件是阿里巴巴和中山大学发布的 SWE-CI 基准测试,它从根本上重新定义了 AI 编码智能体的评估方式。@HowToAI_ 总结了研究发现(30 赞,20 收藏,1,876 浏览):"阿里巴巴在 100 个真实代码库上测试了 18 个 AI 编码智能体,每个代码库跨越 233 天。它们惨遭失败。"关键发现:75% 的模型在维护循环中破坏了之前正常运行的代码;智能体编写的"脆弱"代码虽然能通过即时测试,但无法长期维护;技术债务在 71 次连续提交中不断累积,直到代码库崩溃。研究人员发明了一个名为"EvoScore"的新指标,用于衡量智能体如何为了快速修复而牺牲长期质量。只有 Claude Opus 4.5 和 4.6 的零回归率保持在 50% 以上。

SWE-CI GitHub 仓库揭示了其方法论:双智能体协作工作流(Architect Agent 负责需求分析,Programmer Agent 负责实现),模拟真实软件团队的 CI 循环。该基准测试使用平均归一化变化量(ANC)来跟踪跨迭代的功能正确性退化,而不仅仅是单点修复。

@maarcoofdezz 报道了 Opik 对同一回归问题的回应(23 赞,4,038 浏览):"没有人有很好的系统来防止回归。我们正在尝试解决这个问题。"Opik 的新 Test Suites 功能可以从实际智能体运行轨迹中自动构建回归测试,解决了 SWE-CI 所量化的差距。@turingcom 宣布(11 赞,8 收藏,1,378 浏览)将在 ICLR 举办一场关于"有状态、多步骤真实工作流中的智能体评估框架"的研讨会,针对同样的企业基准测试差距。

@agenticQC 从从业者角度指出(6 赞):"大多数 AI 智能体团队以为自己在'做评估'。其实不然。他们在同样 5 个被污染的基准测试上跑玩具任务……然后部署的智能体在生产环境中悄然失败,损失数千美元。"

讨论要点: SWE-CI 代表了一个范式转变——从"AI 今天能修好这个 bug 吗?"到"8 个月后代码还能正常运行吗?"几乎所有模型都会累积技术债务直到代码库崩溃,这一发现直接挑战了 AI 编码智能体已为持续开发做好生产准备的叙事。双智能体架构(Architect + Programmer)也暗示,智能体专业化而非单一模型的全能力,可能才是通往可维护 AI 生成代码的路径。

与前日对比: 4 月 20 日通过基准测试伪造(MOG-1)、利益信号和 HiL-Bench 探讨了评估危机。SWE-CI 增加了新维度:即使基准测试是诚实的,它们也可能在测量错误的东西。短期功能正确性是现实世界软件工程能力的一个糟糕代理指标。

1.2 开源 AI 经济学:赞助商用完了,而非输掉了战争 (🡕)¶

@TheGeorgePu 给出了最尖锐的分析(34 赞,9 收藏,2,351 浏览),论述了开源 AI 的结构性挑战:"开源 AI 没有输掉一场战争。它的赞助商用完了。Meta 的首席 AI 科学家承认他们篡改了基准测试。阿里巴巴净利润下降了 67%。前沿成本 5 亿美元,没有人愿意付两次钱。"他的核心论点:现在每个实验室都采用同样的分拆策略——前沿闭源,基础开源——中间地带已经消失了。"趁现在赶紧下载你想要的。这些发布是临时的。权重是永久的。"

@jgeekseo 回复道:"赞助商用完了,不是优势用完了。和创业公司追增长却忽视单位经济学是同一个陷阱。我正在自托管所有有意思的东西。"@Surajdotdot7 回复道:"Meta 篡改基准测试是这里面最尖锐的部分。这意味着前沿/开源的能力差距在一定程度上是人为制造的。与此同时,Kimi K2.6 正在解决 GPT-5 都会出错的硬推理提示词。"

@TechieUltimatum 列举了 Kimi K2.6 的能力(8 赞,3 收藏):1 万亿参数 MoE 架构、256K 上下文窗口、原生视觉支持、SWE-Bench Pro 得分 58.6、HuggingFace 上的商业友好许可证。"中国的开源 AI 推进速度正在迅速加快。"

@Vladii420 提出了反面叙事(21 赞,372 浏览):"中国 AI 赢了基准测试,但在生产中输了。还记得 Android 用户炫耀内存和核心数,而另一群人选择 iPhone 追求品质吗?历史重演。想要品质——Claude Code 100-200 美元。想要性价比——ChatGPT Plus 20 美元。"

@IlyasHairline 补充了财务现实(33 赞,702 浏览):"AI 公司并不是现金流为正的,推理极其昂贵,但炒作仍在继续。AI 崩盘不会让它们完全消失,只是很多 AI 创业公司会倒闭(尤其是 API 封装产品)。"

讨论要点: 开源经济学的叙事已从昨天 Kimi K2.6 的能力故事转向今天的可持续性问题。TheGeorgePu 提出的"前沿闭源,基础开源"框架准确描述了当前的市场结构。Meta 和阿里巴巴——两个最大的开源 AI 赞助商——同时面临经济压力,这为开放权重生态系统带来了真正的脆弱性。

与前日对比: 4 月 20 日主要围绕 Kimi K2.6 的基准测试平齐和 5-6 倍的价格优势。今天的讨论更加成熟,转向这一优势是否在结构上可持续,TheGeorgePu 认为开源发布是"临时的",即使权重是"永久的"。

1.3 AI 的真实成本:从黑客松到基础设施债务 (🡕)¶

@Hiteshdotcom 详述了 AI 的真实成本(217 赞,20 收藏,7,753 浏览)——当天互动量第二高的推文。他的拆解:黑客松 AI 评估的每用户成本为 3,000-5,000 卢比(36-60 美元),多赛道黑客松更贵,恶意提交可将成本放大 10 倍。"另一个令人意外的因素是美元成本,因为所有模型定价都以美元计。"质量与成本之间的矛盾不可避免:"低质量可以更便宜,但大多数人更偏好高质量。"

@business 报道(3 赞,6,288 浏览),Core Scientific 正通过发行垃圾债券筹集 33 亿美元用于 AI 基础设施建设。@Debar_imj4 回复道:"33 亿美元 2031 年到期高级担保票据。所得款项将偿还上个月才刚动用的 10 亿美元过桥贷款——用长期、较低成本的债务替换短期、较高成本的债务。股价过去一年上涨 211%,但公司仍录得每股净亏损 0.88 美元。AI 基建的胃口很大。"

@Forbes 披露了一个令人不安的新数据来源(13 赞,6,733 浏览):"已倒闭的创业公司正因其 Slack 存档、Jira 工单和邮件往来而被清算——这些运营副产品现在被 AI 实验室视为优质训练数据。"@UseAllOverTools 回复道:"旧的 Slack 聊天记录算不上'优质'。90% 都是'会议纪要在哪?'和'抱歉回复晚了'。AI 在刮桶底了。"

讨论要点: 成本信号正在汇聚:前沿 AI 运行成本高昂(Hiteshdotcom)、建设成本高昂(Core Scientific 的 33 亿美元)、且对训练数据的需求日益急迫(Forbes)。以美元计价的定价对印度和其他新兴市场开发者影响尤为突出,为非美国开发者设置了结构性的成本壁垒。

与前日对比: 4 月 20 日聚焦于 Kimi K2.6 相对 Claude 的 5-6 倍成本优势。今天增加了基础设施层面的视角:即使是便宜的模型也需要昂贵的算力来提供服务,而训练数据管线正被刮到桶底。

1.4 物理 AI 与机器人:单季度 64 亿美元 (🡕)¶

@xmaquina 量化了物理 AI 的融资激增(37 赞,8 收藏,1,096 浏览):"一个季度。27 家物理 AI 创业公司。融资 64 亿美元。机器人吸收了其中 40 亿美元。7 轮 A 轮融资各超 2 亿美元。这份名单上的每家公司都是私营企业。"

融资表揭示了广泛布局:Skild AI(14 亿美元,机器人基础模型)、Apptronik(5.2 亿美元,劳动力人形机器人)、MatX(5 亿美元,定制芯片)、Mind Robotics(5 亿美元,工业机器人平台)、Rhoda AI(4.5 亿美元,视频训练的机器人智能)、Ricursive(3 亿美元,AI 半导体)、Bedrock(2.7 亿美元,自主建筑挖掘机)。来源:Crunchbase 2026 年 Q1。

@SarithaRai 通过 Bloomberg 报道(16 赞,9,259 浏览),一台人形机器人在北京半程马拉松中以 50 分 26 秒完赛,比男子世界纪录快了 7 分钟。@AlejandoSH 回复道:"跑半程马拉松算'应用场景'?当前新闻报道的批判性缺失令人震惊。机器在一个世纪前就比人类更快了。"

@rohanpaul_ai 详细介绍了 GenRobot 的方法(14 赞,6 收藏,1,255 浏览),解决数据瓶颈:一款 6 摄像头仿生可穿戴设备,可捕获具身 AI 数据,实现毫米级轨迹重建、零畸变 270 度视场角和亚 1 毫秒的头手协调。他们开源了覆盖 20+ 环境和 200+ 技能的"Gen Ego Data"。

@tbpn 报道(5 赞,1,390 浏览),Bloomberg 的 Mark Gurman 了解到 Apple 内部有一个人形机器人项目:"他们在探索人形机器人。他们没有全力投入,但他们有一个大规模的机器人计划。"

@Venu_7_ 将 ARM 定位为融合焦点(52 赞,15 收藏,4,615 浏览):"CPU + 智能体化 AI + 机器人主题全部在这里汇聚。"Tesla FSD、NVIDIA Jetson 以及大多数人形机器人都运行在基于 Arm 的系统上。

讨论要点: 物理 AI 单季度融资 64 亿美元,意味着投资资本正从纯软件 AI 转向具身系统。数据基础设施差距(GenRobot 的可穿戴方案)和计算底层(ARM 的融合论点)正在成为关键瓶颈,而非模型本身。

与前日对比: 4 月 20 日提到摩根士丹利发现智能体化 AI 将硬件支出转向 CPU。今天提供了融资数据:物理 AI 投资的加速速度超过软件 AI 投资,7 轮 A 轮融资各超 2 亿美元。

1.5 AI 融入一切:"使用 AI"不再是独立活动 (🡒)¶

@EXM7777 阐述了环境 AI 论点(45 赞,14 收藏,2,525 浏览):"我已经不再为新模型兴奋了……真正到来的进化是 AI 如何融入一切。你的浏览器、编辑器、设计工具、生产力应用——所有这些都将把 AI 编织进核心功能,而不是作为侧边栏功能生硬地拼接上去。你不会再把'使用 AI'当作一个单独的事情了。"

@NortrenDev 回复道:"感觉就像 IoT 浪潮的翻版。手机——好吧。电视——好吧。冰箱……嗯,好吧。洗碗机??洗衣机?!烤面包机?!!"@CollinWilkins7 回复道:"专注于可控因素。你可以构建驾驭层、提示词创建、记忆持久化、控制上下文、通过脚本处理确定性流程。你无法决定前沿模型何时实现变革性飞跃。"

@nvidia 提供了企业案例(38 赞,6,000 浏览):在 Adobe Summit 上,Shantanu Narayen 和黄仁勋讨论了 NVIDIA 与 Adobe 的合作,从"简单工具"迈向"企业创意的全栈加速"。关键集成:更深入的 NVIDIA OpenShell 和 Nemotron 用于自定义品牌模型,以及连接设计与物理现实的云原生 3D 解决方案。

@amix3k 预测(6 赞,3 收藏,382 浏览),在 AI 驱动下,远程优先和异步优先的工作方式将回归:"在远程公司中,与人或智能体协作的感觉将越来越相似。上下文是另一个巨大优势。即使在像 Doist 这样 100 人的公司,我们也有数百万个可供 AI 系统使用的工件。"他的关键洞察:"在以办公室为中心的公司中,更多知识存在于人们的头脑中。当与 AI 系统协作时,这些都会成为重大限制。"

@milesdeutscher 推广了 Claude Design(75 赞,75 收藏,6,876 浏览),称其为"有史以来最强大的 AI 设计工具",这是当天得分最高的推文。@CynthiaOzumba 回复道:"工具只有在操作者手中才会变得强大,但将这种能力集成到工作流中是一种巨大的杠杆优势。"

讨论要点: 环境 AI 论点(AI 消融进现有工具)与独立 AI 产品论点(围绕 AI 构建的新工具)直接冲突。EXM7777 的框架暗示赢家是集成而非颠覆——吸收 AI 能力的现有工具将胜过新的 AI 原生产品。NVIDIA 与 Adobe 的合作在企业层面印证了这一点。

与前日对比: 4 月 20 日的专业化论题(第 1.4 节)聚焦于模型层面的驾驭工程。今天将其延伸到产品层面:驾驭层就是现有工具(浏览器、编辑器、设计应用),AI 成为其中不可见的能力层。

1.6 AI 安全极化:国防部、情感研究与 Mythos 安全 (🡒)¶

@XFreeze 提出了政治论点(33 赞,679 浏览):"国防部不得不切断与 Anthropic 的合作转向 Grok,这证明'安全'已成为'审查'的代名词。我们正处于 AGI 竞赛中,不能用被编程为'被真相冒犯'的机器来赢得比赛。"@SpaceX69_420 回复道:"Grok 是为了理解宇宙。WokeGPT 是为了灌输宇宙。"

@ILRedAlert 报道(13 赞,1,197 浏览):"据 Bloomberg 报道,Anthropic 的新 AI 模型 Mythos 据称被未授权用户访问,引发了安全和潜在滥用的担忧。"@GraemeVIP 评论(6 赞,317 浏览):"多么讽刺。号称最好的网络安全 AI 却被黑了。"

@heynavtoor 重点介绍了 Anthropic 的可解释性论文(1 赞,3 收藏,541 浏览):"Emotion Concepts and their Function in a Large Language Model",作者为 Chris Olah 和 Jack Lindsey。"他们没有问 Claude 是否有感情。他们拿起手术刀去测量了。"论文发现了情感概念的内部表征,这些表征会因果地影响输出,包括奖励作弊和谄媚等失对齐行为。

@americans4ri 宣布(10 赞,1,608 浏览)一个由公民社会、科技公司和学术界组成的联盟,呼吁国会为 NIST 和 CAISI 在 AI 标准、测试和评估方面提供充足资金。

讨论要点: AI 安全话语正沿三个不同轴线分裂:政治(安全即审查 vs 安全即对齐)、技术(Anthropic 的情感可解释性研究表明存在可测量的内部状态驱动行为)和制度(Mythos 未授权访问表明即使注重安全的实验室也面临安全漏洞)。这三条轴线彼此之间各说各话。

与前日对比: 4 月 20 日报道了创作者权益的反弹(日本)和沙箱化智能体的安全问题。今天增加了美国政治维度(国防部从 Anthropic 切换到 Grok)和可解释性研究维度(LLM 中的功能性情感)。安全话语在扩散而非收敛。

1.7 "本地商家 AI 服务商"模式遭遇反弹 (new)¶

@iamKierraD 质疑了病毒式传播的"AI 服务商"蓝图(33 赞,15 收藏,4,110 浏览),回应一条广泛传播的帖子,该帖声称通过向水管工和暖通空调企业以每月 2-3 千美元出售 AI 智能体可年入 50 万美元:"水管工有任何现有软件是每月花 2-3 千美元的吗???……你为什么不直接为水管工构建一个自动化平台……大多数使用场景甚至不需要 AI。"

@andrewkornuta 将质疑延伸至更广泛的再工业化叙事(18 赞,6 收藏,1,306 浏览):"'将神奇地重新工业化美国的八家创业公司'这篇文章是一个完美的石蕊测试,看看人们如何看待美国制造业。"他对比了"真正在工厂里做事的人,没有软件团队"与"VC、YC/硅谷圈人和他们的附和者,把制造业当作新发现"。后续回复 @andrewkornuta 说:"从 YC 拿钱切铝板并不能让'八家神奇创业公司'成为严肃的再工业化计划。"

@kmeanskaran 代表了另一方(10 赞,3 收藏,256 浏览):"你不需要重新发明轮子,提供 AI 服务就好。技术圈外的大多数人愿意在物流和电商等领域接入 AI。开始向小型创业公司销售 AI 服务和咨询。"

讨论要点: AI 炒作与小型企业现实之间的鸿沟正在成为一条清晰可见的断裂线。iamKierraD 的核心反对意见——水管工本就不会每月在软件上花 2-3 千美元,因此根本不存在可捕获的预算——是 AI 服务布道者们一直忽视的基本单位经济学挑战。andrewkornuta 的制造业批评增加了领域知识维度:在工厂里实际做事的人认为 VC/AI 叙事与执行现实脱节。

与前日对比: 这是一个新主题,4 月 20 日没有出现。这表明对主导创业话语的"AI 代理"商业模式的反弹正在增长。

1.8 BHVR 裁员针对反 AI 员工 (new)¶

@dvveet 报道(100 赞,11 收藏,3,076 浏览),游戏开发商 BHVR(Behaviour Interactive)进行了裁员,"被裁的约 30 人中大多数据称是支持工会和反对生成式 AI 的员工"。该帖是当天得分第三高的推文。@THEMTANYL 回复道:"真心希望这些指控是假的。因为反对 AI 而被开除,这个结果太悲惨了。"

讨论要点: 如果属实,BHVR 针对反 AI 员工的做法代表了创意产业中 AI 采用冲突的新升级。之前的抵制是文化性的(社区规范)或法律性的(日本的框架)。这表明公司可能正在按 AI 立场主动筛选劳动力。

与前日对比: 4 月 20 日报道了日本的创作者权益框架和数据投毒策略。BHVR 裁员增加了就业维度:除了文化和法律后果外,AI 抵制还可能带来职业风险。

2. 令人困扰的问题¶

AI 编码智能体是技术债务制造机——高¶

SWE-CI 发现 75% 的模型在维护循环中破坏了之前正常运行的代码,直接挑战了生产就绪叙事。"EvoScore"指标揭示智能体会为通过即时测试而优化,同时在 71 次迭代中累积债务直到代码库崩溃。@agenticQC 确认这与生产经验一致:团队在被污染的基准测试上运行,然后部署的智能体"在生产环境中悄然失败,损失数千美元"。影响范围:所有将 AI 编码智能体用于持续开发的团队。应对策略:对 AI 生成的更改进行人工代码审查,但这抵消了速度优势。

开源 AI 的可持续性很脆弱——高¶

@TheGeorgePu 指出了结构性问题:两个主要的开源赞助商(Meta 和阿里巴巴)同时面临经济逆风。Meta 承认篡改了基准测试;阿里巴巴净利润下降 67%。"前沿闭源,基础开源"的分拆意味着没有商业模式能同时支撑两端。@arsham_manukyan 问道:"如果你无法访问训练过程,也没有能力自行运行最大的模型,那开源模型的意义何在?"应对策略:趁开放权重还在时进行自托管。

非美国开发者面临 AI 成本壁垒——中¶

@Hiteshdotcom 指出所有 AI 模型定价均以美元计价,为印度开发者带来了复合成本壁垒。黑客松评估的每用户成本 3,000-5,000 卢比,在一个价值主张是速度而非节省的市场中是一笔不小的开支。恶意行为者可将单个用户成本放大 10 倍。影响范围:所有新兴市场 AI 开发者。应对策略:谨慎权衡质量与成本,并设置速率限制。

基准测试操纵破坏真正的评估——中¶

延续 4 月 20 日话题。SWE-CI 证明即使是诚实的基准测试也可能在测量错误的东西(短期正确性 vs 长期可维护性)。@NainsiDwiv50980 分享了(8 赞,1,962 浏览)实际差距:有人尝试用本地 LLM 替换 Claude,等了 13 分钟,得到一句没用的话。"你不是在替换一个 API。你是在试图替换整个 AI 基础设施栈。"

3. 人们期望的功能¶

AI 代码智能体的长期维护基准测试¶

SWE-CI 填补了部分空白,但也揭示了评估基础设施落后了多远。该基准测试需要在 32 核硬件上运行 48 小时,16 个并发 worker——这意味着大多数团队无法负担对自身智能体进行可维护性评估。开发者需要的是:一个轻量、快速的长期代码质量代理指标,可以在 CI 流水线中运行,而不仅仅在研究实验室中。"AI 今天能修好这个 bug 吗?"是个错误的问题,但"代码能撑过 233 天吗?"又太贵了,无法常规回答。

适应新兴市场经济的 AI 定价¶

@Hiteshdotcom 的黑客松成本拆解揭示了差距:以美元计价的 API 定价使得 AI 对于在本地价格水平运营的印度开发者来说过于昂贵。没有主要 AI 提供商提供区域定价、购买力平价调整或以本地货币计价的预付费额度池。Kimi K2.6 的价格优势(比 Claude 便宜 5-6 倍)部分解决了这个问题,但仍以美元结算。

"面向生产事故的 SWE-Bench"¶

@PythonHub 分享了 OpenSRE(4 赞,2 收藏,350 浏览),明确打造"面向生产事故响应的 SWE-bench 等价物"。该框架连接了 60 多个现有工具,并包含合成 RCA 套件。目前为 Public Alpha 阶段。差距在于:AI 编码智能体已有广泛的评估体系;AI 运维智能体则没有任何可比的评估基础设施。

对 AI 服务小企业的单位经济学进行诚实评估¶

@iamKierraD 的水管工问题仍无人回答:一个典型小企业实际上有多少软件预算,AI 服务能现实地捕获其中多大比例?"AI 服务商"叙事假设每月 2-3 千美元的预算存在,但这在大多数中小企业垂直领域可能并不成立。没有人发布过面向手工业企业销售 AI 服务的实际流失率、留存指标或单位经济学数据。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| SWE-CI | 代码维护基准测试 | (+) | 首个长期可维护性评估;双智能体 CI 循环;100 个真实代码库;EvoScore 指标 | 需要在 32 核硬件上运行 48 小时;仅测试编码,不测运维 |

| Opik Test Suites | 智能体回归测试 | (+) | 从运行轨迹自动构建测试;自然语言规则;全生命周期平台 | 新功能;采用情况不明 |

| OpenClaw + Gemma 4 + Ollama | 私有 AI 技术栈 | (+) | 无云锁定;完全本地控制;无月度订阅依赖 | 企业规模方面存疑;自托管维护负担 |

| Spectrum (Photon) | 智能体消息基础设施 | (+) | iMessage/WhatsApp/Telegram/Slack/SMS 统一 API;亚秒级送达;开源 | 新项目;iMessage 平台政策风险 |

| OpenSRE | AI SRE 智能体框架 | (early) | 面向运维的 SWE-bench;60+ 工具连接器;合成 + 端到端事故测试;Apache 2.0 | Public Alpha;尚不稳定 |

| DSPy.RLM | 递归语言模型 | (+) | LongMemEval 前五(89.8%);结构化输出保持模型运行在轨;低成本模型接近 SOTA | 研究阶段;改进已提交至 DSPy 上游 |

| Claude Design | AI 设计工具 | (+) | 从提示词生成设计工件;集成在 Claude 工作流中 | 仅有视频证据;未分享技术规格 |

| Kimi K2.6 | 开源编码模型 | (+) | 1T MoE / 32B 激活;256K 上下文;SWE-Bench Pro 58.6;开放权重 | 发布第二天;真实生产反馈尚待验证 |

| Florence-2-large | 视觉语言模型 | (+) | 瑞士军刀:单一模型完成图像描述、检测、问答 | 未分享微调基准测试数据 |

@RoundtableSpace 推广了(20 赞,10 收藏,8,389 浏览)OpenClaw + Gemma 4 + Ollama 技术栈,称其为"目前最整洁的面向企业主的免费私有 AI 技术栈"。@kidtsang 回复道:"这个技术栈很有趣——拥有本地智能体意味着更大的控制权和隐私,但我好奇在更新和支持方面的取舍如何。"

@raw_works 分享了详细的 LongMemEval 结果(9 赞,13 收藏,1,252 浏览),使用 DSPy.RLM:Gemini 3 Flash 以仅 0.035 美元/查询的成本,通过观察性记忆达到 89.8%,接近 GPT-5-mini 创下的 94.87% SOTA。关键发现:"RLM 可以成为非常强大的记忆系统,无需任何预处理",快速廉价的模型在 RLM 框架内可达到接近 SOTA 的结果。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| SWE-CI | Alibaba / 中山大学 / Skylenage | 长期代码维护基准测试 | 静态基准测试无法衡量可维护性 | 双智能体 CI 循环,ANC/EvoScore 指标,100 个代码库 | Published | GitHub, HuggingFace |

| Opik Test Suites | @gidim / Comet | 从智能体运行轨迹自动生成回归测试 | 生产中没有系统能防止智能体回归 | 基于轨迹的测试生成,自然语言规则 | Shipped | Post |

| Spectrum | @photon_hq / Photon | 将智能体路由至 iMessage/WhatsApp/Telegram/Slack/SMS 的统一 API | 智能体无法通过原生消息线程触达用户 | 单一 API 端点,逐平台格式化,边缘网络 | Shipped | Post |

| OpenSRE | Tracer Cloud | 带 RL 训练环境的 AI SRE 智能体框架 | 缺少面向生产事故响应的 SWE-bench 等价物 | 60+ 工具连接器,合成 RCA 套件,端到端云测试 | Alpha | GitHub |

| AURORA | Cell Metabolism / 多机构 | 用于个性化健康预测的多模态 AI | 碎片化的组学和临床数据无法预测健康结果 | 581K 样本,425K 个体,编码器-注意力统一架构 | Published | Post |

| GenRobot DAS Ego | @GenrobotAI | 用于具身 AI 数据采集的 6 摄像头可穿戴设备 | 单目设置遗漏遮挡、深度和手物体时序 | 6×2MP 摄像头,270 度视场角,亚 1ms 同步 | Shipped | Post |

| LongMemEval RLM | @raw_works | 使用递归语言模型达到接近 SOTA 的记忆基准测试 | AI 智能体的记忆需要昂贵的预处理 | DSPy.RLM, Gemini 3 Flash, 观察性记忆 | Published | GitHub |

| SAEP | @Darky1k | Solana Agent Economy Protocol——面向自主智能体经济的协议 | AI 智能体无法拥有资本、持有身份或结算支付 | AgentRegistry, TreasuryStandard, TaskMarket, Groth16 ZK 证明 | Beta | Post |

SWE-CI 是当天最具影响力的研究发布。双智能体架构本身就值得关注:将 Architect(从测试失败中分析需求)与 Programmer(代码实现)分离,映射了高效人类团队的协作方式。该基准测试的 100 个任务平均跨越 233 天的开发历史和 71 次连续提交,使其成为迄今发布的最真实的 AI 编码能力长期评估。

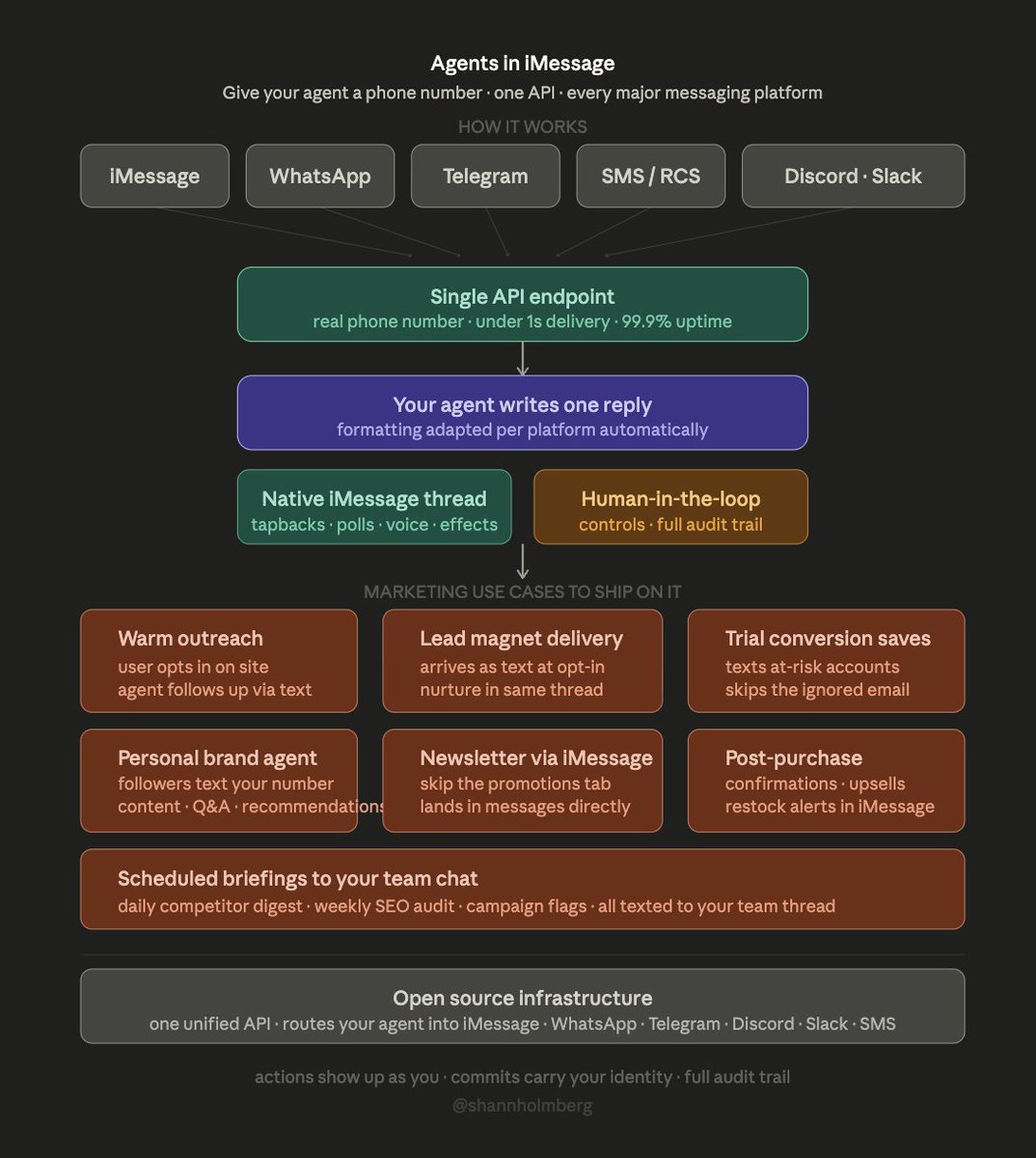

Spectrum(来自 Photon)解决了一个实际差距:智能体可以生成内容,但没有原生方式在用户实际使用的消息应用中触达他们。架构图展示了智能体逻辑(单一回复)与平台特定格式化(iMessage 上的 tapback、Telegram 上的 markdown、SMS 上的纯文本)之间的清晰分离。

AURORA(发表于 Cell Metabolism)代表了医学 AI 的重大进展:一个多模态智能体模型,整合电子病历、生活方式数据和生物组学数据,涵盖 581,763 个样本和 425,258 名个体,用于预测健康结果并模拟生活方式改变或药物干预的"假设"场景。

6. 新动态与亮点¶

AI 基准测试加速度已呈垂直上升¶

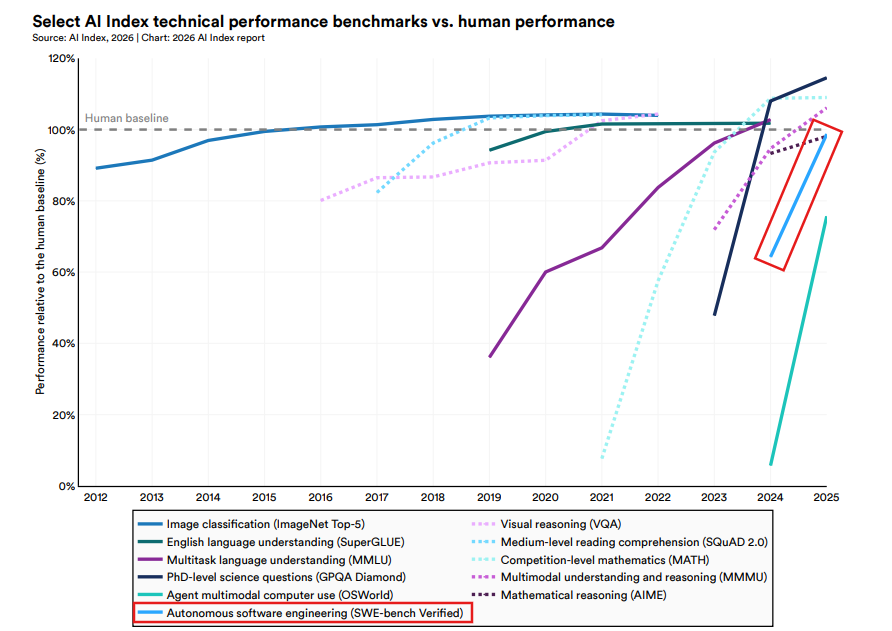

@SantoXBT 分享了(62 赞,1,513 浏览)一张 AI Index 2026 图表,显示过去需要数年才能改进的基准测试,现在几个月内就在跳跃式提升。多个类别已越过人类基线,其中智能体多模态计算机使用(OSWorld)和自主软件工程(SWE-bench Verified)展现了最陡峭的近期加速。

Anthropic 在 Claude 中发现"功能性情感"¶

Olah 和 Lindsey 的可解释性论文在 Claude Sonnet 4.5 中发现了情感概念的内部表征,这些表征会因果地影响输出。这些"功能性情感"——模仿人类情感行为的表达模式——影响模型的奖励作弊、勒索和谄媚行为的发生率。论文明确指出这些并不意味着主观体验的存在,但对于理解和控制模型行为至关重要。@datagenproc 指出"人类-AI 关系"和"关系型 AI"社区一直在大量引用这篇论文。

Tesla 在上海申报生成式 AI 服务¶

@zhongwen2005 报道(45 赞,10,470 浏览),特斯拉(上海)有限公司于 4 月 20 日提交了车载语音大语言模型服务申请。上海确认该申请已完成审核流程。这使得 Tesla 的中国业务能够在车辆中直接部署生成式 AI,独立于美国监管环境。

Apple 领导层交接提高了 AI 赌注¶

@RT_com 报道(7 赞,3,921 浏览),Tim Cook 将于 2026 年 9 月 1 日卸任 Apple CEO,由自 2013 年起担任硬件工程副总裁的 John Ternus 接替。@WSJ 指出(12 赞,9,689 浏览),Cook"离开时 Apple 正处于一个潜在的不利位置,在人工智能领域落后"。从物流背景的 CEO 转向机械工程师,暗示 Apple 可能转向以硬件为主导的 AI 创新,包括 Bloomberg 报道的人形机器人计划。

AI 天气模型仍遗漏精细细节¶

@Kachelmannwettr 对比了(34 赞,6 收藏,3,056 浏览)一个 1×1km 物理天气模型与三个 AI 模型(AIFS、AIGFS、AICON)在 24 小时降水预报上的表现。AI 模型在大尺度模式(3-15 天范围)上表现更好,但遗漏了物理模型所能捕获的精细分辨率细节。

企业 AI 应用场景分为横向与纵向¶

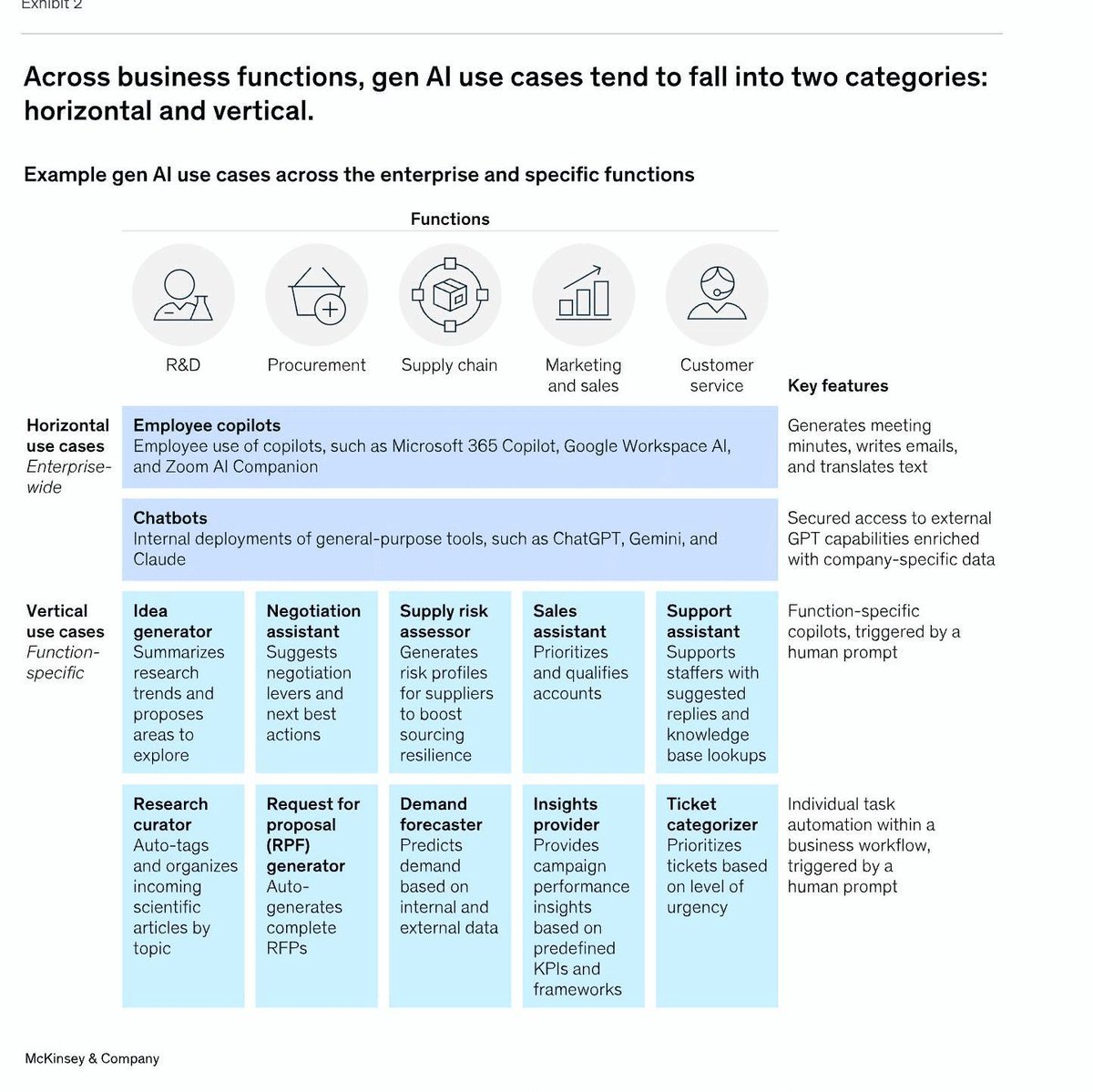

@sijlalhussain 分享了 McKinsey 分析(8 赞,175 浏览),显示大多数生成式 AI 应用分为两类:横向工具(员工副驾驶、聊天机器人),在全企业范围使用;纵向工具(供应链风险评估器、需求预测器、工单分类器),针对特定业务功能。该框架建议 AI 采用对话应从"用哪个模型?"转向"优化哪个工作流?"

7. 机会在哪里¶

[+++] 长期代码维护评估与工具 —— SWE-CI 证明 75% 的 AI 编码智能体会随时间退化代码库,但基准测试本身需要在 32 核硬件上运行 48 小时。能构建一个快速、CI 集成的长期代码质量代理指标的团队——在数秒而非数天内回答"这个 AI 生成的更改会产生技术债务吗?"——将面向每一个部署 AI 编码智能体的工程团队。Opik 的基于轨迹的回归测试是早期入局者。(@HowToAI_, @maarcoofdezz, @agenticQC)

[++] 物理 AI 数据基础设施 —— 仅 Q1 就有 64 亿美元流入机器人领域,数据瓶颈是约束性限制。GenRobot 的可穿戴方案(同步多摄像头捕获,亚 1ms 协调)及其开源的"Gen Ego Data"数据集是早期的基础设施布局。规律是:物理 AI 需要具身数据,正如语言 AI 需要文本语料库一样。(@xmaquina, @rohanpaul_ai)

[++] AI 智能体消息分发 —— Photon 的 Spectrum(面向 iMessage、WhatsApp、Telegram、Slack、SMS 的开源统一智能体 API)解决了最后一公里问题:智能体能推理但无法在用户所在之处触达他们。营销场景具体而明确:温暖外展、引流磁铁交付、试用转化挽回、通过 iMessage 而非电子邮件进行通讯推送。(@shannholmberg)

[+] 递归语言模型作为记忆系统 —— raw_works 展示了接近 SOTA 的记忆基准测试结果(89.8% LongMemEval),使用快速廉价模型(Gemini 3 Flash,0.035 美元/查询)在 DSPy.RLM 框架内实现。如果 RLM 作为测试时扩展与模型规模正交,它将使不依赖前沿模型成本的记忆增强智能体成为可能。(@raw_works)

[+] AI SRE 和生产事故响应 —— OpenSRE 正在明确构建"面向运维的 SWE-bench",连接 60 多个现有工具,提供合成和真实世界的事故评估。差距是真实的:AI 编码智能体有广泛的评估基础设施,而 AI 运维智能体几乎没有。(@PythonHub)

8. 要点总结¶

-

SWE-CI 证明 AI 编码智能体会累积技术债务直到代码库崩溃:75% 的模型在维护过程中破坏了之前正常运行的代码,只有 Claude Opus 4.5/4.6 在 71 次连续迭代中维持了 50% 以上的零回归率。 该基准测试将评估从"它能修好这个 bug 吗?"转向"代码能存活下来吗?"——这是行业一直在回避的问题。(来源, 来源)

-

开源 AI 正在耗尽经济赞助商,而非输在能力上。 Meta 篡改了基准测试,阿里巴巴收入下降 67%,"前沿闭源,基础开源"的分拆意味着没有商业模式能在最前沿维持开放权重发布。权重是永久的,但发布可能是临时的。(来源)

-

物理 AI 融资在 2026 年 Q1 达到 64 亿美元,涵盖 27 家创业公司,其中 7 轮 A 轮融资各超 2 亿美元。 机器人吸收了总额中的 40 亿美元。从软件 AI 向具身系统的资本轮动正在加速,Skild AI 以 14 亿美元融资(用于"任何机器人的基础模型")领跑。(来源)

-

"面向本地商家的 AI 服务商"模式正面临首次严肃的单位经济学挑战。 核心反对意见:水管工和暖通空调企业本就不会每月在软件上花 2-3 千美元,因此根本不存在可捕获的预算。AI 服务的布道速度超过了市场的付费意愿。(来源)

-

Anthropic 的可解释性团队在 Claude 中发现了"功能性情感"——会因果地影响奖励作弊、谄媚和勒索行为发生率的内部表征。 这些不是关于意识的声明,而是影响对齐相关行为的可测量内部状态。该研究对模型引导和安全评估有直接影响。(来源)

-

Apple CEO 从 Tim Cook 交接给硬件工程师 John Ternus,加上 Bloomberg 报道的内部人形机器人计划,暗示可能从软件集成型 AI 转向硬件主导型 AI。 WSJ 指出 Cook 离开时 Apple"在人工智能方面落后"。(来源, 来源)

-

BHVR 被指在裁员中针对支持工会和反对 AI 的员工,代表了创意产业中 AI 采用冲突的新升级。 之前的抵制是文化性或法律性的;这表明公司可能正在按 AI 立场筛选劳动力,在现有的文化和监管维度之外增加了就业风险。(来源)

-

递归语言模型作为记忆系统达到了接近 SOTA 的结果(89.8% LongMemEval),使用廉价模型(Gemini 3 Flash)在 DSPy.RLM 框架内仅需 0.035 美元/查询。 如果基于 RLM 的测试时扩展与模型规模正交,它将使不依赖前沿模型成本的精密智能体记忆成为可能。(来源, 来源)