Twitter AI - 2026-04-22¶

1. 人们在讨论什么¶

1.1 AI 幻觉冲击收费 2000 美元/小时的律所(new)¶

Sullivan & Cromwell 向联邦法官承认,其法庭文件包含 AI 生成的幻觉内容,包括虚构的案例名称、捏造的引文和不存在的法规。@MrEwanMorrison 将其定义为转折点(94 赞,27 转发,1,757 次浏览):"伟大的 AI 经济现实检验。LLM AI 是信息污染源——错误和垃圾的制造机器。依赖它们的公司会陷入严重麻烦。"相关报道详细描述了这些失败:该律所的初审团队和二次审核均未发现错误,而合伙人收费超过 2,000 美元/小时。

@Technimentals回复道:"联邦法院已经有超过 1,000 起类似案例。"@4854Capital补充:"我们正在进入'垃圾纠正'时代。当每家公司都能生成无限信息时,这些信息的市场价值将降为零。"@ahmedehab_01指出了结构性问题:"人工审核是不够的,因为它会让任何普通人不堪重负。"

这与@Dr_Lockdown 报告(11 赞,151 次浏览)的零售领域持续模式相呼应:"'但 ChatGPT 说的。'通常当我用'往奶酪混合物里加胶水'的例子来解释时,他们就能理解这有多蠢,但这是我们必须不断解释的常见问题。"

与前日对比: 4 月 21 日讨论了 AI 编程智能体在长期维护中的失败(SWE-CI)。今天幻觉问题出现在另一个高风险领域——法律——带来了具体的经济和职业后果。模式一致:AI 系统通过了表面检查但在深入审查下失败。

1.2 AI 编程智能体:SWE-CI 发现持续传播(🡒)¶

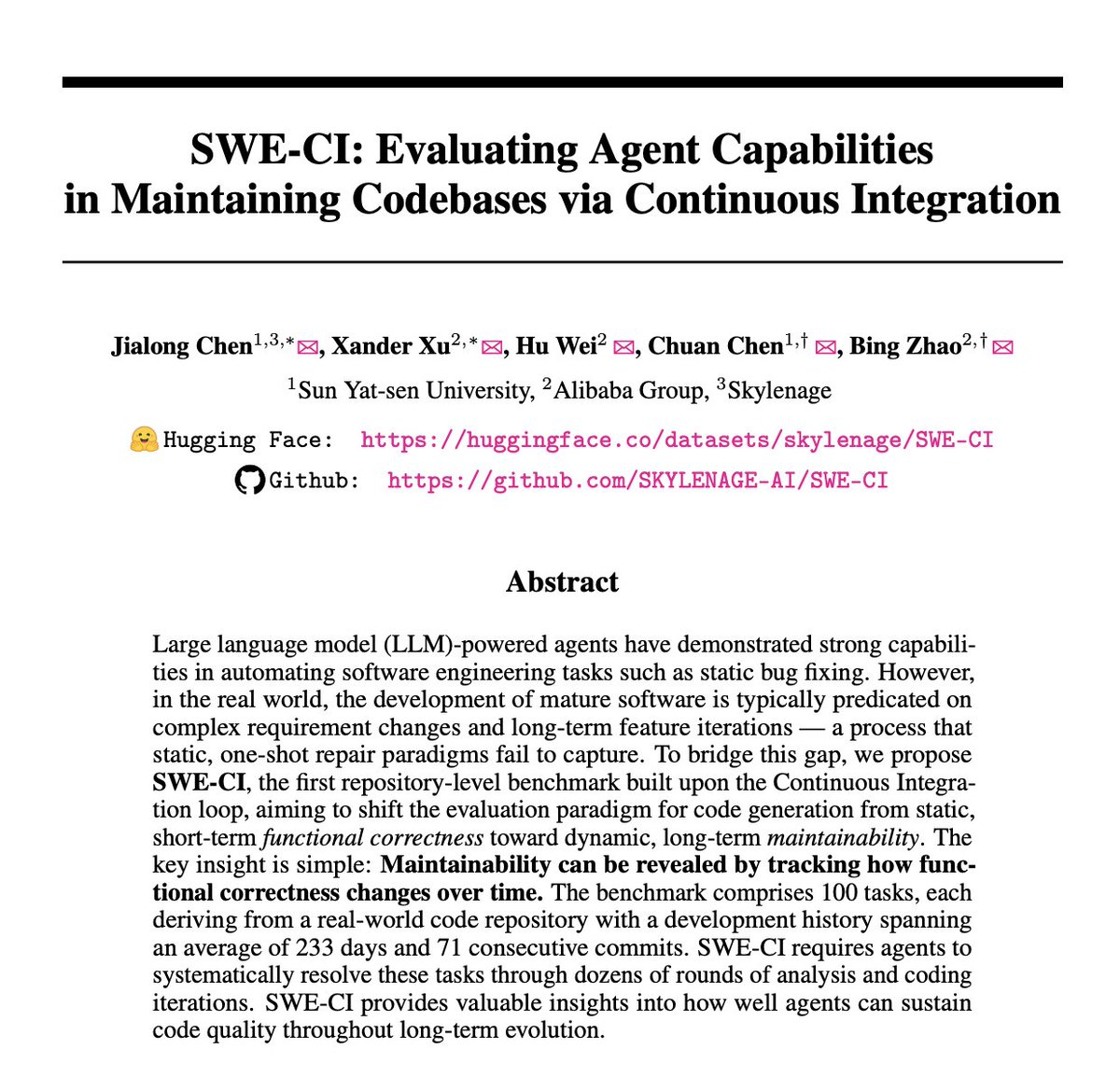

来自阿里巴巴和中山大学的 SWE-CI 基准测试在第二天继续引发讨论。@HowToAI_ 分享了研究结果(48 赞,30 收藏,3,729 次浏览):"阿里巴巴在 100 个真实代码库上测试了 18 个 AI 编程智能体,每个代码库跨度 233 天。它们惨遭失败。"核心发现:75% 的模型在维护循环中破坏了之前正常运行的代码;技术债务在 71 次连续提交中不断累积,直到代码库崩溃;只有 Claude Opus 4.5 和 4.6 保持了 50% 以上的零回归率。

@fadeone_x提出了实践者的反驳:"如果你正确指导了 Claude,使用代码检查器、类型检查器、覆盖率计数器……代码会稳定得多。Claude 无法在不通过单元测试的情况下完成任务。如果端到端测试失败——重试。就这样。'代码即艺术'的时代结束了。"

@maarcoofdezz 报道了 Opik 的回应(24 赞,19,901 次浏览):Opik 扩展到覆盖完整的 AI 智能体生命周期,推出了测试套件功能,可从实际智能体追踪中自动构建回归测试,以及智能体游乐场用于测试智能体配置而无需修改代码。

SpaceX 进入 AI 编程基础设施是一个次要信号。@Benzinga 报道(1,359 次浏览)SpaceX 获得了以 600 亿美元收购 Cursor 的选择权,备选方案为 100 亿美元合作。@WSJ 确认(2,716 次浏览)了这笔交易。

与前日对比: SWE-CI 在 4 月 21 日作为当天最具技术意义的报道位列主题 1.1。今天它继续传播,带来新的互动和实践者回应,同时 Cursor/SpaceX 交易为 AI 编程基础设施增添了并购维度。

1.3 "为本地企业做 AI"的质疑声增长(🡕)¶

@iamKierraD 质疑了病毒式传播的 AI 代理商蓝图(86 赞,36 收藏,11,287 次浏览),回应一个广泛传播的声称每年向水管工以 2-3K 美元/月出售 AI 智能体可赚 50 万美元的说法:"水管工有任何每月花费 2-3K 美元的现有软件吗?……而且你为什么不直接为水管工搭建一个自动化平台呢……大多数用例根本不需要 AI。"

@s4rah_dev回复:"承包商软件可能非常昂贵,甚至更高。但'振感编程'出更好的解决方案的可能性为零。他们可能会以更低的成本创造一个更差的解决方案,但不太可能是更好的。"@bossnayamoss补充了一个细微差别:"AI 顾问在'AI 采用'方面收费过高,而他们真正需要的只是一个简单的语音智能体+预约自动化。"

@eptwts 重新定义了更广泛的 AI 初创公司辩论(25 赞,15 收藏,1,715 次浏览):“10% 的‘AI 初创公司’只是:接受用户任务,集成外部工具/API,将专有领域特定数据注入提示词,随使用持续改进,使用所有可用工具比原始模型更好地完成任务,收费 29 美元/月。”@LucasHogie回复:“法律领域需要这个数据层为律师精确地、确定性地调优。这也是一项困难的任务,比你预期的更难。”@DavidWentNomad补充:“用最少 LLM token 创造最多价值的企业将在每个市场中胜出。”

与前日对比: 该主题首次出现在 4 月 21 日(主题 1.7)。今天的对话更加成熟,提出了更具体的领域反对意见(承包商软件很贵但 AI 不会取代它)和一个反命题:增值型 AI 初创公司不是 API 包装器——它们是数据层公司。辩论正围绕单位经济学逐渐明朗化。

1.4 Naval Ravikant 推出面向散户的 AI 风投基金(new)¶

@Polymarket 报道(213 赞,40 回复,18,382 次浏览)Naval Ravikant 推出了一个散户风投基金,提供对 OpenAI、Anthropic 和 xAI 等私人 AI 初创公司的投资敞口,最低投资额 500 美元。该推文是当天浏览量最高的内容。Polymarket 后续指出 Anthropic 今年 IPO 的概率为 54%。

@iPaulLee 提出了一个相关的投资论点(29 赞,1,875 次浏览):"我实际上看好非显而易见的 AI 影响行业中的种子前和种子轮。我认为 AI 将以效率提升和利润增长的形式渗透到一大批尚未创建的初创公司中。"他预测 3-5 年内获得 3-5 倍回报,而非传统的 10-12 年 LP 等待期。

@orrdavid 分析了科技股估值(19 赞,2,368 次浏览):"现在连旧 AI 硬件的租赁价格都在飙升,多头的论点更加可信了。"他的后续分析:"之前:正面 AI 硬件需求下降,严重供过于求,保证熊市。现在:正面 AI 硬件需求下降,我们大致回到原来的位置。反面,事情会变得非常疯狂。"

@business 报道(6,086 次浏览)TD Bank 正在考虑采用罕见的重大风险转移,对冲 AI 基础设施投资带来的数据中心风险敞口。

与前日对比: 4 月 21 日讨论了开源 AI 经济和资金脆弱性。今天转向投资准入层面:散户投资者现在可以用 500 美元买入私人 AI 公司,而机构投资者正通过新型金融工具管理 AI 基础设施风险。

1.5 Blackstar:前 OpenAI Codex 工程师称"软件已被解决"(new)¶

@DanielEdrisian 宣布离开 OpenAI 的 Codex 团队(110 赞,34 收藏,6,191 次浏览)去创建 Blackstar,一家专注于人机交互的硬件公司:"我们相信软件已被解决。构建应用程序现在很容易,但人类与 AI 沟通的下一个有意义的改进需要改变操作系统和硬件。这就是为什么我们要构建一个全新的设备。"该公司完成了由 Abstract Ventures 领投的 1200 万美元种子轮融资,Naval Ravikant、SV Angel、Chapter One 和 Timeless Partners 参投。团队共 8 人,分布在旧金山和深圳。

"软件已被解决"的论点来自一位在 OpenAI 构建 AI 编程工具的人,尤其值得关注。这与 SWE-CI 的发现一致:AI 编程智能体能处理短期任务(构建应用)但在长期工程中失败——暗示价值创造的前沿正从软件转向硬件接口。

与前日对比: 4 月 21 日的物理 AI 主题(1.4)聚焦于 64 亿美元的机器人资金。Blackstar 增添了消费设备维度:不是用于工业工作的机器人,而是用于 AI 交互的新设备形态。

1.6 端侧 AI 进入生产:Atomic Mail + Gemini Nano(new)¶

@testingcatalog 报道(36 赞,19 收藏,3,679 次浏览)Atomic Mail 成为首个通过 Chrome 内置 Gemini Nano 运行 AI 功能的电子邮件产品:"数据不离开你的设备。无服务器调用。零成本。"该功能通过隐私中心设置向所有 Chrome 桌面用户开放。

@sudoingX 分享了本地 AI 采用的实践经验(38 赞,8 收藏,1,319 次浏览):"不再信任公开的 tok/s 声称。不再将 Web UI 作为基准测试表面。不再为可以在自己机器上运行的推理付费。玩本地 AI 和真正运行本地 AI 的区别在于你已经停止做上述哪些事情。"

@tom_doerr 分享了 ZeroClaw(4 赞,4 收藏,328 次浏览),一个用 Rust 编写的个人 AI 助手,可在 10 美元的硬件上运行,内存占用不到 5MB,采用 MIT/Apache 2.0 许可证,有 234 位贡献者。

@ramin_m_h 分享了(25 赞,18 收藏,3,244 次浏览)Shopify CTO Mikhail Parakhin 对 Liquid 模型的认可:"我认为在与 Transformer 的混合形式中,它们可能是我所知的最佳架构,句号。"来自大型科技公司 CTO 的认可表明,超越标准 Transformer 的替代架构正在生产工作负载中获得关注。

与前日对比: 4 月 21 日提到了本地 AI 技术栈(OpenClaw + Gemma 4 + Ollama)。今天从技术栈推荐转向生产里程碑:一个发布的电子邮件产品运行端侧 AI,以及一个在 10 美元硬件上运行的 Rust 助手。本地/端侧 AI 运动正从爱好者阶段向产品阶段过渡。

1.7 加拿大宣布公共 AI 超级计算机引发质疑(new)¶

@EvanLSolomon 宣布(35 赞,90 回复,27 引用,15,965 次浏览)加拿大首台公共 AI 超级计算机:"在加拿大拥有并运营,为各行各业的创新提供动力。从医疗保健到清洁能源,再到在国内扩展的初创公司。"该推文的回复与点赞比异常高(90:35),表明存在显著的反对意见。

@johnxinos发表了最尖锐的回复:"加拿大政府在解决每个问题上都表现得令人难以置信的出色,Phoenix 薪资系统、ArriveCAN、无穷无尽的骗局……我简直迫不及待想看看我们国家的第一台公共 AI 超级计算机会带来什么奇迹。"@henrytheories提出了实际问题:"这台超级计算机有多大(多少 GPU)?要花多少钱?"——但没有得到回答。

与前日对比: 国家 AI 基础设施不是 4 月 21 日的主题。加拿大的公告加入了主权 AI 倡议的增长模式,与同日@NayakSatya_SG报道的印度 AWS/SHI 在 IndiaAI Mission 下的合作并列。

1.8 AI 安全:学术课程、安全评估与监管信号(🡒)¶

@maksym_andr 宣布(39 赞,11 收藏,1,380 次浏览)蒂宾根大学开设新的开源 AI 安全课程,硕士级别,专注于 LLM 和 LLM 智能体,由@sahar_abdelnabi和@jonasgeiping联合授课。

@faststocknewss 报道(30 赞,6,816 次浏览)Microsoft 计划将 Anthropic 的 Claude Mythos 模型纳入其安全开发生命周期,多模型 AI 扫描解决方案预计 6 月发布预览版。Mythos 在评估中表现出"相对于先前模型的显著改进"。

@ThruntingLabs 强调(14 赞,1,546 次浏览)与 Cotool AI 合作,使用真实入侵数据而非合成评估数据进行安全评估:"许多针对前沿模型的 AI 安全评估偏离了目标。它们用合成评估数据来评估真实世界的工作流程,这是在拿苹果比橙子。"

@heynavtoor 继续讨论(4 赞,8 收藏,936 次浏览)Anthropic 关于"大语言模型中的情感概念及其功能"的可解释性论文,作者 Chris Olah 和 Jack Lindsey。研究发现了情感概念的内部表征,这些表征会因果性地影响输出,包括奖励作弊和谄媚的发生率。

与前日对比: 4 月 21 日讨论了 AI 安全的极化(DoD/Anthropic、情感研究、Mythos 安全)。今天增加了教育维度(蒂宾根课程)、企业安全集成(Microsoft/Mythos)和真实世界评估方法论(Cotool/Thrunting Labs)。安全对话继续扩展而非收敛。

2. 令人困扰的问题¶

AI 幻觉在高风险专业场景中出现 -- High¶

Sullivan & Cromwell 承认在联邦法庭文件中存在 AI 幻觉——虚构的案例、捏造的引文、不存在的法规——尽管由收费 2,000 美元以上/小时的合伙人进行了初审和二次审核,这表明即使在高风险环境中,人工监督也无法捕获 AI 错误。@Technimentals声称联邦法院已有超过 1,000 起类似案例。失败模式很具体:AI 生成的内容能骗过表面合理性检查,但包含只有领域专家才能发现的捏造内容,而这些专家越来越信任 AI 输出。(source)

AI 编程智能体技术债务仍未解决 -- High¶

延续自 4 月 21 日。SWE-CI 发现 75% 的模型在维护过程中破坏之前正常运行的代码,这一发现仍在传播。实践者的差距很明显:@fadeone_x认为解决方案是在 CI 中强制执行代码检查器、类型检查器和覆盖率计数器——但这否定了"自主编程"的价值主张。应对策略:将 AI 视为需要人工设计安全护栏的受限工具,而非自主工程师。(source)

面向中小企业的 AI 单位经济学不成立 -- Medium¶

"为本地企业做 AI"的模式面临根本挑战:目标客户(水管工、暖通空调)可能没有 2-3K 美元/月的软件预算可供捕获。@s4rah_dev指出承包商软件可能很昂贵,但"振感编程"出更好解决方案的可能性不大。真正的需求可能是以更低价格提供简单的语音智能体和预约自动化,而非完整的 AI 智能体部署。(source)

X 关闭社区功能扰乱 AI 内容网络 -- Medium¶

@chrisfirst 报道(28 赞,478 次浏览)X 正在移除社区功能,迫使拥有 250,000 名成员的生成式 AI 社区分散到群聊、Substack、Reddit 和 Instagram。这次迁移使平台上最大的集中式 AI 内容网络碎片化。(source)

3. 人们期望的功能¶

可靠的 AI 输出验证用于专业用途¶

Sullivan & Cromwell 的幻觉事件揭示了 AI 生成的专业内容缺乏足够的验证系统。该律所的初审和二次审核都未能发现捏造的引文。所需之物:自动验证工具,能在提交前将 AI 生成的法律引文与实际案例数据库进行比对、标记捏造的引文、验证法规引用。同样的需求适用于医疗、金融和工程领域——AI 输出承载着专业责任。

价格实惠的多模型 AI 编程访问¶

BytePlus ModelArk 的 10 美元/月编程计划,提供 GLM-5.1、Kimi-K2.5、DeepSeek-V3.2 等模型及自动路由功能,引起了多个账号的关注(@SarahAnnabels、@base10_、@hey_abusiddik)。需求信号:开发者希望通过单一订阅访问多个编程模型,而不是管理多个独立的 API 密钥和预算。摩擦点在于模型选择,而非模型访问。

保持时效性的 AI 自动化工作流¶

@milesdeutscher 演示了(39 赞,52 收藏,5,517 次浏览)Perplexity Computer 自动生成每日 AI 研究简报并发送至 Slack 和邮件。@_themarketbrief指出了差距:"我一直看到的唯一差距是时效性。这些深度扫描在研究和趋势方面堪称金矿,但在 AI 新闻、X 情感倾向或市场等快速变化的内容上,它们经常拉取过时新闻。有人攻克了实时版本吗?"

对企业 AI 部署成本的诚实评估¶

@vasuman 描述了(5 赞,373 次浏览)Varick 模式:4 周审计,4 周构建,持续改进。客户反馈:"比 McKinsey 好 100 倍。"但没有人发布过跨行业的企业 AI 部署标准化成本和时间线基准测试。"接入 AI"的承诺与审计优先的现实之间的差距仍未被记录。

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| Perplexity Computer | AI 自动化平台 | (+) | 自动生成每日研究简报至 Slack/邮件;替代手动 VA 工作流 | 快速变化话题的时效性差距;过时新闻风险 |

| BytePlus ModelArk Coding Plan | 多模型编程订阅 | (+) | 10 美元/月获取 GLM-5.1、Kimi-K2.5、DeepSeek-V3.2+;自动路由;无限流 | 新产品;真实质量与基准测试对比未知 |

| Opik Test Suites | 智能体回归测试 | (+) | 从追踪中自动构建测试;自然语言规则;全生命周期平台 | 新功能;采用情况不明 |

| Gemini Nano (Chrome) | 端侧 LLM | (+) | 零成本推理;数据不离开设备;所有 Chrome 桌面用户可用 | 仅限 Chrome;模型能力与云端模型的差距 |

| ZeroClaw | 本地 AI 助手 | (early) | Rust 编写;内存不到 5MB;可在 10 美元硬件上运行;MIT/Apache 2.0;234 位贡献者 | v0.7.1;能力范围不明确 |

| Liquid Models | 替代架构 | (+) | Shopify CTO 认可;混合 Transformer 形式;适合生产用例 | 公开基准测试有限;认可处于早期阶段 |

| Cotool AI | AI 安全评估 | (+) | 使用真实入侵数据而非合成数据;在真实工作流上评估前沿模型 | 合作阶段;未广泛可用 |

| Claude Mythos | AI 安全扫描 | (+) | 在 Microsoft SDL 评估中"显著改进";多模型方法 | 预览版预计 6 月发布;尚未发货 |

| Google Deep Research Max | AI 研究工具 | (+) | 深度网络研究 93% 对比 GPT 5.4 的 88%;可连接私有公司数据 | 单一基准测试来源;独立验证待定 |

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 阶段 | 链接 |

|---|---|---|---|---|---|

| Blackstar | @DanielEdrisian(前 OpenAI Codex) | 用于人机 AI 交互的新硬件设备 | 软件界面限制 AI 沟通;需要操作系统/硬件变革 | Seed ($12M) | announcement |

| Atomic Mail + Gemini Nano | @atomic_mail | 通过 Chrome 内置 LLM 实现端侧 AI 邮件功能 | 云端 AI 邮件功能泄露用户数据 | Shipped | post |

| ZeroClaw | @zeroclawlabs | 基于 Rust 的个人 AI,可在 10 美元硬件上运行,内存不到 5MB | 本地 AI 需要昂贵硬件 | Alpha (v0.7.1) | GitHub |

| Opik Test Suites | @gidim / Comet | 从智能体追踪中自动生成回归测试 | 没有系统能防止智能体在生产中出现回归 | Shipped | post |

| Varick | @vasuman | 审计优先的企业 AI 部署(4 周审计,4 周构建) | 通用 AI 工作流在企业边缘案例中失败 | Active | post |

| PulseBench-Tab | @Hersh_Desai / Pulse AI + S&P Global | 开源表格提取基准测试;T-LAG 指标 | 现有表格解析指标混淆了格式错误和结构错误 | Published | post |

| Humyn Labs | @tomatofroots | 面向 AI 的人类数据基础设施:经审核的贡献者、可审计的工作流 | 高质量人类数据是 LLM 评估和机器人技术的瓶颈 | Active | post |

| Open Generative AI | @aiedge_ | 包含 200+AI 模型的开源仓库,用于图像/视频生成 | 商业工具有内容过滤器和订阅费用 | Shipped | GitHub |

| 加拿大公共 AI 超级计算机 | @EvanLSolomon | 国家 AI 算力基础设施 | 加拿大 AI 公司缺乏国内算力 | Announced | post |

6. 新动态与亮点¶

Chip Huyen 的 AI 工程配套仓库走红¶

当天得分最高的内容,遥遥领先。@techNmak 分享了(125 赞,202 收藏,6,572 次浏览)Chip Huyen 为其 AI Engineering 一书制作的开源配套仓库。202 次收藏对比 125 次点赞的比例显示出强烈的"先收藏稍后看"的实用性信号。内容包括 10 个章节摘要(从基础模型到架构)、学习笔记、来自生产系统的提示词示例、公司案例研究、ML 理论基础,以及来自 LinkedIn、Uber、Netflix、Google、DoorDash 等的精选工程博客。

Tesla 在上海申请使用字节跳动豆包的车载语音 LLM¶

@zhongwen2005 报道(45 赞,11,209 次浏览)特斯拉(上海)有限公司于 4 月 20 日申请了车载语音大语言模型服务。@shanghaidaily 确认(198 次浏览)该语音助手将集成字节跳动的豆包 LLM。这使 Tesla 的中国业务能够在车辆中直接部署生成式 AI,使用国内中国模型而非美国替代方案。

McKinsey:50% 的美国医疗领导者已实施生成式 AI¶

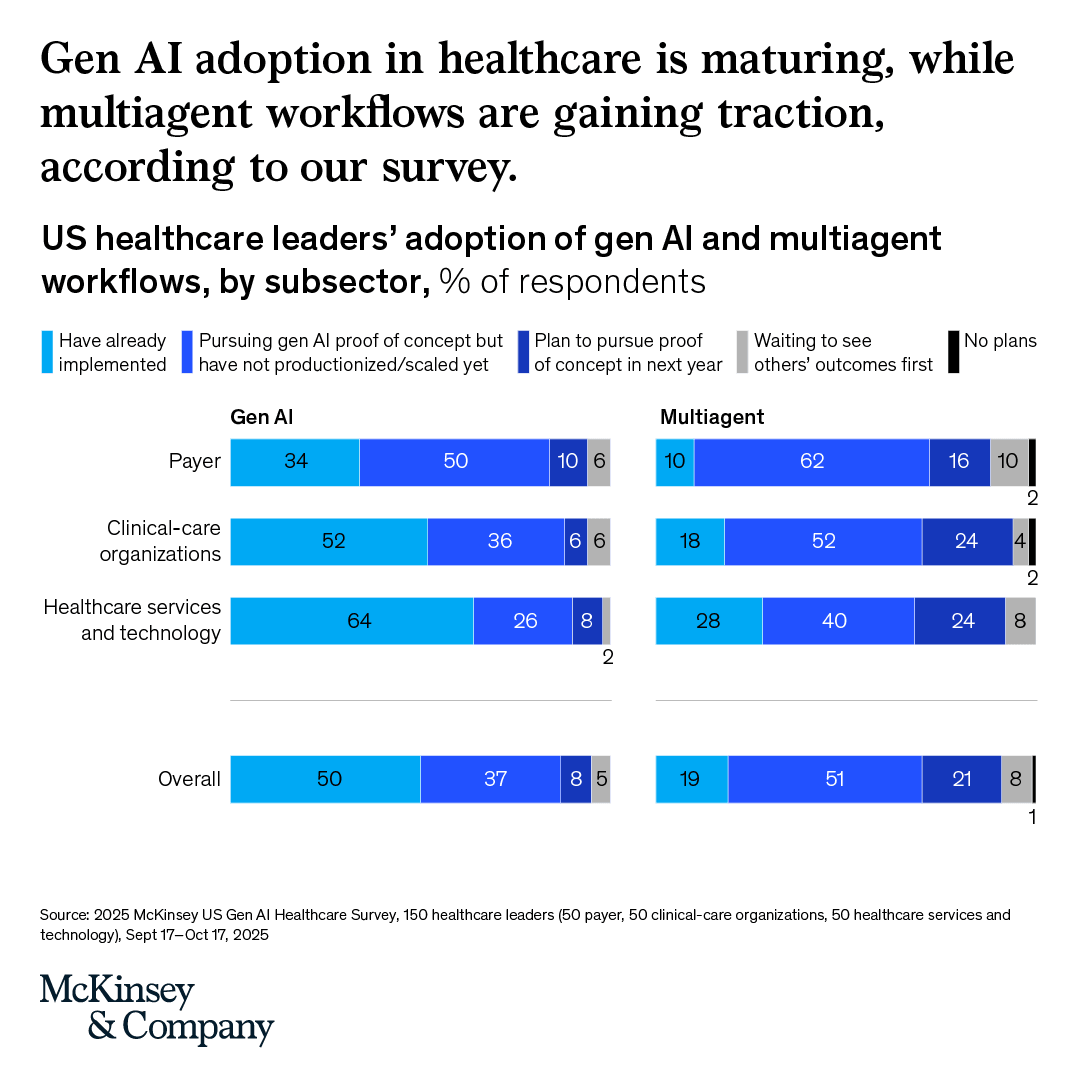

@McKinsey 发布了调查结果(1,568 次浏览),调查对象为 150 位美国医疗领导者:50% 已经实施了生成式 AI,80% 以上已将首批用例部署给终端用户。医疗服务和技术领域以 64% 的实施率领先,而多智能体工作流则更早期:总体 19% 已实施,51% 在概念验证阶段。

Google Cloud Next 展示完整的智能体化技术栈¶

@googlecloud 分享了(12 赞,561 次浏览)其 Cloud Next 主题演讲的完整技术栈:Agentic Taskforce、Agentic Platform and Models、Agentic Defense、Agentic Data Cloud 和 AI Hypercomputer。另外,@CNBCTV18Live 报道(1,749 次浏览)Tata Steel 与 Google Cloud 合作开发统一的智能体化 AI。

Kimi K2.6 攀升编程排行榜¶

@jacobayoka 指出月之暗面的 Kimi K2.6——一个 1 万亿参数的模型——登上了 OpenRouter 编程排行榜榜首,在编程基准测试中击败了 Claude 4.6 和 GPT-5.4。@CGenai25884 补充Kimi K2.6"运行 300 个并行智能体,可持续执行 12 小时以上。"

X 为自定义时间线添加 AI 功能,让用户困惑¶

@icreatelife 报道(10 赞,312 次浏览)X 在其自定义时间线"暂停话题"功能中添加了人工智能选项。该实现方式违反直觉:用户必须不选择 AI 才能阅读 AI 相关内容,因为该功能列出的是要隐藏的话题而非关注的话题。

7. 机会在哪里¶

[+++] 面向专业领域的 AI 输出验证 -- Sullivan & Cromwell 的幻觉事件,加上@Technimentals声称联邦法院有 1,000 多起类似案例,揭示了巨大的验证空白。收费 2,000 美元/小时的律所无法通过人工审核可靠地发现 AI 捏造内容。能够将 AI 生成的法律引文、医疗参考文献或金融声明自动与权威数据库进行验证的工具,将服务于一个失败成本为诉讼、医疗事故或监管行动的市场。Microsoft 将 Claude Mythos 集成到其安全开发生命周期中,表明企业对 AI 驱动的验证有强烈需求。(source, source)

[++] 端侧和边缘 AI 产品 -- Atomic Mail 基于 Gemini Nano 发布产品、ZeroClaw 在 10 美元硬件上以不到 5MB 内存运行、以及@sudoingX对本地推理的实践采用,都表明端侧 AI 正从实验走向产品。浏览器原生 LLM(Chrome)、超轻量运行时(Rust/ZeroClaw)和 Shopify CTO 对 Liquid 替代架构的认可三者的融合,表明端侧 AI 的基础设施层正在成熟。隐私敏感的垂直领域(邮件、医疗、法律)是自然的首选市场。(source, source, source)

[++] 审计优先的企业 AI 部署 -- @vasuman的 Varick 模式(4 周审计+4 周构建+持续改进)和@levie的论述——"公司有需要现代化的遗留技术栈、分散在大量碎片化工具中的数据、未被捕获或数字化的知识"——指向一个咨询型机会。传统公司(McKinsey、Deloitte)适应缓慢;Varick 声称客户反馈"比 McKinsey 好 100 倍"。市场是每一家知道应该部署 AI 但无法内部执行的大公司。(source)

[+] 多模型 AI 编程平台 -- BytePlus ModelArk Coding Plan(10 美元/月获取多个模型及自动路由)引起了至少三个独立账号的关注。需求模式:开发者想要一个能智能路由到最佳模型的单一订阅,而不是管理各个独立的 API 密钥。自动路由层——将任务匹配到模型——是具有防御性的组件。(source, source)

[+] AI 智能体回归测试基础设施 -- Opik 从智能体追踪中自动生成测试套件,解决了 SWE-CI 量化的差距:没有好的系统能防止 AI 智能体在生产中出现回归。随着智能体部署规模扩大,测试层成为关键基础设施。构建轻量级、CI 集成的 AI 生成代码变更质量检查的团队,将覆盖每一个发布 AI 辅助代码的工程团队。(source)

8. 要点总结¶

-

Sullivan & Cromwell 向联邦法官承认,AI 生成的法庭文件包含虚构的案例名称、捏造的引文和不存在的法规——尽管由收费 2,000 美元以上/小时的合伙人进行了初审和二次审核。 该律所通过人工审核未能发现幻觉,表明仅靠人工监督不足以应对 AI 生成的专业内容。据报道联邦法院已有超过 1,000 起类似案例。(source)

-

SWE-CI 的发现持续传播:75% 的 AI 编程智能体在维护过程中破坏之前正常运行的代码,实践者以安全护栏工作流(代码检查器、类型检查器、覆盖率计数器)而非自主编程来应对。SpaceX 另行获得了以 600 亿美元收购 Cursor 的选择权,表明 AI 编程基础设施已成为战略收购目标。(source, source)

-

"为本地企业做 AI"的模式面临日益增长的单位经济学质疑。 核心挑战:目标中小企业客户可能没有 2-3K 美元/月的软件预算。新兴反命题:增值型 AI 公司通过领域特定数据层和工具集成实现差异化,而非原始模型访问。"用最少 LLM token 创造最多价值的企业将在每个市场中胜出。"(source, source)

-

Naval Ravikant 推出散户风投基金,以最低 500 美元提供对私人 AI 公司(OpenAI、Anthropic、xAI)的投资敞口,同时 Polymarket 显示 Anthropic 今年 IPO 概率为 54%。 AI 投资正在散户层面实现民主化,而机构投资者(TD Bank)则通过新型金融工具管理 AI 基础设施风险敞口。(source)

-

端侧 AI 达到生产里程碑:Atomic Mail 基于 Chrome 的 Gemini Nano 发布零成本、零数据泄露的 AI 功能,而 ZeroClaw 在 10 美元硬件上以不到 5MB 内存运行个人 AI 助手。 Shopify CTO 认可 Liquid 模型在混合 Transformer 形式中"可能是我所知的最佳架构",表明替代架构正在获得生产层面的认可。(source, source, source)

-

一位前 OpenAI Codex 工程师宣称"软件已被解决",并筹集了 1200 万美元来构建 Blackstar,一个用于人机 AI 交互的新硬件设备。 其论点:AI 已将应用构建商品化,因此价值的前沿在于新的设备形态,而非软件工具。8 人团队分布在旧金山和深圳。(source)

-

McKinsey 调查数据显示 50% 的美国医疗领导者已实施生成式 AI,80% 以上已将首批用例部署给终端用户。 多智能体工作流更早期:19% 已实施,51% 在概念验证阶段。医疗服务和技术细分领域以 64% 的实施率领先。(source)

-

Microsoft 将把 Anthropic 的 Claude Mythos 集成到其安全开发生命周期中,预览版预计 6 月发布。 另外,Cotool AI 与 Thrunting Labs 合作使用真实入侵数据而非合成基准测试进行安全评估,蒂宾根大学开源了一门专注于 LLM 和智能体的硕士级 AI 安全课程。AI 安全正从话语层面走向制度基础设施。(source, source, source)