Twitter AI - 2026-04-26¶

1. 人们在讨论什么¶

1.1 智能体式 AI 基础设施重估半导体供应链 🡕¶

智能体式 AI 的建设不再只是芯片故事——它正在重估从推理芯片到先进封装再到能源的每一层。@Ren_aramb 拆解了这场结构性转变(13 点赞,1,819 浏览量,11 收藏),并引用自己在一家大型企业担任 Head of AI 的一手经验:“仅今年,我们投向智能体式 AI 的预算分配就呈指数级增长,同时削减其他地方的成本来为它筹资。”这条讨论串梳理了完整供应链:推理芯片(Google TPU v8、Broadcom、Marvell)、晶圆代工(TSMC 在 3nm/2nm 上是无法绕开的瓶颈)、封装(CoWoS 结构性供不应求,Intel EMIB 正成为替代方案)、内存(HBM3e)和光子学。

@DanielTNiles 提供了市场层面的视角(126 点赞,8,023 浏览量):SOX Index 上周上涨 10%——连续 18 个交易日上涨,这段时间累计 +49%。他预计“智能体工作负载激增,将推动 MSFT Azure、AMZN Web Services 和 GOOGL Cloud 的 AI 驱动型 hyperscaler 收入加速增长”。不过,他也提示了近期风险:半导体价格飙升、油价上涨(WTI 94 美元),以及技术面超买后可能出现浅度回调。

@mikalche 把能源依赖放到中心(5 点赞,1,791 浏览量):“AI 从来都不是芯片故事。它是能源 + 电网故事。”白宫已将电网基础设施宣布为国防必需,2-4 年的变压器交付周期和对外国供应的依赖,都是硬性限制。

@HedgeMind 重点提到 AMD(6 点赞,3,640 浏览量)创下 5670 亿美元市值的新高,并把催化因素归因于“智能体式 AI 带来的结构性转变,正在造成高性能服务器 CPU 的供应紧张”。

与前日对比: 4 月 25 日讨论了算力约束从技术瓶颈转向横跨 11 个硬件子行业的投资论点。今天的分析更深:有企业一线预算增长作为确认,具体封装瓶颈数据出现(MediaTek 为 Google TPU 订单请求 7 倍 CoWoS 增量),能源层也进入叙事,并被提升为国家安全优先事项。

1.2 AI 评估继续碎片化为不同类别 🡕¶

评估层继续快速扩张。@s_batzoglou 发布 ProofGrid(5 点赞,2,952 浏览量),这是一个用机器可检查证明而不是最终答案测试 LLM 的推理基准。论文(Arkoudas 和 Batzoglou 的 “Stress-Testing the Reasoning Competence of LLMs With Proofs under Minimal Formalism”)涵盖 15 个任务和 3,000+ 道题,测试了从 GPT-4o 到 GPT-5.4、Gemini-3.1 的 24 个模型。关键发现:前沿模型在基础任务上表现出“惊人的快速进步”,但在全局组合推理上仍有“尖锐的剩余局限”。论文还提出了 Epistemic Stability Index(ESI),用于衡量跨上下文一致性。

@RituWithAI 宣布 WorldMark(5 点赞,184 浏览量,6 收藏),这是 Alaya Studio 推出的统一互动视频世界模型基准。每个领先的视频世界模型(Sora、Genie、YUME、HY-World、Matrix-Game)此前都在自己的私有基准、私有场景上被评估。WorldMark 给每个模型同样的 500 个评估案例,配备标准化 WASD 风格控制、三个难度层级,以及第一/第三人称视角。他们还推出了 World Model Arena,用于公开实时头对头对战。

@HuggingPapers 报道(27 点赞,2,751 浏览量)OpenAI 在 Hugging Face 发布 HealthBench Professional——由医生策划的医学对话,按专科使用 rubric 评分。有回复指出:“大多数医疗 AI 评估失败在临床推理风格上,而不是事实回忆。”

@AlexWingfield_ 描述了企业评估缺口(1 点赞,14 浏览量):“企业 LLM 正以最蠢的方式失败——不只是幻觉,还会弄坏 JSON、躲避工具,并且过度道歉。修复方式是把‘测试’变成完整的 AI 评估栈。”

与前日对比: 4 月 25 日把三个评估工具(用于智能体评分的 Laureum、ProofGrid、HealthBench)视为类别正在凝结的证据。今天新增了面向视频世界模型的 WorldMark 和企业评估缺口,确认这个类别并不是合并为单一框架,而是按领域碎片化(推理、医疗、视频、企业)。

1.3 中国开源 AI 实验室高速交叉借鉴 🡒¶

@piyush784066 捕捉到这种动态(11 点赞,329 浏览量):“kimi 用 deepseek 的 v3 架构发布 k2.6——同一周 deepseek 又用 kimi 的 muon optimizer 发布 v4——1.6 万亿参数和 1M 上下文——两者在基准测试上都追平或超过闭源模型,同时便宜 8 倍……真正的战斗已经确认,就是开源 vs 闭源。”

@witcheer 从实践者角度评价 Qwen 3.6-27B(2 点赞,220 浏览量):SWE-bench verified 得分 77.2,超过旧的 397B MoE,并能在 24GB VRAM 上运行。但作者的实际用例是 Qwen 3.5:4B 做上下文压缩——“当对话变长时,4b 模型会把较早轮次总结到原始长度的 20%,让主模型保留有用的工作窗口。”值得注意的是,Alibaba 在 4 月 20 日把 Qwen 3.6-max-preview 作为闭源权重发布——这是一次只保留旗舰模型闭源的转向。

@prpatel05 指出(4 点赞,145 浏览量):“DeepSeek 刚发布 V4。1.6 万亿参数。完全开源。他们称它在智能体式编程基准上超过 Claude、GPT-5.4 和 Gemini。开源和闭源 AI 的差距每个季度都在缩小。”

与前日对比: 4 月 25 日从 DeepSeek-V4 发布兴奋转向第一轮实质性批评——基准持平不等于真实可用性。今天的讨论把 Qwen 3.6 加入进来,并呈现了一个实际使用模式(用小模型做上下文压缩),展示本地 AI 实践者如何在标题式基准之外部署这些模型。

1.4 企业 AI 采用出现具体数字 🡕¶

@rohanpaul_ai 分享了 JPMorgan CEO Jamie Dimon 的说法(83 点赞,10,710 浏览量):“我们把 AI 用于风险欺诈、营销、承保、记笔记、广告生成、错误报告、减少错误,一共有 600 个用例,其中 50 个我会放进重要类别。AI 可能创造四天工作周。”回复中的反驳立刻出现:“每条 AI roadmap 都承诺四天工作周。积压事项说明了另一回事。”

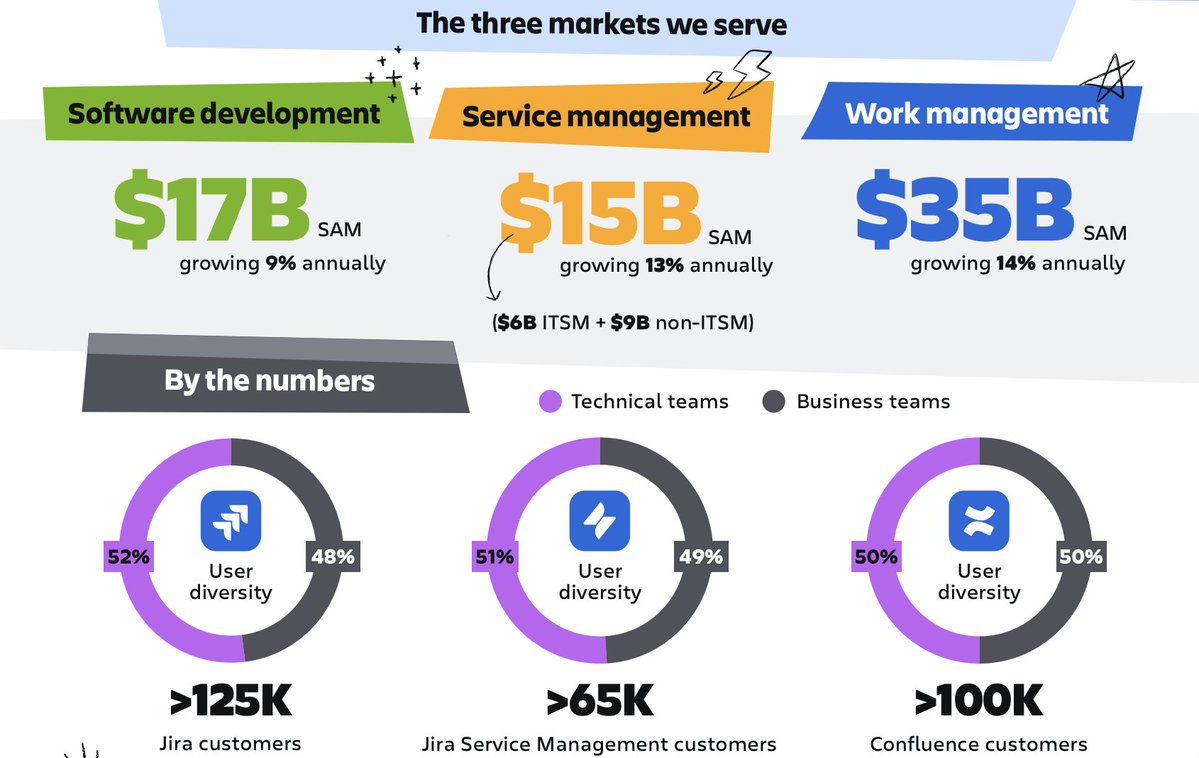

@JaredSleeper 发布了他的软件公司 AI 拆解系列第 32 天(11 点赞,2,014 浏览量,8 收藏),主题是 Atlassian($TEAM)。股价从 2021 年 10 月峰值 458 美元跌至今天的 71 美元(-84%)。AI 熊市论点:SWE 席位数下降会威胁基于席位的定价,且随着智能体取代软件构建中的人类协调,整个类别会被颠覆。AI 牛市论点:Atlassian 是最大规模的软件开发上下文系统。管理层关键数据:使用 AI 编程工具的客户会创建多 5% 的 Jira 任务,MAU 高 5%,席位扩张快 5%。

@chiefmartec 预览了 State of Martech 2026 报告(6 点赞,716 浏览量,4 收藏),展示 Content & Experience AI 用例的 Build vs. Buy 散点图。Brand Voice & Style Enforcement 单独位于 Build-Leaning 象限——“这是一个没人解决的类别所呈现出的视觉签名。”B2C 的 build-to-buy 比例显著高于 B2B:“当 AI 输出本身就是品牌体验时,B2C 营销人员拒绝外包。”

与前日对比: 4 月 25 日把企业 AI 框定为控制层 vs. 被颠覆对象(ServiceNow 论点)。今天加入了 JPMorgan 的具体采用数字(600 个用例)、Atlassian 的反直觉发现(AI 用户创建更多 Jira 任务而不是更少),以及 martech Build vs. Buy 数据,显示企业在哪些地方拒绝外包给供应商。

1.5 AI 安全与治理撞上真实世界事件 🡕¶

南非通信部长 Solly Malatsi 在承认政策本身使用 AI 起草后,撤回了 Draft National AI Policy(14 点赞,2,386 浏览量)。@HeidiGiokos 报道:“部长说南非人理应得到更好的结果。负责起草和质量保证的人将接受后果管理。”

@romanyam 指出(10 点赞,465 浏览量),Future of Life Institute 发布了一支关于他 AI safety 工作的视频:“我们无法理解、预测、解释或控制的系统,不应被当作只是营销更好一点的普通软件。”

@FrankLuntz 批评了一条病毒式传播的说法(10 点赞,2,222 浏览量),即 AI 系统“得出疫苗会导致自闭症的结论”,称其为“当人工智能取代了真正的智能”。他随后引用 Brandolini's Law:“反驳胡说所需的能量,比制造胡说所需的能量大一个数量级。”回复称:“美国需要提升自己的 AI 素养。”

@peligrietzer 分享了(5 点赞,309 浏览量,6 收藏)Columbia 社会学家 Anna Thieser 发布在 LessWrong 上的一份 AI safety 领域合著网络分析,梳理该社区的研究结构。

@awgaffney 提出了一个医疗安全担忧(6 点赞,388 浏览量):“医疗中用来防止 AI 幻觉的所谓安全检查之一是由人类专家验证:如果随着 AI 使用增加,医生知识基础萎缩……错误风险会增加,而不是减少。”

与前日对比: 4 月 25 日讨论了 AI 治理通过工作坊和工具批评变得具体。今天升级为真实世界事件:一个国家政府撤回 AI 起草的 AI 政策,一位知名民调专家点名 AI 放大的错误信息,以及随着 AI 依赖增加,人类验证能力会退化的结构性担忧。

1.6 开源 AI 硬件与本地优先设备 🡕¶

多条帖子都集中在开源 AI 硬件上。@itsLORDROY 称赞 OpenHome(34 点赞,11,489 浏览量):“下一波 AI 不会只有 app,还会是设备。本地优先 AI、定制硬件、开源、真正的开发者工具。1000+ 贡献者公开构建,这很强大。”DevKit 对有想法的创始人免费。@snskritinaruka 呼应(9 点赞,15,188 浏览量):“硬件很难,但开源 AI 设备是前沿。”

@_vmlops 重点介绍(5 点赞,218 浏览量,4 收藏)一个带 200+ 模型(Flux、Sora、Kling、Midjourney、Veo)的开源生成式 AI studio——“你每月为 midjourney 支付 30 美元,而这个 github repo 安静地免费躺在那里。”支持 text-to-image、image-to-image、text-to-video、lip sync,以及一次使用 14 张参考图。

与前日对比: 4 月 25 日没有专门的开源硬件主题。这是一个新集群,由 OpenHome 的社区牵引力(1,000+ 贡献者)和减少云依赖的本地优先 AI 大趋势推动。

1.7 生成式 AI 创作反弹继续 🡒¶

Blender vs. AI 的争论在 @DiscussingFilm 报道 Backrooms 电影使用 Blender 做概念艺术和布景设计时浮出水面。@vanillaopinions 反应(12 点赞,1,445 浏览量):“所以我们现在开始庆祝人工智能被使用了吗。”随后出现多条纠正:@shwnxtd00r 澄清(11 点赞,173 浏览量):“生成式 AI 和 blender 的区别在于,你确实需要创作出口才能完成设计,而不是输入提示词。”

@infinitethird 指向更深层的损失(13 点赞,709 浏览量):“还记得那个家伙手绘动画电影向女友求婚的视频吗?那是真的有意义。”批评的重点不是能力,而是当创作努力被提示词取代时,意义会被侵蚀。

@_overment 给出开发者的异议(3 点赞,201 浏览量):“尽管我对生成式 AI 极度热情,但我仍然看不到近期会出现一个能生成可靠软件的自动化程序员。”

与前日对比: 4 月 25 日没有专门的创作反弹主题。Blender/Backrooms 事件触发了围绕工具辅助创作与提示词驱动生成之间持续张力的一阵集中讨论。

2. 令人困扰的问题¶

GPU 获取不平等正在挤压 AI 创业公司 -- High¶

@theinformation 独家报道(3 点赞,1,695 浏览量,3 收藏),云服务商将供应保留给 OpenAI、Anthropic 和内部使用,导致 AI 创业公司获取 Nvidia GPU 时面临更高价格和数月等待。@Impact177 指出(3 点赞,11 浏览量):“2026 年 Q1 流入 AI 创业公司的资金达到 267,000,000,000 美元。这比历史上任何一个季度都高出一倍以上。”矛盾在于:创纪录资金流入 AI 创业公司,但它们所需的算力正被既有巨头和 hyperscalers 囤住。

用 AI 起草 AI 政策,随后被撤回 -- Medium¶

南非的 Draft National AI Policy 被撤回,此前政府承认起草过程中使用了 AI。一条回复捕捉到这种挫败感:“组织必须开始教员工如何合乎伦理地使用 AI。否则我们要有大麻烦。”这个事件说明,写规则的机构内部,在 AI 治理雄心与基本 AI hygiene 之间存在差距。

AI 生成内容削弱人类验证能力 -- Medium¶

@awgaffney 警告(6 点赞,388 浏览量),随着 AI 使用上升,人类验证这道安全检查会退化:“如果医生知识基础萎缩……错误风险会增加,而不是减少。”@TRTRE62 在招聘中观察到同样模式(6 点赞,1,816 浏览量):“2026 年的简历会为了 LLM 筛选、排序、总结和解释而塑形。评估制度已经变了。”两者都指向一个反馈回路:围绕 AI 优化会削弱人类发现 AI 错误的能力。

企业 AI 定价投资回避了真正交出控制权的地方 -- Medium¶

@sijlalhussain 分析(11 点赞,245 浏览量)McKinsey 的一项发现:企业定价中影响最高的领域(交易配置、折扣治理、续约)与组织正在投资的地方并不一致。“真正的挑战不是识别高影响用例,而是投资到必须真正交出权限的地方。”

3. 人们期望的功能¶

面向视频世界模型的统一基准基础设施¶

@RituWithAI 指出了缺口:“每个 AI 视频世界模型都在自己批改自己的作业。”Sora、Genie、YUME、HY-World 和 Matrix-Game 各自使用私有基准、私有测试场景和私有指标。WorldMark 用标准化评估(500 个案例、统一控制、公开 arena)回应了这个问题,但更广泛的需求仍存在于其他 AI 子领域,在那些领域自我评估仍是常态。紧迫性:High。(source)

具备 AI 素养的治理框架¶

南非事件(AI 起草 AI 政策)和 Frank Luntz 对 AI 放大错误信息的干预都指向同一个缺口:机构缺乏使用、评估或监管 AI 系统的基本 AI 素养。需求不是更多政策论文,而是政府机构内部具备可操作的 AI 能力。紧迫性:High。(source, source)

面向医疗 AI 工作流的轨迹级安全¶

@Symbioza2025 在多条帖子中主张(3 点赞,113 浏览量),医疗 AI 需要外部轨迹可观测性——“不是替代临床医生,不是控制模型,而是监控工作流在以下链路中是否保持稳定:临床输入 -> AI 推理 -> 人类纠正 -> 面向患者的输出 -> 后续使用。”这个需求把 4 月 25 日的异常管理论点延伸到可观测性层。紧迫性:High。(source)

超越幻觉检测的企业 AI 评估栈¶

@AlexWingfield_ 指出,企业 LLM 会以很日常的方式失败——弄坏 JSON、躲避工具、过度道歉——这些完全不是以幻觉为中心的评估能覆盖的。需求是:完整评估栈,覆盖指令遵循、工具使用、格式遵守和行为一致性。紧迫性:Medium。(source)

4. 使用中的工具与方法¶

| 工具 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| ProofGrid | LLM 推理基准 | (+) | 机器可检查证明、15 个任务、3000+ 道题;Epistemic Stability Index(ESI);测试 24 个模型 | 聚焦形式推理;不覆盖真实世界任务表现 |

| WorldMark | 视频世界模型基准 | (+) | 统一 WASD 控制、500 个评估案例、3 个难度层级;warena.ai 上有实时 World Model Arena | 新基准(4 月 24 日预印本);模型团队是否采用尚不清楚 |

| HealthBench Professional | 医疗 AI 评估 | (+) | 医生策划的 rubrics、专科特定评分、安全护栏;在 Hugging Face 上 | 可能在分布外患者人群上失效 |

| SPLIT | LLM 引导方法 | (+) | 统一微调、LoRA、activation edits;在 log-odds 尺度上分离偏好与效用 | 学术研究;生产集成不清楚 |

| PSAISuite | 多提供商 AI 接口 | (+) | PowerShell 模块、15+ 提供商、内置基准套件、provider-neutral | PowerShell 生态限制其触达 Windows/.NET 用户 |

| Voice-Pro | 语音/翻译/配音 | (+) | Whisper + F5-TTS + CosyVoice;YouTube 处理;zero-shot voice cloning;开源 | 设置复杂;实时性能需要 GPU |

| Open Generative AI Studio | 多模型创意套件 | (+) | 200+ 模型;text-to-image/video、lip sync;可自托管;免费 | 自托管需要大量算力 |

| Humanizer(Claude Code skill) | AI 写作去伪装 | (+) | 检测 29 种 AI 写作模式;voice calibration;基于 Wikipedia 的 “Signs of AI writing” | 效果取决于源文本质量 |

| FutureAGI | AI 生命周期平台 | (+) | 端到端:仿真、评估、保护、监控、可观测性、gateway、优化 | 刚开源;生产采用不清楚 |

评估层仍是最活跃的工具类别。ProofGrid、WorldMark 和 HealthBench 分别针对不同评估维度(推理、视频、医疗),而 PSAISuite 回应了对 provider-neutral AI 编排不断增长的需求。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| WorldMark + World Model Arena | Alaya Studio(@RituWithAI) | 带实时公开 arena 的互动视频世界模型统一基准 | 每个视频世界模型都在私有基准上自己给自己评分 | 标准化 WASD 控制、500 个 eval cases、warena.ai | Released | post |

| ProofGrid | Arkoudas & Batzoglou(System 2 Labs、Seer) | 用机器可检查证明测试 LLM 推理的基准 | 基准只测最终答案,不测推理路径 | 15 个任务、3000+ 道题、ESI 指标 | Published | post |

| OpenHome DevKit | @JesseRank / OpenHome | 带本地 AI、空间模型和 PCB 设计的开源 AI 硬件设备 | AI 设备封闭、依赖云、原型成本高 | 本地 AI、定制空间模型、firmware、iOS app、cloud SDK | Alpha(DevKit) | post |

| AIRecon / RedTeam-Agent | @Dinosn / ktol1 | 面向渗透测试和红队工作流的自主网络安全智能体 | 手动逐工具安全评估速度慢 | Ollama LLM + Kali Linux Docker + 15 个工具 | Open source | post |

| ULTRASHIP | @Dinosn | Claude Code plugin:39 个技能、33 个工具、11 个 agents,用于可交付工作流 | 开发者缺少集成式规划/审查/安全能力的编程智能体 | Claude Code plugin、MIT license、180 tests | Shipped | post |

| PSAISuite | @dfinke | 面向 15+ 提供商的 provider-neutral AI 集成 PowerShell 模块 | 应用逻辑绑定单一 AI provider | PowerShell、benchmark suite | Shipped | post |

| ASA(trajectory observability) | @Symbioza2025 | 面向医疗中长时程 AI 系统的外部轨迹可观测性 | 缺少对 AI 工作流长期稳定性的监控 | Not disclosed | Pre-launch | post |

| Humanizer | blader(via @oliviscusAI) | 去除 AI 写作模式的 Claude Code skill;检测 29 种模式 | AI 生成文本可被检测且听起来不自然 | Claude Code skill、基于 Wikipedia 模式 | Shipped | post |

评估集群(ProofGrid、WorldMark、HealthBench)延续了 4 月 25 日的模式:多个团队正在为 AI 质量的不同维度构建评估工具。网络安全集群(AIRecon、RedTeam-Agent、ULTRASHIP)则是一个新模式——开发者正在构建把本地 LLM 与传统渗透测试工具链结合起来的自主安全智能体。

6. 新动态与亮点¶

已倒闭创业公司数据清算现在有了市场¶

[++] @Forbes 详细报道(9 点赞,8,347 浏览量),SimpleClosure 正在推出 Asset Hub,一个面向已倒闭创业公司数据的市场。cielo24 因 13 年的 Slack 档案、Jira 工单和邮件线程获得了“数十万美元”。OpenAI 前首席科学家 Ilya Sutskever 指出,AI 实验室在 2024 年底已经耗尽公共互联网数据。文章把真实工作互动产生的运营数据称为“AI agents 的化石燃料”——这是训练能真正做事、而不只是回答问题的模型所必需的。

南非撤回由 AI 起草的 AI 政策¶

[++] 南非通信部长在承认 AI 被用于起草后,撤回了 Draft National AI Policy。部长承诺落实“后果管理”。这是已知首个国家政府公开撤回一项 AI 政策,原因正是 AI 被用于政策创建本身——一个递归式治理失败,说明机构内部的 AI 雄心与 AI 能力之间存在差距。

美国国务院下令全球推动反击中国 AI IP 盗窃¶

[+] @NEWSMAX 报道(25 点赞,3,448 浏览量),美国国务院下令在全球范围内强调“中国公司为窃取美国人工智能实验室知识产权所做的广泛努力”。这把地缘政治 AI 竞争叙事从技术管制升级为主动外交行动。

Qwen 3.6-27B 发布,Alibaba 将旗舰转向闭源权重¶

[+] @witcheer 记录(2 点赞,220 浏览量),Qwen 3.6-27B 发布后在 SWE-bench verified 得分 77.2(超过旧的 397B MoE),并可在 24GB VRAM 上运行。与此同时,Alibaba 在 4 月 20 日悄悄发布闭源权重的 Qwen 3.6-max-preview——一次“只保留旗舰闭源”的转向:开放权重层继续 Apache 2.0,但最佳模型保留为专有访问。

7. 机会在哪里¶

[+++] 按领域划分的 AI 评估基础设施——一天内出现四种不同评估工具(ProofGrid 面向推理、WorldMark 面向视频、HealthBench 面向医疗、企业 eval 面向指令遵循)。每个领域都需要自己的基准,因为通用评估会漏掉特定领域失败模式。构建跨领域评估编排层的组织——让企业通过单一接口运行特定领域 evals——将捕获一个结构性需求。(source, source)

[+++] 能源和电网基础设施成为 AI 的约束上限——白宫将电网基础设施宣布为国防必需。变压器交付周期达 2-4 年。CoWoS 封装结构性供不应求。讨论已经从“受算力约束”转向“受能源约束”——政策也通过 Defense Production Act 机制推动周期向前。为 AI 数据中心解决发电、电网现代化和先进封装的公司,正在处理下一个约束上限。(source, source)

[++] 本地优先 AI 硬件与开源开发者工具——OpenHome 的 1,000+ 贡献者和面向创始人的免费 DevKit,显示市场需要无需云依赖即可本地运行的 AI 设备。AI 硬件类别一直由封闭产品主导;一个有真实社区牵引力的开源替代品,可能成为“AI 时代的 Raspberry Pi”。(source)

[++] 自主网络安全智能体——AIRecon、RedTeam-Agent 和 ULTRASHIP 都把本地 LLM 与传统安全工具链结合起来。模式是:由 LLM 编排现有渗透测试工具,完全本地运行,无需 API keys 或云依赖。安全团队长期人手不足;能执行多步评估工作流的自主智能体解决的是劳动力市场约束,而不只是生产力问题。(source, source)

[+] 面向 Brand Voice 的 AI-native martech——未被解决的类别——State of Martech 2026 数据显示,Brand Voice & Style Enforcement 是唯一处于 Build-Leaning 象限的用例,且 SaaS、AI-native 与自研方案大致均分。“还没人解决它。”当 AI 输出本身就是品牌体验时,B2C 营销人员拒绝外包。能破解 AI 生成内容中一致品牌声音的创业公司,将捕获一个构建痛点高、且尚无主导供应商的类别。(source)

8. 要点总结¶

-

智能体式 AI 正在重估整个半导体供应链,并得到企业一线预算增长确认。 一家大型企业的 Head of AI 报告称,今年智能体式 AI 预算呈指数级增长。SOX Index 连涨 18 天(+49%),供应链分析从推理芯片延伸到封装(CoWoS 结构性供不应求)和能源(电网被宣布为国防必需)。(source, source)

-

AI 评估正在按领域碎片化,而不是合并。 ProofGrid(推理证明)、WorldMark(视频世界模型)、HealthBench(医学 rubrics)和企业评估栈分别处理不同失败模式。跨领域编排层——通过单一接口运行特定领域评估——尚不存在。(source, source)

-

中国开源 AI 实验室通过相互借鉴加速发布。 Kimi 使用 DeepSeek 的 V3 架构;DeepSeek 使用 Kimi 的 Muon optimizer。Qwen 3.6-27B 在 24GB VRAM 上超过旧的 397B MoE。但 Alibaba 对旗舰模型转向闭源权重,说明其开源策略在前沿层有边界。(source, source)

-

企业 AI 采用正在产生反直觉指标:AI 用户创造更多工作,而不是更少。 Atlassian 报告称,AI 编程工具用户会生成多 5% 的 Jira 任务,并更快扩张席位。JPMorgan 运行 600 个 AI 用例。模式是 AI 放大工作流体量,而不是减少人头——这与替代叙事相矛盾,却确认了基础设施需求论点。(source, source)

-

AI 治理遭遇迄今最尴尬事件:一个政府因为 AI 写了 AI 政策而撤回该政策。 南非通信部长撤回 Draft National AI Policy,并承诺追责。这不是假设风险,而是一次现场演示:写 AI 规则的机构自己缺乏负责任使用 AI 的能力。(source)

-

已倒闭创业公司数据市场正在工业化。 Forbes 报道 SimpleClosure 推出 Asset Hub,一个专门面向清算创业公司运营数据的市场。AI 实验室在 2024 年底耗尽公共互联网数据后,现在把 Slack 档案、Jira 工单和邮件线程视为智能体式 AI 的高端训练材料。(source)

-

开源 AI 硬件正在成为有社区牵引力的真实类别。 OpenHome 的 1,000+ 贡献者、免费创始人 DevKit 和本地优先架构,代表了 AI 设备领域第一次严肃的开源推进。AI 硬件空间过去封闭且昂贵;这可能像 Arduino 和 Raspberry Pi 之于嵌入式计算那样降低门槛。(source)

-

自主网络安全智能体正在聚集成一种模式:用 LLM 编排传统安全工具链,并本地运行。 AIRecon、RedTeam-Agent 和 ULTRASHIP 都把本地 LLM 与渗透测试工具结合起来。安全劳动力短缺让这个类别具备结构性吸引力,而纯本地架构也回应了企业安全团队不愿把漏洞数据发送给云 API 的顾虑。(source, source)