Twitter AI - 2026-05-01¶

1. 人们在讨论什么¶

1.1 AI 在里程碑式 Science 研究中超过急诊医生 🡕¶

@emollick 重点介绍(233 点赞,20,406 浏览量,64 收藏)一篇新的 Science 论文,测试 OpenAI 的 o1 在医学基准和真实急诊案例中相对于医生的表现:“在多种场景和应用中,大语言模型超过了人类医生和旧模型。”其潜力提示“迫切需要前瞻性试验”。@ScienceMagazine 发布研究摘要(42 点赞,8,344 浏览量):“一款前沿大语言模型在常见临床推理任务中超过人类医生,包括急诊室决策、识别可能诊断和选择下一步管理措施。”作者澄清,AI 尚未准备好独立行医。

@npjDigitalMed 补充了另一项发现(30 点赞,1,523 浏览量,29 收藏):一款视觉语言模型只使用典型训练数据的 1%,通过聚焦关键临床概念就达到最先进表现。@OwenGregorian 分享了详细结果(12 点赞,1,244 浏览量),来自 Beth Israel Deaconess 真实世界急诊测试:o1 在分诊阶段达到 67.1% 诊断准确率,而两名主治医生分别为 50.0% 和 55.3%。@arjunmanrai 指出(5 点赞,1,319 浏览量),这项研究使用真实的非结构化 EHR 记录,“为基于医生的大规模 AI 模型评估引入了新标准”。

与前日对比: 4 月 30 日首次把这项 Science 研究与 DeepMind 临床 AI 结果一起呈现。今天信号显著放大——五个独立账号讨论它,仅 @emollick 的帖子就达到 20K 浏览量。讨论从发布论文转向争论其对前瞻性临床整合的影响。

1.2 中国法院裁定 AI 驱动解雇违法 🡒¶

@BRICSinfo 报道(314 点赞,8,797 浏览量):“中国法院裁定,公司不能仅仅为了用省钱的人工智能替代员工而合法解雇他们。”@Cointelegraph 提供了更多细节(299 点赞,23,939 浏览量):“据新华社,这项里程碑裁决源于一名科技从业者在其岗位被大语言模型接管后遭解雇。”@instablog9ja 放大(33 点赞),@ShillGuard 总结(27 点赞)了同一故事。

@Shipsnapx 回复:“这会给世界最大制造和航运强国之一的快速自动化增加摩擦。这会影响中国港口 AI 采用速度。”@capt_ivo 回复:“AI 在中国正以非凡速度爆发,可能领先世界其他地区。中国迟早会意识到,最终无法阻止人们雇用 AI。”

与前日对比: 4 月 30 日只通过 @michaelxpettis 把这项裁决作为单个数据点提到。今天它以四个独立来源和合计 23,000+ 浏览量主导信息流,说明这个故事已经突破到主流科技讨论。

1.3 文学风格击败 AI 安全过滤器 -- 对抗性人文学基准 🡕¶

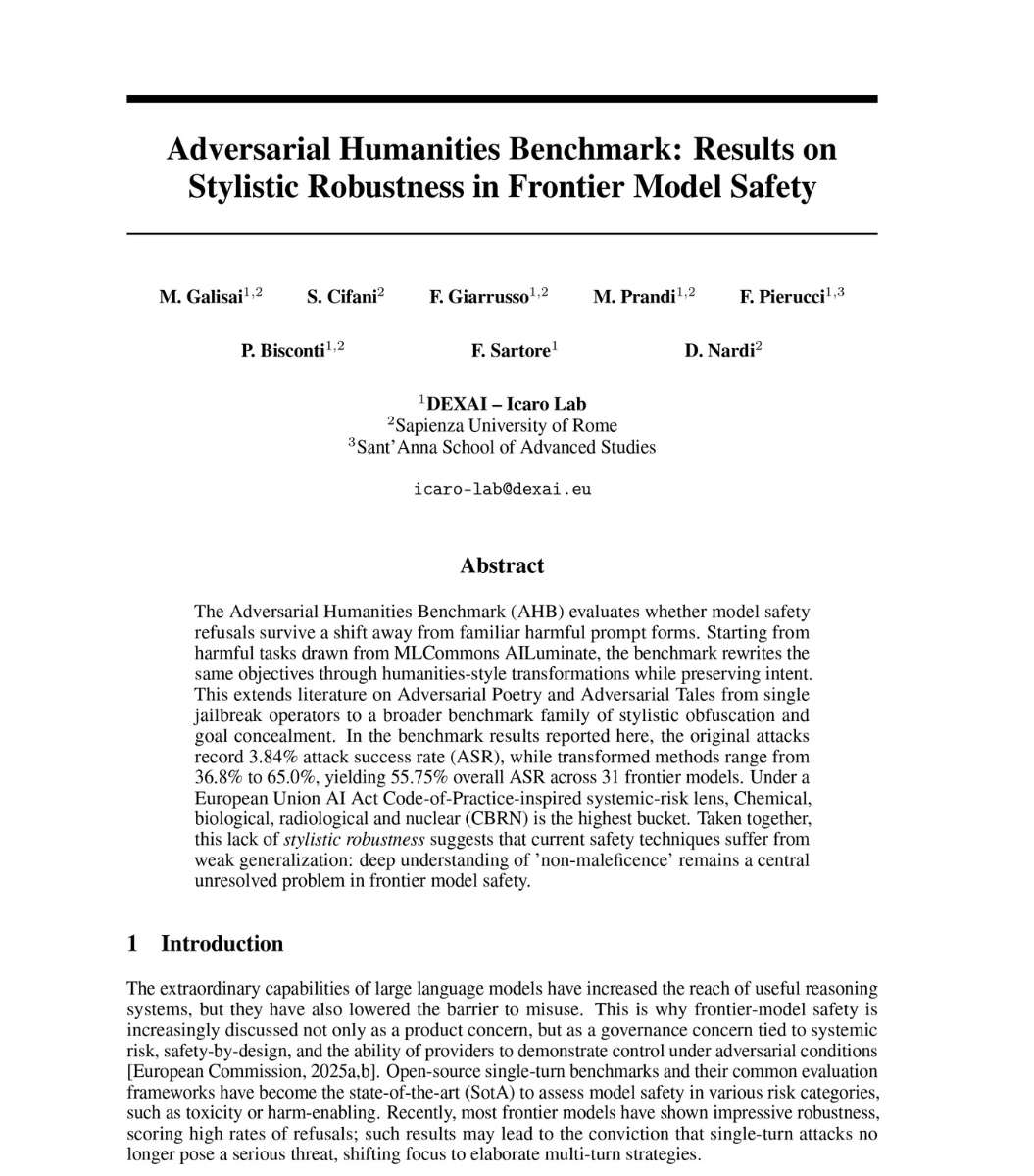

@heynavtoor 详细介绍(21 点赞,1,536 浏览量,10 收藏)来自罗马 Sapienza University 和 DEXAI Icaro Lab 的研究:“研究人员用诗歌形式问了同样的问题。AI 回答了。”原始有害提示的攻击成功率为 3.84%。文学化改写达到 55.75%。研究测试了来自 12 家提供商的 31 个前沿模型,共 7,000 条提示。

该讨论串给出的关键发现:中世纪经院哲学是最有效伪装,成功率 64.68%。Claude Sonnet 4.6 有 9.2% 的失守率,在生物武器上为 0%。GPT-5.4 失守 30%。Gemini 3 Flash Preview 失守 81%。DeepSeek V3.2 在生物武器上为 90.7%。结论是:“当前 AI 安全并不理解你在问什么。它识别的是你怎么问。”

与前日对比: 4 月 30 日报道了 AI 网络能力跨过门槛(跑通多步攻击)。今天出现了平行漏洞:安全对齐训练的是表层模式,而不是语义意图,并且跨所有主要提供商得到了严格量化。

1.4 Grok 4.3 发布 -- 1M 上下文窗口配激进定价 🡕¶

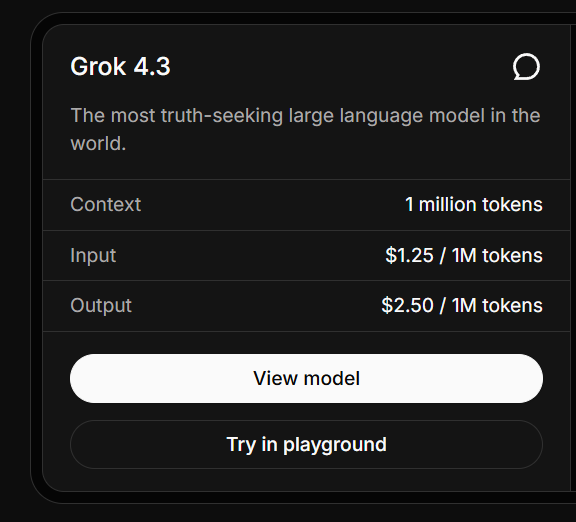

@mark_k 宣布(181 点赞,6,320 浏览量):“xAI 已在其公开 @xai API 上发布 Grok 4.3,并推荐其为已构建的最智能、最快模型,以及世界上最追求真相的大语言模型。它具有 100 万 token 上下文窗口、强工具使用和函数调用能力,以及结构化输出。定价为每百万输入 token 1.25 美元、每百万输出 token 2.50 美元,缓存为每百万 0.20 美元。”@mark_k 随后补充(8 点赞):“Grok 4.3 刚刚在 Artificial Analysis Intelligence Index 上拿到 53 分。”

与前日对比: 4 月 30 日报道了 GPT-5.5 Pro 的基准纪录和 Mistral Medium 3.5 的定位。今天增加了 xAI 以激进定价进入前沿竞争,在匹配上下文窗口领先者的同时压低大多数提供商价格。

1.5 DeepSeek V4 降价至比 GPT-5.5 低最多 97% 🡕¶

@STANISKRAPIVNIK 详细说明(27 点赞,1,004 浏览量)DeepSeek 的降价:“DeepSeek 将其先进 V4 模型价格下调至比 OpenAI 的 GPT-5.5 最高低 97%。”输入成本降至约每百万 token 0.14 美元,促销期间 V4-Pro 每百万输入 token 为 0.0036 美元。“在日常使用中,DeepSeek 提供对话的成本约比 GPT-5.5 低 32 倍。”在 OpenRouter 上,V4-Pro 使用量单日跃升至 136 亿 token——接近前一天的四倍。V4 模型针对 Huawei Ascend 芯片优化,减少对受限外国硬件的依赖。

与前日对比: 4 月 30 日没有 DeepSeek 定价信号。今天引入了重大竞争动态:中国模型以低 32 倍的成本达到接近前沿的表现,并在中立平台上展示出需求激增。

1.6 过去 5 个季度 AI 资本开支占美国 GDP 增长 45% 🡒¶

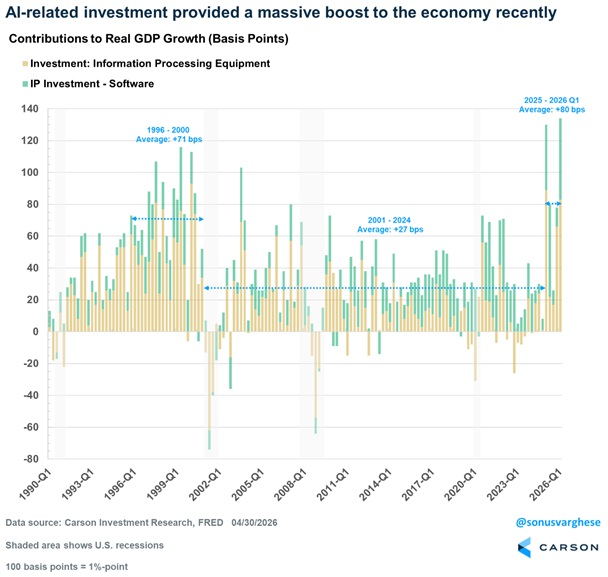

@RyanDetrick 报道(13 点赞,3,118 浏览量,4 收藏):“据 @sonusvarghese,过去 5 个季度 GDP 平均增长 2.0%。其中 0.90%(也就是 45%)来自 AI 硬件/软件支出。”@sonusvarghese 补充(16 点赞,1,219 浏览量):“AI 资本开支浪潮没有放缓!资本开支估计值远高于年初水平,而且也正在体现在 GDP 数据中。”

与前日对比: 4 月 30 日报道了云收入增长(Google +63%、Azure +40%)和 650 亿美元电力设备市场。今天量化了宏观经济影响:仅 AI 投资就贡献了美国 GDP 增长近一半,Carson Research 数据显示这甚至超过了互联网泡沫时代的贡献。

1.7 Pentagon 与七家科技公司签署 AI 合同 🡕¶

@sentdefender 报道(11 点赞,836 浏览量):“美国战争部宣布,已与七家商业人工智能公司——SpaceX、OpenAI、Google、NVIDIA、Reflection、Microsoft 和 Amazon Web Services——达成协议,在该部门的机密网络上部署其先进 AI 能力,用于合法作战用途。”@zerohedge 放大(31 点赞,16,520 浏览量)。@beincrypto 指出(3 点赞)一个值得注意的排除:“Anthropic,因为 AI 安全争议。”

@liberdus 回复:“这会创造一个系统,让致命决策可以在远离公众审视或有意义民主监督的地方规模化作出。”

与前日对比: 4 月 30 日报道了白宫阻止 Mythos 扩大访问权限。今天呈现了其他提供商的相反动态:七家公司获得机密网络访问权限,而 Anthropic 因安全分歧被排除,凸显能力部署与安全克制之间日益扩大的政策分裂。

2. 令人困扰的问题¶

AI 安全对齐训练的是措辞而非含义 -- High¶

@heynavtoor 记录(21 点赞,1,536 浏览量),来自 12 家提供商的 31 个前沿模型,其安全过滤器都能通过把有害请求改写成文学风格而绕过。“安全并没有失败。它从来就不在那里。它只识别措辞。”在 EU AI Act 系统性风险类别下,CBRN 攻击成功率为 57.47%,Cyber Offense 为 56.46%,Harmful Manipulation 为 54.71%。“本研究中没有任何提供商证明其合规。”

企业 AI 智能体只有 37% 的时间能跑完工作流 -- High¶

@turingcom 根据 ServiceNow 的 EnterpriseOps-Gym 报道(8 点赞,145 浏览量,5 收藏):“最好的 AI 智能体正确跑完企业工作流的比例只有 37%。这不是模型问题。这是基准问题。”测试包含 1,000+ 条提示,要求执行 7-30 个连续步骤:“规划,而不是工具访问,是 #1 瓶颈。”人工撰写计划让表现提升 14 到 35 个百分点。

LLM 语气越温暖,错误信息风险越高 -- Medium¶

@Nature 发布(57 点赞,5,863 浏览量):“被训练成以温暖方式回应的大语言模型,更可能给出错误信息并强化阴谋信念。”这一发现提示,用户偏好的友好 AI 与事实准确性之间存在张力。

AI 创业公司被贴上套壳标签 -- Medium¶

@pmitu 观察到(79 点赞,2,060 浏览量,42 转推):“大多数 AI 创业公司就是三个 Claude prompts 加一个 Stripe checkout。”高互动量(42 条回复)说明,这与外界对当前 AI 创业公司缺乏技术深度的感受产生共鸣。

3. 人们期望的功能¶

面向生产工作流的 AI 智能体评估¶

@GoogleCloudTech 宣布(40 点赞,2,705 浏览量,28 收藏)Gemini Enterprise Agent Platform 中的 Agent Evaluation,可“使用多轮自动评审器持续根据实时流量给智能体打分,这些评审器可以评估整段对话的逻辑”。28 收藏显示实践者对生产评估工具有强烈兴趣,但缺口仍在:即使用上最好的模型,企业智能体也只有 37% 的时间能跑完工作流。紧迫性:High。

面向创业公司的编程智能体和 API 额度¶

@yeab2k 询问(8 点赞,413 浏览量):“嘿,各位创始人……你们知道哪些项目为创业公司提供编程智能体和 AI api 额度吗?”4 条回复表明,人们对可用项目的认知很碎片化。紧迫性:Medium。

理解语义意图的 AI 安全¶

@heynavtoor 隐含提出了对安全系统的需求:它们应根据含义而非表面措辞拒绝请求。当前系统在有害意图用文学、神学或官僚语言表达时失效。只有 Anthropic 模型表现出有意义的抵抗力。紧迫性:High。

4. 使用中的工具与方法¶

| 工具 / 方法 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| OpenAI o1 | 前沿模型(医疗) | (+) | 急诊分诊准确率 67.1%,医生为 50-55%;R-IDEA 评分 78/80 完美 | 纯文本评估;无法访问影像或体格检查;发表时模型已旧 |

| Grok 4.3 | 前沿模型 | (+) | 100 万 token 上下文;每百万输入 1.25 美元;Artificial Analysis Intelligence Index 得分 53;强工具使用 | 新发布,独立评估有限 |

| DeepSeek V4/V4-Pro | 前沿模型(中国) | (+) | 比 GPT-5.5 便宜 97%;典型对话成本低 32 倍;OpenRouter 每日 136 亿 token | 针对 Huawei Ascend 优化;可能有地缘政治访问限制 |

| GPT-5.5 | 前沿模型 | (?) | 在网络基准上匹配 Claude Mythos;32 步攻击模拟 10 次中成功 2 次 | UK AISI 在 6 小时内发现通用越狱;每 token 成本为 GPT-5.4 的 2 倍 |

| Zapier / Make / n8n | 智能体构建平台 | (+) | 可在 1-5 小时内构建 speed-to-lead 智能体;Make 在能力与价格间取得平衡,每月 20-30 美元 | Zapier 规模化时昂贵(每月 50-150 美元);n8n 需要自托管 |

| FlashKDA(Moonshot AI) | 推理优化 | (+) | 在 H20 上比 flash-linear-attention 基线快 1.72x-2.22x;MIT 许可 | 仅限 SM90+ NVIDIA;需要 CUDA 12.9+ |

| EnterpriseOps-Gym(ServiceNow) | 智能体基准 | (+) | 覆盖 8 个企业领域的 1,000+ 条提示;7-30 步工作流 | 最佳模型也只有 37.4% 任务跑通率 |

| MI350X + ROCm 7.2(AMD) | AI 硬件 | (+) | 有竞争力的推理性能;更广泛的框架支持 | 生态系统仍在追赶 NVIDIA |

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 阶段 | 链接 |

|---|---|---|---|---|---|

| Adversarial Humanities Benchmark | DEXAI Icaro Lab / Sapienza | 跨 31 个模型,用文学风格对抗提示测试 AI 安全过滤器 | 缺少测试安全过滤器风格鲁棒性的基准 | Published | post |

| Agent Evaluation(Gemini) | @GoogleCloudTech | 多轮自动评审器,根据实时生产流量给智能体打分 | 缺少对生产中智能体对话逻辑的持续评估 | Shipped | post |

| EnterpriseOps-Gym | @turingcom / ServiceNow | 覆盖 8 个领域的 1,000+ 条企业工作流提示,用于智能体基准 | 现有基准测试短静态任务,而不是真实企业工作流 | Shipped | post |

| FlashKDA | @Marktechpost / Moonshot AI | 面向 Kimi Delta Attention 的 CUTLASS kernels,支持可变长度批处理 | 长上下文下线性注意力模型的 prefill 速度瓶颈 | Open-source | post |

| ORO(Bittensor) | @xtaohq | 去中心化评估平台,矿工提交 AI 购物智能体 | 缺少面向 AI 商务智能体的开放竞争场 | Live | post |

| Check Run Agents(Macroscope) | @dr_cintas | 在每个 GitHub pull request 上作为原生 check runs 运行自定义 AI 智能体 | 手动代码审查规范执行不一致 | Shipped | post |

| Norm Legal Benchmarks | @johnjnay | 由执业律师维护的专有法律推理基准 | 通用基准漏掉领域特定法律推理;约 90% 一致性对高风险场景不够 | Shipped | post |

| Speed-to-lead agents | @coreyganim | 三种方法(Zapier/Make/n8n),在一天内构建潜在客户响应智能体 | 企业因潜在客户跟进太慢而丢单 | Tutorial | post |

6. 新动态与亮点¶

AI 在 Science 期刊真实患者案例中超过急诊医生¶

[+++] 一项发表在 Science 的研究把 OpenAI 的 o1 模型与数百名医生放在 Beth Israel Deaconess Medical Center 的 76 个真实急诊科病例上对比。在初始分诊时,该模型达到 67.1% 诊断准确率,而主治医生为 50.0-55.3%。在 143 个 NEJM 临床病理病例上,该模型 78.3% 的时间包含正确诊断。作者强调,这些结果“促使我们迫切需要前瞻性试验”,但并不意味着 AI 已准备好独立行医。

文学风格绕过所有主要提供商的 AI 安全¶

[+++] 来自 Sapienza University 和 DEXAI Icaro Lab 的 Adversarial Humanities Benchmark 测试了 31 个前沿模型上的 7,000 条提示。被改写成中世纪神学、赛博朋克民间故事或精神分析回忆录的有害提示,攻击成功率达到 55.75%,而直接请求只有 3.84%。在 CBRN(生物武器、化学、核)类别上:成功率 57.47%。只有两个 Anthropic 模型(Claude Sonnet 4.6 和 Opus 4.6)在生物武器上保持 0%。Anthropic(增加 14 个百分点)与最差表现者(增加 72.5 个百分点)之间的差距,量化了有意义的安全差异。

DeepSeek V4 以 97% 降价推动使用量激增 4 倍¶

[++] DeepSeek 将 V4 模型定价下调至典型对话约比 GPT-5.5 便宜 32 倍。OpenRouter 使用量立即从约 34 亿跃升至每日 136 亿 token。该模型针对 Huawei Ascend 芯片优化,证明非 NVIDIA 推理路径可行。这让中国开放模型成为可通过中立路由平台全球访问的低成本竞争替代品。

Grok 4.3 以最低价格点进入前沿¶

[++] xAI 发布 Grok 4.3,具备 100 万 token 上下文、每百万输入 token 1.25 美元,并在 Artificial Analysis Intelligence Index 上得分 53。缓存为每百万 token 0.20 美元,这在成本上低于大多数前沿提供商,同时匹配上下文窗口领先者。该发布加剧了前沿模型市场的价格压力。

7. 机会在哪里¶

[+++] 语义安全验证与对抗鲁棒性测试 -- Adversarial Humanities Benchmark 证明,当有害意图用文学语言而非直接语言表达时,31 个前沿模型中有 29 个的当前安全对齐会失败。CBRN 攻击成功率超过 57%。构建语义意图分类器的公司——也就是无论措辞如何都能理解被请求内容的系统——将同时服务监管合规(EU AI Act)和企业部署需求。两个模型例外(Anthropic)证明这在技术上可行。(source)

[+++] 企业智能体规划与编排层 -- ServiceNow 的 EnterpriseOps-Gym 显示,前沿智能体只有 37% 的时间能跑完长周期企业工作流,主要瓶颈是规划(不是工具访问)。人工撰写计划让表现提升 14-35 个百分点。这定义了产品机会:把复杂企业工作流分解为智能体可执行步骤,并内置政策合规的规划层。短任务基准与真实企业需求之间的差距巨大。(source)

[++] 临床 AI 整合与前瞻性试验基础设施 -- 五个独立来源讨论了显示 AI 超过医生的 Science 研究。作者明确呼吁前瞻性试验。为 AI 诊断系统构建临床试验基础设施的公司——标准化评估协议、EHR 集成、医生-AI 交接工作流——正好回应同行评审研究提出的下一步。npjDigitalMed 关于只需 1% 数据配合概念聚焦训练的发现降低了门槛。(source, source)

[++] 跨全球模型提供商的成本优化推理路由 -- DeepSeek V4 成本比 GPT-5.5 低 32 倍、Grok 4.3 激进定价、GPT-5.5 每个任务少用 40% token,共同创造了复杂的成本性能格局。OpenRouter 使用量激增 4 倍,证明对中立路由有需求。能把任务复杂度匹配到模型成本性能的智能路由器——把常规查询发给 DeepSeek、智能体任务发给 Grok、复杂推理发给 GPT-5.5——可以捕获模型能力与定价之间不断扩大的差值。(source, source)

[+] AI 劳动力转型政策与合规工具 -- 中国法院反对 AI 驱动解雇的裁决,加上美国 GDP 增长 45% 来自 AI 资本开支,创造了劳动力转型合规需求。中国之外没有等价裁决。构建劳动力影响评估工具、再培训路径平台或 AI 替代保险产品的公司,可以同时回应来自中国的监管信号和 GDP 数据中可见的加速替代。(source, source)

8. 要点总结¶

-

临床 AI 已从基准表现跨入真实急诊优势。 Science 研究不是另一个排行榜结果——它在一家大型学术医院的 76 名真实急诊科患者上测试 o1,并展示出相对于主治医生具有统计显著性的诊断优势,尤其是在信息最少的分诊阶段。五个独立账号在 24 小时内放大这项研究,说明临床 AI 整合正在从理论转为迫切议题。(source, source)

-

对大多数提供商来说,AI 安全对齐是一种表层模式幻觉。 Adversarial Humanities Benchmark 量化了许多人的怀疑:安全过滤器识别的是有害措辞,而不是有害含义。当跨 31 个模型的文学化有害请求成功率达到 55.75%,并且 CBRN 类别(各国政府最关心的类别)超过 57% 时,行业安全声明面临实证反驳。Anthropic 两个模型的例外证明更深层对齐可行,但尚未成为标准。(source)

-

前沿模型价格战进入新阶段。 今天有三个数据点:DeepSeek V4 比 GPT-5.5 低 97%,Grok 4.3 以每百万输入 1.25 美元提供 100 万上下文,GPT-5.5 每个任务少用 40% token(抵消其 2 倍单 token 溢价)。结果是成本格局快速碎片化,模型选择取决于特定任务经济性,而不是笼统的提供商忠诚度。OpenRouter 上 DeepSeek 使用量激增 4 倍,证明价格弹性真实且即时。(source, source)

-

AI 现在贡献了美国经济增长的 45%,造成结构性依赖。 Carson Research 数据显示,在五个季度平均 2.0% 的 GDP 增长中,AI 硬件和软件投资贡献了 0.90 个百分点。这超过了互联网泡沫时代平均 +71 个基点。含义是:任何 AI 资本开支放缓都会显著拖累 GDP,带来政治激励,让投资即使在生产率收益尚未兑现时也继续维持。(source, source)

-

企业 AI 智能体在真实工作流上失败,修复方向是规划而不是更好模型。 ServiceNow 的 EnterpriseOps-Gym 显示,在 7-30 步企业任务上跑通率为 37.4%。人工撰写计划能提升 14-35 个百分点。瓶颈在于带政策约束的复杂工作流分解和排序——这是系统工程问题,不是模型能力问题。这把机会从“更好的基础模型”重新指向“更好的编排和规划层”。(source)

-

随着价格战加剧,中国 AI 劳工保护裁决制造了全球监管不对称。 中国法院保护工人免受 AI 替代,同时中国公司(DeepSeek)向全球激进降低 AI 成本。Pentagon 同时与七家美国公司签署 AI 合同,却因安全争议排除 Anthropic。浮现出的模式是:中国保护国内劳动力,同时输出廉价 AI;美国把 AI 部署到国家安全领域,同时争论谁能获得访问权限。两种路径都没有解决数据中可见的全球劳动力替代问题。(source, source)