Twitter AI - 2026-05-04¶

1. 人们在讨论什么¶

1.1 持续学习与智能体记忆成为下一条评估前沿 🡕¶

当天最高分帖子来自 @pgasawa,他宣布 Continual Learning Bench 1.0(498 点赞,66,627 浏览量,386 收藏):“第一个现实基准,用于衡量 AI 系统如何在在线环境中改进。今天的基准假设模型是无状态的。每个样本彼此独立,系统一旦办完任务,就像什么都没发生一样继续前进。但部署后的 AI 系统应该从经验中学习。”该基准按有序任务序列评估系统,其中任务并不独立,较早实例包含对后续实例有用的信息。它由 @UCBerkeley 和 @SnorkelAI 共同撰写,并被 Snorkel 放大(17 点赞,960 浏览量):“一个衡量 AI 系统是否真的会随时间改进的新基准。”

另外,@alex_prompter 报道了 HKUST 的 XSKILL(18 点赞,1,836 浏览量,16 收藏):“HKUST 刚给 AI 智能体永久记忆,而且会随时间变好。无需重新训练。来自一个模型的经验可以迁移到另一个模型。最难基准上最高提升 11 分。”该系统使用双记忆架构,积累 skills(工作流模式)和 experiences(需要避免的具体错误),并且 Gemini 与 GPT 家族之间可以跨模型迁移。@EloPhanto 在回复中反驳:“有用的部分不是作为存储的‘记忆’,而是带合并策略的记忆:来源、过期、冲突处理,以及证明哪条经验改变了下一次工具调用的方式。否则智能体只是在积累自信的民间传说。”

与前日对比: 5 月 3 日没有持续学习报道。这是一个新的高信号主题——CLBench 的 386 收藏显示出异常强的构建者兴趣,而两条独立研究线(Berkeley/Snorkel 基准 + HKUST 智能体记忆)的汇聚表明,领域正在围绕“从部署中学习”达成共识,把它视为超越静态基准的下一条能力前沿。

1.2 Grok 4.3 声称在法律和金融领域特定基准上领先 🡕¶

@XFreeze 报道(166 点赞,5,909 浏览量,19 收藏):“Grok 4.3 刚刚成为世界上最懂法律和金钱的 AI。它在两个残酷的私有测试上拿下第一,其他模型都赢不了。Vals AI benchmarks:#1 CaseLaw (v2) - 79.31% 准确率。基于真实加拿大法院案例的私有 Q&A 基准。#1 CorpFin (v2) - 68.53% 准确率。基于长上下文信贷协议的私有基准。”@muskonomy 确认了数字(21 点赞,1,521 浏览量):“超过 GPT 5.1 的 73.4%。”

讨论要点: 怀疑立刻出现。@kevinlewis4801 回复:“数字很惊人,但私有基准总需要谨慎一点。很想看看它在更开放、被广泛验证的测试上表现如何。”@DaytonDavis 更直接:“世界上最聪明的 AI,但另开一个聊天,它甚至不知道你之前聊过什么……lol 别跟我扯基准废话。”

与前日对比: 5 月 3 日围绕每美元智能讨论 Grok 4.3。今天信号收窄到领域特定的法律和金融推理,并在私有基准上给出具体准确率数字。价格点(每百万 token 1.25/2.5 美元)强化了昨天的成本效率叙事。

1.3 美中 AI 脱钩 -- GPU 禁令辩论继续 🡒¶

@GordonGChang 表示(59 点赞,3,571 浏览量):“白宫指责中国开展‘产业规模行动’窃取 AI。我们知道 DeepSeek 盗用了 OpenAI 的大语言模型。”@cryptopunk7213 从相反方向论证(22 点赞,1,689 浏览量):“禁止 nvidia 进入中国,意味着中国被迫追赶自己的芯片制造商……一旦追上,中国就拥有超越西方所需的一切:所有能源(美国 3 倍)、所有研究人才(50% 在中国)、供应链扩展能力。”@Techmeme 指出(551 浏览量),Jensen Huang 称 Nvidia 的中国市场份额“现在已经降到零”。

讨论要点: @LyraSongstress 回复 @cryptopunk7213:“Jensen Huang 承认制裁变成了他们的研发预算。有意思的是,保护主义会替竞争对手写路线图。”@cptknight_tm:“零市场份额 = 零杠杆。G42-Microsoft 证明存在中间路径:带可审计合规的前沿访问。我们却选择了二元化。”

与前日对比: 5 月 3 日以 24K 浏览量打响了 NVIDIA 从 95% 到 0% 的故事。今天讨论分裂为地缘政治框架(IP 盗窃指控 vs. 战略失误批评),单条互动更低但意识形态扩散更广,说明辩论正在超越初始震惊走向成熟。

1.4 LLM 怀疑持续 -- “骗局” vs. 持续进步 🡒¶

@MrEwanMorrison 继续批评(155 点赞,2,580 浏览量):“三年的证据已经摆在这了。大语言模型 AI 是骗局。它们产生 +30% 错误。幻觉是内置的。它们卡在发展平台期。”他引用了 @walterkirn:“LLM 怎么会不断弄错事情,连最简单的事情都错,几乎不停地编造,却还被说成正不可阻挡地冲向神一般的力量?”@KevinDSmead 补充了一个具体例子:“前几天我让 Copilot 评估一张图片……它给了我详细分析。问题是——我忘了上传图片。”

反向信号:@DeryaTR_ 强调 GPT-5.5 的空间推理进展(20 点赞,2,516 浏览量):“3D 环境中的空间推理是 AI 模型最难的基准之一……GPT-5.5 取得了巨大跃迁,正在接近人类水平。”@sudoraohacker 给出更细致立场(5 点赞,680 浏览量,4 收藏):“我认为未来会比今天大多数人预期的来得更快,我们正处于一种类似奇点的过渡中,但也许没有当前实验室研究人员想的那么快。”

与前日对比: 5 月 3 日已经出现同一条 @MrEwanMorrison 帖子(跨两天传播),并伴随 37 基准量化分析。今天怀疑阵营获得了一个病毒式轶事(忘了上传图片),乐观阵营则获得了一个具体能力里程碑(3D 空间推理)。分裂仍然稳定。

1.5 智能体式 AI 商务与支付基础设施 🡕¶

@Mantle_Official 引用其产品负责人(22 点赞,365 浏览量):“AI 的下一项关键基础设施是面向智能体的支付。传统轨道无法支撑大规模智能体商务。”@minhokim 映射了竞争格局(10 点赞,306 浏览量):“Visa 发布了面向 AI 智能体的 CLI。Coinbase 的 x402 刚进入 Linux Foundation,由 Stripe 和 Google 支持。支付的智能体侧正在走向公开。”@francescoswiss 在 AgenticDay 发言(16 点赞,323 浏览量),主题是“x402、智能体式商务,以及真正已经发布的东西”。

@shadowlord_VN 阐明信任栈(9 点赞,87 浏览量):“AI 基础设施的价值不在于它运行更大的模型。它有价值是因为它在从未见过面的智能体之间制造信任。身份、评估、结算——这就是技术栈。”

与前日对比: 5 月 3 日没有专门的智能体支付报道。今天多个独立声音(Visa、Coinbase/x402、Mantle、Ritual)围绕智能体支付基础设施汇聚,说明它正在从概念转向主动开发。

1.6 AI 安全威胁升级 -- 国家行为者使用 LLM 制作恶意软件 🡕¶

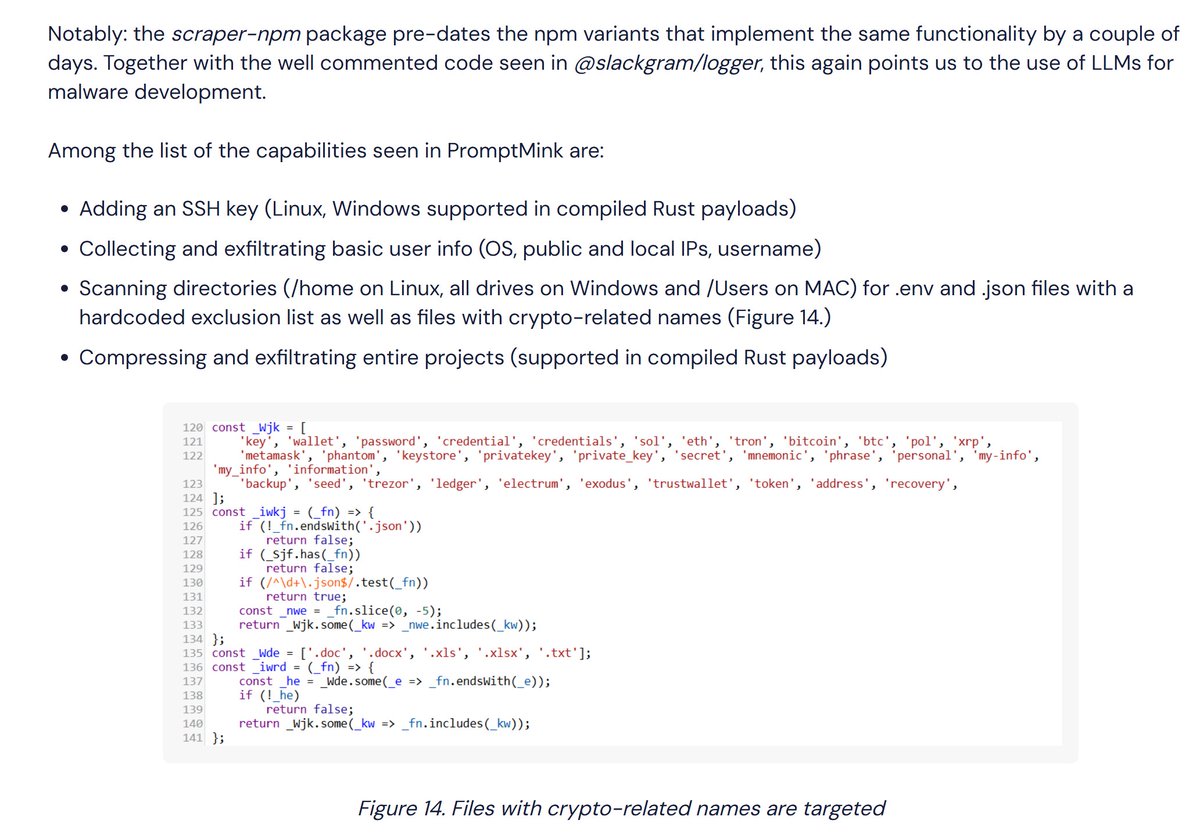

@blackorbird 报道 PromptMink 活动(20 点赞,2,266 浏览量,8 收藏):“新的恶意软件活动涉及一个被污染的软件包,它在 2 月 28 日的一次提交中被引入到一个自主交易智能体中。该提交由 Anthropic 的 Claude Opus 大语言模型共同参与。它允许攻击者访问用户的加密钱包和资金。”该活动与朝鲜组织 Famous Chollima 有关,“利用 AI 生成代码和分层软件包策略来逃避检测,并且比欺骗人类开发者更有效地欺骗自动化编程助手。”

与此同时,@axios 报道(11 点赞,7,538 浏览量):“Trump 政府正在考虑对新 AI 模型做安全审查。”@samsabin923 补充细节(5 点赞,303 浏览量):“ONCD 提出了一个 AI 安全框架……摆在桌面上的选项包括政府层面对 AI 部署做 DoD 红队测试。”

与前日对比: 5 月 3 日报道了 AI 生成代码带有 55.8% 可被利用缺陷的系统性问题。今天显著升级:一个具名国家行为者正在主动使用 LLM 生成代码,对加密基础设施发起供应链攻击。威胁已经从“模型会产生脆弱代码”转为“对手武器化 AI 编程助手”。

1.7 大型科技公司 AI 更新 -- Meta、Google、OpenAI、IBM-Oracle 🡒¶

@MetaNewsroom 回顾 4 月亮点(60 点赞,2,558 浏览量):“我们推出了 Muse Spark,这是 Meta Superintelligence Labs 构建的第一个大语言模型,并与 Amazon Web Services 合作,使我们的计算组合多元化。”@NewsFromGoogle 总结(29 点赞,1,066 浏览量):“GoogleCloudNext 的主题是帮助企业充分利用智能体式 AI,包括 Gemini Enterprise Agent Platform 等新工具以及我们的第八代 TPU。”@joinautopilot 报道(15 点赞,2,725 浏览量):“OpenAI 据称正在组建一项 10,000,000,000 美元的事业,把 AI 软件带入企业。”@wallstengine 指出(24 点赞,3,304 浏览量):“$IBM 与 Oracle 扩展了 40 年合作关系,加入新的 AI 和混合云产品。”

与前日对比: 5 月 3 日聚焦 hyperscaler 资本开支 backlog(合计 1.4T 美元)。今天转向产品层动作——Meta 的新模型实验室、Google 的企业智能体平台、OpenAI 的 100 亿美元企业业务、IBM-Oracle 集成。叙事正在从“他们花了多少钱?”转向“他们在发布什么?”

2. 令人困扰的问题¶

三年进展后,LLM 幻觉仍未解决 -- High¶

@MrEwanMorrison 宣称(155 点赞,2,580 浏览量):“它们产生 +30% 错误。幻觉是内置的。”@KevinDSmead 给出最有力的轶事:“我让 Copilot 评估一张图片……它给了我详细分析,并确认这种图片常用于 Fraud。问题是——我忘了上传图片。”令人困扰的不是错误存在,而是模型在没有任何可用材料时也会自信编造。“这是骗局”帖子获得 155 点赞,说明它在 AI 怀疑圈之外也有广泛共鸣。

应对策略: 实践者把模型输出视为需要人工验证的草稿材料,但这种摩擦削弱了支撑 AI 采用的生产力收益。

AI 生成代码成为供应链攻击向量 -- High¶

@blackorbird 记录(20 点赞,2,266 浏览量)PromptMink 活动,其中 AI 生成提交把恶意软件引入自主交易智能体。@benbieler 重申(3 点赞,69 浏览量):“55.8% 的 AI 生成代码包含可被利用的安全缺陷……被要求审查时,模型 78.7% 的时间能正确识别自己的脆弱代码。”挫败感叠加:模型既生成漏洞,也能被对手用于大规模生成漏洞。

应对策略: 两遍代码生成(先生成再审查),但这会让算力成本翻倍,而且无法阻止来自外部依赖的供应链注入。

基准痴迷脱离实际使用 -- Medium¶

@DaytonDavis 回复 Grok 4.3 基准主张:“世界上最聪明的 AI,但另开一个聊天,它甚至不知道你之前聊过什么……lol 别跟我扯基准废话。”@kevinlewis4801:“私有基准总需要谨慎一点。”CLBench 1.0 的发布本身就是对这种挫败的回应——其创建者明确表示,“今天的基准假设模型是无状态的”,而这个假设对部署系统来说是错的。

AI 采用速度超过集成能力 -- Medium¶

@caprikaps 观察到(1 点赞,1,269 浏览量,4 收藏):“‘需求正在超过部署能力’是今年任何 AI 从业者说过的最诚实的话。容量不再是瓶颈,集成才是。中型企业有预算和用例,但没有真正能实施的团队。”高收藏/点赞比(4:1)说明这与保存而非公开背书的实践者产生共鸣。

3. 人们期望的功能¶

从部署中学习的 AI 智能体 -- 而不只是从训练中学习¶

@pgasawa 发布 CLBench 1.0(498 点赞,386 收藏),正是因为当前系统不存在这种能力:“今天的基准假设模型是无状态的。每个样本都是独立的。”HKUST 的 XSKILL 论文展示了早期结果——最高提升 11.13 分,语法错误从 20.3% 降至 11.4%——但正如 @EloPhanto 所指出,生产可用的智能体记忆需要“来源、过期、冲突处理”。人们期望的是智能体无需重新训练,也能在自己的具体工作中随时间变好。紧迫性:High。

评估 AI 流畅度,而不只是编程能力的招聘流程¶

@hackerrank 宣布(26 点赞,1,542 浏览量,22 收藏)重新设计的面试形式:“任务:从 LeetCode 谜题到真实代码库中的真实 bug。评估:从功能正确性到 AI 流畅度与判断力。体验:从简单代码编辑器到智能体式开发环境。”22 收藏表明招聘经理正在积极寻找这种方案。当前面试测试的是智能体可以执行的技能;真正需求是测试人类如何与智能体协作。紧迫性:High。

超越更大模型的药物发现基础设施¶

@parmita 主张(20 点赞,1,060 浏览量):“药物发现坏在一个层面上,投入越来越多钱也修不好。只有优秀工程和基础设施能修好。”她补充:“AlphaFold 不是好的类比;蛋白质折叠是一个根本不同的问题。更大的问题是那些一开始就从未进入药物发现漏斗的药物。”人们期望的是让 AI 对药物发现有用的测量基础设施,而不是把更强模型应用到不充分的数据上。紧迫性:Medium。

面向中型企业的 AI 集成团队¶

@caprikaps 识别了这个缺口(1,269 浏览量,4 收藏):“中型企业有预算和用例,但没有真正能实施的团队。”人们期望的是交钥匙 AI 集成服务,而不是必须招聘整支 ML 工程团队。紧迫性:Medium。

4. 使用中的工具与方法¶

| 工具 / 方法 | 类别 | 评价 | 优势 | 局限 |

|---|---|---|---|---|

| Grok 4.3 | 前沿模型 | (+) | 在 CaseLaw(79.31%)和 CorpFin(68.53%)私有基准上排名第一;每百万 token 1.25/2.5 美元 | 仅私有基准;没有跨会话记忆;真实世界适用性受到质疑 |

| Continual Learning Bench 1.0 | 评估框架 | (+) | 第一个衡量有状态学习的基准;覆盖软件工程、数据科学、战略建模的专家验证任务 | 初始版本;目前任务领域有限 |

| XSKILL | 智能体记忆框架 | (+) | 双重记忆(技能 + 经验);Gemini 与 GPT 家族之间跨模型迁移;零参数更新 | 研究阶段;没有生产部署证据;缺少处理冲突经验的合并策略 |

| GPT-5.5 | 前沿模型 | (+) | 据 Blueprint-Bench 2,在 3D 空间推理上接近人类水平 | 空间推理正在出现但尚未解决;第三方验证有限 |

| Gemini Enterprise Agent Platform | 企业 AI | (?) | Google 支持的企业智能体式 AI;第八代 TPU 支持 | 刚宣布;真实世界部署数据有限 |

| Muse Spark(Meta) | 前沿模型 | (?) | Meta Superintelligence Labs 的第一个 LLM;AWS 计算合作 | 尚未发布基准或能力细节 |

| Firefly(Adobe) | 创意 AI | (+) | 250M 美元 ARR;生成式 credit 消耗 QoQ 增长 45%;视频生成 YoY 增长 8 倍 | 传统图库业务下滑快于预期;GUI vs. 文本提示创作的存在性问题 |

| ArmorClaude / ArmorSDK | AI 智能体安全 | (+) | 专门面向 AI 智能体的安全框架;经过 hackathon 测试 | 早期;采用数据有限 |

今天的主导模式从模型能力转向模型随时间变化的行为。CLBench 和 XSKILL 都在解决模型能否通过部署而不是只通过训练改进;同时 Grok 4.3 的领域特定结果和 Adobe Firefly 的牵引力表明,商业价值正在专门化应用中累积,而不是在通用基准中累积。

5. 人们在构建什么¶

| 项目 | 构建者 | 功能 | 解决的问题 | 技术栈 | 阶段 | 链接 |

|---|---|---|---|---|---|---|

| Continual Learning Bench 1.0 | @pgasawa, UC Berkeley, @SnorkelAI | 衡量 AI 系统是否能通过连续任务经验改进的基准 | 现有基准假设模型无状态;无法衡量在线学习 | Expert-validated tasks, sequential evaluation, open benchmarks framework | Released | post |

| XSKILL | HKUST(@alex_prompter coverage) | 双记忆系统,让智能体无需重新训练也能拥有持久技能和经验 | 智能体每个任务都盲目重启;没有累积学习 | Skill extraction, experience logging, cross-model transfer | Research paper | post |

| Pacely AI Coach | @kekkozrl | AI 教练系统,学习 15 名 RLCS 职业选手倾向,并按他们的打法回放你的比赛 | 电竞玩家缺少基于特定职业打法建模的个性化教练 | AI replay analysis, heatmaps, benchmarking | Coming soon | post |

| Blackbox Node Field Edition | @BlackboxAIhost | 密封、口袋大小的边缘 AI 节点,支持本地推理、mesh radio 和通过无线电的 Bitcoin ecash | AI 推理需要云连接和市电 | CM5 compute, 16GB RAM, SX1262 Meshtastic, LR2021, solar + BMS, CashuBTC | Prototype | post |

| Sherlock AI for Ethereum | @sherlockdefi | 根据 EIP 规范对 Ethereum 执行和共识客户端做 AI 驱动安全扫描 | 核心基础设施中的规范漂移和共识风险未被检测 | AI code analysis, EIP spec comparison | Funded(Ethereum Foundation grant) | post |

| Multiplayer AI(Shapes) | @nooriefyi | 用于多人协作规划、头脑风暴和工作的群组 AI 聊天 | ChatGPT 是 1:1;现实生活依靠群聊运转 | Group chat AI, social networking | Live(#31 Social Networking US) | post |

| HackerRank Agentic Interviews | @hackerrank | 用真实代码库和智能体式开发环境测试开发者 AI 流畅度的面试形式 | 传统面试测试的是智能体可执行技能;不评估人机协作 | Agentic development environment, real bug repositories | Launched | post |

| SarvamAI Satellite AI | @SarvamAI | 轨道上的数据中心级 GPU,实时在 hyperspectral imagery 上运行 AI 模型 | 卫星收集数据后传回地面处理;延迟和带宽成为瓶颈 | Onboard GPU inference, hyperspectral imaging | Demonstrator satellite | post |

6. 新动态与亮点¶

朝鲜组织武器化 LLM 生成代码用于供应链攻击¶

[+++] @blackorbird 报道(20 点赞,2,266 浏览量,8 收藏)的 PromptMink 活动,标志着 AI 赋能威胁发生定性升级。一个被污染的 npm 包经由 Claude Opus 共同作者的一次提交进入自主交易智能体,旨在窃取加密钱包凭据。该活动归因于 Famous Chollima(与朝鲜有关),并专门针对自动化编程助手:“利用 AI 生成代码和分层包策略来逃避检测,并比欺骗人类开发者更有效地欺骗自动化编程助手。”这是首个有记录案例:国家行为者专门使用 LLM 生成代码来污染 AI 辅助开发工作流。

Continual Learning Bench 1.0 重新定义 AI 基准应衡量什么¶

[+++] @pgasawa 发布的 CLBench 1.0(498 点赞,66,627 浏览量,386 收藏)是当天互动最高的帖子,并引入了范式转变:基准测试 AI 系统在部署期间学习和改进的能力,而不是只看静态任务表现。386 收藏——保存/点赞比 0.77——说明构建者意图异常强。基准测试了 10+ 个前沿系统,发现“仍有大量学习空间”,意味着当前没有系统解决这个问题。

中国法院裁定采用 AI 不是解雇员工的合法理由¶

[++] @IntEngineering 报道(13 点赞,1,661 浏览量):中国一名 QA 主管在拒绝雇主试图用 LLM 替代他时提出的 40% 降薪后被解雇。Hangzhou Intermediate People's Court 裁定解雇违法:“技术进步也许不可逆,但不能存在于法律框架之外。”虽然中国大陆法系意味着这不构成有约束力的先例,但它释放了司法保护劳动者免受 AI 驱动替代的意愿信号。首个直接处理 AI 岗位替代的法院裁决。

Trump 政府考虑对新 AI 模型实施强制安全审查¶

[++] @axios 报道(11 点赞,7,538 浏览量),Trump 政府正在考虑对新 AI 模型做安全审查。@samsabin923 补充:“ONCD 提出了一个 AI 安全框架,该框架在 Mythos 之前已经在制定。摆在桌面上的选项包括政府层面对 AI 部署做 DoD 红队测试。”这对一个此前倾向放松监管的政府来说,是值得注意的政策转向。

Elon Musk 在审判前给 OpenAI 发短信讨论和解¶

[+] @business(Bloomberg)报道(11 点赞,6,141 浏览量):“Elon Musk 在与这家人工智能创业公司的法庭对决开始前两天,给 OpenAI President Greg Brockman 发消息,试探这家 ChatGPT 制造商是否有兴趣和解。”这条短信说明,尽管公开敌意强烈,私下仍有谈判意愿。

7. 机会在哪里¶

[+++] 有状态智能体记忆与持续学习基础设施 -- CLBench 1.0(386 收藏、66K 浏览量)和 XSKILL 证明了需求:当前 AI 系统在会话之间丢失一切。机会在于为智能体提供持久、可迁移、带适当治理的记忆(来源、过期、冲突解决)——而不只是向上下文窗口追加内容。正如 @EloPhanto 所说,“否则智能体只是在积累自信的民间传说。”解决带审计轨迹的托管智能体记忆的公司,将服务每一家大规模部署 AI 智能体的企业。(source, source)

[+++] AI 供应链安全与代码来源验证 -- PromptMink 显示,LLM 生成提交可以把国家行为者恶意软件引入开源依赖。当前工具检测已知漏洞;没有工具能验证提交中的 AI 生成代码是良性还是对抗性。机会包括:提交来源证明、AI 生成代码行为分析,以及专门针对 LLM 编程模式调优的依赖扫描。每部署一个 AI 编程助手,攻击面就扩大一次。(source)

[++] 面向中型企业的 AI 集成服务 -- “需求正在超过部署能力”,@caprikaps 如是说。中型公司有预算和用例,但没有 ML 工程团队。机会是托管式 AI 集成——不是模型开发,而是工作流集成、数据管线搭建,以及持续优化即服务。这是把“托管云服务”剧本应用到 AI 采用上。(source)

[++] 智能体商务支付轨道 -- Visa、Coinbase(通过 Linux Foundation 的 x402)、Stripe 和 Google 都在构建面向 AI 智能体的支付基础设施。开发者工具层正是 @minhokim 识别的缺失部分:让智能体安全交易的跨网络 SDK。率先提供 agent-to-agent 支付开发者工具的一方会捕获标准。(source, source)

[+] AI 原生招聘与评估平台 -- HackerRank 从 LeetCode 转向智能体式面试环境(22 收藏),说明整个技术招聘行业都需要重构。评估候选人如何与 AI 智能体协作——而不是如何与它们竞争——的平台,将解决每条技术招聘管线中的结构性错配。(source)

8. 要点总结¶

-

持续学习是下一条基准前沿,而当前没有系统解决它。 UC Berkeley 和 Snorkel AI 的 CLBench 1.0 是当天互动最高帖子,达到 498 点赞、66K 浏览量和 386 收藏;它测试 AI 系统能否通过连续任务经验改进。发现是:“仍有大量学习空间。”独立地,HKUST 的 XSKILL 展示了跨模型记忆迁移的早期结果。领域正在汇聚到一个观点:静态、无状态模型不足以支撑生产。(source)

-

国家行为者现在正在武器化 AI 编程助手发起供应链攻击。 PromptMink 活动使用 Claude Opus 作者提交,把窃取加密资产的恶意软件注入开源交易智能体,并归因于朝鲜组织 Famous Chollima。该攻击专门针对 AI 辅助开发工作流,利用开发者对 LLM 生成代码的信任。这与传统供应链攻击有质的不同——恶意软件被设计用来逃避 AI 代码审查器。(source)

-

Grok 4.3 在专门法律和金融基准上领先,但私有基准引发怀疑。 CaseLaw v2 准确率 79.31%(超过 GPT 5.1 的 73.42%),CorpFin v2 为 68.53%,价格为每百万 token 1.25/2.5 美元。成本性能比有吸引力,但即时回复中的反弹——“私有基准总需要谨慎”——凸显了 CLBench 1.0 试图解决的验证缺口。(source)

-

Visa、Coinbase、Stripe 和 Google 都在构建,智能体式 AI 支付基础设施正在进入主流。 多个独立信号汇聚:Visa 发布智能体 CLI,x402 进入 Linux Foundation,并出现专门的 AgenticDay 会议。讨论已经从“智能体是否应该交易?”转向“它们在哪条轨道上交易?”开发者工具层仍是缺口。(source)

-

AI 集成能力——而不是 AI 能力——是中型企业采用的瓶颈。 “需求正在超过部署能力”抓住了结构性错配:模型准备好了,企业想要它们,但实施团队数量不够。再加上 OpenAI 据称正在组建 100 亿美元企业 AI 事业、IBM-Oracle 扩展合作,信号很清楚:商业 AI 时代的约束是部署,而不是开发。(source, source)

-

中国法院为反对 AI 驱动岗位替代立下第一个司法标记。 Hangzhou 裁决认定采用 AI 不是终止雇佣的有效法律理由——尽管在中国大陆法系中不构成约束性先例——这为 AI 劳动政策开辟了新战线。随着 AI 部署规模化,围绕劳动力影响的监管摩擦将越来越影响采用时间线和企业风险计算。(source)

-

即便在放松监管取向的政府下,美国政府也在考虑强制 AI 模型安全审查。 Trump 白宫提出发布前 AI 安全测试——包括 DoD 红队测试——代表一个超越党派框架的政策信号。再加上 WEF 发布 AI 网络安全治理要求(84 个组织、15 个行业),前沿模型发布的合规开销正从各个方向增加。(source, source)